Python DB库分页查询:实现快速数据检索的高效技巧

发布时间: 2024-10-17 18:20:50 阅读量: 31 订阅数: 33

无需编写任何代码即可创建应用程序:Deepseek-R1 和 RooCode AI 编码代理.pdf

# 1. 分页查询的必要性和理论基础

在数据密集型的应用中,分页查询是一个关键的操作,它能够帮助我们在数据库中高效地检索大量数据。合理的分页技术不仅能够减少单次数据加载的压力,还能提升用户界面的交互体验。本章将介绍分页查询的必要性,以及其在数据库管理系统中的理论基础。

## 1.1 分页查询的必要性

分页查询在数据库操作中十分常见,尤其是在Web应用程序中。当数据量非常庞大时,一次性加载所有数据到客户端会导致性能下降,甚至可能导致程序崩溃。通过分页查询,可以将数据集分切成较小的块(即“页”),每次只加载一页数据,从而避免了这些性能问题。

## 1.2 分页查询的理论基础

分页查询通常依赖于数据库提供的排序和限制(limit)功能。通过指定从哪一条记录开始获取数据(offset)以及希望获取记录的总数(limit),我们可以控制查询结果的分页。在SQL语言中,分页的基本语法大致如下:

```sql

SELECT * FROM table_name ORDER BY id LIMIT number_of_records OFFSET starting_point;

```

在实际应用中,分页的实现可能会更加复杂,因为涉及到优化查询性能以及处理不同数据库的兼容性问题。在后续章节中,我们会深入探讨分页查询的实现技术,包括游标分页、使用ORM框架等,以及如何对分页查询进行性能优化。

分页查询不仅是一种数据管理的手段,更是一种用户友好的信息呈现方式。通过合理的分页设计,我们可以提供更加流畅、高效的用户体验,尤其是在数据密集型的应用场景下。

# 2. Python数据库连接和游标管理

数据库连接和游标管理是进行数据库操作的基础,也是实现分页查询的重要组成部分。本章节我们将详细介绍Python DB API的使用,探讨连接池的实践和优势,以及SQL注入的防范策略和实践。

## 2.1 Python DB API的基本使用

Python DB API是Python数据库接口规范,它为访问不同的数据库提供了统一的接口,使得开发者能够在不同的数据库系统之间进行迁移,而不必修改太多代码。

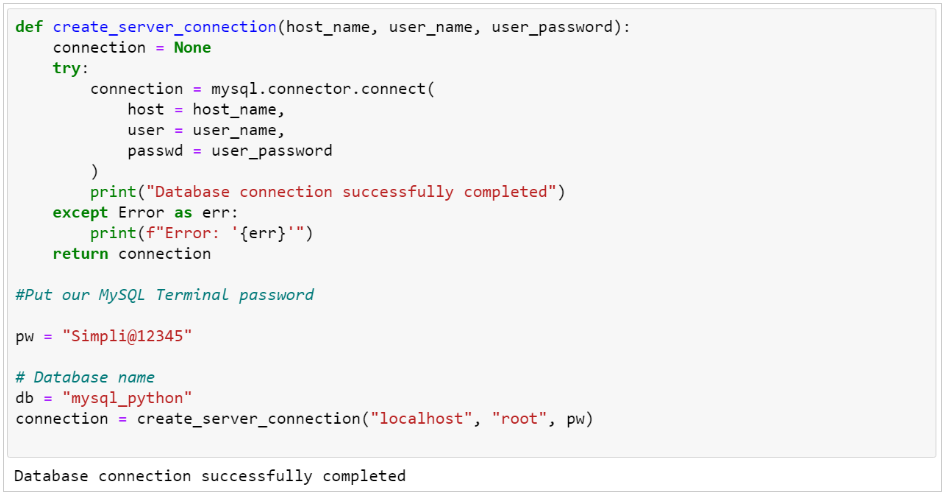

### 2.1.1 连接数据库

连接数据库是使用Python DB API的第一步。以MySQL为例,我们需要安装MySQL连接器,并使用它来创建连接和执行SQL语句。

```python

import mysql.connector

# 创建连接

connection = mysql.connector.connect(

host='***.*.*.*',

user='yourusername',

password='yourpassword',

database='yourdatabase'

)

# 检查连接是否成功

if connection.is_connected():

db_info = connection.get_server_info()

print("成功连接到MySQL数据库服务器,服务器版本:", db_info)

else:

print("连接失败")

```

以上代码首先导入`mysql.connector`模块,并使用`connect`方法创建一个新的数据库连接。参数`host`、`user`、`password`、和`database`分别代表数据库服务器的地址、用户名、密码和数据库名。

### 2.1.2 游标对象的作用与使用

连接到数据库后,通常会使用游标(cursor)对象来执行SQL语句和获取结果。游标可以帮助你有效地处理数据,特别是大规模数据。

```python

cursor = connection.cursor()

# 执行SQL命令

cursor.execute("SELECT VERSION()")

# 获取单条记录

data = cursor.fetchone()

print("数据库版本:", data)

# 关闭游标

cursor.close()

```

在这里,`cursor`方法被用来获取游标对象,并用它执行SQL语句。`fetchone()`方法用于获取查询结果的第一行,如果查询结果只有一行,`fetchone()`将返回包含该行的元组,如果查询结果为空,则返回None。

## 2.2 数据库连接池的实践与优势

数据库连接池是缓存数据库连接的容器。它可以在多个应用请求之间重复使用现有的数据库连接,而不是每次请求都创建新的连接。

### 2.2.1 连接池的定义与原理

连接池可以显著减少应用程序和数据库之间的交互次数,提高程序的性能。连接池通过复用连接而不是每次都创建新的连接来减少数据库的负载。

### 2.2.2 Python中连接池的实现方法

在Python中,可以使用诸如`psycopg2`、`pymysql`等数据库模块自带的连接池功能,也可以使用第三方库如`SQLAlchemy`。

```python

from sqlalchemy import create_engine

from sqlalchemy.pool import QueuePool

# 创建一个带有连接池的引擎

engine = create_engine(

"mysql+pymysql://username:password@host:port/dbname",

poolclass=QueuePool,

pool_size=5, # 连接池大小

max_overflow=10, # 最大溢出连接数

)

# 连接池会在这里初始化

```

在上面的代码中,我们使用`SQLAlchemy`创建了一个带有连接池的数据库引擎。`pool_size`定义了连接池中初始的连接数,而`max_overflow`定义了可以临时创建的最大连接数。

## 2.3 SQL注入与安全查询

SQL注入是一种常见的安全漏洞,攻击者通过在SQL语句中注入恶意SQL代码,获取未授权的数据访问。了解SQL注入的原理和防范策略对保障数据库安全至关重要。

### 2.3.1 SQL注入的原理与风险

SQL注入通过在输入字段中插入恶意的SQL代码片段,使原本的SQL语句逻辑发生改变,从而达到攻击者想要的操作。比如,通过在登录界面输入特殊的用户名和密码组合,绕过安全验证。

### 2.3.2 防范SQL注入的策略和实践

防范SQL注入的最好方法是使用参数化查询。参数化查询可以确保传入的参数不会被解释为SQL代码的一部分,而是作为数据处理。

```python

cursor.execute("SELECT * FROM users WHERE username=%s AND password=%s", (username, password))

```

在上述代码中,`%s`是参数占位符,`cursor.execute`方法的第二个参数是一个元组,包含了传入的参数。这种方式能有效避免SQL注入,因为无论传入什么值,它们都会被当作数据处理,而不会被解释为SQL命令的一部分。

在本章节中,我们深入学习了如何在Python中使用DB API连接数据库和使用游标对象,了解了数据库连接池的定义、原理和实现方法,并讨论了SQL注入的原理、风险以及防范措施。这为我们在下一章节中实现分页查询提供了坚实的技术基础。

# 3. 分页查询的实现技术

随着应用程序和数据库规模的日益增长,有效地管理和展示大量数据成为开发者面临的常见问题。分页查询作为一种技术手段,能够帮助我们高效地处理和呈现数据。本章我们将深入探讨分页查询的实现技术,从基于游标的分页技术到使用ORM框架,再到性能优化,我们都会逐步展开讨论。

## 3.1 基于游标的分页技术

### 3.1.1 游标分页的工作机制

游标(Cursor)是数据库管理系统中用于处理数据的工具之一,它允许用户对查询结果集进行逐行访问。游标分页技术就是利用游标逐行处理数据的能力,通过逐步移动游标的位置来实现分页效果。

游标分页的基本流程如下:

1. 定位到结果集的开始位置。

2. 通过游标的滚动操作,按需获取数据页面。

3. 每次获取固定数量的记录,这些记录构成一页。

4. 当需要下一页时,移动游标到下一页的起始位置。

5. 重复上述步骤直到获取所有数据。

0

0