GAN训练中的模式崩溃问题:原因、影响与全面解决方案

发布时间: 2024-09-03 14:51:02 阅读量: 250 订阅数: 57

java+sql server项目之科帮网计算机配件报价系统源代码.zip

# 1. GAN训练概述

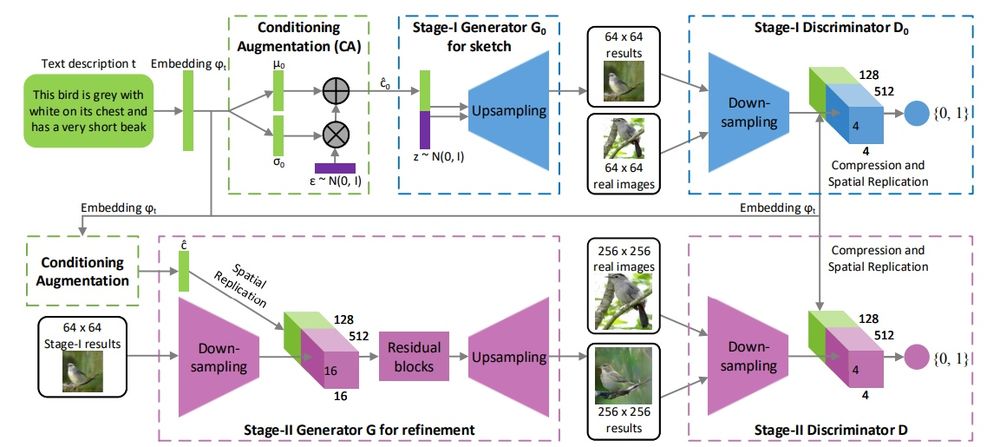

GAN(生成对抗网络)是一种深度学习模型,它通过两个神经网络的对抗学习,来生成与训练数据集相似的新数据。在GAN的训练过程中,生成器(Generator)负责创造出逼真的数据,而判别器(Discriminator)则试图区分真实数据和生成数据。尽管GAN在图像生成、语音合成等领域取得了巨大成功,但其训练过程常常面临困难,尤其是所谓的模式崩溃(Mode Collapse)问题。

模式崩溃是指生成器在训练过程中开始重复生成相同的或非常相似的输出,失去了生成多样性数据的能力。这不仅降低了生成数据的质量,也使得训练变得不稳定。在接下来的章节中,我们将深入探讨模式崩溃现象的理论基础、影响以及缓解策略,帮助读者更好地理解和掌握GAN的训练技术。

# 2. 模式崩溃问题的理论分析

### 2.1 GAN的工作原理

#### 2.1.1 生成器与判别器的基本概念

生成对抗网络(GAN)由两部分组成:生成器(Generator)和判别器(Discriminator)。生成器的主要任务是从随机噪声中生成尽可能逼真的数据实例。它接受噪声向量z作为输入,通过一个不断学习的映射函数,输出看似来自真实数据分布的样本。判别器的任务则是区分真实样本和生成器生成的假样本。它从真实数据集中和生成器处接收样本,并输出一个介于0到1之间的分数,代表样本为真或假的概率。

GAN的训练过程可以类比为对抗游戏,其中生成器和判别器相互竞争。生成器不断学习如何产生越来越难以被判别器识别的假样本,而判别器则不断提高其准确区分真假样本的能力。理想情况下,这种动态平衡会引导生成器产生高质量的假样本,以至于连判别器也无法有效区分,从而使得生成样本在统计上与真实样本无法区分。

#### 2.1.2 GAN训练目标的数学表述

数学上,GAN的训练目标可以表述为一个二元函数的极小极大(minimax)问题。训练目标函数为:

```math

\min_G \max_D V(D, G) = \mathbb{E}_{x \sim p_{data}(x)}[\log D(x)] + \mathbb{E}_{z \sim p_z(z)}[\log(1 - D(G(z)))]

```

其中,`\(V(D, G)\)` 是值函数,`\(G\)` 是生成器,`\(D\)` 是判别器。`\(p_{data}(x)\)` 是真实数据的分布,而 `\(p_z(z)\)` 是先验噪声分布。`\(D(x)\)` 表示判别器判断样本 `\(x\)` 来自真实数据分布的概率。生成器 `\(G\)` 通过最小化其生成数据被 `\(D\)` 正确分类的概率来训练,即最大化 `\(D(G(z))\)`。

### 2.2 模式崩溃现象的定义

#### 2.2.1 模式崩溃的概念和特点

模式崩溃(Mode Collapse)是生成对抗网络中出现的一种现象,指的是生成器开始重复生成一些特定的样本或仅覆盖数据分布中的有限模式,从而无法覆盖整个真实数据的多样性。这种现象的特点包括生成样本的多样性下降、样本在某些特征上表现出相似性或重复性等。

模式崩溃可能导致生成器的学习过程陷入停滞,因为生成器已经找到了一些可以轻易欺骗判别器的样本,从而导致判别器的梯度信息失效或变得非常微弱。由于缺乏有效的梯度指导,生成器可能无法继续学习和改进,因此模式崩溃对GAN的训练和性能有着负面影响。

#### 2.2.2 模式崩溃发生的条件和后果

模式崩溃的条件一般发生在生成器和判别器能力失衡时。当生成器过于强大或过于弱小,或者判别器过于强大或过于弱小,都有可能触发模式崩溃。此外,GAN的损失函数设计不当、训练数据的分布不平衡,以及随机梯度下降(SGD)的学习速率设置不合适等,也可能会促使模式崩溃现象的发生。

模式崩溃的后果是对GAN的性能产生负面影响。具体而言,生成样本的多样性减少,质量下降,真实性和多样性之间的平衡被打破。这不仅影响了模型的实用性,还限制了GAN在各种应用中的潜力,如图像生成、数据增强等。

### 2.3 模式崩溃的理论原因

#### 2.3.1 损失函数的不稳定性

损失函数在GAN中起着关键作用,它直接影响模型训练时的梯度信息。传统的GAN训练中使用的是交叉熵损失函数,它在某些情况下是不稳定的。在梯度消失或梯度爆炸的情况下,生成器不能有效地学习到如何改进,进而可能陷入模式崩溃。

此外,当判别器过于自信,即总是对真实样本和生成样本给出极端的判断(例如,总是输出接近1或0的值),此时生成器获得的梯度信号将变得非常微弱。由于判别器的不稳定性,生成器难以得到有效的学习信号,可能导致其输出模式变得过于单一。

#### 2.3.2 训练数据的不平衡性

在某些情况下,训练数据集可能本身存在不平衡性,例如某些类别的样本数量远远多于其他类别。这种不平衡性可能加剧模式崩溃。如果生成器在学习过程中倾向于生成那些更容易被判别器接受的样本(即数据丰富的类别),那么它可能会忽视或很少生成那些数据稀缺的类别样本。结果是,生成器只覆盖了数据分布的一部分,从而导致模式崩溃。

#### 2.3.3 模型容量与训练过程的互动关系

模型容量指的是模型能够表示或学习数据分布的能力。在GAN中,模型容量包括生成器和判别器的容量。如果生成器的容量太低,它可能无法捕捉到数据分布的复杂性,从而导致生成样本的多样性不足。相反,如果判别器的容量过高,它可能会过于快速地学习到区别真假样本的细微差别,这可能导致生成器在生成新的、多样化样本上面临困难。这种模型容量和训练过程的不匹配会导致模式崩溃现象的发生。

接下来,我们将探讨模式崩溃问题对GAN性能的影响以及相关的解决策略。

# 3. 模式崩溃问题的影响

模式崩溃是生成对抗网络(GAN)在训练过程中常见的问题,它会显著地影响GAN的性能和应用。本章将详细探讨模式崩溃对GAN性能以及研究和应用的影响。

## 3.1 对GAN性能的影响

模式崩溃问题对GAN的性能产生深远影响,主要体现在生成样本的质量下降和训练过程的不稳定。

### 3.1.1 生成样本质量下降

当GAN遇到模式崩溃时,生成器生成的样本往往会失去多样性,出现过度相似的问题。这导致生成样本的多样性和质量严重下降,从而难以满足实际应用中对高分辨率、高真实感图像的需求。样本质量的下降使得GAN的应用范围和效果都大打折扣,尤其在图像处理、视频生成等对样本质量要求极高的领域。

### 3.1.2 训练过程的不稳定性

模式崩溃会导致GAN的训练过程变得非常不稳定。在训练初期,生成器和判别器可能还能在某种程度上进行正常的对抗训练,但随着训练的深入,模式崩溃问题越来越严重,判别器可能很快就学会区分真实样本和生成样本。由于生成样本之间的差异越来越小,判别器可以轻易地获得高准确率,进而使得生成器的梯度更新变得微弱,训练过程陷入停滞。

## 3.2 对研究和应用的阻碍

模式崩溃不仅仅是技术问题,它还给GAN的研究和应用带来了许多挑战。

### 3.2.1 研究进展的限制因素

在GAN的

0

0