【MapReduce终极指南】:从0到1精通WordCount

发布时间: 2024-11-01 05:42:40 阅读量: 19 订阅数: 17

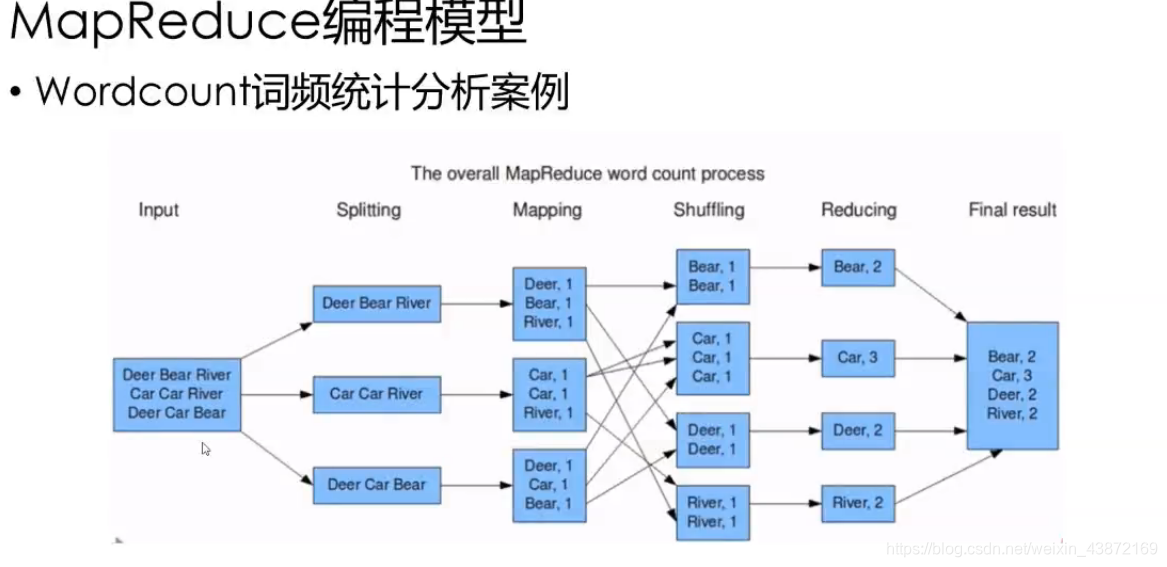

# 1. MapReduce简介与WordCount案例

MapReduce是一种编程模型,用于在大型数据集上实现并行运算。它由Google提出,并在Hadoop框架中得到广泛实现。通过Map和Reduce两个步骤,可以将复杂的数据处理过程简化为两个可管理的阶段,从而处理和分析大规模数据集。

## 1.1 MapReduce编程模型

MapReduce编程模型基于两个主要概念:Map和Reduce。

### Map阶段

在Map阶段,输入的数据被分割为独立的块,然后由Map任务并行处理。每个Map任务执行指定的处理逻辑,通常是对数据进行排序、过滤或转换操作,并输出键值对(key-value pairs)。

```java

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

```

### Reduce阶段

Reduce阶段则对所有Map任务输出的键值对进行汇总。它按照键(key)对这些值进行分组,并执行一个Reduce函数,通常用于汇总或合并值。

```java

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

## 1.2 WordCount案例

WordCount是MapReduce模型的经典入门案例,用于统计文本中单词的出现次数。它简单直观地展示了MapReduce模型如何将复杂的任务分解为可管理的部分,并通过Map和Reduce两个步骤完成任务。

### Map任务

在Map任务中,我们将输入的文本文件拆分为单词,并将每个单词映射为键值对(word, 1)。

### Reduce任务

然后Reduce任务将相同单词的所有键值对的值累加,得到每个单词的总出现次数。

通过这个案例,开发者可以初步理解MapReduce如何在分布式环境下处理大规模数据集,并理解其核心工作原理。下一章将深入探讨MapReduce的核心原理。

# 2. MapReduce的核心原理

### 2.1 MapReduce编程模型

MapReduce编程模型将复杂的数据处理流程分解为两个关键阶段:Map阶段和Reduce阶段。

#### 2.1.1 MapReduce的工作流程

MapReduce模型的工作流程从输入数据开始,数据首先被切分成块(block),这些块被分配给Map任务处理。Map任务处理输入数据,将其转换为一系列键值对(key-value pairs)。这些键值对经过Shuffle过程,被发送到相应的Reduce任务。每个Reduce任务对这些键值对进行排序和合并,最后将结果输出。整个过程如下:

1. **输入分片(Input Splits)**: 输入数据被分解为多个片段,每个片段对应一个Map任务。

2. **Map任务处理**: Map函数读取输入片段,对数据进行处理,并生成键值对。

3. **Shuffle和Sort**: Map输出的键值对经过Shuffle过程,排序后发送给相应的Reduce任务。

4. **Reduce任务处理**: Reduce函数对来自Map任务的中间结果进行合并,生成最终结果。

5. **输出**: 最终结果写入到输出文件系统。

```mermaid

graph LR

A[输入数据] -->|切分| B[输入分片]

B -->|读取和处理| C[Map函数]

C -->|中间键值对| D[Shuffle和Sort]

D -->|排序后的键值对| E[Reduce函数]

E --> F[输出结果]

```

#### 2.1.2 Map和Reduce任务的执行机制

Map任务执行时,Map函数会读取输入数据,处理后输出键值对。随后,这些键值对经过Shuffle过程,根据键值进行排序,并路由到正确的Reduce任务。Reduce任务则按照键值对进行合并操作,最终输出聚合后的结果。

Map阶段的核心在于将数据转换为键值对形式,而Reduce阶段的重点是将这些键值对进行合并,以达到用户期望的最终输出。

### 2.2 数据流和任务调度

在Hadoop中,MapReduce框架负责数据流和任务调度,以确保高效地执行任务。

#### 2.2.1 数据的分区和排序

在MapReduce的Shuffle阶段,数据经过分区器(Partitioner)以确保具有相同键的值被发送到同一个Reduce任务。排序过程则发生在每个分区内部,保证了每个Reduce任务接收到的是有序的数据。

```mermaid

flowchart LR

A[Map输出] -->|Shuffle| B[分区和排序]

B -->|有序键值对| C[Reduce输入]

```

#### 2.2.2 Hadoop中的任务调度

Hadoop通过任务调度器来管理作业执行。它包括资源调度器(如YARN的ResourceManager),它负责资源的分配和任务的调度。调度器根据资源可用性、任务需求和其他因素来决定任务的执行顺序和位置。

### 2.3 MapReduce优化策略

优化MapReduce作业是提高大数据处理效率的重要环节。

#### 2.3.1 Combiner与Partitioner的作用

Combiner是一个可选组件,它在Map输出之后和Shuffle之前对数据进行局部合并,减少了传输到Reduce任务的数据量。Partitioner决定数据如何在不同的Reduce任务之间进行分区。通过合理设计Combiner和Partitioner,可以显著提高作业的性能。

#### 2.3.2 优化MapReduce性能的最佳实践

最佳实践包括选择合适的键值对类型、优化Map和Reduce函数的执行效率、合理配置MapReduce作业的参数等。此外,针对特定作业的硬件优化,如调整HDFS块大小或优化网络设置,也能显著影响性能。

以上章节内容展示出MapReduce的工作机制和优化策略,为理解和实施MapReduce作业提供了详尽的理论基础。下一章将深入探讨如何通过WordCount案例,将理论应用于实际场景中。

# 3. WordCount实战详解

## 3.1 WordCount的Map阶段实现

### 3.1.1 输入数据的读取和解析

在MapReduce的Map阶段,数据处理的第一步是读取输入文件。在WordCount例子中,输入通常是一系列文本文件。MapReduce框架使用InputFormat来定义如何读取数据。对于文本文件,常见的InputFormat是TextInputFormat,它将每一行文本作为独立的记录处理。

```java

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setInputFormatClass(TextInputFormat.class);

FileInputFormat.addInputPath(job, new Path(inputPath));

```

上述代码配置了Job对象,指定了Job的名称,并设置了输入格式为TextInputFormat。`FileInputFormat.addInputPath()`方法用于添加输入数据的路径。

TextInputFormat会为每行文本返回一个key-value对,其中key是行的起始位置(字节偏移量),value是行的内容。Map任务接收到这些key-value对后,需要将其解析为单词计数所需的格式。

### 3.1.2 单词计数的Map函数逻辑

Map函数需要完成两个主要任务:首先,它要解析输入数据;然后,它需要对每个单词进行计数。在Java中,Map函数通常由一个继承自`Mapper`的类实现。

```java

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

```

上述代码中的`TokenizerMapper`类实现了map方法。它接收输入的key-value对,然后使用`StringTokenizer`将文本行分解为单词。每个单词都会映射为一个新的key-value对,其中key是单词本身,value是计数1。

## 3.2 WordCount的Reduce阶段实现

### 3.2.1 Map输出结果的排序和分组

Map任务完成后,输出的中间结果需要进行排序和分组,以便于Reduce任务的处理。MapReduce框架会对Map输出的key进行排序,并按照key的字典顺序将相同key的所有value聚集在一起。

```java

job.setSortComparatorClass(***parator.class);

```

这里设置了输出key的排序规则为`***parator`,它按照字典顺序排序。排序后,相同key的value会被组合在一起,形成一个列表,这个列表会作为Reduce任务的输入。

### 3.2.2 Reduce函数的聚合计算

Reduce任务接收来自Map任务的输出,其主要任务是将相同key的所有value聚合起来进行计算。在WordCount例子中,Reduce任务将相同单词的所有计数合并为一个总数。

```java

public static class IntSumReducer

extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

上述代码中的`IntSumReducer`类实现了reduce方法。它遍历排序后分组的value列表,将它们相加得到总和,然后输出单词和对应的总数。

## 3.3 WordCount完整代码解析

### 3.3.1 环境搭建和代码提交

在编写WordCount程序之后,接下来需要将代码打包成JAR文件,并在Hadoop集群上提交运行。首先,设置Hadoop环境变量并配置Hadoop配置文件。

```bash

export HADOOP_HOME=/path/to/hadoop-install-dir

export PATH=$PATH:$HADOOP_HOME/bin

```

然后,使用`jar`命令打包WordCount类文件和相关的资源文件:

```bash

jar cf wc.jar WordCount*.class

```

最后,通过`hadoop jar`命令将打包好的JAR文件提交到Hadoop集群运行:

```bash

hadoop jar wc.jar WordCount /input/path /output/path

```

### 3.3.2 代码调试和运行结果分析

提交作业后,可以通过Hadoop提供的命令行工具监控作业的运行状态:

```bash

hadoop job -list

hadoop job -status <job_id>

```

作业完成后,检查输出目录以查看结果文件。可以通过查看结果文件来验证程序的正确性:

```bash

hadoop fs -cat /output/path/part-r-00000

```

使用以下命令查看计数结果:

```java

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

```

至此,WordCount程序的MapReduce逻辑已全部实现并解释完毕。通过这段代码,可以深入理解MapReduce框架如何将计算任务分解为Map和Reduce两个阶段,以及这两个阶段如何相互协作完成大规模数据的处理工作。

# 4. MapReduce的高级主题

## 4.1 自定义Partitioner与Combiner

### 设计自定义Partitioner

在MapReduce框架中,默认的Partitioner(分区器)基于哈希算法将Map输出的键值对均匀分配到各个Reducer中。然而,在有些特定的场景下,我们可能需要根据实际需求,将数据划分到特定的Reducer中。这时,就需要我们设计一个自定义的Partitioner来实现这一需求。

```java

public class CustomPartitioner extends Partitioner<Text, IntWritable> {

@Override

public int getPartition(Text key, IntWritable value, int numPartitions) {

// 使用简单的键值对规则来划分数据

if (key.toString().startsWith("A") || key.toString().startsWith("a")) {

return 0;

} else if (key.toString().startsWith("B") || key.toString().startsWith("b")) {

return 1 % numPartitions;

} else {

return (key.hashCode() & Integer.MAX_VALUE) % numPartitions;

}

}

}

```

上述代码创建了一个简单的自定义Partitioner,它根据键的起始字符将键值对分配到两个Reducer中。当键值以"A"或"a"开始时,数据会被发送到第一个Reducer,如果以"B"或"b"开始,则发送到第二个Reducer,其它情况下则使用默认的哈希方法分配。

### 实现自定义Combiner的逻辑

Combiner是MapReduce中的可选组件,它在Map端对输出的数据进行局部合并,以减少传输到Reducer的数据量,从而提高效率。设计一个自定义的Combiner,需要继承Reducer类,并实现reduce方法。

```java

public class CustomCombiner extends Reducer<Text, IntWritable, Text, IntWritable> {

@Override

public void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

context.write(key, new IntWritable(sum));

}

}

```

在WordCount案例中,如果使用了Combiner,每个Map任务在其输出中对相同单词的计数会进行合并,这样就减少了网络传输的数据量。如上述代码所示,我们对每个单词的计数进行了简单的累加操作。

## 4.2 多阶段MapReduce任务

### 任务链式处理的设计思路

多阶段MapReduce任务涉及将多个MapReduce作业按顺序连接在一起处理数据。这种模式允许我们通过组合多个任务来实现复杂的数据处理流程。

设计多阶段MapReduce任务的基本思路是:每个阶段的MapReduce作业的输出成为下一个阶段的输入。这就需要在每个作业之间进行精心设计,确保数据的格式和类型在任务间正确传递和转换。

### 实现多阶段MapReduce的案例

下面是一个简单的多阶段MapReduce任务案例,它演示了如何将两个MapReduce作业链接在一起。

```java

// 第一阶段MapReduce作业,对单词进行计数

public class FirstStageMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

// 省略具体实现...

}

public class FirstStageReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

// 省略具体实现...

}

// 第二阶段MapReduce作业,对第一阶段的输出结果进行汇总

public class SecondStageMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

// 省略具体实现...

}

public class SecondStageReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

// 省略具体实现...

}

```

在这个案例中,第一阶段计算单词出现的次数,而第二阶段对第一阶段的结果进行汇总。每个阶段都有独立的Mapper和Reducer实现。

## 4.3 MapReduce的容错机制

### 失败任务的自动重启

MapReduce框架具有自动任务重启的容错机制。当某个任务失败时,框架会自动重新调度和执行该任务。失败的原因可能是节点故障、网络问题或用户代码错误等。

### 数据的备份与恢复策略

MapReduce的备份机制是通过复制Map和Reduce任务的输出文件实现的。当MapReduce任务失败时,框架会从最近的成功节点恢复任务。Hadoop通过设置`mapreduce.tasktracker.map.tasks.maximum`和`mapreduce.tasktracker.reduce.tasks.maximum`等参数来控制任务槽的数量,这间接影响备份的数量。

为了更高级的容错,可以使用Hadoop的Rack Awareness策略来提升数据的安全性。该策略确保备份数据分布在不同的机架上,以便在某一机架失效时,数据仍然可用。

> 通过实现自定义的Partitioner和Combiner,可以更细致地控制数据处理的流程,并优化MapReduce作业的执行效率。多阶段MapReduce任务展示了如何将多个作业连接起来,以实现复杂的数据处理。最后,MapReduce框架的容错机制保障了作业在遇到故障时能够自动恢复,同时,备份和恢复策略确保了数据的安全性。

# 5. 深入MapReduce生态系统

## 5.1 MapReduce与Hadoop生态系统

### 5.1.1 MapReduce在Hadoop中的位置

MapReduce是Hadoop生态系统中的核心处理框架,专门用于大规模数据集的分布式处理。随着Hadoop的发展,MapReduce已经从一个简单的批处理工具演变为一个成熟的数据处理平台。它在Hadoop中的位置相当于一个处理引擎,负责执行用户编写的Map和Reduce任务。MapReduce框架负责任务调度、监控任务执行、处理任务失败等情况,确保作业的顺利进行。

为了更好地理解MapReduce在Hadoop生态系统中的作用,我们需要清楚Hadoop的两大核心组件:Hadoop Distributed File System (HDFS)和Yet Another Resource Negotiator (YARN)。

- **HDFS**是Hadoop的存储组件,负责管理存储在集群中的数据,保证数据的高可靠性和容错性。它为MapReduce提供数据存储的能力。

- **YARN**是Hadoop的资源管理组件,负责管理集群资源的分配、作业调度等。YARN将资源管理与作业调度分离,使得MapReduce以及其他计算框架可以在同一个资源池中运行。

MapReduce通过YARN提交任务,YARN则将任务调度到拥有足够资源的计算节点上执行。MapReduce处理完毕后,将结果写回到HDFS中。

### 5.1.2 其他Hadoop生态系统组件概览

除了MapReduce,Hadoop生态系统还包括许多其他组件,这些组件极大地丰富了Hadoop的数据处理能力。

- **HBase**是一个可扩展的非关系型分布式数据库,它运行在HDFS之上,为大数据提供实时读写的能力。

- **Hive**是一个数据仓库工具,它提供了数据摘要、查询和分析的功能,可以将SQL语句转换成MapReduce任务执行。

- **Pig**是一个高级的数据流语言和执行框架,它简化了数据的ETL操作。Pig的脚本最终会被转换为MapReduce任务。

- **Zookeeper**是一个分布式协调服务,管理着集群中的配置信息、命名空间和同步状态等。

- **Oozie**是一个工作流调度系统,用于管理和调度在Hadoop集群上的工作流作业。

这些组件的引入,不仅提高了数据处理的效率,也增加了Hadoop处理各种数据类型和数据源的能力。MapReduce因此不再是唯一的大数据处理工具,但仍然是Hadoop生态系统中不可或缺的重要组成部分。

## 5.2 MapReduce在现代大数据处理中的角色

### 5.2.1 MapReduce与Spark的对比

随着技术的发展,Apache Spark逐渐成为另一个处理大数据的主要框架,它提供了更高级的抽象,使得数据分析更加便捷、高效。与MapReduce相比,Spark在以下几个方面表现出了优势:

- **计算速度**:Spark利用了内存计算的优势,可以显著提高数据处理速度,特别是在迭代算法中。

- **易用性**:Spark提供了RDD和DataFrame等高级抽象,简化了复杂的数据处理逻辑。

- **容错机制**:Spark通过RDD的lineage进行容错,相比MapReduce的磁盘写入具有更高的容错效率。

尽管如此,MapReduce仍然在一些场景下显示出其独特的优势,特别是需要稳定性和成熟度的大型企业级应用。MapReduce的批处理能力以及对任务完整性的严格控制使其在需要长时间运行的复杂作业中表现卓越。

### 5.2.2 MapReduce的未来发展方向

在现代大数据处理的背景下,MapReduce并没有停滞不前。它正朝着以下几个方向发展:

- **性能优化**:通过改进底层的执行引擎和调度策略,提升MapReduce的性能,以适应更快的数据处理需求。

- **集成更多组件**:与Hadoop生态系统中的其他组件如Spark、Hive等进行更紧密的集成,为用户提供更加一体化的数据处理解决方案。

- **云计算融合**:MapReduce正在逐步适应云环境,通过云服务的弹性扩展能力和按需计费模式,使其更加灵活和经济。

MapReduce仍然是处理大规模数据集的强大工具,未来它可能会在性能、易用性以及与新工具的集成方面有更多的突破。

## 5.3 企业级应用案例分享

### 5.3.1 实际业务中的MapReduce应用

在企业级应用中,MapReduce被广泛用于处理海量的日志数据、进行数据挖掘、构建推荐系统等。一个典型的例子是电商网站的用户行为分析。

在这个场景中,MapReduce通过分析用户的点击流数据,能够发现用户的偏好模式,从而为用户提供个性化的推荐。此外,MapReduce也可以用于计算用户访问频率,帮助理解用户活跃度。

使用MapReduce进行日志处理的流程通常包括:

1. **数据采集**:从多个服务器收集日志数据。

2. **数据预处理**:使用MapReduce进行数据清洗和格式化。

3. **数据分析**:通过MapReduce进行模式识别和趋势分析。

4. **结果存储**:将分析结果存储在HDFS中,供进一步使用。

### 5.3.2 案例分析与经验总结

以某电商网站为例,该网站使用MapReduce对用户行为日志进行分析,以便优化商品推荐算法。通过MapReduce,网站能够处理TB级的日志数据,并从中提取有用的信息。

在实施过程中,该网站遇到的主要挑战包括数据的高可靠性存储、任务执行效率以及数据处理的实时性。针对这些挑战,他们采取了以下措施:

- **使用HDFS**:利用HDFS的高容错机制,保证数据不会因为单点故障而丢失。

- **优化MapReduce作业**:通过调整MapReduce任务的配置参数,优化执行计划,以提高作业效率。

- **引入流式处理**:配合Storm、Flink等流式处理框架,提高数据处理的实时性。

总体而言,MapReduce在处理大规模数据时显示出了其不可替代的作用,但是企业也需要根据实际需求,结合其他工具进行综合的数据处理。未来,MapReduce应考虑与其他大数据处理工具的融合,以适应不断变化的数据处理需求。

0

0