Spark大数据处理实战指南:从入门到精通,高效处理海量数据

发布时间: 2024-07-14 01:07:07 阅读量: 47 订阅数: 21

# 1. Spark大数据处理简介**

Spark是一个开源的分布式计算框架,专门用于处理大规模数据集。它提供了丰富的API,支持多种编程语言,包括Scala、Java、Python和R。Spark的核心概念是弹性分布式数据集(RDD),它是一个不可变的、分区的数据集合,可以分布在集群中的多个节点上。

Spark的优势在于其高性能、可扩展性和易用性。它利用分布式计算和内存计算技术,可以高效地处理TB级甚至PB级的数据。此外,Spark提供了一个交互式shell,允许用户快速地探索和分析数据,并提供了一个丰富的生态系统,包括机器学习库、流处理框架和图形处理算法。

# 2. Spark核心概念与原理

### 2.1 分布式计算框架

Spark是一个分布式计算框架,它允许在集群中并行处理大数据集。它采用主从架构,其中一个称为Driver的进程负责协调计算,而多个称为Executor的进程负责执行实际的计算任务。

### 2.2 弹性分布式数据集(RDD)

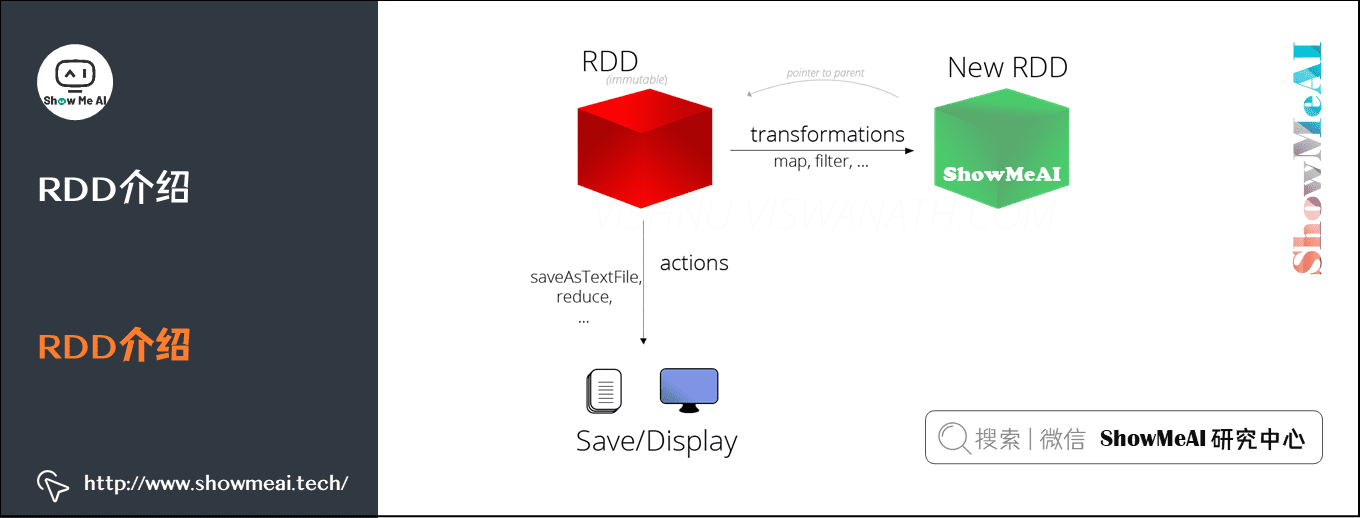

RDD(弹性分布式数据集)是Spark中表示数据的主要抽象。它是一个不可变的、分区的数据集合,分布在集群中的各个节点上。RDD支持多种操作,包括转换(如映射、过滤、分组)和操作(如聚合、连接)。

### 2.3 转换和操作

Spark提供了一系列转换和操作,用于处理和分析RDD。转换创建新的RDD,而操作返回单个值或新RDD。

**转换**

* `map()`:将每个元素映射到一个新值。

* `filter()`:过滤掉不满足条件的元素。

* `groupBy()`:根据指定键将元素分组。

**操作**

* `reduce()`:将RDD中的所有元素聚合为一个值。

* `join()`:连接两个RDD,基于共同的键。

* `count()`:返回RDD中元素的数量。

### 2.4 内存管理和性能优化

Spark使用一种称为弹性分布式数据集(RDD)的内存管理模型。RDD被分区并存储在集群中的各个节点上。Spark会自动将RDD缓存到内存中,以提高性能。

**性能优化**

* **使用宽依赖转换:**宽依赖转换(如`groupBy()`)会导致数据重新分区,从而降低性能。使用窄依赖转换(如`map()`)可以避免重新分区。

* **减少shuffle操作:**shuffle操作(如`join()`)涉及跨节点传输数据。减少shuffle操作可以提高性能。

* **使用缓存:**将经常使用的RDD缓存到内存中可以提高性能。

* **调整并行度:**并行度控制Spark用于执行任务的线程数。调整并行度可以优化性能。

**代码示例**

```python

# 创建一个RDD

rdd = sc.parallelize([1, 2, 3, 4, 5])

# 使用转换映射每个元素

mapped_rdd = rdd.map(lambda x: x * 2)

# 使用操作聚合所有元素

sum_value = mapped_rdd.reduce(lambda x, y: x + y)

# 打印结果

print(sum_value)

```

**代码逻辑分析**

* `parallelize()`创建一个分布在集群中的RDD。

* `map()`转换将每个元素映射到一个新值,创建了一个新的RDD。

* `reduce()`操作将RDD中的所有元素聚合为一个值。

**参数说明**

* `parallelize(data)`:`data`是要创建的RDD的数据。

* `map(func)`:`func`是应用于每个RDD元素的函数。

* `reduce(func)`:`func`是用于聚合RDD元素的函数。

# 3.1 数据加载和预处理

### 3.1.1 数据源连接和读取

Spark支持从各种数据源加载数据,包括文件系统(如HDFS、S3)、数据库(如MySQL、Oracle)、NoSQL数据库(如MongoDB、Cassandra)和流式数据源(如Kafka、Flume)。

**代码块:从HDFS加载CSV文件**

```scala

val df = spark.read

.option("header", "true")

.opt

```

0

0