机器学习:缺失值处理影响及优化策略

发布时间: 2024-11-20 04:02:03 阅读量: 34 订阅数: 38

全面指南:数据集缺失值处理策略与代码实现

# 1. 机器学习中的缺失值问题

在机器学习领域,数据是构建模型的基石。然而,在实际应用中,我们经常遇到的一个问题就是数据集中的缺失值。缺失值可以是由于数据录入错误、数据收集过程中的遗漏、或者某些变量根本就无法获取导致的。缺失值的存在会导致分析结果的偏差,降低模型的预测性能,因此理解和处理缺失值是构建稳健机器学习模型不可或缺的一环。

## 1.1 缺失值的普遍性与影响

缺失值在现实世界的数据集中非常常见,它们可以出现在不同的特征或者记录中。这些缺失值如果不加以处理,可能会导致以下几个问题:

- 降低数据质量:影响数据的代表性和准确性。

- 模型偏误:如果缺失不是随机的,可能会导致模型学习到错误的模式。

- 功能失效:一些算法或方法无法处理含有缺失值的数据。

## 1.2 处理缺失值的重要性

处理缺失值是数据预处理的重要步骤之一。我们可以通过以下方法来处理缺失值:

- **删除含有缺失值的记录**:简单但可能导致数据信息的大量丢失。

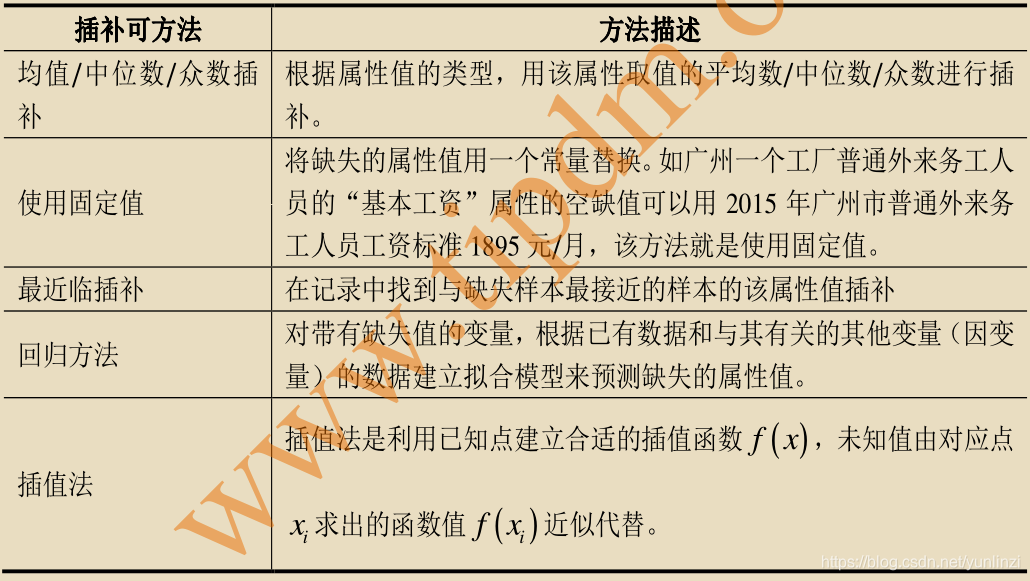

- **填充缺失值**:使用合适的策略来估计缺失值,如均值、中位数、众数或者基于模型的预测。

- **建模处理**:将缺失值处理视为模型的一部分,使用特殊的算法(如EM算法)来处理。

在选择处理方法时,需综合考虑数据的特性和后续分析的需求,以实现对缺失值的最佳处理。接下来的章节中,我们将详细介绍缺失值的分类、统计学原理、常见处理方法及其在实践中的应用。

# 2. 缺失值处理的理论基础

## 2.1 缺失数据的分类与成因

### 2.1.1 完全随机缺失

完全随机缺失(Missing Completely at Random, MCAR)是指数据缺失的情况与任何观察值无关,包括缺失值本身。这种情况下,缺失数据与数据集中未缺失的数据或任何其他已知信息之间没有任何关联性。MCAR是缺失数据分类中“最理想”的情况,因为它允许我们简化统计分析方法,并且不会引入系统偏差。判断数据是否符合MCAR通常需要进行统计检验,例如Little's MCAR test。

### 2.1.2 随机缺失

随机缺失(Missing at Random, MAR)指的是缺失值与观察数据集中的其他变量有关,但与缺失值本身无关。在这种情况下,缺失数据与未缺失的数据之间存在相关性,但一旦控制了其他变量,这种相关性就会消失。MAR的处理比较复杂,因为它可能引入系统性偏差,但与数据本身没有直接关系。

### 2.1.3 非随机缺失

非随机缺失(Not Missing at Random, NMAR)是指缺失值与观测变量或缺失值本身有直接关系。例如,健康调查中可能高收入人群更少报告其收入(可能因为隐私考虑或社会地位),而低收入人群更愿意报告。NMAR是缺失数据处理中最棘手的类型,因为它可能会对分析结果造成偏误。

## 2.2 缺失值处理的统计学原理

### 2.2.1 描述统计与缺失值

描述统计学提供了一种计算数据集特征(如均值、方差、中位数和众数)的方法,当数据集中存在缺失值时,大多数描述统计量的计算会受到影响。对于含有缺失值的数据,通常会根据不同的缺失数据类型和分析目的,采用不同的处理方法。例如,对于MCAR数据,可以通过删除含有缺失值的记录来计算描述统计量,而对于MAR或NMAR类型的数据,可能需要采用更复杂的插补方法。

### 2.2.2 推断统计与缺失值

推断统计是关于从样本数据推断总体参数的过程,缺失数据会对这一过程产生重要影响。由于缺失值的存在,可能导致统计推断的偏差或效率降低。处理方法包括调整统计测试以考虑缺失数据,或者应用适合的数据缺失模型进行参数估计。

### 2.2.3 缺失值处理模型的理论基础

缺失值处理模型的建立基于统计学和概率论原理。基本思想是构建一个概率模型,描述数据是如何生成的,包括缺失数据。模型需要将数据的观测部分和缺失部分联系起来,使我们能够基于已观测到的数据推断缺失数据的值。一种常见方法是基于似然函数或贝叶斯推理框架来估计缺失数据。这种模型通常需要对数据生成过程有一定的假设,如多元正态性等。

在接下来的章节中,我们将深入探讨缺失值处理的常见方法,并在实际应用中展示如何选择和实施这些策略。通过理解这些理论基础,我们可以更好地评估和选择适合不同数据集和分析目标的缺失值处理技术。

# 3. 缺失值处理的常见方法

在机器学习和数据分析领域中,缺失值处理是一个不可避免的问题。正确处理这些缺失值能够显著提升数据质量和后续分析的准确性。本章节将深入探讨缺失值处理的常见方法,从简单的删除策略到复杂的建模方法,并提供实用的代码示例。

## 3.1 删除含有缺失值的观察值

在某些情况下,删除含有缺失值的观察值(行)或变量(列)是一个简单有效的解决方案。这种策略尤其适用于含有缺失值的行或列数量较少时。

### 3.1.1 列删除

当某一列中的缺失值过多时,可能会选择删除这一列。删除列是一种保守的方法,可避免数据丢失过多,但会减少数据集的特征维度。

```python

import pandas as pd

import numpy as np

# 创建含有缺失值的数据集

data = pd.DataFrame({

'A': [1, 2, np.nan, 4],

'B': [5, np.nan, np.nan, 8],

'C': [9, 10, 11, 12]

})

# 删除含有缺失值的列B

data_cleaned = data.drop(columns=['B'])

```

### 3.1.2 观察值删除

与列删除相对,观察值删除涉及删除含有缺失值的整行数据。这种方法能够保留其他列的数据完整性

0

0