多变量模型挑战应对

发布时间: 2024-11-20 04:10:48 阅读量: 49 订阅数: 38

# 1. 多变量模型的基础概念和重要性

在数据驱动的时代,多变量模型作为分析和解释复杂数据的强大工具,其重要性不言而喻。多变量模型能够同时处理多个自变量与因变量之间的关系,这对于理解和预测现实世界中的复杂现象至关重要。本章将介绍多变量模型的基础概念,包括它的定义、核心思想以及在统计学中的地位。我们会阐述为何多变量分析成为了现代数据分析不可或缺的一部分,并简要探讨其在解决实际问题中的应用价值。通过本章的学习,读者将对多变量模型有一个初步的认识,并为进一步深入学习打下坚实的基础。

# 2. 多变量模型的理论基础

### 2.1 多变量模型的定义和分类

#### 2.1.1 定义及其在统计学中的角色

多变量模型是统计学中研究多个变量之间相互关系和影响的数学模型。这类模型可以包含多个因变量和多个自变量,其核心在于探讨这些变量之间的动态变化规律,以及如何利用这些规律进行预测和解释。在统计学中,多变量模型扮演着至关重要的角色,它不仅在理论研究上提供了一个框架,用于分析和理解复杂现象中的内在联系,而且在实际应用中也有着广泛的应用,比如在金融市场的风险管理、生物信息学中的基因分析、以及社会科学的数据预测等方面。

#### 2.1.2 主要分类和应用场景

多变量模型可以根据其功能和结构分为不同的类型,常见的分类包括线性模型与非线性模型、固定效应模型与随机效应模型等。线性模型是最基础的多变量模型类型,其假设模型中变量之间的关系是线性的,例如多元线性回归模型。非线性模型则包括了变量之间关系为非线性的模型,如逻辑回归、多项式回归等。固定效应模型假设模型中的某些效应不随时间或其他因素变化,而随机效应模型则认为这些效应是随机的,这在面板数据分析中尤为重要。

### 2.2 多变量模型的构建过程

#### 2.2.1 数据收集和预处理

构建多变量模型的第一步是收集数据。数据收集的准确性直接影响模型的有效性。这包括确定数据来源、数据采集的方式和数据的质量保证。预处理数据是建模之前的关键步骤,包括数据清洗、数据转换和数据标准化等。数据清洗涉及去除异常值、填补缺失值等。数据转换可能包括对变量进行对数转换或平方根转换以满足模型假设。数据标准化是为了消除不同量纲和量级带来的影响,使模型更加稳定和可靠。

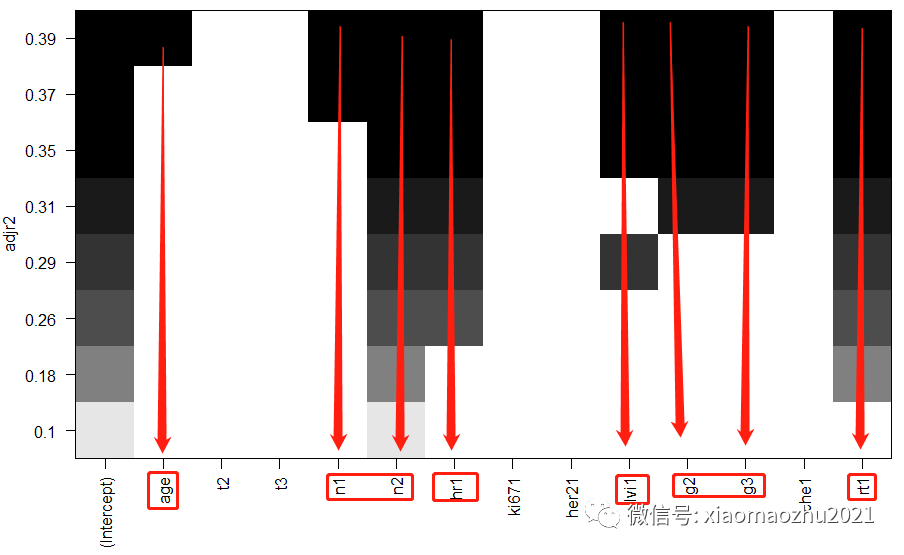

#### 2.2.2 变量选择和模型设定

在多变量模型中选择正确的变量是至关重要的。变量选择可以通过统计测试、专家意见或者数据挖掘技术来完成。这一步骤需要综合考虑变量与研究目标之间的相关性以及变量之间的多重共线性问题。模型设定则涉及到选择合适的模型形式,如线性回归、主成分分析(PCA)、因子分析等。模型设定还应包括定义模型的参数,例如,在多元线性回归中,需要确定哪些变量作为预测变量(解释变量)。

#### 2.2.3 模型估计和诊断测试

模型设定之后,接下来是模型的估计。这包括参数估计和模型拟合度的评估。参数估计通常采用最大似然估计或最小二乘估计等方法。模型拟合度的评估则依赖于R平方值、调整R平方值等统计量。在模型估计完成后,需要进行一系列的诊断测试来检查模型的有效性。这包括残差分析来检验误差项的正态性和方差齐性,以及多重共线性诊断来评估变量间的相关性问题。

### 2.3 多变量模型的统计假设

#### 2.3.1 基本假设的检验

多变量模型的构建依赖于一系列统计假设,其中包括线性、正态性、误差项的独立同分布(i.i.d)、同方差性(homoscedasticity),以及不存在完全多重共线性等。这些假设保证了模型参数估计的一致性和统计推断的准确性。对这些假设进行检验是建模过程的必要步骤。比如,可以通过Shapiro-Wilk检验来评估数据的正态性,或者使用Durbin-Watson检验来检验误差项的自相关性。

#### 2.3.2 异常值和影响点的识别

在多变量模型分析中,异常值和影响点可能严重扭曲模型的参数估计和预测能力。异常值是指那些与数据的主体分布不一致的观测值,而影响点是指那些能够显著影响模型参数估计结果的观测值。为了识别这些值,常用的方法有Cook's距离、杠杆值(Leverage)、以及标准化残差等。一旦识别出异常值和影响点,分析师需要判断这些值是否是真实的数据点,或者是录入错误等其他问题导致的,并据此采取适当的处理措施,如保留、修正或删除这些值。

# 3. 多变量模型的实战应用

## 3.1 金融分析中的多变量模型

### 3.1.1 资产定价模型

在金融领域,多变量模型的核心应用之一就是资产定价。资产定价模型通常利用多个市场因素来预测证券或资产的预期回报率。其中最著名的模型之一是资本资产定价模型(CAPM),该模型假设资产的期望收益率与市场组合的系统性风险成正比。

```mermaid

graph LR

A[开始] --> B[数据收集]

B --> C[模型参数设定]

C --> D[估计模型参数]

D --> E[进行资产定价]

E --> F[模型诊断测试]

```

在使用CAPM模型时,投资者首先收集历史数据,包括个股回报率和市场组合的回报率。然后设定模型参数,比如无风险利率和市场组合的预期收益率。接下来,通过回归分析估计出个股的贝塔值(β系数),这个系数代表了该资产的系统性风险。最后,利用估计出的β值和无风险利率,计算出预期的资产回报率,并对模型进行诊断测试以确保其准确性。

### 3.1.2 风险管理和预测模型

多变量模型在风险管理中也扮演着重要角色,尤其是在定量风险评估和预测方面。金融市场中广泛使用的Value at Risk(VaR)和Expected Shortfall(ES)等风险管理模型,都需要借助多变量分析技术。

```mermaid

graph LR

A[开始] --> B[历史数据收集]

B --> C[数据分布假设]

C --> D[模拟或理论模型构建]

D --> E[风险度量计算]

E --> F[模型验证与调整]

```

在计算VaR时,首先收集历史市场数据并对其分布做出假设。然后,构建相应的理论模型或进行模拟,如历史模拟法或方差-协方差法等。计算出的VaR值能够告诉金融机构在正常市场条件下,某投资组合在未来一段时间内最大可能的损失。之后,模型需要经过验证和调整,以确保其在不同市场条件下的一致性和准确性。

## 3.2 生物统计中的多变量模型

### 3.2.1 临床试验中的应用

在生物统计学中,多变量模型应用于临床试验的目的是为了更

0

0