深度学习模型中的数据填充技术

发布时间: 2024-11-20 04:35:20 订阅数: 7

# 1. 数据填充技术在深度学习中的重要性

## 1.1 数据质量与深度学习模型性能的关系

在深度学习领域,数据的完整性和质量直接影响模型的训练效果。高质量的数据能够提升模型的泛化能力,而数据缺失则可能导致模型性能下降甚至完全失效。因此,数据填充技术在保证数据质量、改善模型性能方面扮演着关键角色。

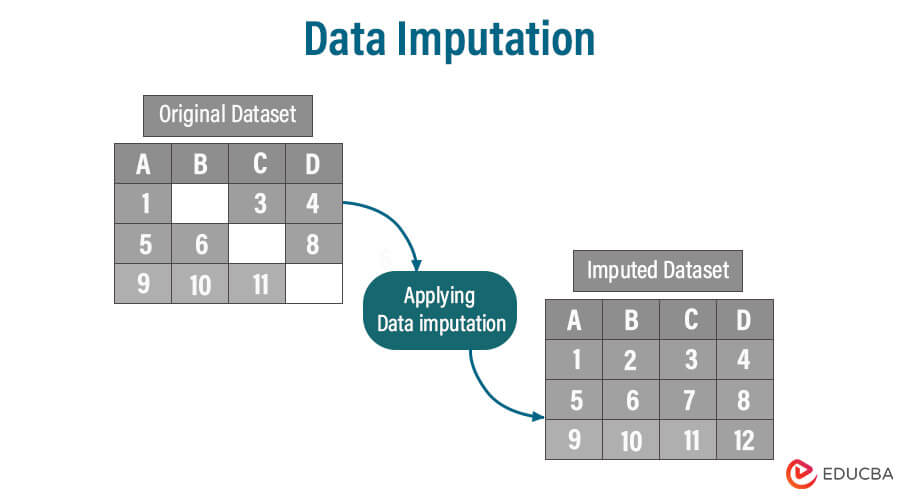

## 1.2 数据填充技术的定义和作用

数据填充技术是指在数据集中存在缺失值的情况下,通过一定的算法或统计方法,对缺失的数据进行有效补充的处理过程。其目的是为了构建一个完整的数据集,使得深度学习模型能够从中有效学习和提取有用信息。

## 1.3 数据填充对深度学习模型性能的提升

通过合理的数据填充,可以减少数据中的噪声和不确定性,有助于提高模型的训练效率和预测准确性。尤其在数据集规模庞大、特征维度多的情况下,数据填充技术能够显著提升深度学习模型的性能表现。

# 2. 数据填充技术的基本理论

### 2.1 数据缺失的类型和影响

#### 2.1.1 缺失数据的分类

数据缺失是数据集中常见的问题,可被分类为完全随机缺失(MCAR)、随机缺失(MAR)和非随机缺失(NMAR)。完全随机缺失指的是数据缺失完全不依赖于任何变量;随机缺失是数据缺失与观测变量相关,但与未观测变量不相关;非随机缺失意味着数据缺失与未观测变量有关。

为了深入理解这些分类,我们需要考虑数据缺失的机理和潜在的影响因素。MCAR条件下,分析结果可能偏误最小,而NMAR条件下则可能产生最大的偏误。这些分类对于选择适当的填充技术至关重要。

#### 2.1.2 缺失数据对模型的影响分析

缺失数据的存在可能导致统计分析和机器学习模型的性能显著下降。例如,在线性回归中,缺失值会导致参数估计不准确。在分类问题中,缺失数据可能会使分类边界变得模糊,降低模型的预测能力。

缺失数据的影响不仅限于模型的准确性,还涉及模型的泛化能力。数据填充技术的引入,旨在通过合理的假设和算法,减少缺失数据带来的负面影响。

### 2.2 常见的数据填充方法

#### 2.2.1 单值填充技术

单值填充技术,包括均值填充、中位数填充和众数填充等,是最简单的填充技术。这些方法操作简单,易于实现。均值填充适用于连续变量的缺失值,而众数填充适用于分类变量。尽管简单,这类技术可能会导致数据分布的失真和方差的减少。

以均值填充为例,在R或Python中,可以简单地使用内置函数计算列的均值并替换NaN值。这种方法的局限性在于它忽略了变量之间的关系。

```r

# R中的均值填充示例

data$column_with_NA[is.na(data$column_with_NA)] <- mean(data$column_with_NA, na.rm = TRUE)

```

#### 2.2.2 基于统计的填充技术

基于统计的方法涉及更为复杂的计算和模型,例如多重插补和EM算法。多重插补利用统计模型对缺失值进行估计,然后重复进行此过程多次,每次生成一组完整的数据集,最后将多个数据集的分析结果合并。EM算法通过迭代过程来估计缺失数据,以最大化整个数据集的似然函数。

多重插补需要使用统计软件包,如R的`mice`库,进行操作。EM算法的Python实现可以在`scikit-learn`的`impute`模块找到。

```python

from sklearn.impute import SimpleImputer

import numpy as np

# Python中的多重插补示例

imputer = SimpleImputer(missing_values=np.nan, strategy='mean')

data_filled = imputer.fit_transform(data)

```

#### 2.2.3 基于模型的填充技术

基于模型的方法,如k最近邻(k-NN)填充和矩阵分解技术(如奇异值分解SVD),在预测缺失值时会考虑变量间的关系。k-NN填充通过查找最相似的数据点来预测缺失值,而矩阵分解方法通过分解原始数据矩阵来重建完整矩阵。

基于模型的方法较为复杂,但在处理具有复杂关系的数据集时,通常能提供更好的填充效果。在实际应用中,我们可以使用如`scikit-survival`等库中的k-NN填充方法,以及`scikit-learn`中的SVD等矩阵分解技术。

```python

from sklearn.neighbors import KNeighborsClassifier

from sklearn.impute import KNNImputer

# Python中的k-NN填充示例

imputer = KNNImputer(n_neighbors=5)

data_filled = imputer.fit_transform(data)

```

### 表格:常见数据填充方法的比较

| 填充方法 | 适用场景 | 优点 | 缺点 |

| --- | --- | --- | --- |

| 均值/中位数/众数填充 | 简单应用 | 实现简单、快速 | 易导致分布失真,忽略变量间关系 |

| 多重插补 | 复杂结构数据 | 考虑数据分布,减少偏差 | 计算量大,需要多次迭代 |

| EM算法 | 高维数据 | 考虑变量间关系,适用性广 | 收敛速度可能慢,可能陷入局部最优 |

| k-NN填充 | 非数值型数据 | 考虑数据相似性,更灵活 | 计算成本高,对大数据集不友好 |

| 矩阵分解 | 有因子分析需求的数据 | 能够处理非线性关系,填充质量高 | 复杂度较高,调参困难 |

### 图表:数据填充技术选择流程图

```mermaid

graph TD

A[数据缺失类型分析] -->|MCAR| B[单值填充]

A -->|MAR| C[基于统计的填充]

A -->|NMAR| D[基于模型的填充]

B --> E[数据填充效果评估]

C --> E

D --> E

E -->|效果良好| F[模型训练与评估]

E -->|效果不佳| G[选择其他填充技术]

F --> H[模型部署]

G -->|返回| A

```

在数据填充技术的选择上,需要综合考虑数据缺失的类型、模型复杂度、计算资源和效果评估等多方面因素。此流程图展示了从数据缺失类型分析到模型部署的整个决策过程。

# 3. 数据填充技术的实践应用

## 3.1 实践前的数据预处理

### 3.1.1 数据清洗

数据清洗是数据填充实践的重要前置步骤,其目的是识别并纠正数据集中的错误和不一致性,为后续的数据填充提供一个干净的“画布”。数据清洗涉及多个方面,包括处理重复记录、纠正错误、标准化格式,以及处理缺失值。例如,通过识别出数据集中的重复记录,我们可以合并信息或删除冗余,提高数据的质量和一致性。处理缺失值时,我们可以考虑多种方法,包括删除含有缺失值的记录、估算缺失值,或使用数据填充技术。

### 3.1.2 数据探索性分析

数据探索性分析(EDA)是理解数据集的分布、特征和潜在模式的过程。在数据填充技术实践中,EDA能够帮助我们识别数据中的异常值和缺失模式。例如,通过散点图我们可以发现数据中的离群点;通过直方图和箱型图可以了解数据的分布情况。当数据集较大时,EDA可以揭示数据集中的结构和关系,为选择合适的数据填充方法提供依据。

## 3.2 实践中的数据填充实施

### 3.2.1 Python在数据填充中的应用

Python凭借其强大的数据科学库,成为数据填充实践中的首选工具之一。使用Pandas库,我们可以轻松执行数据清洗和探索性分析。Pandas提供了`dropna()`和`fillna()`方法来处理缺失数据,支持多种填充策略。例如:

```python

import pandas as pd

# 创建一个示例DataFrame

data = pd.DataFrame({

'A': [1, 2, None, 4],

'B': [5, None, None, 8],

'C': [9, 10, 11, 12]

})

```

0

0