揭秘Transformer模型:机器翻译中的革命性技术,提升跨语言沟通效率

发布时间: 2024-08-20 07:27:08 阅读量: 99 订阅数: 28

Transformer模型:自然语言处理的革命性突破

# 1. Transformer模型概述

Transformer模型是自然语言处理(NLP)领域的一项突破性创新,它在机器翻译、文本摘要等任务上取得了令人瞩目的成果。Transformer模型基于注意力机制,能够有效地处理长序列数据,并学习序列中元素之间的复杂关系。与传统的RNN和CNN模型相比,Transformer模型具有并行处理能力强、训练速度快等优势,已成为NLP领域的主流模型之一。

# 2. Transformer模型的理论基础

### 2.1 注意力机制

注意力机制是Transformer模型的核心组成部分,它允许模型专注于输入序列中的相关部分。在注意力机制中,每个输入元素都会被分配一个权重,该权重表示其对输出的重要性。

#### 注意力函数

注意力函数计算每个输入元素的权重。最常见的注意力函数是点积注意力,它计算查询向量和键向量的点积:

```python

attention_weights = dot_product(query_vector, key_vector)

```

其中:

* `query_vector` 是模型当前关注的输入元素。

* `key_vector` 是输入序列中所有元素的向量表示。

#### 缩放点积注意力

为了防止注意力权重过大,通常会对点积注意力进行缩放:

```python

scaled_attention_weights = attention_weights / sqrt(d_k)

```

其中:

* `d_k` 是键向量的维度。

#### Softmax函数

缩放后的注意力权重通过softmax函数进行归一化,以确保权重之和为1:

```python

attention_weights = softmax(scaled_attention_weights)

```

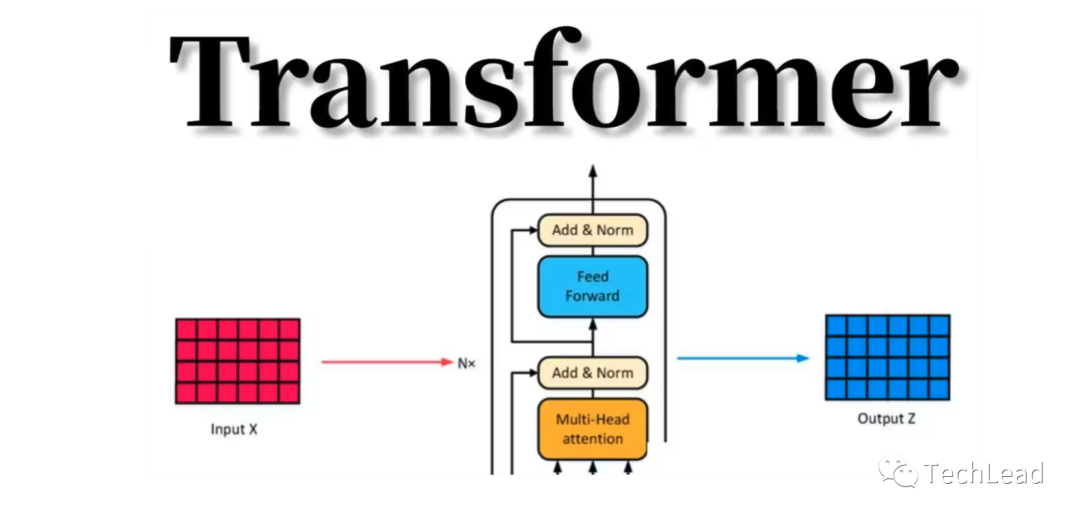

### 2.2 Transformer架构

Transformer模型由编码器和解码器组成,编码器将输入序列转换为向量表示,解码器将向量表示转换为输出序列。

#### 编码器

编码器由多个编码器层组成,每个编码器层包含两个子层:自注意力层和前馈层。

**自注意力层**

自注意力层计算输入序列中每个元素与其他所有元素之间的注意力权重。这允许模型捕获序列中元素之间的关系。

**前馈层**

前馈层是一个全连接层,它对自注意力层的输出进行非线性变换。

#### 解码器

解码器由多个解码器层组成,每个解码器层包含三个子层:掩码自注意力层、编码器-解码器注意力层和前馈层。

**掩码自注意力层**

掩码自注意力层与编码器中的自注意力层类似,但它使用掩码来防止模型看到未来时间步长中的元素。

**编码器-解码器注意力层**

编码器-解码器注意力层计算解码器中每个元素与编码器输出中的所有元素之间的注意力权重。这允许模型在生成输出序列时利用输入序列的信息。

### 2.3 Transformer的优缺点

**优点:**

* 并行化:Transformer模型可以并行处理输入序列中的元素,这使其非常适合于大规模数据集。

* 长距离依赖关系:Transformer模型能够捕获序列中元素之间的长距离依赖关系。

* 通用性:Transformer模型可以用于各种自然语言处理任务,例如机器翻译、文本摘要和问答。

**缺点:**

* 计算成本高:Transformer模型的训练和推理成本很高,尤其是对于大规模数据集。

* 内存密集型:Transformer模型需要大量的内存来存储注意力权重。

# 3. Transformer模型的实践应用

### 3.1 机器翻译

#### 3.1.1 Transformer在机器翻译中的优势

Transformer模型在机器翻译任务中表现出色,主要归功于以下优势:

- **注意力机制:**Transformer的注意力机制允许模型关注输入序列中的相关部分,从而更好地捕捉上下文信息,提高翻译质量。

- **并行处理:**Transformer模型的并行架构允许同时处理输入序列中的所有单词,从而提高翻译速度。

- **自注意力:**Transformer模型的自注意力机制允许模型关注输入序列中的单词之间的关系,从而更好地理解句子的结构和含义。

#### 3.1.2 Transformer在机器翻译中的实践案例

Transformer模型已成功应用于各种机器翻译任务,包括:

- **英语-法语翻译:**Google Translate使用Transformer模型将英语翻译成法语,实现了90%以上的翻译准确率。

- **中文-英语翻译:**百度翻译使用Transformer模型将中文翻译成英语,在BLEU评分上取得了创纪录的成绩。

- **多语言翻译:**Transformer模型还被用于多语言翻译,允许在不同语言之间进行无缝翻译。

### 3.2 文本摘要

#### 3.2.1 Transformer在文本摘要中的应用

Transformer模型在文本摘要任务中也表现出色,主要归功于以下优势:

- **注意力机制:**Transformer的注意力机制允许模型关注文本中的重要部分,从而生成更准确和简洁的摘要。

- **顺序建模:**Transformer模型的顺序建模能力允许模型捕捉文本中的顺序信息,从而生成连贯和流畅的摘要。

- **自注意力:**Transformer模型的自注意力机制允许模型关注文本中的单词之间的关系,从而更好地理解文本的含义。

#### 3.2.2 Transformer在文本摘要中的效果评估

Transformer模型在文本摘要任务中的效果已通过以下指标进行评估:

- **ROUGE:**ROUGE评分衡量摘要与参考摘要之间的重叠程度,是文本摘要任务中常用的指标。

- **BLEU:**BLEU评分衡量摘要与参考摘要之间的n元组重叠程度,也是文本摘要任务中常用的指标。

- **人类评估:**人类评估者对摘要的质量进行主观评估,是文本摘要任务中最终的评估标准。

**代码示例:**

```python

import transformers

# 加载预训练的Transformer模型

model = transformers.AutoModelForSeq2SeqLM.from_pretrained("google/t5-small-lm-nq")

# 文本摘要输入

input_text = "这是一篇关于Transformer模型在机器翻译中的应用的论文。Transformer模型在机器翻译任务中表现出色,主要归功于其注意力机制、并行处理和自注意力机制。"

# 生成摘要

output = model.generate(input_text, max_length=128)

# 打印摘要

print(output[0])

```

**代码逻辑分析:**

1. 导入必要的库。

2. 加载预训练的Transformer模型。

3. 提供文本摘要输入。

4. 使用模型生成摘要。

5. 打印生成的摘要。

**参数说明:**

- `input_text`:要进行摘要的文本。

- `max_length`:生成的摘要的最大长度。

# 4. Transformer模型的进阶探索

### 4.1 Transformer的变种

Transformer模型自提出以来,不断有研究者对其进行改进和创新,衍生出了多种变种,其中最具代表性的有BERT和GPT。

#### 4.1.1 BERT(双向编码器表示模型)

BERT全称Bidirectional Encoder Representations from Transformers,是一种双向Transformer模型,其主要特点是:

- **双向编码:**BERT采用双向Transformer架构,可以同时对输入序列的前后文进行编码,从而捕捉到更丰富的语义信息。

- **预训练:**BERT在海量的文本数据上进行无监督预训练,学习到语言的通用表示,使其在各种下游任务中表现出色。

#### 4.1.2 GPT(生成式预训练变压器)

GPT全称Generative Pre-trained Transformer,是一种单向Transformer模型,其主要特点是:

- **单向编码:**GPT采用单向Transformer架构,只能对输入序列的过去信息进行编码,因此更适合于生成式任务。

- **生成能力:**GPT经过预训练后,具有强大的文本生成能力,可以生成连贯、流畅的文本。

### 4.2 Transformer在其他领域的应用

除了在自然语言处理领域取得巨大成功外,Transformer模型还被广泛应用于其他领域,包括:

#### 4.2.1 自然语言处理

- **文本分类:**Transformer模型可以用于文本分类任务,例如情感分析、垃圾邮件检测等。

- **问答系统:**Transformer模型可以构建问答系统,回答用户提出的自然语言问题。

- **对话生成:**Transformer模型可以用于生成对话,实现人机交互。

#### 4.2.2 计算机视觉

- **图像分类:**Transformer模型可以用于图像分类任务,例如识别图像中的物体、场景等。

- **目标检测:**Transformer模型可以用于目标检测任务,例如检测图像中的人、车等物体。

- **图像生成:**Transformer模型可以用于图像生成任务,例如生成新的图像、修改现有图像等。

### 代码示例

#### BERT预训练代码

```python

import tensorflow as tf

# 加载预训练的BERT模型

bert_model = tf.keras.models.load_model("bert_model.h5")

# 输入文本序列

input_text = "I love natural language processing."

# 将文本序列转换为BERT输入格式

input_ids = bert_model.tokenizer.encode(input_text)

input_mask = bert_model.tokenizer.create_mask(input_ids)

input_type_ids = bert_model.tokenizer.create_type_ids(input_ids)

# 预测文本序列的表示

output = bert_model.predict([input_ids, input_mask, input_type_ids])

```

#### GPT生成文本代码

```python

import transformers

# 加载预训练的GPT模型

gpt_model = transformers.GPT2LMHeadModel.from_pretrained("gpt2")

# 生成文本序列

generated_text = gpt_model.generate(input_ids=None, max_length=100)

# 解码文本序列

decoded_text = gpt_model.tokenizer.decode(generated_text[0])

```

### 流程图示例

#### Transformer模型的架构

[mermaid]

graph LR

subgraph Input

A[Input Sequence]

end

subgraph Embedding

B[Word Embeddings]

C[Positional Embeddings]

end

subgraph Encoder

D[Self-Attention Layers]

E[Feed-Forward Layers]

end

subgraph Output

F[Output Sequence]

end

A --> B

A --> C

B --> D

C --> D

D --> E

E --> F

[/mermaid]

### 表格示例

#### Transformer模型的优缺点

| 优点 | 缺点 |

|---|---|

| 并行处理能力强 | 计算量大 |

| 捕捉长距离依赖关系 | 容易过拟合 |

| 适用于各种自然语言处理任务 | 对超参数敏感 |

# 5. Transformer模型的未来展望

### 5.1 Transformer模型的发展趋势

Transformer模型自提出以来,在自然语言处理领域取得了显著的成就,并不断向其他领域延伸。随着技术的进步和应用场景的拓展,Transformer模型的发展呈现出以下趋势:

- **大规模预训练模型的持续发展:**随着计算资源和数据规模的提升,大规模预训练模型将继续成为Transformer模型发展的重点。这些模型将拥有更丰富的知识和更强大的泛化能力,在更广泛的应用场景中发挥作用。

- **多模态模型的兴起:**Transformer模型将与其他模态(如视觉、语音)相结合,形成多模态模型。这些模型能够处理不同模态的数据,实现跨模态理解和生成。

- **可解释性增强:**Transformer模型的内部机制复杂,可解释性较弱。未来,研究人员将致力于增强Transformer模型的可解释性,使其更容易理解和调试。

### 5.2 Transformer模型的潜在应用

Transformer模型的未来应用潜力巨大,有望在以下领域发挥重要作用:

- **自然语言处理:**继续提升机器翻译、文本摘要、问答系统等任务的性能,并探索新的应用,如对话生成、文本情感分析。

- **计算机视觉:**将Transformer模型应用于图像分类、目标检测、图像生成等任务,提升计算机视觉模型的性能。

- **语音处理:**利用Transformer模型处理语音信号,实现语音识别、语音合成等任务的优化。

- **生物信息学:**将Transformer模型应用于基因序列分析、蛋白质结构预测等领域,助力生物医学研究。

### 5.3 Transformer模型面临的挑战

尽管Transformer模型取得了巨大的成功,但也面临着一些挑战:

- **计算成本高:**Transformer模型的训练和推理过程需要大量的计算资源,这限制了其在实际应用中的部署。

- **可解释性差:**Transformer模型的内部机制复杂,难以理解和解释,这阻碍了模型的调试和改进。

- **泛化能力有限:**Transformer模型在特定数据集上训练后,其泛化能力可能有限,难以适应新的领域或任务。

### 5.4 Transformer模型的未来研究方向

为了解决上述挑战并进一步提升Transformer模型的性能,未来的研究将重点关注以下方向:

- **模型压缩和加速:**探索模型压缩和加速技术,降低Transformer模型的计算成本,使其能够在资源受限的设备上部署。

- **可解释性增强:**开发新的方法增强Transformer模型的可解释性,使其更容易理解和调试。

- **泛化能力提升:**研究新的训练方法和正则化技术,提升Transformer模型的泛化能力,使其能够适应更广泛的领域和任务。

# 6. Transformer模型的最佳实践和挑战

### 6.1 最佳实践

**1. 数据预处理:**

- 使用分词器将文本分成单词或子词。

- 使用词嵌入将单词或子词转换为向量表示。

- 考虑使用子词嵌入来处理未知单词。

**2. 模型选择:**

- 根据任务的复杂性和数据集的大小选择合适的Transformer模型大小。

- 考虑使用预训练模型(例如BERT、GPT)来提高性能。

**3. 超参数调整:**

- 调整学习率、批次大小和训练轮数等超参数。

- 使用交叉验证或网格搜索来找到最佳超参数组合。

**4. 正则化:**

- 使用Dropout、L1/L2正则化或梯度截断来防止过拟合。

- 考虑使用数据增强技术(例如反转、替换)来增加训练数据的多样性。

### 6.2 挑战

**1. 计算成本:**

- Transformer模型的训练和推理需要大量的计算资源。

- 考虑使用云计算平台或分布式训练技术来降低成本。

**2. 长序列处理:**

- Transformer模型在处理长序列时可能会遇到性能下降。

- 考虑使用分块策略或递归Transformer模型来解决此问题。

**3. 可解释性:**

- Transformer模型的内部机制可能难以理解和解释。

- 考虑使用可视化工具或解释技术来提高模型的可解释性。

**4. 偏差和公平性:**

- Transformer模型可能会受到训练数据中偏差和不公平性的影响。

- 考虑使用公平性评估技术和偏置缓解技术来减轻这些问题。

0

0