Transformer模型与位置前馈网络的对比:机器翻译中的信息处理方式

发布时间: 2024-08-20 08:16:13 阅读量: 4 订阅数: 15

# 1. 机器翻译中的神经网络模型**

机器翻译(MT)是自然语言处理(NLP)中一项关键任务,旨在将一种语言的文本自动翻译成另一种语言。神经网络模型,特别是Transformer模型和位置前馈网络,在机器翻译领域取得了显著的进展。

这些神经网络模型通过学习语言的统计模式,能够捕捉文本中单词和句子之间的复杂关系。它们使用编码器-解码器架构,其中编码器将源语言文本编码成一个向量表示,而解码器使用该表示来生成目标语言文本。

# 2. Transformer模型**

## 2.1 Transformer的架构和原理

Transformer模型是一种基于注意力机制的神经网络模型,它在2017年由Vaswani等人提出。与传统的神经网络模型不同,Transformer模型不使用卷积或循环神经网络,而是完全依赖注意力机制来处理输入序列。

Transformer模型的架构主要由以下几个部分组成:

- **编码器:**编码器负责将输入序列转换为一个固定长度的向量表示。它由多个编码器层组成,每个编码器层包含两个子层:自注意力层和前馈层。

- **解码器:**解码器负责将编码器的输出向量表示转换为输出序列。它也由多个解码器层组成,每个解码器层包含三个子层:自注意力层、编码器-解码器注意力层和前馈层。

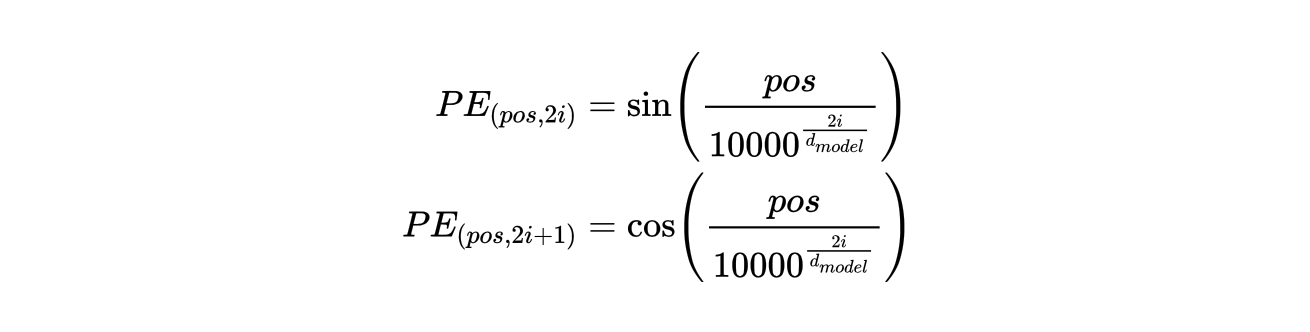

- **位置编码:**位置编码是一种特殊的向量,用于向Transformer模型提供输入序列中元素的相对位置信息。这是因为Transformer模型不使用循环或卷积操作,因此无法直接从输入序列中获取位置信息。

## 2.2 Transformer的注意力机制

注意力机制是Transformer模型的核心。它允许模型专注于输入序列中与当前元素最相关的部分。Transformer模型中有两种类型的注意力机制:

- **自注意力:**自注意力机制允许模型关注输入序列中的不同元素之间的关系。它计算每个元素与其自身以及其他所有元素之间的相似性,并使用这些相似性来生成一个加权和,该加权和表示该元素的上下文表示。

- **编码器-解码器注意力:**编码器-解码器注意力机制允许解码器关注编码器输出序列中的不同元素。它计算解码器中的每个元素与其在编码器输出序列中的所有元素之间的相似性,并使用这些相似性来生成一个加权和,该加权和表示解码器元素的上下文表示。

## 2.3 Transformer的优点和缺点

Transformer模型具有以下优点:

- **并行化:**Transformer模型的注意力机制可以并行计算,这使其非常适合在大型数据集上进行训练。

- **长距离依赖性:**Transformer模型能够捕获输入序列中长距离的依赖关系,这对于自然语言处理任务非常重要。

- **鲁棒性:**Transformer模型对输入序列的顺序不敏感,这使其非常适合处理无序或部分有序的数据。

Transformer模型也有一些缺点:

- **计算成本高:**Transformer模型的

0

0