HDFS版本控制精讲:文件版本管理的艺术

发布时间: 2024-10-28 20:23:47 阅读量: 5 订阅数: 8

# 1. HDFS版本控制基础

## 1.1 HDFS版本控制概述

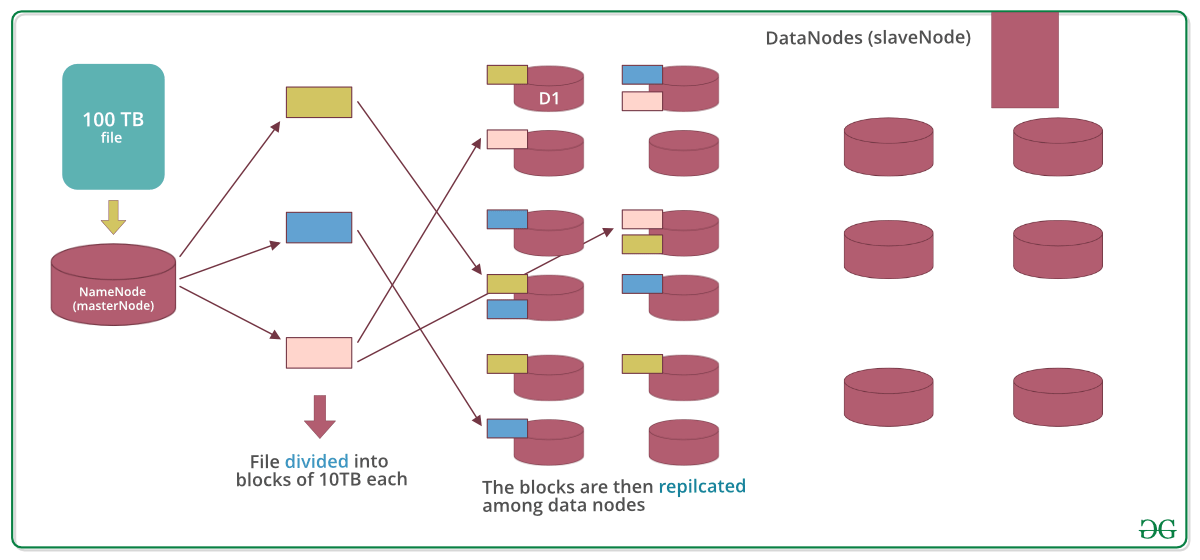

Hadoop Distributed File System (HDFS) 是一个高度容错的系统,适用于大型数据集的存储。它被设计为运行在廉价的硬件上,并提供高吞吐量的数据访问,非常适合大数据应用场景。HDFS 版本控制是其众多功能中的一项,它允许用户跟踪和管理文件的不同版本,从而实现了数据的版本化存储。

## 1.2 版本控制的基本原理

在 HDFS 中实现版本控制,意味着系统能够在不覆盖旧数据的情况下保存文件的新版本。每当用户写入新数据时,系统会自动保留旧版本,并为新版本创建一个时间戳,这使得用户可以随时回溯到之前的文件状态。这种机制在数据仓库、数据湖和大数据分析领域尤为重要,能够帮助运维团队和数据分析师应对数据误操作或数据损坏的情况。

## 1.3 版本控制的优势

采用 HDFS 版本控制可以极大地增强数据管理的灵活性和可靠性。除了上述的优点,它还为数据的审计和合规性提供了强有力的工具。此外,版本控制使得并行数据处理变得更加安全和高效,因为不同的分析任务可以基于数据的同一历史版本来运行,从而确保了结果的一致性。

通过本章的介绍,我们将建立起 HDFS 版本控制的基础概念和优势的认识,为接下来深入探讨 HDFS 版本控制机制及其应用做好铺垫。

# 2. 深入理解HDFS版本控制机制

### HDFS的文件版本概念

#### 版本控制的重要性

版本控制是数据管理系统的核心功能之一,特别是在分布式存储系统中。在HDFS中,文件的版本控制能够保障数据的安全性和可靠性,使得数据在被覆盖或者删除时,仍可通过之前的版本进行恢复。这种机制在大数据处理中尤为重要,因为数据的处理往往涉及到不可逆的操作,一旦出现错误或者需要追溯历史数据时,没有版本控制的系统将束手无策。HDFS通过版本控制,不仅能够避免因误操作导致的数据丢失问题,同时也为数据的长期保存和分析提供了便利。

#### HDFS文件版本的数据结构

HDFS通过引入时间戳和文件快照的概念来实现版本控制。文件在HDFS中以一系列的版本存储,每个版本代表文件的一个特定时间点的状态。当文件更新时,HDFS不会直接覆盖原有文件,而是创建一个新的版本。每个文件版本都保留了其创建时间点的元数据信息,包括时间戳、块列表和文件大小等。HDFS的NameNode维护了版本信息,并且能够快速定位到文件的任何一个历史版本。

### HDFS版本控制的工作原理

#### 写操作的版本控制

当对HDFS中的文件执行写操作时,实际上是在创建文件的一个新版本。这个过程涉及到几个关键步骤:

1. 客户端发起写请求。

2. NameNode接收到写请求后,为文件生成一个新版本的时间戳。

3. NameNode检查是否有足够的空间来存储新的文件版本,并分配相应的数据节点。

4. 数据节点负责实际的写入过程,并返回操作结果给NameNode。

5. NameNode更新文件系统的元数据,记录新版本的文件信息。

#### 读操作与版本选择

读操作时,HDFS默认返回文件的最新版本。如果需要读取特定的历史版本,可以通过指定版本的时间戳来实现。在这种情况下,HDFS会搜索符合时间戳的文件版本,并将读请求重定向到相应的数据节点。这个过程保证了读操作的灵活性和数据版本的可追溯性。

```shell

# 示例代码:使用HDFS命令读取特定版本的文件

hdfs dfs -get -version <path_to_file> <version_timestamp> <local_output_path>

```

在上述命令中,`<path_to_file>`是HDFS上的文件路径,`<version_timestamp>`是希望读取的版本时间戳,而`<local_output_path>`是本地存储路径。

#### 删除操作和回收站机制

在HDFS中执行删除操作时,并不是直接从文件系统中移除文件,而是将文件标记为删除,并移动到回收站目录。回收站机制允许用户在一定时间范围内恢复误删除的文件。当文件在回收站中时,HDFS会保持文件的版本信息不变,直到达到保留期限或用户主动清空回收站。

### HDFS版本控制的配置与管理

#### 配置参数详解

HDFS版本控制的配置参数可以在`hdfs-site.xml`配置文件中进行设置。其中一些关键的参数包括:

- `dfs.ha.automatic-failover.enabled`:是否开启自动故障转移功能。

- `dfs.replication`:HDFS数据块的副本数量。

- `dfs.name.dir`:NameNode元数据存储路径。

通过合理的配置,可以优化HDFS的版本控制机制,提高系统的整体性能和稳定性。

#### 管理工具和命令

HDFS提供了一系列的命令行工具和Web界面来进行版本控制的管理。命令行工具如`hdfs dfs -versions`可以列出文件的所有版本,`hdfs dfs -createVersion`可以手动创建新版本等。而Web界面则提供了一个直观的方式来查看和管理文件版本,操作员可以轻松地进行恢复、删除等操作。

通过这些工具和命令,管理员能够有效地管理HDFS中的文件版本,确保数据的准确性和完整性。

以上内容为《深入理解HDFS版本控制机制》章节的详细介绍,接下来的内容将围绕HDFS版本控制在大数据中的应用进行深入探讨。

# 3. HDFS版本控制在大数据中的应用

在第三章中,我们将深入探讨HDFS版本控制在大数据环境中的实际应用,以及这些应用如何帮助开发者和数据工程师更好地管理数据的版本,进行数据恢复与备份,以及处理实时数据流。

## 3.1 数据湖与版本控制

### 3.1.1

0

0