R语言重塑数据专家课:reshape2包的全面剖析与应用

发布时间: 2024-11-02 21:56:41 阅读量: 67 订阅数: 35

R语言数据重塑,20种高效函数操作数据格式与管理

# 1. R语言与reshape2包简介

在数据分析的世界中,R语言以其强大的统计功能和图形表现力脱颖而出。它不仅支持基本的数据分析,还能通过各种包进行深度定制和优化。今天我们将介绍的是一个专注于数据重塑的R包——reshape2,这个包因其在数据处理中的高效与简洁,成为数据分析工作流程中不可或缺的一部分。

## 1.1 R语言的简介

R语言是一种专为统计分析而生的编程语言。它的名字取自其主要设计者Robert Gentleman和Ross Ihaka的第一个字母。R语言在学术和工业界中被广泛使用,特别是在金融、生物信息学、数据挖掘和统计领域。R语言之所以能够得到如此广泛的应用,除了其开源特性外,还因为有一个庞大且活跃的社区不断贡献新的包和工具。

## 1.2 reshape2包的功能概述

reshape2包是由Hadley Wickham开发的,它专门用于数据重塑,即从一种格式转换到另一种格式。在数据分析过程中,常常需要将数据从宽格式(宽表)转换为长格式(长表),或者反过来。reshape2通过提供简洁而强大的函数,简化了这一过程,让分析师可以更加专注于数据本身而非数据转换的过程。

```r

# 安装reshape2包的R代码

install.packages("reshape2")

library(reshape2)

```

这段代码展示了如何在R环境中安装并加载reshape2包。通过简单的两行代码,我们即可利用其提供的melt和dcast等函数,开始数据重塑的旅程。随着本文的深入,我们将学习如何通过reshape2包将复杂的数据集快速转换成易于分析的形式,为数据探索和建模提供便利。

# 2. 理解数据重塑的概念与理论基础

## 2.1 数据重塑的基本概念

### 2.1.1 长格式和宽格式数据的定义

在数据分析领域,数据重塑是指将数据从一种格式转换成另一种格式的过程。其中,长格式(Long Format)和宽格式(Wide Format)是两种基本的数据组织方式。

长格式数据,也称为堆叠数据,其特征是每个观测值都被记录在单独的行中,从而使得数据表的行数增加。长格式数据的优点是结构统一,可以更容易地进行动态数据操作和分析。

宽格式数据,又称为非堆叠数据,其特征是每个观测值分布在不同的列中,每一列对应一个测量变量。宽格式数据通常用于数据的静态展示,它使得观察数据的交叉比较变得方便。

理解长格式和宽格式之间的转换对于任何涉及数据处理和分析的项目都是基础且至关重要的。在处理复杂的数据集时,正确地将数据从一种格式转换到另一种格式,常常是数据分析的第一步。

### 2.1.2 数据重塑在数据分析中的重要性

数据重塑在数据分析和统计建模中扮演着关键角色。由于不同的统计分析方法对数据格式有着不同的要求,例如,回归分析可能需要数据为长格式,而交叉表分析可能更倾向于宽格式。

此外,数据重塑可以提高数据分析的灵活性。通过重塑数据,可以使得数据分析流程中的数据处理和可视化步骤更加高效。例如,将数据从宽格式转换为长格式,可以方便地实现动态的多变量分析,而将数据从长格式转换为宽格式,更适合进行数据的汇总和展示。

数据重塑还使得数据的一致性管理变得更加容易。当数据集中的变量命名和结构保持一致时,可以避免重复的数据清洗工作,提高数据处理效率。

## 2.2 重塑数据的理论框架

### 2.2.1 数据重塑的常用方法

在数据重塑的过程中,我们通常使用如下几种方法:

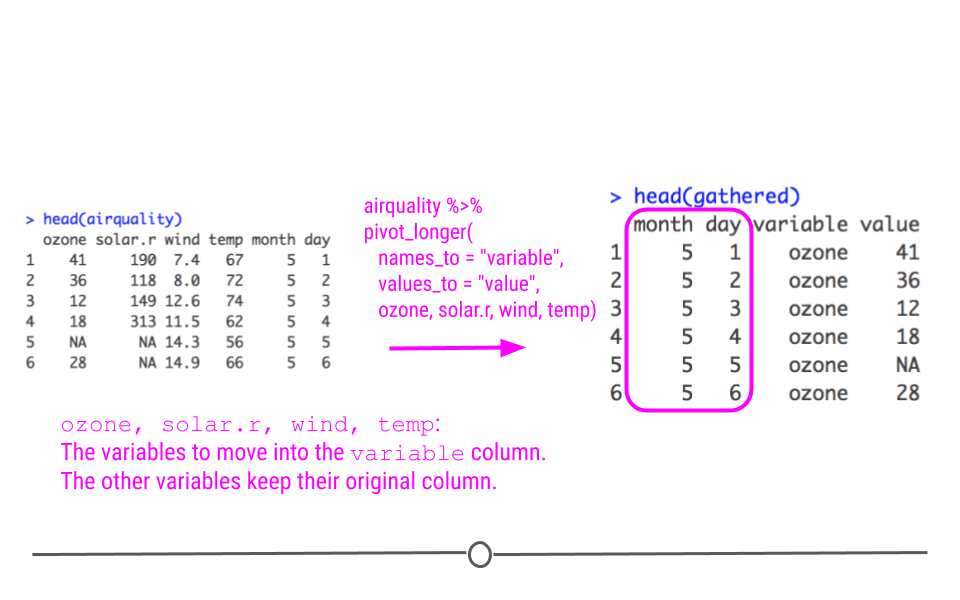

- 转置(Transpose):将数据的行转换为列,或者列转换为行。

- 分组(Gather):将多个列合并为两列,一列表示变量名,另一列表示变量值。

- 展开(Spread):将一列的值分布到多个列中,通常与分组相反。

- 转换(Transform):对数据的结构进行变换,如将数据按一定规则进行聚合、分组或其他形式的转换。

这些方法的组合使用可以应对各种复杂的数据重塑需求。

### 2.2.2 重塑操作的逻辑流程

重塑数据的操作流程大致遵循以下逻辑步骤:

1. **确定目标格式**:首先要明确我们希望通过重塑操作达到的数据格式,是长格式还是宽格式。

2. **理解数据结构**:分析现有数据的结构,确认哪些列是标识变量(不会被重塑),哪些列是测量变量(需要被重塑)。

3. **选择合适的函数**:根据目标和数据结构,选择恰当的重塑函数。例如,在R中,可以使用`reshape2`包中的`melt`函数或`dcast`函数。

4. **执行重塑操作**:应用选定的函数对数据进行实际的重塑操作。

5. **检查和验证结果**:重塑完成后,需要检查数据是否符合预期,包括数据的完整性、准确性等。

以上逻辑流程对于任何数据重塑操作都是通用的,理解和遵循这个流程能够帮助我们高效且正确地完成数据重塑任务。

## 2.3 R语言中的数据结构

### 2.3.1 向量、矩阵和数组

在R语言中,向量是基础的数据结构,它可以包含数值、字符或者其他类型的数据,并且在同一向量中的所有元素必须是同一类型。

矩阵(Matrix)是二维数组,其所有元素必须是相同的数据类型。矩阵主要用于数学运算,其行和列都有明确的索引。

数组(Array)可以看作是多维的矩阵,它可以包含多于两个维度的数据,比如三维数组可以包含高度、宽度和深度的数据。

### 2.3.2 数据框和列表的使用

数据框(Data Frame)是R中用于存储表格数据的主要数据结构,它可以存储不同类型的列。数据框非常灵活,支持各种统计分析和图形操作。

列表(List)是R中一种非常灵活的数据结构,它可以存储不同类型的数据对象,包括向量、矩阵、数组、数据框等。列表的每个元素可以是一个数据对象,也可以是另一个列表,这使得它非常适合存储复杂的数据结构。

R语言的数据结构提供了一个强大的框架,为数据分析和数据重塑提供了丰富的工具。掌握这些数据结构,对于有效地使用R进行数据分析和数据重塑至关重要。

在接下来的章节中,我们将深入探讨`reshape2`包的核心功能与应用,通过具体的案例来展示如何运用这些理论知识进行数据重塑操作。

#

0

0