数据重塑的紧迫行动:掌握reshape2包以优化数据结构

发布时间: 2024-11-02 22:03:17 阅读量: 30 订阅数: 35

# 1. 数据重塑的重要性

数据重塑是数据分析和数据处理过程中不可或缺的一环。在IT和相关行业中,数据重塑对于有效管理和分析不同格式的数据集至关重要。随着数据分析技术的发展和数据量的增长,掌握数据重塑的技巧已成为数据分析师和数据科学家的一项核心能力。

不仅仅是数据结构的转换,数据重塑还包括清洗、整合以及重格式化数据,以适应特定的分析需求或满足特定的数据模型要求。恰当的数据重塑能够简化数据分析流程,提高数据处理效率,并帮助从原始数据中提取更深层次的业务见解。因此,理解数据重塑的重要性,并将其有效地应用于实际工作中,对于提高工作效率和质量都具有不可忽视的作用。

# 2. reshape2包的基本概念与安装

### 2.1 数据重塑的理论基础

数据重塑是数据科学中的一个基本而重要的操作,它涉及将数据从一种格式转换为另一种格式,通常是为了更好地进行分析或展示。理解数据重塑的理论基础是掌握reshape2包的关键。

#### 2.1.1 数据结构的类型

在R语言中,数据结构主要包括向量、矩阵、数组、数据框和列表。其中,数据框(data.frame)是最常用于数据分析和统计建模的数据结构,因为它能够存储不同类型的数据列,这类似于数据库中的表。

数据框的列通常包含不同数据类型的元素,例如数值、字符、因子等,而在重塑数据时,我们经常会改变数据框中数据的组织方式。

#### 2.1.2 重塑数据的常见场景

数据重塑的常见场景包括但不限于:

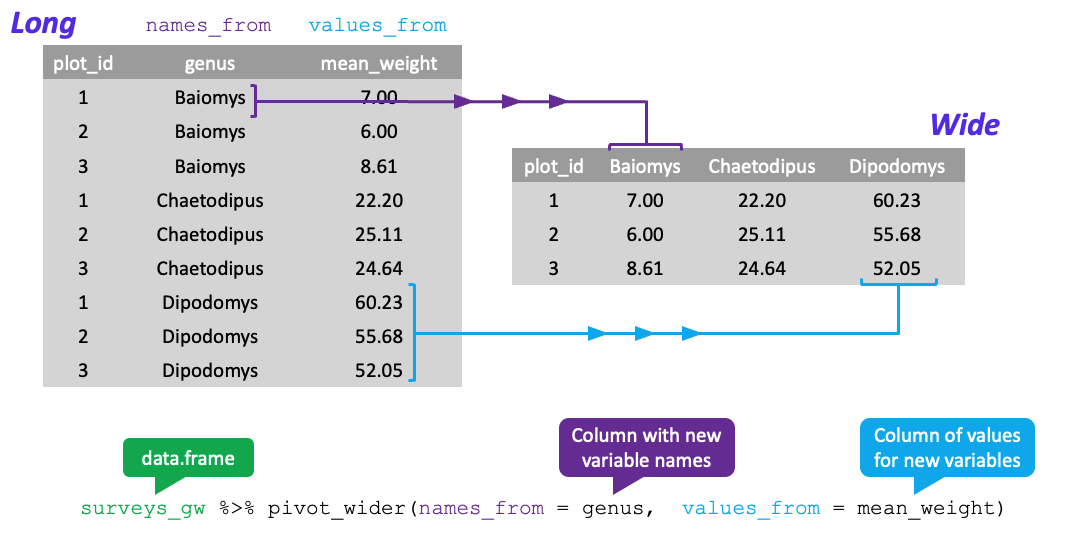

- 长格式(Long Format)和宽格式(Wide Format)之间的转换。长格式数据是指每个变量都有自己的列,每一行记录一个观测值;宽格式数据则是每个观测值有多行,一行中包含多个变量的值。

- 数据的融合(如SQL中的JOIN操作),将多个数据源合并为一个数据框。

- 变量的创建和修改,以及记录的拆分和合并等。

理解这些场景有助于在使用reshape2包时,更清晰地知道如何实现数据的转换以满足分析需求。

### 2.2 reshape2包的安装与配置

#### 2.2.1 在R环境中安装reshape2

要在R环境中安装reshape2包,只需运行以下代码:

```r

install.packages("reshape2")

```

这行代码会下载reshape2包的最新版本,并安装到你的R环境中。安装完成后,需要加载它以便在你的会话中使用。

```r

library(reshape2)

```

#### 2.2.2 配置reshape2包的环境

安装并加载reshape2包后,你需要确保它与你的工作环境配置一致。这包括了解可用的函数,如melt和dcast,以及如何与R中的其他包(如dplyr、ggplot2等)协同工作。

```r

# 与其他包协同工作

library(dplyr)

library(ggplot2)

```

至此,你已经完成reshape2包的基本安装与配置。接下来,我们将深入了解如何使用melt函数进行数据重塑。

# 3. 使用melt函数重塑数据

## 3.1 melt函数的基本语法

### 3.1.1 melt函数的参数介绍

melt函数是reshape2包中用于将宽格式数据框转换为长格式数据框的核心函数。理解melt函数的参数是掌握其使用方法的基础。melt函数的主要参数包括:

- `data`:需要转换的数据框。

- `id.vars`:标识变量列,这些列在转换过程中将保持不变。

- `measure.vars`:测量变量列,这些列将被melt转换成两个新变量:一个用于变量名(variable),一个用于值(value)。

- `variable.name`:转换后变量名的列名,默认为"variable"。

- `value.name`:转换后值的列名,默认为"value"。

- `...`:其他参数用于进一步指定melt函数的行为。

### 3.1.2 简单的melt转换实例

为了更好地理解melt函数的基本用法,我们来看一个简单的例子。假设我们有如下宽格式的数据框df:

```R

df <- data.frame(

ID = c(1, 2, 3),

Time1 = c(22, 27, 23),

Time2 = c(25, 28, 29),

Time3 = c(26, 29, 27)

)

```

这个数据框记录了三个个体在三个不同时间点的测量值。使用melt函数,我们可以将时间点和测量值转换为两个新列:

```R

library(reshape2)

melted_df <- melt(df, id.vars = "ID")

```

这里,我们指定`ID`列作为`id.vars`,因为它是标识变量。执行上述代码后,`melted_df`将包含三个列:`ID`、`variable`和`value`,其中`variable`列包含了原始列名(Time1, Time2, Time3),`value`列包含了相应的测量值。

## 3.2 mield函数的高级应用

### 3.2.1 多变量数据的melt操作

在处理包含多个测量变量的数据集时,我们可以同时指定多个变量到`measure.vars`参数。这样,melt函数会将这些变量合并到一个新的长格式数据框中。

例如,如果我们有以下数据框,它不仅包含时间点的测量值,还包括另一组变量`Group`:

```R

df <- data.frame(

ID = c(1, 2, 3),

Group = c("A", "B", "A"),

Time1 = c(22, 27, 23),

Time2 = c(25, 28, 29),

Time3 = c(26, 29, 27)

)

```

我们可以这样应用melt:

```R

melted_df <- melt(df, id.vars = c("ID", "Group"), measure.vars = c("Time1",

```

0

0