递归树递归调用栈分析:深入理解调用原理

发布时间: 2024-09-12 17:44:17 阅读量: 30 订阅数: 26

# 1. 递归树与递归调用栈简介

在计算机科学中,递归树与递归调用栈是理解递归算法的基本组成部分。本章旨在为读者提供对这两个概念的概览,为后续章节中更深入的讨论奠定基础。

## 1.1 递归树的初步认识

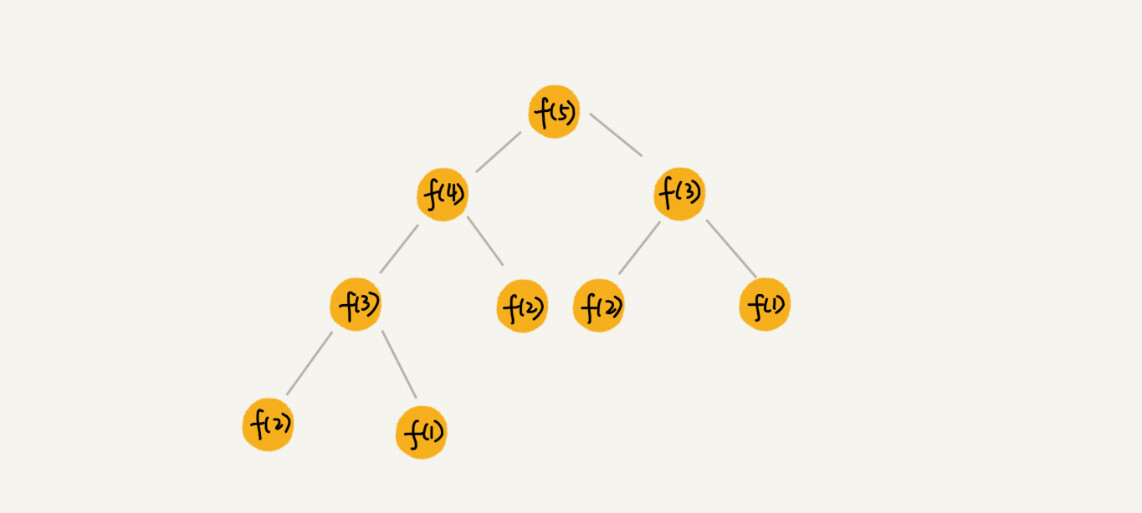

递归树是表示递归函数调用的一种树形数据结构。每个节点代表一次函数调用,其中子节点代表下一级递归调用。理解递归树的结构有助于可视化递归过程中的函数执行顺序。

## 1.2 递归调用栈的原理

递归调用栈是一种特殊的栈结构,它用于存储程序中每次递归调用的状态信息。栈顶的元素对应最近的函数调用,而栈底的元素对应最初的函数调用。调用栈的内存管理涉及分配和释放栈帧,保证程序的正确执行和回收内存资源。

理解递归树和调用栈的概念对于深入学习递归算法至关重要。接下来的章节将详细探讨递归树的构建方法、递归算法的时间复杂度、递归调用栈的工作原理,以及递归优化策略等。

# 2. 递归树的基本概念和算法

### 2.1 递归树的定义和特性

#### 2.1.1 递归树的数学基础

递归树是递归思想在树形数据结构上的应用。在数学中,树可以被定义为一个无环连通图,即一个没有环并且任意两个节点之间有且仅有一条路径相连的图。递归树的每个节点可以有零个或多个子节点,并且通常有一个根节点,该节点没有父节点。

从算法的角度来看,递归树是一种递归式的数据结构,其中每个节点代表一个子问题。在解决问题的过程中,每个子问题都会被分解为若干个更小的子问题,这些子问题又被递归地分解,直到达到基本情况(base case),即不需要进一步分解的问题。

递归树的构建通常需要考虑以下三个方面的数学基础:

1. **递归关系**:描述了如何从一个或多个更小问题构建当前问题。

2. **基本情况**:递归的停止条件,通常是问题的最简单形式。

3. **组合函数**:描述如何将子问题的解组合成当前问题的解。

递归树的每个节点代表一个递归调用,树的层级对应递归的深度。递归算法的效率很大程度上取决于递归树的形态和深度。

#### 2.1.2 递归树在算法中的应用

在算法设计中,递归树被广泛用于解决分治问题,如排序算法中的归并排序、树和图的遍历算法、以及一些特定的优化问题。

例如,在归并排序中,递归树的每个节点表示一次分割过程,其中数组被分割为更小的部分,直至每个部分只有一个元素(基本情况)。然后,这些小数组被两两合并(组合函数),最终形成一个完整的有序数组。

递归树可以直观地表示算法的执行过程,并帮助我们理解算法的空间和时间复杂度。通过分析递归树的层级和每个节点代表的工作量,可以得到算法的总体复杂度。

### 2.2 递归树的构建方法

#### 2.2.1 构建递归树的基本步骤

构建递归树通常遵循以下步骤:

1. **定义问题**:确定需要解决的原问题和基本情况。

2. **设计递归方案**:根据问题的特点,设计如何将原问题分解为子问题。

3. **实现递归函数**:编写递归函数来实现问题的分解和递归调用。

4. **构建树结构**:在递归函数中,将每个子问题作为一个节点加入到树中。

5. **终止条件**:确保每个递归调用都有一个明确的终止条件,避免无限递归。

下面是一个简单的归并排序的递归树构建伪代码示例:

```plaintext

function mergeSort(array):

if len(array) <= 1:

return array

mid = len(array) / 2

left = mergeSort(array[:mid])

right = mergeSort(array[mid:])

return merge(left, right)

function merge(left, right):

result = []

while len(left) > 0 and len(right) > 0:

if left[0] <= right[0]:

result.append(left.pop(0))

else:

result.append(right.pop(0))

result.extend(left)

result.extend(right)

return result

```

通过上述步骤,我们可以构建出归并排序的递归树,并且通过观察树的结构,我们可以了解在排序过程中数据是如何被分解和合并的。

#### 2.2.2 递归树的优化策略

递归树的优化策略主要集中在减少不必要的递归调用和降低空间复杂度上。优化递归树的关键在于:

1. **避免重复计算**:使用记忆化技术存储已经计算过的子问题的解,避免重复计算相同问题。

2. **剪枝**:在递归树中,有些节点可能代表的解并不需要被完全计算。通过剪枝技术可以提前终止这些分支的递归调用。

3. **减少递归深度**:通过改变递归策略,减少递归调用的深度,可以有效减少系统调用栈的开销。

以斐波那契数列的递归实现为例,未优化的版本如下:

```python

def fibonacci(n):

if n <= 1:

return n

else:

return fibonacci(n-1) + fibonacci(n-2)

```

上述代码会产生大量的重复计算。通过引入一个简单的缓存机制,我们可以将其优化为:

```python

cache = {}

def fibonacci(n):

if n in cache:

return cache[n]

if n <= 1:

return n

cache[n] = fibonacci(n-1) + fibonacci(n-2)

return cache[n]

```

在这个优化后的版本中,每个数字只被计算一次并存储在`cache`中,显著提高了效率。

### 2.3 递归算法的时间复杂度分析

#### 2.3.1 时间复杂度的基本概念

时间复杂度是衡量算法运行时间与输入数据大小关系的一个指标。在递归算法中,时间复杂度通常与递归树的深度和每个节点的工作量有关。

递归算法的时间复杂度分析分为以下几个步骤:

1. **确定递归深度**:计算递归树的最大深度。

2. **计算节点工作量**:确定递归树每个节点上执行的操作数量。

3. **求和**:将每个节点的工作量累加,得到算法的总工作量。

#### 2.3.2 递归树算法的时间复杂度计算

对于递归树算法,其时间复杂度可以通过递归树的节点数量来进行估算。考虑一个简单的二叉递归树,每个节点被分为两个子节点,如果树的深度为`d`,则节点总数是`O(2^d)`。

假设每个节点的操作需要`O(1)`时间,那么该递归算法的时间复杂度为`O(2^d)`。这个例子中,时间复杂度与递归深度`d`成指数关系,因此对于深层递归,效率会非常低下。

以斐波那契数列递归解法为例,其时间复杂度为`O(2^n)`,这是因为每个节点都会产生两个新的子节点(除了基本情况)。优化后的缓存版本,时间复杂度降至`O(n)`,因为每个子问题只需要计算一次。

通过递归树的分析,我们可以更准确地了解算法的效率,并有针对性地进行优化。下面是一个表格,比较了递归树算法优化前后的性能:

| 算法版本 | 时间复杂度 | 空间复杂度 | 备注 |

| --------- | ----------- | ----------- | ---- |

| 未优化的斐波那契数列递归 | O(2^n) | O(n) | 时间和空间效率都很低 |

| 优化的斐波那契数列递归 | O(n) | O(n) | 显著提升了效率 |

通过以上分析,我们可以看出,递归树算法的时间复杂度分析对于优化算法性能至关重要。通过理解递归树的工作原理,我们可以对递归

0

0