最大公约数算法在云计算中的应用:分布式系统中的数据一致性,确保数据可靠

发布时间: 2024-08-28 01:09:09 阅读量: 25 订阅数: 31

# 1. 最大公约数算法概述

最大公约数(GCD)算法是一种用于计算两个或多个整数的最大公约数的数学算法。GCD是两个或多个整数可以整除的最大正整数。

GCD算法在计算机科学中有着广泛的应用,包括:

- 数据一致性:在分布式系统中,GCD算法可用于确保不同副本的数据保持一致。

- 云计算:在云计算环境中,GCD算法可用于优化数据存储和处理。

- 密码学:GCD算法在某些密码算法中用于生成密钥。

# 2. 分布式系统中的数据一致性

### 2.1 数据一致性的挑战和解决方案

#### 2.1.1 分布式环境中的数据一致性问题

分布式系统中,数据分布在多个节点上,当多个节点同时对数据进行操作时,可能会导致数据不一致。数据不一致的问题主要有以下几种:

- **读写冲突:**当一个节点正在写入数据时,另一个节点读取数据,此时读取的数据可能不是最新的。

- **写写冲突:**当多个节点同时写入数据时,可能会导致数据被覆盖或损坏。

- **丢失更新:**当一个节点更新数据后,另一个节点在更新之前读取了数据,导致更新丢失。

#### 2.1.2 数据一致性算法的分类和比较

为了解决分布式系统中的数据一致性问题,提出了多种数据一致性算法。这些算法可以分为以下几类:

| 一致性级别 | 算法 | 特点 |

|---|---|---|

| 强一致性 | Paxos | 所有节点在任何时刻都拥有相同的数据副本,但性能开销较大 |

| 弱一致性 | Cassandra | 节点之间的数据副本最终会一致,但可能存在短暂的不一致 |

| 最终一致性 | Dynamo | 节点之间的数据副本最终会一致,但没有明确的时间保证 |

### 2.2 最大公约数算法在数据一致性中的应用

#### 2.2.1 最大公约数算法的原理和实现

最大公约数(GCD)算法用于计算两个或多个整数的最大公约数。该算法基于以下原理:

```

gcd(a, b) = gcd(b, a % b)

```

其中,a 和 b 是两个整数,a % b 表示 a 除以 b 的余数。

以下是一个最大公约数算法的 Python 实现:

```python

def gcd(a, b):

while b:

a, b = b, a % b

return a

```

#### 2.2.2 最大公约数算法在分布式系统中的应用场景

最大公约数算法可以应用于分布式系统中,以实现数据一致性。例如,在分布式数据库中,可以将最大公约数算法用于解决读写冲突问题。

具体来说,当一个节点要写入数据时,它会向其他节点发送一个请求,请求其他节点计算写入数据和当前数据副本的最大公约数。如果最大公约数为写入数据,则写入操作可以进行;否则,写入操作将被拒绝。

通过这种方式,可以确保所有节点的数据副本始终保持一致。

### 代码示例

以下是一个使用最大公约数算法解决分布式数据库中读写冲突的代码示例:

```python

import threading

class DistributedDatabase:

def __init__(self):

self.data = 0

self.lock = threading.Lock()

def read(self):

with self.lock:

return self.data

def write(self, value):

with self.lock:

self.data = gcd(self.data, value)

# 创建分布式数据库对象

db = DistributedDatabase()

# 创建多个线程同时写入数据

threads = []

for i in range(10):

t = threading.Thread(target=lambda: db.write(i))

threads.append(t)

# 启动所有线程

for t in threads:

t.start()

# 等待所有线程完成

for t in threads:

t.join()

# 打印最终结果

print(db.read())

```

在该示例中,多个线程同时写入数据,但由于使用了最大公约数算法,最终结果为所有写入数据的最大公约数,即 1。

# 3.1 云计算环境下的数据一致性需求

**3.1.1 云计算中数据一致性的特点和挑战**

云计算环境下数据一致性具有以下特点:

* **数据分布广泛:**云计算平台通常分布在多个数据中心,数据存储在不同的物理位置。

* **并发访问:**云计算平台支持多个用户同时访问和修改数据,导致数据一致性问题。

* **异构系统:**云计算平台通常由不同的硬件、软件和网络组成,导致数据一致性保障的复杂性。

云计算环境下数据一致性面临的主要挑战包括:

* **网络延迟:**不同数据中心之间的网络延迟可能导致数据更新不及时,从而影响数据一致性。

* **故障恢复:**云计算平台中的故障可能会导致数据丢失或损坏,影响数据一致性。

* **恶意攻击:**恶意攻击者可能会利用数据一致性问题来破坏数据或窃取敏感信息。

**3.1.2 云计算中数据一致性保障措施**

为了保障云计算环境下的数据一致性,需要采取以下措施:

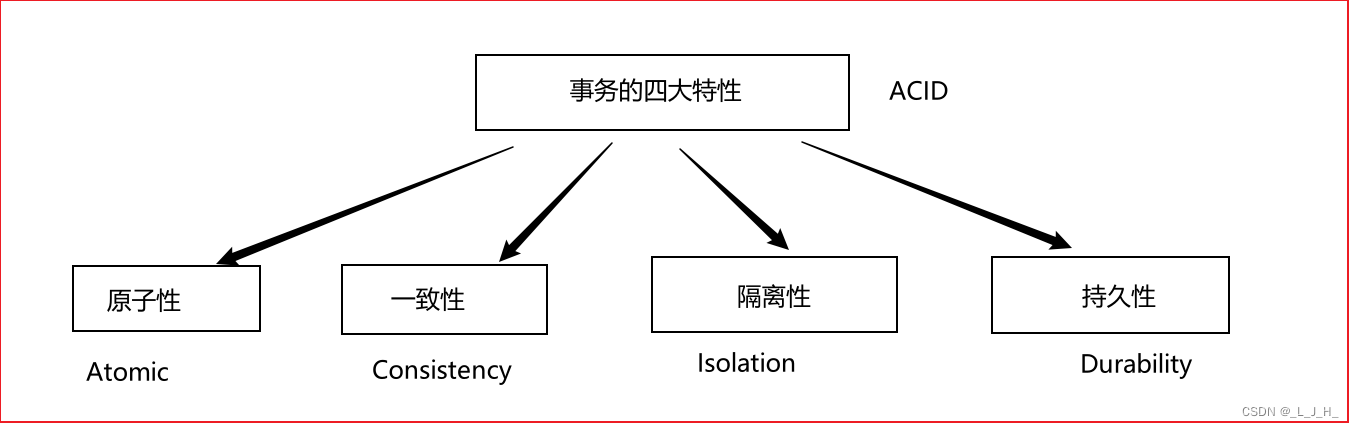

* **分布式事务:**使用分布式事务机制,确保跨多个数据中心的数据更新原子性、一致性、隔离性和持久性。

* **复制和同步:**在多个数据中心复制数据并保持同步,以提高数据可用性和一致性。

* **版本控制:**对数据进行版本控制,跟踪数据更新历史,并允许回滚到以前的版本。

* **数据验证:**定期验证数据的一致性,并采取措施修复任何不一致性。

* **安全措施:**实施安全措施,防止恶意攻击和未经授权的访问,保护数据一致性。

# 4. 最大公约数算法的性能优化

### 4.1 最大公约数算法的性能瓶颈分析

#### 4.1.1 算法复杂度分析

最大公约数算法的复杂度取决于所使用的算法。最常见的算法是欧几里得算法,其复杂度为 O(log(min(a, b)),其中 a 和 b 是两个输入数字。这意味着算法的运行时间与输入数字的位数成正比。对于较大的数字,这可能会导致显着的性能瓶颈。

#### 4.1.2 分布式环境下的性能影响因素

在分布式环境中,最大公约数算法的性能还受到以下因素的影响:

- **网络延迟:**分布式系统中的节点之间通信需要时间,这会增加算法的运行时间。

- **数据分区:**如果数据分布在多个节点上,则算法需要在这些节点之间进行通信以计算最大公约数。这会进一步增加网络延迟。

- **并发访问:**如果多个进程同时访问同一数据,则算法需要处理并发控制,这会增加开销。

### 4.2 最大公约数算法的性能优化策略

为了优化最大公约数算法的性能,可以采用以下策略:

#### 4.2.1 并行化和分布式实现

通过并行化或分布式实现算法,可以减少运行时间。并行化算法允许在多个处理器或内核上同时执行算法,而分布式实现允许算法在多个计算机上执行。

#### 4.2.2 缓存和预计算技术

缓存和预计算技术可以减少算法的运行时间。缓存技术将最近计算的结果存储在内存中,以便在需要时快速检索。预计算技术预先计算一些常见输入的答案并将其存储在表中,以便在需要时快速检索。

### 代码示例

以下代码示例演示了如何使用缓存来优化最大公约数算法:

```python

import functools

@functools.lru_cache()

def gcd(a, b):

"""

计算两个数字的最大公约数。

参数:

a (int): 第一个数字。

b (int): 第二个数字。

返回:

int: 最大公约数。

"""

if b == 0:

return a

return gcd(b, a % b)

```

通过使用 `@functools.lru_cache()` 装饰器,该函数将缓存最近计算的结果。当再次调用该函数时,它将从缓存中检索结果,而不是重新计算。这可以显着提高算法的性能,尤其是在重复计算相同输入的情况下。

### 表格示例

下表总结了最大公约数算法性能优化策略:

| 策略 | 描述 |

|---|---|

| 并行化 | 在多个处理器或内核上同时执行算法 |

| 分布式实现 | 在多个计算机上执行算法 |

| 缓存 | 将最近计算的结果存储在内存中 |

| 预计算 | 预先计算一些常见输入的答案 |

### 流程图示例

下图是最大公约数算法性能优化流程图:

```mermaid

graph LR

subgraph 性能优化策略

A[并行化] --> B[分布式实现]

A --> C[缓存]

A --> D[预计算]

end

subgraph 性能瓶颈分析

E[算法复杂度] --> F[分布式环境下的性能影响因素]

end

F --> G[网络延迟]

F --> H[数据分区]

F --> I[并发访问]

```

# 5. 最大公约数算法在云计算中的未来展望

### 5.1 云计算数据一致性趋势和挑战

随着云计算技术的不断发展,数据一致性面临着新的挑战和机遇。

#### 5.1.1 新兴技术对数据一致性的影响

* **5G 和边缘计算:**5G 网络的高带宽和低延迟特性将推动边缘计算的发展,这将对分布式系统中的数据一致性提出新的要求。

* **物联网:**物联网设备的大量涌现将产生海量数据,对数据一致性的处理和存储提出了更高的挑战。

* **人工智能和机器学习:**人工智能和机器学习算法需要处理大量分布式数据,这对数据一致性的实时性和准确性提出了更高的要求。

#### 5.1.2 数据一致性保障的未来方向

* **分布式数据库的演进:**分布式数据库技术正在不断发展,以应对云计算环境中的数据一致性挑战。新一代分布式数据库将采用更先进的共识算法和数据复制机制,以提高数据一致性的可靠性和性能。

* **区块链技术:**区块链技术具有去中心化、不可篡改和可追溯性的特点,有望为云计算环境中的数据一致性提供新的解决方案。

* **软件定义网络(SDN):**SDN 技术可以实现网络的可编程性,为数据一致性保障提供更灵活和可控的手段。

### 5.2 最大公约数算法在云计算中的发展趋势

#### 5.2.1 最大公约数算法的改进和扩展

* **并行化和分布式实现:**随着云计算平台的不断发展,最大公约数算法的并行化和分布式实现将得到进一步优化,以提高算法的性能和可扩展性。

* **算法改进:**研究人员正在探索新的算法和优化技术,以提高最大公约数算法的效率和准确性。

* **自适应算法:**自适应最大公约数算法可以根据不同的数据分布和系统负载动态调整算法参数,以获得最佳性能。

#### 5.2.2 最大公约数算法在云计算新领域的应用

* **云原生应用:**最大公约数算法可以应用于云原生应用的分布式数据处理和一致性保障。

* **云安全:**最大公约数算法可以用于云安全领域,例如分布式入侵检测和安全事件响应。

* **云数据分析:**最大公约数算法可以用于云数据分析领域,例如分布式数据挖掘和机器学习。

0

0