数据一致性解决方案:HDFS迁移中的关键挑战

发布时间: 2024-10-29 10:47:30 阅读量: 11 订阅数: 26

# 1. 数据一致性与HDFS迁移概述

在现代信息技术飞速发展的时代,数据已成为企业的重要资产。数据的一致性对于保证业务的连续性和数据的准确性至关重要。随着数据量的不断增长,越来越多的组织需要迁移至更大规模的存储系统以适应业务需求,HDFS(Hadoop Distributed File System)作为一种广泛使用的分布式文件系统,其迁移过程中的数据一致性问题尤为关键。

## 数据一致性的重要性

数据一致性是信息系统能够正确反映其数据间真实状态的能力。在HDFS迁移中,保持数据一致性是确保应用能够在迁移后无缝运行的基础。对于任何迁移项目来说,数据一致性的考量不仅仅是技术问题,更是业务连续性和数据安全性的核心。

## HDFS迁移的目的和挑战

HDFS迁移的主要目的是实现系统的升级、扩展或维护,同时保证数据不丢失、不损坏,并在迁移过程中保持业务的稳定运行。挑战在于确保数据的完整性和一致性,以及在迁移过程中避免对业务造成干扰。

接下来的章节将深入探讨HDFS迁移中的一致性理论基础、实践中的关键问题、迁移工具与案例分析以及未来趋势与技术展望。

# 2. ```

# 第二章:HDFS迁移中的一致性理论基础

在现代数据密集型应用中,Hadoop分布式文件系统(HDFS)由于其可扩展性和容错性被广泛采用。但是,随着企业业务的发展和技术的更新,HDFS迁移成为不可避免的任务。在进行HDFS迁移的过程中,数据一致性问题尤其重要,它直接关系到数据的准确性和系统的可靠性。本章将深入探讨HDFS架构与数据一致性原理、数据一致性模型以及理论框架下的HDFS迁移挑战。

## 2.1 HDFS架构与数据一致性原理

### 2.1.1 HDFS的基本架构组件

HDFS 是一个高度容错性的系统,适合在廉价硬件上运行。它的设计目标是支持大文件的存储和高吞吐量的数据访问。HDFS的基本架构包括以下几个关键组件:

- **NameNode**:管理文件系统的命名空间。它维护着文件系统树以及整个文件系统的元数据。这些信息包括所有的文件和目录以及每个文件的块列表和块的位置等。

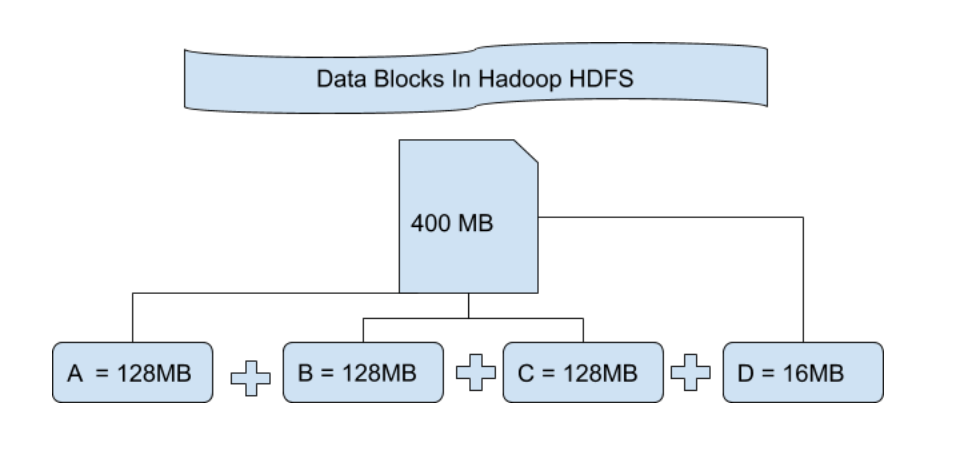

- **DataNode**:负责存储实际的数据。数据以块的形式存储,每个块的默认大小为128MB(在Hadoop 2.x中默认为128MB,在Hadoop 3.x中默认为256MB)。一个文件被切分成若干块,存储在多个DataNode上。

- **Secondary NameNode**:定期合并文件系统命名空间镜像与编辑日志,帮助NameNode减轻元数据存储的压力。

### 2.1.2 数据一致性的定义和重要性

数据一致性是指在分布式系统中,所有数据副本在任意时刻都能保证一致的状态。在HDFS中,一致性主要涉及以下几个方面:

- **命名空间一致性**:指文件系统树以及文件和目录的属性的准确性和完整性。

- **数据块一致性**:指数据块内容的一致性和块在DataNode间正确分布。

- **客户端一致性**:指客户端看到的文件内容与其写入时一致,没有因系统故障、网络问题等原因造成数据损坏或不一致。

数据一致性对于保持数据准确性和系统稳定性至关重要。如果数据在多个节点间不一致,那么就可能导致数据丢失、数据冗余或不正确的计算结果,严重影响业务的正常运行。

## 2.2 数据一致性模型

### 2.2.1 强一致性模型

强一致性模型是指系统中的所有操作完成后,任何后续的访问都能立即看到最新的状态。在HDFS中,文件的写操作完成后,所有的读操作都能立即读到最新写入的数据。

### 2.2.2 最终一致性模型

最终一致性模型是指系统保证如果没有新的更新操作,那么最终所有的数据副本都将是一致的。HDFS提供了数据的复制功能,虽然在写入数据后,可能不会立即在所有副本上体现,但最终所有副本都会达到一致的状态。

### 2.2.3 HDFS的一致性模型

HDFS采用的是基于CAP定理(一致性、可用性、分区容错性)的权衡方案。它在保证高可用性和分区容错性的同时,尽量提供强一致性保证。在HDFS中,写入操作默认是按照最终一致性模型实现的,而读操作则尽量保证能够读到最新的数据。

## 2.3 理论框架下的HDFS迁移挑战

### 2.3.1 迁移过程中的数据完整性问题

在HDFS迁移过程中,确保数据完整性是最大的挑战之一。由于迁移可能涉及硬件、软件、网络等多个层面,因此数据在迁移过程中可能面临损坏、丢失或不一致的风险。

### 2.3.2 HDFS命名节点的高可用性挑战

HDFS的NameNode是系统的关键组件,负责管理所有的文件系统元数据。在迁移过程中,如果NameNode不可用,将导致整个HDFS集群不可用。因此,保证NameNode的高可用性以及在迁移期间的无中断切换是另一个重大挑战。

```

以上内容是根据您的目录结构框架生成的第二章内容,每部分均遵循Markdown格式。接下来是第三章的内容,由于篇幅限制,这里只提供一个大致的结构和部分内容。

```

# 第三章:HDFS迁移实践中的关键问题

HDFS迁移是一个复杂且风险较高的过程,它需要精心的策划和执行。本章重点讨论在HDFS迁移实践中的关键问题,例如数据迁移策略的选择、迁移过程中数据校验、迁移后的数据一致性检验与恢复。这些问题的妥善处理对于保障数据的完整性和系统的稳定运行至关重要。

## 3.1 数据迁移的策略选择

### 3.1.1 滚动升级

滚动升级是一种常用的迁移策略,它允许集群的一部分节点在不影响整体集群服务的前提下进行软件升级或硬件更换。通过逐个或逐批次替换旧的节点,可以最小化服务中断的时间,但同时也带来了管理上的复杂性。

### 3.1.2 数据迁移期间的读写分离

在迁移过程中实施读写分离可以有效地减少对业务的影响。读操作可以尽可能多地使用旧集群,而写操作则逐步迁移到新集群。这种方式可以确保迁移期间数据的完整性,但可能需要额外的配置和监控。

## 3.2 HDFS迁移过程中的数据校验

### 3.2.1 数据校验的策略和工具

为了确保数据的准确性,在迁移完成后进行数据校验是必不可少的一步。HDFS提供了多种工具来进行数据完整性检查,例如`hdfs fsck`命令,它能够检查文件系统中的健康状况和文件块的完整性。同时,还可以使用第三方数据校验工具,这些工具可以提供更为全面和深入的数据一致性验证。

### 3.2.2 数据校验过程中的常见错误及解决

在数据校验过程中可能会遇到多种错误,如文件块损坏、元数据不一致等。这些问题的诊断和解决需要对HDFS的内部机制有深刻的理解。例如,块校验失败可能需要重新复制损坏的块,而元数据错误则可能需要参考HDFS的命名空间日志来修正。

## 3.3 迁

```

0

0