数据透视表在Pandas中的实现:高级聚合与分组的不传之秘

发布时间: 2024-09-18 13:32:51 阅读量: 125 订阅数: 65

# 1. 数据透视表的概念与重要性

数据透视表是一种强大的数据汇总工具,它允许用户以动态、直观的方式汇总、分析和呈现大量数据集。作为数据分析和商业智能领域中不可或缺的组件,数据透视表能够快速将复杂数据转换为易于理解的信息,支持决策过程。

## 1.1 数据透视表的定义

数据透视表通过构建交叉表的方式,汇总并比较不同维度的数据。它提供了一个动态的界面,使得数据可以从多个角度被筛选、分组和汇总,从而得到深入的洞察。

## 1.2 数据透视表的功能与应用

数据透视表可以处理大量数据,并且具有高度的灵活性。通过拖放行、列、数据区域和过滤器,用户能够快速调整报表,以响应不同的分析需求。

## 1.3 数据透视表在数据分析中的重要性

数据分析的目的在于提炼信息、发现模式,并为决策提供依据。数据透视表提供了一个高效的途径来实现这一点,其交互式的特性使得分析过程更加直观和高效。

在接下来的章节中,我们将深入了解如何使用Pandas这一强大的Python库来实现高级数据透视表的构建,这将是数据分析工作流程中的一部分,进一步提升数据处理的灵活性和效率。

# 2. Pandas库基础

## 2.1 Pandas库概述

### 2.1.1 Pandas库的安装与导入

Pandas是一个开源的Python数据分析库,广泛应用于数据挖掘和数据处理领域。在安装Pandas库前,需要确保Python环境已经搭建完毕,并且安装了pip包管理工具。Pandas可以通过以下指令安装:

```bash

pip install pandas

```

安装完成后,就可以在Python脚本或Jupyter Notebook中导入Pandas库:

```python

import pandas as pd

```

### 2.1.2 Pandas的基本数据结构

Pandas主要有两种数据结构:Series和DataFrame。Series是一个一维数组,可以存储任何数据类型(整数、字符串、浮点数、Python对象等)。DataFrame则是一个二维的表格型数据结构,每一列可以是不同的数据类型。

一个Series对象可以这样创建:

```python

import pandas as pd

s = pd.Series([1, 2, 3, 4, 5])

print(s)

```

输出结果:

```

dtype: int64

```

创建一个DataFrame对象:

```python

import pandas as pd

data = {

'Column1': [1, 2, 3, 4],

'Column2': ['a', 'b', 'c', 'd']

}

df = pd.DataFrame(data)

print(df)

```

输出结果:

```

Column1 Column2

0 1 a

1 2 b

2 3 c

3 4 d

```

## 2.2 Pandas中的数据选择与过滤

### 2.2.1 索引与选择数据

在Pandas中,数据可以通过行索引和列标签来选择。例如,使用`.iloc`可以基于位置选择数据,而`.loc`基于标签进行选择。

```python

import pandas as pd

# 选择第一行数据

first_row = df.iloc[0]

print(first_row)

# 选择第二列数据

second_column = df['Column2']

print(second_column)

```

### 2.2.2 条件过滤与布尔索引

Pandas支持使用布尔索引来过滤数据,基于一系列的条件来获取数据子集。

```python

# 选择Column1中值大于2的行

filtered_rows = df[df['Column1'] > 2]

print(filtered_rows)

```

## 2.3 Pandas中的数据清洗

### 2.3.1 缺失值的处理

在处理实际数据时,常常遇到缺失值。Pandas提供了多种方法来处理这些缺失值,例如 `.dropna()`删除缺失值,`.fillna()`填充缺失值。

```python

# 删除含有任何NaN的行

df_cleaned = df.dropna()

# 填充所有NaN为默认值10

df_filled = df.fillna(10)

```

### 2.3.2 数据合并与重塑

Pandas支持多种数据合并和重塑操作。可以使用`.concat()`合并多个DataFrame对象,使用`.merge()`按条件合并,以及使用`.pivot()`或`.pivot_table()`重塑数据。

```python

# 合并两个DataFrame

df1 = pd.DataFrame({'A': ['foo', 'bar'], 'B': ['one', 'two']})

df2 = pd.DataFrame({'A': ['foo', 'bar'], 'C': ['three', 'four']})

merged_df = pd.concat([df1, df2], axis=1)

print(merged_df)

```

输出结果:

```

A B C

0 foo one three

1 bar two four

```

以上章节详细介绍了Pandas库的基础知识,从安装导入到数据结构、数据选择与过滤,以及数据清洗。在接下来的章节中,我们将深入学习Pandas的高级功能,例如聚合与分组操作。

# 3. Pandas高级聚合与分组操作

在处理复杂数据集时,将数据拆分成多个部分、应用函数以及将结果组合起来是一个常见的任务。Pandas 库提供了非常强大的数据聚合与分组操作功能,帮助数据科学家与分析师快速实现复杂的数据分析与处理。本章将深入探讨Pandas中的高级聚合与分组操作,让读者能够充分掌握如何利用这些工具进行数据处理和分析。

## 3.1 聚合操作的理论基础

### 3.1.1 聚合函数与groupby方法

聚合操作是指通过某一函数对数据集中的数据进行汇总的过程,如计算均值、总和、标准差等统计量。在Pandas中,最常用的聚合函数是`groupby`方法,它可以将数据集按照指定的规则进行分组,并对各分组应用聚合函数。

```python

import pandas as pd

# 创建一个简单的DataFrame作为例子

df = pd.DataFrame({

'Company': ['Google', 'Google', 'Microsoft', 'Microsoft'],

'Person': ['Alice', 'Bob', 'Alice', 'Bob'],

'Sales': [200, 300, 150, 500]

})

# 使用groupby方法进行分组,并计算每组的销售总额

grouped = df.groupby('Company')

aggregated = grouped['Sales'].sum()

print(aggregated)

```

在上述代码中,我们首先创建了一个包含公司名、员工名和销售额的数据集。然后通过`groupby`方法以“Company”列作为分组依据,并对每个分组的“Sales”列计算总和。

### 3.1.2 分组键与聚合策略

分组键可以是列名、索引名,或者是可以生成这些的函数。聚合策略通常是在分组的基础上应用聚合函数,如`sum`、`mean`、`max`、`min`等。Pandas允许我们对同一组数据应用多个聚合函数:

```python

# 对同一分组应用多个聚合函数

multiple_aggregations = grouped['Sales'].agg(['sum', 'max', 'min'])

print(multiple_aggregations)

```

## 3.2 实践分组与聚合

### 3.2.1 应用groupby进行分组

在实际操作中,数据集可能具有多个分类变量,`groupby`方法允许我们指定多个列进行多维度的分组。例如,如果我们的DataFrame包含“Company”、“Department”和“Sales”三列,我们可以同时按这两个分类变量进行分组:

```python

# 假设我们有一个额外的Department列

df['Department'] = ['HR', 'IT', 'HR', 'IT']

# 使用两个列进行分组

grouped = df.groupby(['Company', 'Department'])

print(grouped.size())

```

### 3.2.2 结合聚合函数实现复杂分析

Pandas提供的聚合功能非常灵活,可以实现复杂的分析。例如,我们可以计算每个公司每个部门的平均销售额:

```python

# 计算每个公司每个部门的平均销售额

average_sales = df.groupby(['Company', 'Department'])['Sales'].mean().unstack()

print(average_sales)

```

`unstack`方法用于将多级索引的数据重塑成一个新的DataFrame结构,这里它将“Company”列转换为索引,而“Department”列则转换为列头,从而清晰地展示每个部门的平均销售情况。

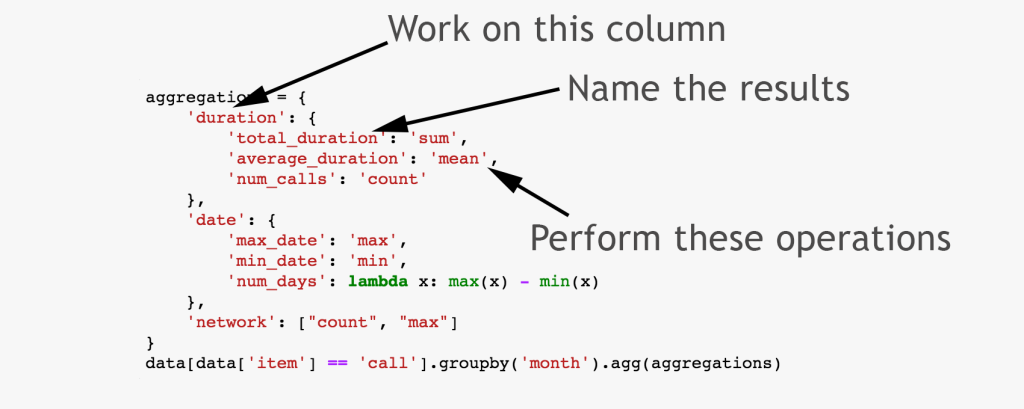

## 3.3 高级聚合技巧

### 3.3.1 使用transform进行数据转换

`transform`方法允许我们在分组后对分组内的数据进行转换。与聚合函数不同的是,`transform`会保留原始数据的结构,返回与原数据集一样大小的结果:

```python

# 计算每个部门相对于其平均销售额的差值

relative_performance = df.groupby('Department')['Sales'].transform(lambda x: (x - x.mean()) / x.mean())

df['Relative_Performance'] = relative_perfor

```

0

0