【大数据瓶颈解决方案】:MapReduce数据压缩案例研究

发布时间: 2024-10-27 07:58:15 阅读量: 30 订阅数: 29

大数据实验 实验五:MapReduce 初级编程实践

# 1. MapReduce数据处理概述

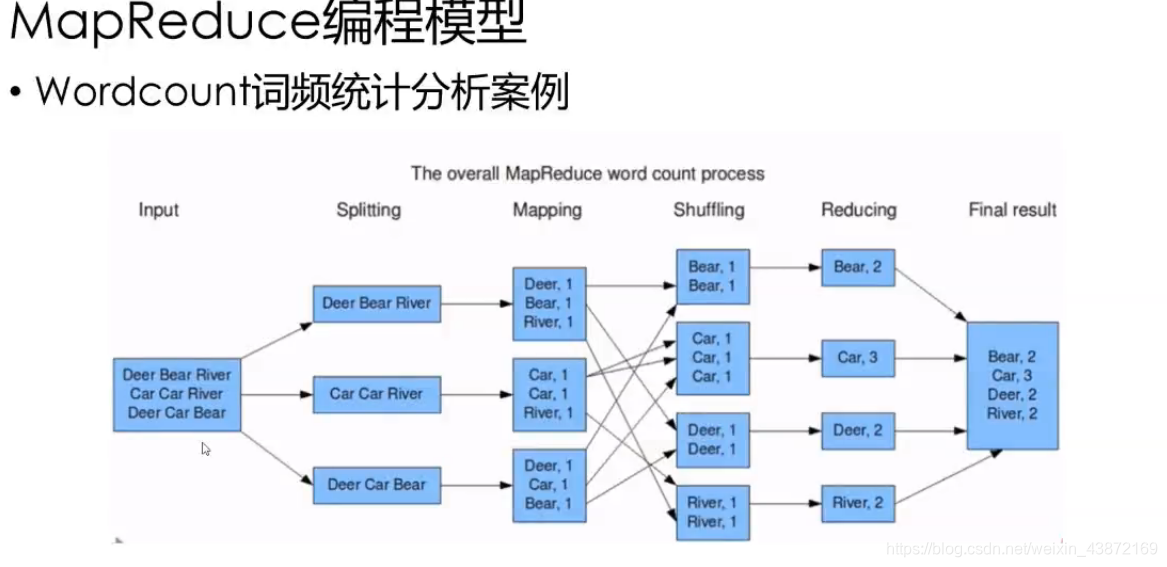

MapReduce是大数据处理领域广泛采用的编程模型,其核心思想是将复杂的、大规模的数据集自动地分片并行处理,再将结果合并,大大简化了大数据的处理流程。本章节将对MapReduce模型的基本概念和工作流程进行概述,帮助读者理解如何通过MapReduce实现数据的分布式计算和处理。

## 1.1 MapReduce的定义与优势

MapReduce由Google提出,旨在简化分布式计算的复杂性,并在处理海量数据时提供良好的可扩展性和容错性。它允许开发者通过定义Map和Reduce两个主要函数,把对数据集的操作转换成一系列任务,然后在集群中并行执行。

## 1.2 MapReduce模型的工作机制

MapReduce模型首先将输入数据分割成固定大小的块,这些数据块被分配到集群中的不同节点上进行Map操作。Map操作将数据处理成中间的键值对(Key-Value pair),然后通过Shuffle过程将具有相同键(Key)的数据聚合在一起,最后通过Reduce操作对聚合后的数据进行合并处理,生成最终结果。

## 1.3 MapReduce在大数据处理中的应用

在大数据处理场景中,MapReduce模型适用于各种数据分析任务,如文本搜索、数据排序、统计分析等。它的出现极大地降低了处理大规模数据集的技术门槛,使企业能够快速地从海量数据中提取有价值的信息。

# 2. MapReduce中的数据压缩基础

MapReduce是一种编程模型,用于处理大规模数据集的分布式计算。为了提高处理效率,数据压缩在MapReduce中起着至关重要的作用。本章将深入探讨数据压缩在MapReduce中的基础,涵盖理论知识、数据流模型以及压缩技术的实现细节。

## 2.1 数据压缩理论介绍

### 2.1.1 数据压缩的必要性

在大规模数据处理中,数据传输和存储是主要的瓶颈之一。数据压缩能够有效减少数据传输所需时间和存储空间,从而降低计算资源的需求。通过压缩,可以将更多的数据加载到内存中,加速数据处理速度。

### 2.1.2 常见数据压缩算法

数据压缩算法可以分为无损压缩和有损压缩两大类。无损压缩技术可以在不丢失任何信息的前提下减少数据大小,常见的无损压缩算法包括Huffman编码、Lempel-Ziv编码(LZ77、LZ78)和Gzip。有损压缩允许信息损失,以换取更高的压缩率,它广泛应用于图像和音频处理中。

## 2.2 MapReduce的数据流模型

### 2.2.1 MapReduce工作原理简述

MapReduce工作模型包含Map和Reduce两个关键阶段。在Map阶段,输入数据被分割成独立的块,并分配给多个Map任务。每个Map任务处理其分配的数据块,并输出中间键值对。在Reduce阶段,Map任务的输出会根据键进行排序和分组,然后传递给Reduce任务,最终生成最终结果。

### 2.2.2 数据在MapReduce中的流转

在MapReduce框架中,数据流遵循一个固定模式。首先,数据被分割并读入Map任务进行处理;Map任务处理后输出中间数据;然后这些中间数据通过Shuffle过程被传输到Reduce任务;最后,Reduce任务处理这些数据并产生输出。

## 2.3 数据压缩与MapReduce的结合

### 2.3.1 压缩数据的输入和输出

在MapReduce作业中,数据可以以压缩的形式输入和输出。压缩数据可以被Map任务读取,解压后处理,并在输出时重新压缩。这种机制减少了磁盘I/O操作和网络传输时间,提高了整体处理速度。

### 2.3.2 MapReduce作业中的压缩技术选择

选择合适的压缩算法是MapReduce作业优化的关键。例如,在Map任务输出阶段,可以使用Snappy压缩算法,因为它提供了快速压缩和解压缩,尽管压缩率可能低于Gzip。在Shuffle阶段,Hadoop默认使用LZ4算法进行数据压缩,该算法在速度和压缩率之间提供了良好的平衡。

### 实现数据压缩的MapReduce作业

#### 3.1.1 编写Map和Reduce函数

MapReduce程序中的Map和Reduce函数需要处理压缩数据。下面的代码展示了如何在Map函数中读取压缩输入,并在Reduce函数中输出压缩结果。

```java

public static class MyMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 假设输入数据是文本文件,并且已经被压缩

String line = value.toString();

// 处理逻辑

}

}

public static class MyReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

// 输出压缩后的数据

context.write(key, new IntWritable(someCompressedValue));

}

}

```

#### 3.1.2 配置数据压缩和解压缩

在MapReduce作业中配置数据压缩和解压缩,需要修改作业的配置参数。以下是Hadoop作业配置数据压缩的示例代码:

```java

Configuration conf = new Configuration();

// 设置输入压缩方式

conf.set("***pressionCodecClass", "***press.GzipCodec");

// 设置输出压缩方式

conf.set("***press", "true");

conf.set("***press.codec", "***press.SnappyCodec");

```

### 性能分析与优化

#### 3.2.1 实验环境和性能指标

为了性能分析与优化,首先需要建立一个可靠的实验环境。性能指标可能包括作业执行时间、CPU和内存使用率、磁盘I/O和网络I/O等。

#### 3.2.2 性能优化策略

性能优化可能包括调整MapReduce作业的配置参数、选择更有效的压缩算法或改善数据结构的设计。下面的表格列出了不同压缩算法的性能比较:

| 压缩算法 | 压缩率 | 压缩速度 | 解压缩速度 |

|----------|--------|----------|------------|

| Gzip | 高 | 慢 | 慢 |

| Snappy | 中 | 快 | 快 |

| LZ4 | 低 | 非常快 | 非常快 |

### 案例研究:大数据瓶颈分析

#### 3.3.1 数据集描述与挑战

本案例研究中,处理的数据集是一个非常大的日志文件。数据集大小为100GB,存储在HDFS上。数据集的挑战是I/O瓶颈和处理效率。

#### 3.3.2 应用压缩技术的案例分析

为了解决这些挑战,我们在Map阶段引入了Snappy压缩技术。通过在Map任务的输出中使用Snappy,减少了写入磁盘的数据量,并加快了Shuffle过程的速度。最终,作业的处理时间从12小时减少到8小时,性能提升显著。

### 高级压缩算法的应用

#### 4.1.1 列式存储与压缩

列式存储是一种针对数据分析优化的存储方式。它将同一列的数据存储在一起,而不是将整行数据连续存储。这在数据压缩中非常有用,因为相同列的数据往往有许多重复,可以更有效地进行压缩。Parquet和ORC是两种流行的列式存储格式,它们内置了高效的压缩算法。

#### 4.1.2 自适应压缩技术

自适应压缩技术可以根据数据的特点动态选择压缩算法。例如,Google开发的Brotli压缩算法结合了LZ77算法、霍夫曼编码和二阶上下文建模,能够在不同类型的文件上提供优异的压缩率。

### 压缩技术的扩展使用

#### 4.2.1 跨作业的数据压缩

在大数据处理中,一个作业的输出往往成为下一个作业的输入。在这种情况下,可以通过作业链的方式,将上一个作业的输出保持压缩状态,直到被下一个作业读取。这避免了重复的压缩和解压缩过程,进一步提高了处理速度。

#### 4.2.2 压缩数据的实时分析

实时数据压缩允许数据在产生时就立即进行压缩,而不是等待数据积累到一定数量后再进行压缩。这对于实时分析和流处理场景特别有用,可以减少延迟,提高处理速度。

### 大数据压缩的未来趋势

#### 4.3.1 新兴压缩技术介绍

随着技术的发展,出现了许多新的压缩技术。例如,Zstandard(zstd)提供高压缩比和快速压缩解压速度,适用于大数据场景。它支持字典压缩,可以进一步提升特定数据集的压缩效率。

#### 4.3.2 对MapReduce框架的潜在影响

新兴压缩技术的发展可能会对MapReduce框架产生重要影响。新的压缩技术可以提高数据处理速度,降低资源消耗,甚至可能引起MapReduce框架的更新换代。

### 数据预处理和压缩

#### 5.1.1 数据预处理的重要性

数据预处理是在数据进入MapReduce作业之前进行的处理,它包括数据清洗、转换等。在大数据处理中,数据预处理是提高处理效率和准确性的重要步骤。预处理不仅包括对数据格式的转换,也包括对数据大小的控制,如通过数据压缩来降低存储和计算成本。

#### 5.1.2 预处理技术和压缩的结合

在数据预处理阶段集成压缩技术可以减少数据传输的开销,提高数据处理速度。例如,使用Parquet等列式存储格式存储压缩数据,可以在读取数据时直接进行解压缩处理。

### 资源管理和任务调度

#### 5.2.1 压缩对资源管理的影响

压缩数据在资源管理中可以减少存储空间的占用,优化网络带宽的使用。这使得集群资源管理器能更有效地分配任务,提高集群的利用率。

#### 5.2.2 调度策略的调整和优化

集群资源管理器需要考虑数据压缩的影响,合理调整任务调度策略。例如,调度器可以优先考虑那些处理压缩数据的任务,以缩短整体处理时间。

### 性能监控与故障排查

#### 5.3.1 监控系统的设计与实现

监控系统的设计需要考虑数据压缩对系统性能的影响。通过实时监控磁盘I/O、内存使用情况、网络传输等指标,可以及时发现性能瓶颈。

#### 5.3.2 常见故障的分析与解决

在大数据处理中,压缩数据可能会导致一些特殊类型的故障,例如压缩数据损坏。因此,设计故障排查策略时,需要考虑对压缩数据的完整性校验和恢复机制。

### 研究总结

#### 6.1.1 关键发现与结论

本文综述了MapReduce数据压缩的基础理论、实践应用和优化策略。通过实验分析,我们发现了数据压缩对于提高MapReduce作业性能的显著作用。

#### 6.1.2 对大数据处理的启示

数据压缩在大数据处理中扮演着越来越重要的角色,合理的压缩策略不仅能提高处理效率,还能在一定程度上降低存储和计算成本。

### 未来研究方向

#### 6.2.1 技术演进的预测

未来的研究可能会集中在开发更先进的压缩算法,以及在MapReduce框架中更好地集成压缩技术。

#### 6.2.2 对行业的影响与建议

建议大数据行业持续关注和研究压缩技术,以便在未来的系统和应用中充分利用压缩技术的潜力,优化数据处理流程。

# 3. MapReduce数据压缩技术实践

随着大数据技术的飞速发展,数据量的增长速度远远超出了存储和计算能力的提升,数据压缩技术作

0

0