【压缩实战秘笈】:如何为MapReduce挑选黄金压缩格式

发布时间: 2024-10-27 07:42:25 阅读量: 16 订阅数: 23

# 1. MapReduce压缩技术概述

MapReduce作为一种分布式数据处理模型,广泛应用于大数据的分析和处理。在这一模型中,数据压缩技术不仅能够减少存储空间的占用,还能显著提升数据处理的效率。本章将为读者介绍MapReduce压缩技术的基础知识,为后续章节中对压缩技术的深入探讨打下基础。

MapReduce处理流程中,数据在写入磁盘前进行压缩可以降低I/O的负载,而读取时解压缩则增加了CPU的开销。因此,在选择压缩技术时,需要在存储空间、处理速度和CPU资源消耗之间进行权衡。接下来的章节将具体阐述在MapReduce中如何选择合适的压缩格式以及如何实现最优的压缩效果。

# 2. 压缩格式的选择标准

选择适当的压缩格式是数据存储和处理中一个至关重要的决定。这一决策将影响到数据的存储效率、处理速度和系统的整体稳定性。本章将从压缩比率与性能、兼容性和稳定性、可扩展性和维护性三个维度深入探讨压缩格式的选择标准。

### 2.1 压缩比率与性能

#### 2.1.1 压缩比率的重要性

压缩比率是指压缩后的数据大小与原始数据大小的比例。一个高的压缩比率意味着更少的存储空间需求和更低的存储成本。在大数据场景下,减少数据的存储需求可以显著降低成本,提高数据处理的效率。然而,获取高比率的同时也可能带来性能的牺牲,尤其是在压缩和解压缩的过程中,可能会增加额外的CPU消耗和处理时间。

#### 2.1.2 压缩与解压缩性能的权衡

在考虑压缩比率时,不能忽视压缩和解压缩操作的性能。一个压缩技术如果在压缩过程中消耗太多的CPU资源,会直接影响到MapReduce任务的执行速度。类似地,如果解压缩时间过长,也会影响数据访问速度,对实时处理和分析产生负面影响。因此,在选择压缩格式时,必须对压缩和解压缩的性能进行充分的测试,找到压缩比率和性能之间的最佳平衡点。

### 2.2 兼容性和稳定性

#### 2.2.1 兼容性对大数据处理的影响

兼容性决定了压缩数据能否在不同的系统和应用之间无缝流通。如果压缩数据只能在一个特定的环境中使用,那么它在大数据处理流程中的价值就会大打折扣。尤其在涉及多种技术栈的大型企业级应用中,兼容性成为不可忽视的因素。

#### 2.2.2 稳定性在生产环境中的作用

稳定性是指压缩格式在不同环境和压力下表现的一致性和可靠性。一个稳定的压缩格式能够确保在各种情况下都能提供一致的性能,这对于生产环境尤为重要。在生产环境中,数据的压缩和解压缩往往需要24/7无间断运行,任何压缩技术的不稳定都有可能导致严重的业务中断。

### 2.3 可扩展性和维护性

#### 2.3.1 压缩格式的可扩展性分析

可扩展性是指压缩技术适应不断增长的数据量和变化的数据类型的能力。在大数据时代,数据量呈现出爆炸性的增长,因此压缩格式的可扩展性变得尤为重要。如果一个压缩格式能够在大数据量下保持高效和稳定,那么它将更加适应未来的发展需求。

#### 2.3.2 维护压缩解决方案的策略

维护性关乎于压缩格式如何在实际应用中进行管理与升级。一个易于维护的压缩解决方案将大大减少IT部门的压力,尤其是在系统迁移、升级或者遇到问题需要快速响应的场景下。维护性好的压缩技术通常具有良好的文档支持、易于集成和更新的特点。

### 章节小结

在本章中,我们讨论了选择合适的压缩格式需要考虑的三个关键因素:压缩比率与性能、兼容性和稳定性、可扩展性和维护性。这些因素共同构成了一个全方位的评估框架,帮助数据工程师和技术决策者选择最适合自己业务需求的压缩技术。下节我们将深入解析MapReduce中最常见的几种压缩格式,以及它们在实际应用中的表现和优缺点。

# 3. 常见压缩格式深入解析

在第三章中,我们开始深入探讨几种在MapReduce环境中常见的压缩格式,并对它们的特性和使用方式进行详细解析。这些格式包括Gzip、Snappy和LZO,它们各自有独特的优点和应用场景。深入了解这些压缩格式将有助于我们更好地选择和实施适用于大数据处理的压缩技术。

## 3.1 Gzip压缩格式

### 3.1.1 Gzip的特点和使用场景

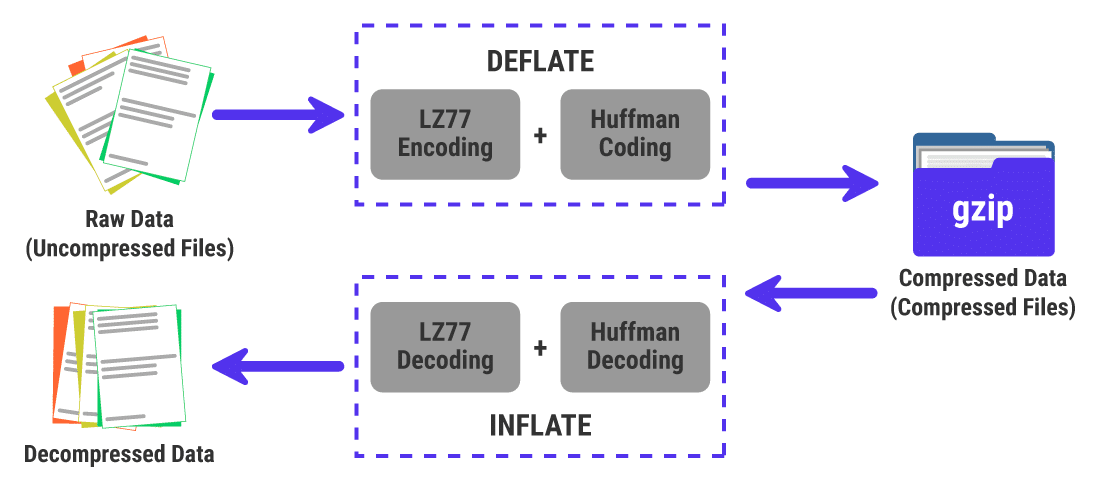

Gzip是一种广泛使用于网络传输中的压缩工具,它基于DEFLATE算法进行数据压缩。Gzip的特点包括良好的压缩比以及较高的压缩速度,这使得它成为Web服务器和客户端之间传输数据的首选压缩格式。由于其广泛的支持和高效性能,Gzip也常常被用于离线数据存储和传输过程中。

在MapReduce的使用场景中,Gzip可以作为一个非常有效的压缩选项,尤其当数据在传输过程中需要被高效压缩和快速解压缩时。同时,由于Gzip的文件格式被广泛支持,它也方便了在不同系统间共享数据。

### 3.1.2 Gzip在MapReduce中的实现

在MapReduce程序中使用Gzip进行压缩和解压缩,通常需要在任务执行阶段配置相应的压缩输出流。以Java为例,可以利用`GZIPOutputStream`类将MapReduce的输出结果进行压缩,并且在读取数据时使用`GZIPInputStream`进行解压。这一过程的代码示例如下:

```java

// 压缩输出

OutputStream gzos = new GZIPOutputStream(outputStream);

// 假设 writer 是输出数据的 Writer 对象

writer.writeTo(gzos);

// 解压缩输入

InputStream gis = new GZIPInputStream(inputStream);

```

在上述代码中,`outputStream`是MapReduce输出流的实例,而`inputStream`则是从HDFS读取的输入数据流。在配置MapReduce作业时,需要设置相应的输出格式为支持Gzip压缩的格式,例如设置`***press`为`true`,并且通过`***press.codec`指定使用`***press.GzipCodec`。

## 3.2 Snappy压缩格式

### 3.2.1 Snappy的性能优势

Snappy是一个由Google开发的压缩库,旨在提供高性能的压缩和解压缩速度。Snappy的压缩比可能不如Gzip等算法,但它的优势在于极快的处理速度,这使得它在需要高速读写的场合非常有用,如实时数据处理和大数据分析。

在MapReduce环境中,Snappy可以被用来处理那些对延迟要求非常严格的任务,如流式数据处理。Snappy的快速压缩和解压特性使得它成为优化MapReduce作业性能的有力工具。

### 3.2.2 Snappy在MapReduce中的应用

在MapReduce作业中,使用Snappy进行压缩和解压缩同样需要配置相应的编解码器。以Hadoop为例,可以通过设置作业的配置属性来指定Snappy编解码器:

```java

// 设置Snappy编解码器

jobConf.set("***press.codec", "***press.SnappyCodec");

```

在上面的代码片段中,我们通过`set`方法设置了MapReduce作业的输出压缩编解码器为Snappy。这样,当MapReduce作业输出数据时,会自动使用Snappy算法对数据进行压缩。

## 3.3 LZO压缩格式

### 3.3.1 LZO压缩与解压缩机制

LZO是一种无损压缩算法,特点是压缩速度快,解压缩速度更快,但压缩比相对较低。LZO能够提供比Snappy更高的压缩比,同时保持较快的压缩和解压速度。由于这些特性,LZO非常适合用于需要快速读写操作的环境,例如处理日志文件和大型数据集。

LZO的解压缩速度非常快,因为它的压缩算法旨在优化解压缩操作。在MapReduce任务中,使用LZO可以提高数据读写的速度,特别是在磁盘I/O成为瓶颈的情况下。

### 3.3.2 LZO在MapReduce中的集成与优化

要在MapReduce中使用LZO压缩,首先需要在Hadoop集群上安装和配置LZO相关的库和编解码器。这通常涉及在所有节点上安装liblzo库以及相应的Hadoop编解码器插件。一旦安装完成,可以通过配置Hadoop作业来指定使用LZO编解码器:

```java

// 设置LZO编解码器

jobConf.set("***press.codec", "***pression.lzo.LzopCodec");

```

通过设置上述属性,MapReduce作业的输出将使用LZO算法进行压缩。需要注意的是,虽然LZO在MapReduce中可以提供良好的性能,但使用它之前必须确保所有节点上都安装了正确的LZO支持库。

以下为本章节的表格和流程图示例:

| 压缩格式 | 压缩比率 | 压缩速度 | 解压速度 | 兼容性 |

|----------|----------|----------|----------|--------|

| Gzip | 高 | 中等 | 中等 | 高 |

| Sna

0

0