【作业调度的秘密】:MapReduce数据压缩的影响探讨

发布时间: 2024-10-27 08:24:55 订阅数: 7

# 1. MapReduce模型概述

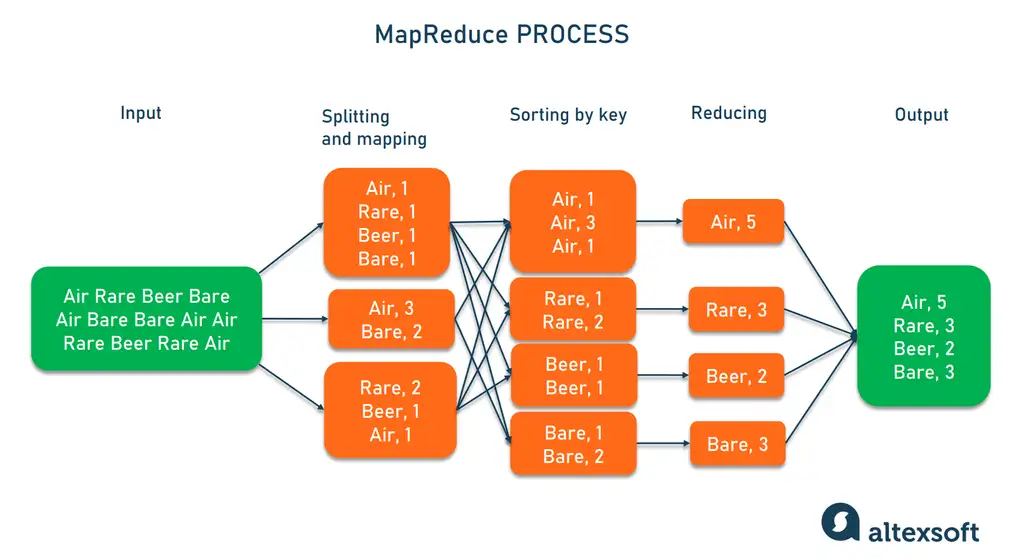

MapReduce 是一种编程模型,用于大规模数据集(大数据)的并行运算。该模型最早由Google提出,是Hadoop等大数据处理框架的核心组件。在MapReduce模型中,数据处理过程分为两个主要阶段:Map(映射)阶段和Reduce(归约)阶段。

## 1.1 模型的起源和定义

MapReduce的概念源于函数式编程中的Map和Reduce操作,它将数据处理流程划分为可分割的独立任务。Map阶段并行处理数据,生成一系列中间键值对(Key-Value pairs),而Reduce阶段则对这些中间结果进行汇总处理。

```python

# 一个简单的MapReduce伪代码示例

def map(document):

for word in document.split():

emit_intermediate(word, 1)

def reduce(word, values):

result = sum(values)

emit(word, result)

```

## 1.2 模型的核心组件

MapReduce模型包含以下几个核心组件:输入数据分割、Map函数、Shuffle机制、Reduce函数、输出数据。其中Shuffle是Map与Reduce之间的数据传输阶段,涉及到中间数据的排序和分组。

## 1.3 模型的性能考量

性能考量包括数据倾斜、任务调度、容错处理等。数据倾斜会导致某些任务需要处理的数据量远大于其他任务,影响整体运行效率。任务调度需要平衡负载,而容错处理则确保在节点失败的情况下,任务可以重新执行而不影响最终结果。

在下一章,我们将深入探讨数据压缩的理论基础,为理解MapReduce中的数据压缩实践打下坚实的理论基础。

# 2. 数据压缩的理论基础

## 2.1 数据压缩概念和必要性

### 2.1.1 数据冗余与压缩技术

数据冗余是数据压缩技术存在的前提。在信息论中,冗余信息指的是在数据中重复出现的部分,这些数据可以通过特定的算法进行缩减而不丢失原有信息的含义。数据冗余分为时间冗余、空间冗余、信息熵冗余以及结构冗余等类型。

例如,在文本文件中,相同的单词或短语可能会多次出现,这就是时间冗余。在图像文件中,相邻像素往往具有相近的色彩值,这是空间冗余的一种形式。数据压缩技术通过识别并利用这些冗余信息,减少了存储空间的需求和传输时间,提升了数据处理的效率。

### 2.1.2 压缩算法的基本原理

数据压缩算法通常分为无损压缩和有损压缩两大类。无损压缩在压缩和解压缩过程中保证数据的完整性,而有损压缩则允许在压缩过程中丢弃一部分数据,以达到更高的压缩率,但压缩后的数据与原始数据会有差异。

基本的压缩算法原理可以概括为以下几点:

1. **编码冗余**:通过替换原始数据中频繁出现的模式,使用更短的代码表示,例如霍夫曼编码。

2. **预测编码**:基于已知数据序列,预测后续数据值,并只记录预测误差。

3. **字典编码**:创建数据项的字典,用字典中的索引来替代原始数据。

4. **模型编码**:用数学模型来描述数据,并记录模型参数而不是数据本身。

## 2.2 常用数据压缩算法分析

### 2.2.1 字典编码类算法

字典编码类算法是通过构建数据项的字典来实现压缩的,其核心思想是用较短的字典索引替代较长的数据项。LZ77、LZ78和它们的变种如LZW是这一类算法的典型代表。

以LZW算法为例,它使用一个字典来存储每个可能的字符串序列及其对应的编码。在压缩过程中,每遇到一个字符串,就查找字典中是否存在该字符串的条目,如果存在,则输出该条目的编码;如果不存在,则输出当前字符的编码,并将该字符串添加到字典中。解压缩时,可以通过相同的字典重建原始数据。

### 2.2.2 统计编码类算法

统计编码类算法基于字符出现的频率进行编码,频率高的字符用较短的编码表示,频率低的字符用较长的编码表示。霍夫曼编码是最常见的统计编码算法。

霍夫曼编码首先统计各个字符出现的频率,然后构建一棵霍夫曼树,频率高的字符离根较近,因此具有较短的路径,频率低的字符离根较远,具有较长的路径。通过遍历这棵树,可以为每个字符生成唯一的编码。在压缩数据时,用生成的编码替换原始字符;在解压时,按照霍夫曼树重建字符。

### 2.2.3 基于模型的压缩算法

基于模型的压缩算法利用数学模型来描述数据的生成过程。这类算法包括算术编码和预测编码。

算术编码与霍夫曼编码类似,但不是将每个符号编码成一段二进制代码,而是将整个消息视为一个数,并用该数的一个区间来表示。这个区间在编码的每一步中不断缩小,最终的编码为这个区间的某个值。解码时,根据这个值反推回原始消息。

预测编码通常用于图像压缩,它利用图像像素的局部相关性,预测像素值,并只传输预测误差。这种算法的关键在于选择合适的预测模型来最小化误差。

## 2.3 MapReduce框架下的压缩策略

### 2.3.1 压缩对MapReduce性能的影响

在MapReduce框架下,数据压缩可以降低磁盘I/O和网络I/O的负载,从而提高MapReduce作业的性能。然而,压缩和解压缩过程会消耗一定的CPU资源,这可能成为性能瓶颈,特别是在集群资源有限的情况下。因此,选择合适的压缩策略和算法对于优化整体性能至关重要。

### 2.3.2 选择合适的压缩方法

选择压缩方法时需要综合考虑数据的类型、大小以及MapReduce作业的特性。例如,文本数据适合使用霍夫曼编码和LZ77算法,而二进制数据则可能更适用于算术编码。在MapReduce框架中,通常还会考虑压缩算法的并行处理能力和与MapReduce的集成程度。

为了优化性能,可以通过实验来确定最佳的压缩算法和参数设置。这通常涉及到在不同的压缩算法和参数组合下运行相同的MapReduce作业,并监控性能指标如CPU使用率、内存消耗、以及作业完成时间。通过比较不同设置下的性能,可以得出最优的压缩策略。

在下一章节中,我们将深入探讨数据压缩实践技巧,包括如何在MapReduce中应用和优化这些压缩策略。

# 3. 数据压缩实践技巧

在本章中,我们将深入探讨数据压缩在实际应用中的技巧,包括压缩工具和库的使用、参数调优以及压缩与安全性之间的关系。通过一系列的实践技巧,读者能够更好地在MapReduce环境下实现数据压缩。

## 3.1 压缩工具和库的使用

### 3.1.1 常用的开源压缩工具介绍

为了在MapReduce环境中有效地实现数据压缩,首先要熟悉一些常用的开源压缩工具。以下是一些流行的压缩工具及其特点:

- **Gzip**: 一种基于DEFLATE算法的广泛使用的文件压缩工具,支持文本和二进制文件的压缩。它在Linux系统中非常普及,并且易于集成到MapReduce程序中。

- **Bzip2**: 使用Burrows-Wheeler变换算法的压缩工具,通常提供比Gzip更好的压缩率,但以更高的CPU使用率为代价。

- **Snappy**: 由Google开发,旨在提供快速压缩和解压速度,优化用于实时数据压缩场景,如MapReduce作业处理。

### 3.1.2 在MapReduce中集成压缩库

0

0