【向量化操作】:Stat库提升Python统计计算性能的关键技术

发布时间: 2024-10-10 21:09:16 阅读量: 145 订阅数: 59

# 1. 向量化操作的概念与重要性

在现代数据科学和数值计算的实践中,向量化操作已成为一项核心技能。向量化是将操作应用于整个数组或向量而不使用显式的循环结构的过程。这不仅可以显著提高计算效率,而且还可以提高代码的简洁性和可读性。本章将深入探讨向量化操作的基本概念、核心原理以及它为什么在数据分析和科学计算中至关重要。

## 1.1 向量化操作的基本概念

向量化操作的本质是利用了现代处理器的SIMD(单指令多数据)能力,将操作应用于数组的每一个元素,从而避免了逐个处理元素的循环过程。例如,考虑两个长度相同的数组相加:

```python

import numpy as np

vector_a = np.array([1, 2, 3, 4])

vector_b = np.array([5, 6, 7, 8])

result = vector_a + vector_b

```

上述代码中的`vector_a + vector_b`操作实际上是一个向量化操作,它会在底层一次性完成整个数组的加法,而不是逐个元素加。

## 1.2 向量化的重要性

在数据分析和机器学习模型中,数据通常以向量或矩阵形式存在,进行向量化的操作能够带来巨大的性能优势。比如,在处理大型数据集时,使用向量化操作相比于传统的循环结构能够提升执行速度数倍甚至数十倍。这使得复杂的统计计算和数据转换任务变得更加高效。

向量化操作通过减少循环和分支跳转,减轻了CPU调度的负担,并减少了代码的执行时间。此外,利用现代CPU的缓存机制,向量化操作还可以减少内存的读写次数,优化数据的局部性。

在后续章节中,我们将详细介绍如何在实践中应用向量化操作,以及通过向量化提高程序性能的具体案例。

# 2. Stat库的基本原理和应用

Stat库是专为统计分析而设计的Python库,它在数据科学领域内扮演着重要角色。Stat库不仅提供了丰富的统计函数和方法,而且其背后所采用的向量化技术极大地提升了数据处理的效率。本章节将探讨Stat库中的向量化数据结构,它们如何在统计计算中发挥作用,以及Stat库的高级特性。

## 2.1 Stat库中的向量化数据结构

### 2.1.1 NumPy数组与向量化

NumPy是Stat库的核心依赖,它提供了一个强大的N维数组对象:ndarray。这使得向量化操作成为可能。与Python内置的list类型相比,ndarray在存储和处理数值数据方面更为高效。

```python

import numpy as np

# 创建一个简单的NumPy数组

a = np.array([1, 2, 3, 4, 5])

```

代码块展示了如何创建一个一维的NumPy数组。当对数组执行运算时,比如求和或乘法,NumPy会应用向量化操作,利用底层的C语言进行运算,从而比使用Python循环更快。

```python

# 使用NumPy进行向量化运算

b = a * 2

```

在上述代码中,NumPy自动应用了向量化,对数组中的每个元素都乘以2,而不是逐个迭代元素。

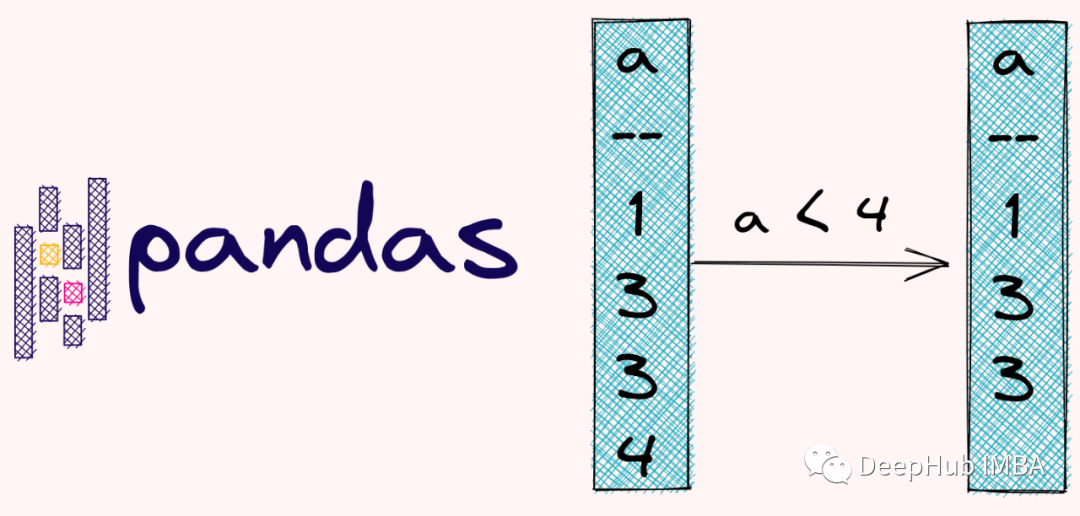

### 2.1.2 Pandas的Series和DataFrame

Pandas库是Stat库的另一个重要组件,它提供了Series和DataFrame两种数据结构。这些结构在处理表格数据时,能够实现向量化操作,提高了数据处理的速度和灵活性。

```python

import pandas as pd

# 创建一个简单的DataFrame

df = pd.DataFrame({

'A': [1, 2, 3, 4],

'B': [5, 6, 7, 8]

})

```

DataFrame允许对列或行应用向量化操作,例如,进行行的统计汇总。

```python

# 向量化地对DataFrame的列求和

df_sum = df.sum(axis=0)

```

在这个例子中,`axis=0`参数指示Pandas对列进行操作。向量化处理不仅加快了计算速度,还使代码更加简洁。

## 2.2 向量化在统计计算中的作用

### 2.2.1 向量化与循环性能对比

在统计计算中,对数据集进行循环操作是常见的任务。然而,传统的循环操作在Python中执行较慢,因为Python解释器在每次迭代时都需要对循环体进行解析。

```python

# 使用循环进行元素乘法

c_loop = []

for x in a:

c_loop.append(x * 2)

```

该代码中使用了传统的for循环对数组`a`中的每个元素乘以2,相比于NumPy的向量化操作,效率较低。

### 2.2.2 向量化在统计函数中的应用实例

向量化操作不仅限于简单的数学运算,还可以与Stat库中的统计函数结合使用,例如计算数据集的均值、中位数等。

```python

import stat

# 计算NumPy数组的均值和标准差

mean_value = np.mean(a)

std_deviation = np.std(a)

```

在这个实例中,`np.mean`和`np.std`函数均采用了向量化方式,直接对数组`a`中的所有元素进行计算,相比于手动实现的循环方式,这种方法更加高效。

## 2.3 Stat库的高级特性

### 2.3.1 数据处理的向量化操作

除了基本的统计计算,Stat库还提供了高级的数据处理功能,如数据选择、过滤和分组聚合等,这些都是建立在向量化基础上的。

```python

# 使用Stat库进行分组聚合

grouped_data = df.groupby('A').sum()

```

这段代码将DataFrame按列`A`的值进行分组,并计算每组的总和,使用了向量化技术。

### 2.3.2 内存管理与优化

在处理大规模数据时,内存管理是关键。Stat库利用了NumPy数组的内存布局优势,优化了内存使用,提高了数据处理的效率。

```python

# 使用Stat库对大型数据集进行内存优化

large_dataset = pd.read_csv('large_dataset.csv')

```

当处理大型数据集时,Pandas会尽可能高效地加载数据到内存中,并采取措施减少内存占用。

接下来,本章节将继续深入探讨Stat库的应用,展示如何在统计分析中利用其进行高效的数据处理和分析。

# 3. 实践案例分析:使用Stat库进行高效统计

## 3.1 数据清洗与预处理

数据清洗与预处理是任何数据分析任务的首要步骤,也是确保分析质量的关键环节。在此阶段,数据科学家往往需要从多种数据源中提取数据,进行转换和清洗,以便为进一步分析做好准备。在本节中,我们将探讨如何使用Stat库在数据清洗与预处理中实现高效工作。

### 3.1.1 缺失值的处理

在实际数据集中,缺失值是常见的问题之一。统计上,缺失值可以分为随机缺失和非随机缺失。处理缺失值的方法有很多,包括删除含有缺失值的记录、填充缺失值、以及使用模型预测缺失值等。

使用Stat库进行缺失值处理的代码示例如下:

```python

import pandas as pd

import numpy as np

# 创建一个示例DataFrame

df = pd.DataFrame({

'A': [1, 2, np.nan, 4],

'B': [np.nan, 2, 3, 4],

'C': [1, 2, 3, 4]

})

# 删除含有缺失值的记录

df_cleaned = df.dropna()

# 填充缺失值

df_filled = df.fillna(0)

# 使用中位数填充缺失值

df_median_filled = df.fillna(df.median())

```

分析这段代码时,我们首先创建了一个包含缺失值的DataFrame。然后,我们演示了三种不同的方法来处理这些缺失值。`dropna()` 函数用于删除含有缺失值的行,而 `fillna()` 函数提供了两种不同的填充策略:用常数填充和使用列的统计特性(如中位数)填充。

### 3.1.2 异常值的检测与处理

异常值检测是数据清洗过程中的另一个重要环节。异常值可能由多种原因造成,例如数据录入错误、测量误差或真实的异常事件。正确地识别和处理异常值,对于确保分析结果的准确性至关重要。

下面的代码展示了使用Stat库进行异常值处理的一个简单例子:

```python

# 假设df是已经清洗过的DataFrame

# 使用Z-score方法识别异常值

from scipy import stats

z_scores = np.abs(stats

```

0

0