【Python统计编程陷阱】:避开常见错误,确保分析正确无误

发布时间: 2024-10-10 20:22:18 阅读量: 117 订阅数: 54

# 1. Python统计编程基础与挑战

## 1.1 统计编程的基本概念

统计编程是运用计算机技术对数据进行收集、处理、分析和解释的过程。Python作为一门功能强大的编程语言,为统计分析提供了众多库和工具,如Pandas、NumPy、SciPy、Matplotlib等,这让数据处理和分析变得高效而直观。

## 1.2 Python在统计编程中的优势

Python在统计编程中的优势主要体现在其简洁的语法、强大的社区支持、丰富的第三方库以及跨平台兼容性。这使得Python成为数据科学和统计分析领域最受欢迎的语言之一。

## 1.3 面临的挑战与误区

虽然Python在统计编程领域具有诸多优势,但其灵活性也带来了不少挑战。新手开发者容易陷入语法陷阱、数据处理误区以及性能优化的误区。本章将概述这些常见问题,并在后续章节中详细介绍解决方法。

# 2. 数据处理中的常见陷阱

### 2.1 数据清洗的误操作

数据清洗是数据分析的重要前置步骤,错误的操作可能会导致后续分析产生偏差。本小节将探讨在数据清洗过程中容易出现的两个误区:缺失值处理和异常值识别与处理。

#### 2.1.1 缺失值处理的常见问题

在实际的数据集中,缺失值是普遍存在的问题,它可能是由于数据采集的错误、传输过程中的丢失或是其他原因造成的。处理缺失值有许多方法,但是错误的选择可能会掩盖重要信息或引入偏差。

**常见错误示例:**

- 盲目删除含有缺失值的记录

- 使用不当的插补方法(如用平均值填充,忽略变量的实际分布)

**具体操作步骤:**

1. 识别缺失数据:使用如Pandas库的`isnull()`函数。

2. 分析缺失数据的模式:用`isnull().sum()`来统计各个列的缺失值数量。

3. 决定处理策略:基于业务逻辑和数据特性,选择合适的处理方法,比如删除记录、填充固定值、使用中位数或众数填充等。

```python

import pandas as pd

# 示例数据集

df = pd.DataFrame({

'A': [1, 2, None, 4],

'B': [5, None, None, 8],

'C': [9, 10, 11, 12]

})

# 检测缺失值

missing_values = df.isnull().sum()

print(missing_values)

# 删除含有缺失值的行

df_dropped = df.dropna()

# 使用列的中位数填充缺失值

df_filled = df.fillna(df.median())

```

**参数说明和逻辑分析:**

- `isnull()`函数:用于检测DataFrame中缺失值的位置。

- `sum()`函数:计算每列缺失值的数量。

- `dropna()`函数:删除含有缺失值的行。

- `fillna()`函数:使用指定值或方法填充缺失值,`median()`为中位数。

正确处理缺失值需要深入理解数据特性和分析目标。过于简单的处理方法可能会导致数据的偏颇,影响分析的准确性。

#### 2.1.2 异常值识别与处理

异常值是与整体数据不一致的数据点,它可能是由于真实的异常情况产生的,也可能是由于数据错误引入的。正确识别和处理异常值对于确保后续分析的准确性和可靠性至关重要。

**常见错误示例:**

- 使用固定阈值简单地剔除异常值

- 不考虑异常值背后的实际原因,盲目地进行数据调整

**操作步骤和方法:**

1. 使用统计学方法(如Z分数、IQR)识别异常值。

2. 分析异常值的来源和特征。

3. 根据异常值的性质决定处理方法,比如保留、修正或剔除。

```python

# 假设df是处理完缺失值的数据集

# 使用Z分数识别异常值

from scipy import stats

import numpy as np

z_scores = np.abs(stats.zscore(df))

abs_z_scores = np.where(z_scores > 3)

# 使用四分位数范围(IQR)识别异常值

Q1 = df.quantile(0.25)

Q3 = df.quantile(0.75)

IQR = Q3 - Q1

lower_bound = Q1 - 1.5 * IQR

upper_bound = Q3 + 1.5 * IQR

# 打印出异常值

print(df[(df < lower_bound) | (df > upper_bound)])

```

**参数说明和逻辑分析:**

- `zscore()`函数:计算数据点与均值的偏差的Z分数。

- `quantile()`函数:计算数据的四分位数。

- `IQR`:四分位数范围,为第三四分位数和第一四分位数的差值。

- `1.5`是常用的IQR倍数,用于确定异常值的范围。

识别异常值后,需要进一步的逻辑验证,确认其为实际错误或特殊情况,并据此采取措施。比如,如果异常值是由于实际的异常情况产生的,可能需要保留;如果是数据错误,则应修正或剔除。

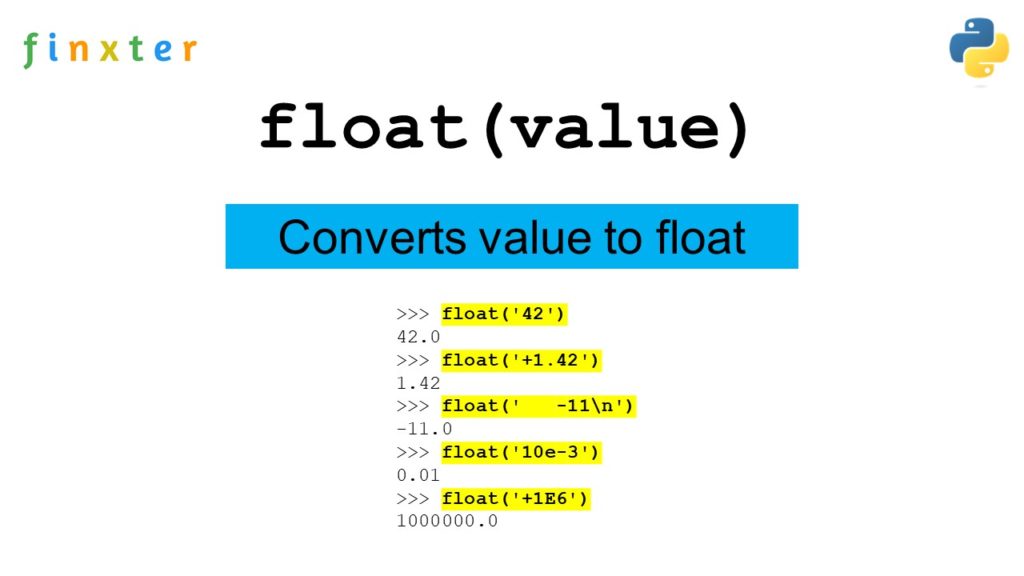

### 2.2 数据类型与转换误区

在数据处理过程中,数据类型转换是一个常见的任务,其不当操作可导致后续分析的失败。本小节将深入探讨对象类型隐式转换的后果和字符串与数值类型混淆的常见问题。

#### 2.2.1 对象类型隐式转换的后果

在Python中,数据类型转换分为显式和隐式两种。隐式转换通常发生在不同数据类型之间进行运算时,由解释器自动完成。若不理解这一机制,可能导致意外的错误。

**常见错误示例:**

- 在算术运算中不注意数据类型转换,导致运算结果错误。

- 将包含不同类型数据的列转换为同一种类型,未考虑数据的实际意义。

**具体操作和分析:**

1. 明确数据类型和需求:使用`type()`函数检查变量的数据类型。

2. 在进行运算前,显式转换数据类型。

3. 使用条件语句,根据数据的实际含义决定转换策略。

```python

# 示例数据集

df = pd.DataFrame({

'A': ['1', '2', '3'],

'B': [1, 2, 3]

})

# 隐式转换会导致A列被解释为字符串类型

df['A'] + df['B'] # 输出: 01 12 23

# 显式转换为整数类型后相加

df['A'] = df['A'].astype(int)

df['A'] + df['B'] # 输出: 1 4 6

```

**参数说明和逻辑分析:**

- `astype()`函数:显式地将数据转换为指定的类型。

在数据处理过程中,进行隐式转换可能会导致预期之外的结果。因此,理解数据类型转换的机制,以及如何通过显式转换来控制转换过程,是避免数据处理错误的关键。

#### 2.2.2 字符串与数值的混淆

在数据分析中,有时会遇到将字符串错误地作为数值来处理的情况,这会导致分析错误或产生无效的结果。在数据处理之前正确识别和转换数据类型是避免此类问题的关键。

**常见错误示例:**

- 在计算中将字符串误当为数值使用。

- 在需要数值计算时,字符串的格式干扰了运算。

**操作步骤和建议:**

1. 在数据读入时,确保数据类型正确。

2. 对于含有数值的字符串数据,使用`pd.to_numeric()`进行转换,设置`errors='coerce'`参数将无法转换的值转换为NaN。

```python

# 示例数据集

df = pd.DataFrame({

'A': ['1', '2', 'three'],

'B': [1, 2, 3]

})

# 尝试转换列为数值类型

df['A'] = pd.to_numeric(df['A'], errors='coerce')

# 查看转换结果,无法转换的值为NaN

print(df)

```

**参数说明和逻辑分析:**

- `to_numeric()`函数:将数据列转换为数值类型。如果遇到无法转换的值,则将这些值设置为NaN。

识别和处理字符串与数值的混淆是数据预处理的一个重要环节。在数据类型转换时要特别小心,防止数据类型错误导致的分析错误。通过显式数据类型转换和数据校验,可以避免此类错误发生。

### 2.3 索引与切片的复杂性

索引与切片是数据处理中的基本操作,但其复杂性不容忽视。本小节将分析负索引和范围边界的陷阱,以及多维数组操作中的常见问题。

#### 2.3.1 负索引和范围边界的陷阱

Python中的索引从0开始,而负索引用于从末尾向前引用。如果操作不当,可能带来难以发现的错误。

**常见错误示例:**

- 不正确地使用负索引,导致选择错误的数据项。

- 使用切片时,不注意范围的闭合性,引起数据选择的遗漏或重复。

**具体操作和分析:**

1. 了解Python切片语法:`[start:end:step]`,其中`start`为起始索引,`end`为结束索引,`step`为步长。

2. 使用负数索引时,特别注意其从末尾开始计数的特性。

3. 在切片操作中,包括起始索引而排除结束索引。为了防止遗漏,可使用`-1`作为结束索引来选择最后一个元素。

```python

```

0

0