【HDFS高可用性架构入门】:7个关键点带你快速理解HDFS HA

发布时间: 2024-10-29 02:30:31 阅读量: 114 订阅数: 26

【HDFS篇11】HA高可用1

# 1. HDFS高可用性架构简介

在现代分布式存储系统中,Hadoop分布式文件系统(HDFS)作为一个稳定的存储解决方案,支撑着海量数据的处理需求。然而,随着业务的发展和技术的进步,对于系统的高可用性(High Availability,简称HA)要求日益提高。本章将简要介绍HDFS高可用性架构的基本概念、发展历程及其在大数据生态中的重要性。

HDFS是Hadoop平台的核心组件之一,它被设计用来存储大量数据,并通过冗余存储来提高数据的可靠性。传统的HDFS架构在遇到NameNode故障时会导致整个系统不可用,这对业务连续性提出了巨大挑战。为了解决这一问题,社区开发了HDFS高可用性架构,确保了即使在关键组件发生故障时,也能保证系统的稳定运行和数据的持续可用性。

在本章中,我们将概览HDFS高可用性架构的设计目标和架构模式,并简要介绍其背后的原理。接下来的章节将深入探讨HDFS的基本组件、HA架构的工作原理以及在实际环境中的配置实践和应用优化策略。这将为读者提供一个系统性的理解HDFS高可用性架构的框架和进阶知识。

# 2. HDFS的基本概念和组件

### 2.1 HDFS的数据存储机制

#### 2.1.1 块存储的概念

Hadoop Distributed File System (HDFS) 是为存储大量数据而设计的分布式文件系统。它的设计基于一个简单的前提:数据存储在普通的硬件上,不可靠的硬件也可能发生故障。因此,HDFS 将大型文件分割成固定大小的块,这些块默认大小为 128MB,然后将这些块存储在多个物理机器上。

块的概念对于提高数据的可靠性至关重要。每个块都会在多个DataNode上保留多个副本(默认为三个副本)。这样即使一个或多个节点发生故障,数据也不会丢失。这一机制保证了即使在面对节点故障时,数据读取的可用性和可靠性也能得到保障。

#### 2.1.2 NameNode和DataNode的角色

在HDFS中,数据存储的管理是由两个主要的组件来完成的,它们是NameNode和DataNode。

- **NameNode**:它是HDFS集群的主节点,负责管理文件系统的命名空间。NameNode维护文件系统树及整个HDFS集群中的所有文件和目录。它记录每一个文件中各个块所在的DataNode节点,并不存储实际的数据。

- **DataNode**:这些是工作节点,它们在集群中的每个节点上运行。DataNode负责存储和检索块数据,根据客户端或者NameNode的指令对块进行创建、删除和复制等操作。

### 2.2 HDFS的关键组件

#### 2.2.1 NameNode的作用和分类

在HDFS中,NameNode有两个主要的类型,即Standby NameNode和Active NameNode。在高可用(HA)配置中,这两个NameNode可以互换角色。Standby NameNode作为Active NameNode的热备份,它会在主节点出现故障时接管系统。这种设置保证了NameNode的故障不会导致整个集群不可用。

- **Active NameNode**:负责处理客户端的读写请求,管理文件系统的命名空间,并且维护文件系统树及文件/块映射。

- **Standby NameNode**:它维护与Active NameNode相同的状态信息。如果Active NameNode出现故障,它会立即启动故障转移过程,接管服务。

#### 2.2.2 DataNode的管理机制

DataNode负责实际数据的存储,它直接与文件系统的物理存储介质打交道。当NameNode请求存储数据时,DataNode负责实际地在磁盘上写入数据块。

DataNode之间并不直接通信,它们全部通过与NameNode通信来同步数据块信息。NameNode在启动时会从各个DataNode获取它们所存储的数据块的信息,以构建整个文件系统的状态。

### 2.3 HDFS的版本控制和元数据管理

#### 2.3.1 一次写入多次读取的特性

HDFS支持一次写入多次读取模型,意味着文件一旦创建、写入后就不可以更改。这一特性简化了数据一致性的问题,并且适合于大数据分析的场景,在这些场景中,文件经常是批处理方式写入一次,然后被多个分析作业多次读取。

#### 2.3.2 元数据的持久化和一致性

元数据在HDFS中是极其重要的。元数据包含了文件系统树、文件到块的映射表、每个块所在的DataNode等信息。为了保证元数据的一致性和持久性,NameNode使用编辑日志(Edit Log)和文件系统镜像(FsImage)来记录文件系统的变更。

- **编辑日志**:记录了自上次 FsImage 以来所有对文件系统做出的更改,例如创建文件、重命名文件、删除文件等。

- **文件系统镜像**:一个文件系统在某一时刻的完整快照。

在启动时,NameNode会加载FsImage并应用编辑日志中的操作,以重建文件系统的最新状态。因此,保持编辑日志和FsImage的一致性对整个文件系统的稳定运行至关重要。

```mermaid

graph LR

A[启动NameNode] --> B[加载FsImage]

B --> C[应用编辑日志]

C --> D[进入正常运行模式]

```

通过上述机制,HDFS实现了即使在分布式环境中也能够维护数据的一致性和可靠性。这使得HDFS非常适合处理大规模数据集,同时也能够保证数据的高可用性。

在此基础上,我们可以进一步深入了解HDFS HA的架构原理以及如何配置和实践HDFS HA,以确保Hadoop集群在面对单点故障时的稳定运行。

# 3. HDFS高可用性架构原理

## 3.1 高可用性的必要性

在现代的分布式系统中,数据的可用性是系统设计中极其重要的一部分。随着数据量的增加,对系统的可靠性提出了更高的要求。对于Hadoop分布式文件系统(HDFS)这样的存储解决方案而言,保证数据的高可用性尤为重要。

### 3.1.1 单点故障的影响

单点故障(Single Point of Failure, SPOF)是指系统的某一部分一旦出现问题,就会导致整个系统的失效。在HDFS的早期版本中,由于只有一个NameNode负责管理文件系统的命名空间和客户端对文件的访问,这就成为了一个明显的单点故障。如果NameNode发生故障,整个HDFS集群将无法访问。

### 3.1.2 高可用性的定义和目标

高可用性(High Availability, HA)意味着系统可以持续提供服务,即使在部分组件出现故障的情况下也能保持运行。HDFS高可用性架构的目标是通过消除单点故障,提供一个稳定的数据存储环境。这要求系统能够在不中断服务的情况下自动检测并恢复节点故障,以实现99.9%的服务水平协议(SLA)。

## 3.2 HDFS HA的两种实现模式

HDFS提供了两种不同的高可用性实现模式:基于联邦的HDFS HA和基于Quorum的HDFS HA。每种模式都有其特定的应用场景和优势。

### 3.2.1 基于联邦的HDFS HA

联邦(Federation)是HDFS中引入的一种HA架构,它允许多个NameNode共享同一个HDFS集群。在联邦模式下,每个NameNode管理自己的命名空间,客户端可以直接与任何活跃的NameNode通信。当一个NameNode发生故障时,其他的NameNode可以接替其工作,保证集群的高可用性。

### 3.2.2 基于Quorum的HDFS HA

基于Quorum的HDFS HA模式通过使用一组辅助节点(JournalNodes)和两个活跃的NameNode来实现。每个NameNode都有自己的命名空间镜像。当一个NameNode需要更新状态时,它将这些更新写入多数JournalNodes。另一个NameNode读取这些更新并应用到自己的命名空间。这种模式允许快速故障转移,因为它不需要复制完整的命名空间。

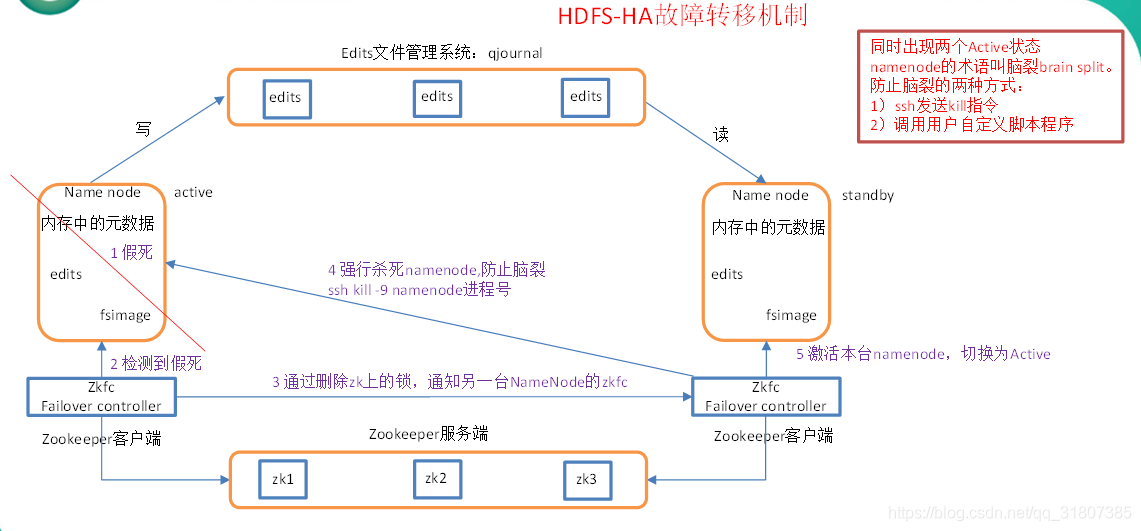

## 3.3 HDFS HA的故障切换机制

HDFS HA集群需要具备自动故障检测和恢复的能力,以保证服务的连续性。这包括两个主要方面:自动故障检测和NameNode故障转移的策略。

### 3.3.1 自动故障检测和恢复过程

自动故障检测是通过健康检查机制实现的。每个NameNode都会定期向其他节点发送心跳信号,表明它还活着。如果没有心跳信号或者心跳信号丢失,集群会认为该节点已经失效。

### 3.3.2 NameNode故障转移的策略

故障转移策略是通过一个称为“Active-Standby”模型实现的。在任何时候,只有一个NameNode处于活跃状态,另一个处于备用状态。当活跃的NameNode失败时,备用的NameNode会自动接管其角色。故障转移可以通过手动命令触发,也可以完全自动进行。

为了更好的理解故障转移机制,我们可以通过以下的mermaid流程图描述故障转移的过程:

```mermaid

graph LR

A[检测到活跃NameNode故障] --> B[备用NameNode准备接管]

B --> C[选举新的活跃NameNode]

C --> D[新的活跃NameNode接管命名空间]

D --> E[数据服务继续]

```

以上流程图展示了在活跃NameNode发生故障时,备用NameNode接管整个系统的步骤,保证了HDFS集群的连续可用性。故障转移后,集群能够继续对外提供服务,对于客户端来说几乎是透明的。

本章详细介绍了HDFS高可用性的必要性,探讨了HDFS HA的两种实现模式,并解析了HDFS HA的故障切换机制。在理解了原理之后,接下来章节将详细介绍如何配置和实践HDFS HA集群,以实现高可用性架构的落地。

# 4. HDFS高可用性架构配置实践

在本章中,我们将深入探讨Hadoop分布式文件系统(HDFS)高可用性(HA)架构的配置实践。首先,我们会为搭建HDFS HA环境做好准备,然后详细阐述配置集群和关键组件的步骤。最后,我们会介绍如何验证和监控HDFS HA集群以确保其健康和性能。

## 4.1 HDFS HA的环境准备

在开始配置HDFS HA之前,我们必须确保硬件和软件环境符合要求,并对网络进行适当配置。

### 4.1.1 硬件和软件要求

对于HDFS HA集群的硬件,建议至少两个节点用于NameNode角色,以及多个节点用于DataNode角色。每个节点都应该有适当的CPU、内存和存储资源,以支持大数据处理。此外,所有节点之间应保持高速网络连接。

在软件方面,需要安装Java环境,Hadoop二进制文件,并确保所有节点上的Hadoop配置文件(如`core-site.xml`、`hdfs-site.xml`)是一致的。同时,还需要安装和配置ZooKeeper,它是HDFS HA的重要组件之一。

### 4.1.2 网络配置和安全设置

网络配置包括静态IP地址的分配、主机名的解析以及防火墙的开放端口。每个节点的`/etc/hosts`文件应该包含集群中所有节点的IP和主机名映射。

安全设置通常涉及到Kerberos认证的配置,这确保了集群中的通信安全。Hadoop集群中的每个服务(如NameNode、DataNode、ZooKeeper等)都需要进行Kerberos认证配置。

## 4.2 配置HDFS HA集群

接下来我们将详细探讨如何配置HDFS HA集群,包括NameNode和ZooKeeper的高可用性设置。

### 4.2.1 配置NameNode高可用

HDFS HA的关键在于配置两个NameNode:一个处于活动状态(Active),另一个处于待命状态(Standby)。这些状态通过一个称为“故障转移控制器”的组件来管理。配置步骤如下:

1. 在`hdfs-site.xml`中设置`dfs.ha.namenodes`参数,定义活动和待命NameNode的名称。

2. 配置与NameNode对应的端口,如`dfs.namenode.http-address`和`dfs.namenode.https-address`。

3. 配置ZooKeeper以管理状态信息,通过`dfs.ha.zookeeper.quorum`参数指定ZooKeeper集群的服务器列表。

4. 配置故障转移控制器,如`dfs.ha.fencing.methods`,它定义了将处于待命状态的NameNode隔离的机制。

### 4.2.2 配置ZooKeeper集群和HAJournalNodes

ZooKeeper集群是HDFS HA架构的核心组件,它负责维护元数据状态的一致性。以下是配置ZooKeeper集群的步骤:

1. 在所有参与ZooKeeper集群的节点上,解压并配置ZooKeeper的`zoo.cfg`文件,设置服务器列表和数据目录。

2. 初始化ZooKeeper集群,并启动ZooKeeper服务。

3. 配置HAJournalNodes,这些是用于保持NameNode元数据同步的日志节点。通常会配置奇数个(至少三个)JournalNodes以保证仲裁机制。

## 4.3 验证和监控HDFS HA集群

完成配置后,我们需要验证集群的状态和性能,以确保HDFS HA集群的健康和正常工作。

### 4.3.1 检查集群状态和健康状况

可以通过以下步骤检查集群状态:

1. 使用`hdfs haadmin`命令检查NameNode的活动状态。

2. 使用`hdfs dfsadmin`命令来获取文件系统的健康状况报告。

3. 确认所有DataNode节点都已注册到NameNode,并且状态为活跃。

### 4.3.2 监控工具和日志分析

使用以下工具和方法可以监控HDFS HA集群:

1. 使用`hdfs dfsadmin -report`命令获取集群报告。

2. 使用Web界面监控NameNode和DataNode的健康状态。

3. 分析Hadoop和ZooKeeper的日志文件,以便及时发现并解决问题。

通过以上实践,我们可以确保HDFS HA集群能够持续稳定地运行,从而提供可靠的高可用性数据存储解决方案。在下一章中,我们将进一步探讨HDFS HA集群的高级应用,包括性能优化、扩展性和维护以及故障排除和案例分析。

# 5. HDFS高可用性架构的高级应用

在Hadoop分布式文件系统(HDFS)中,高可用性(High Availability, HA)架构是确保数据可靠性和服务持续性的关键。随着大数据应用的不断扩展,HA集群不仅需要稳定的运行,还需要经过优化的性能以及易于扩展和维护的特性。在本章中,我们将深入探讨HDFS HA集群的性能优化、扩展性和维护策略,以及故障排除和案例分析。

## 5.1 HDFS HA集群的性能优化

为了保持HDFS HA集群的高效运行,关键在于优化网络和磁盘I/O,以及合理地进行资源调度和负载均衡。

### 5.1.1 网络和磁盘I/O优化

网络和磁盘I/O是影响HDFS HA集群性能的主要因素之一。以下是优化建议:

- **网络优化**:通过使用高速网络设备和高性能网络协议(如RDMA)来降低网络延迟,确保数据传输的高速率。同时,网络隔离可以防止不同类型的流量相互干扰,提高服务的稳定性。

- **磁盘I/O优化**:选择高性能的磁盘(如SSD)可以显著提高数据读写速度。在配置上,可以使用RAID技术来增加数据冗余和提高读写性能。合理设置I/O调度器,如使用NOOP或CFQ,可以提高I/O效率。

### 5.1.2 资源调度和负载均衡

HDFS HA集群中的资源调度和负载均衡可以通过以下策略进行优化:

- **资源调度器**:在YARN中使用合适的资源调度器,如Capacity Scheduler或Fair Scheduler,可以有效管理资源分配,优化作业调度。

- **负载均衡**:HDFS自带的负载均衡器可以在后台运行,自动调整数据块的分布,保证各DataNode之间负载均衡。

## 5.2 HDFS HA集群的扩展性和维护

HDFS HA集群的可扩展性和易维护性对于长期运行和快速响应业务变化至关重要。

### 5.2.1 添加和移除节点的策略

在集群扩展和维护的过程中,有效地添加和移除节点是必要的操作:

- **添加节点**:通过预先配置好的脚本和工具,如Ambari或Cloudera Manager,可以自动完成新节点的加入过程,包括安装必要的软件、配置网络、并加入集群。

- **移除节点**:当需要移除某个节点时,首先应将该节点上的数据块迁移到其他节点,再安全地关闭服务,并从集群中移除该节点。

### 5.2.2 软件升级和回滚机制

软件升级是集群维护的常见任务,而回滚机制提供了升级失败时的安全保障:

- **软件升级**:采用滚动升级策略,逐个或分批次升级集群中的节点,避免服务中断。

- **回滚机制**:在升级过程中保存旧版本的软件和配置信息,以便在升级失败时快速恢复到升级前的状态。

## 5.3 HDFS HA集群的故障排除和案例分析

在实际操作过程中,不可避免地会遇到各种问题。快速有效地诊断和解决问题对于减少停机时间至关重要。

### 5.3.1 常见问题诊断和解决

HDFS HA集群运行过程中可能出现的问题及其解决方法包括:

- **NameNode故障**:通过检查日志文件来诊断问题。常见原因包括内存不足、磁盘故障或配置错误。解决方案包括增加内存、替换磁盘或调整配置。

- **数据块丢失**:可以通过HDFS的`fsck`工具检查和修复丢失的数据块。

### 5.3.2 实际案例分析与总结

案例研究可以为我们提供具体的故障处理经验和教训。例如,一个典型的案例是网络分区导致的脑裂(split-brain)问题。通过分析故障发生的原因、过程及采取的应对措施,我们能总结出预防和解决类似问题的策略。

在本章中,我们详细讨论了HDFS HA集群的性能优化、扩展性和维护策略,以及故障排除和案例分析。通过这些高级应用的深入探索,运维人员可以更加有效地管理和维护HDFS HA集群,确保数据的高可用性和业务的连续性。

0

0