【HDFS联邦与HA的整合】:如何应对联邦架构下的高可用性挑战

发布时间: 2024-10-29 02:50:36 阅读量: 3 订阅数: 7

# 1. HDFS联邦与高可用性(HA)的概念解析

Hadoop分布式文件系统(HDFS)作为大数据存储和处理框架的核心组件,其高可用性和扩展性一直是关注的焦点。HDFS联邦架构作为一种新兴的扩展技术,旨在解决传统HDFS在可扩展性和管理上的挑战。在本章中,我们将深入探讨HDFS联邦的概念,以及它是如何与高可用性(HA)协同工作的。我们将从基础概念出发,逐步揭示HDFS联邦架构和HA的深层原理,为理解后续章节中HDFS联邦的优势与挑战打下坚实的基础。

## 1.1 HDFS联邦的概念

HDFS联邦允许在多个命名空间之间实现横向扩展,提供比传统HDFS更强的可伸缩性和集群管理能力。联邦架构让系统能够跨越多个独立命名空间,实现资源的更优化配置。

## 1.2 高可用性(HA)的基础

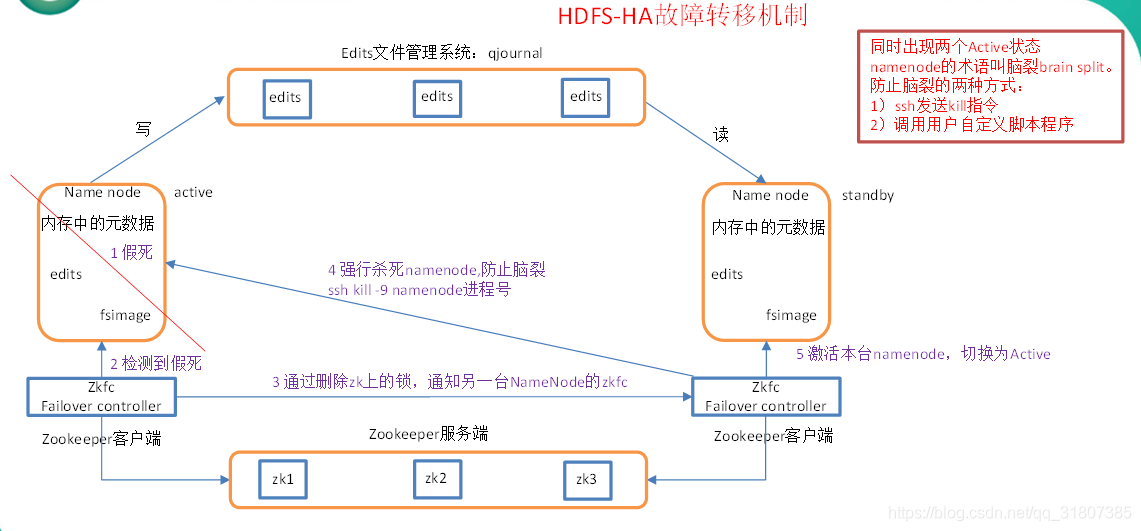

高可用性是指系统在指定时间内无故障运行的能力。HDFS HA通过提供主备NameNode机制,增强了系统的稳定性和容错能力,保证了在发生故障时能够迅速切换到备用节点,最小化了服务中断时间。

## 1.3 联邦架构与HA的结合

在HDFS联邦架构中,HA技术是必不可少的组件。它确保了即使在联邦环境中,各命名空间也能维持高可用性。这种结合为大规模存储环境提供了一个可靠和弹性的解决方案。

# 2. 联邦架构下的HDFS原理与优势

### 2.1 HDFS联邦架构概述

#### 2.1.1 联邦架构的引入背景

在大数据时代背景下,数据的爆炸式增长给分布式存储系统带来了巨大的挑战。传统的HDFS架构虽然能够处理大规模数据集,但其扩展性和高可用性存在局限。引入联邦架构的目的在于优化资源利用,提高系统的可扩展性和容错性。通过联邦架构,HDFS能够在多个命名空间之间进行分布式管理,使得数据存储和管理更加灵活高效。

#### 2.1.2 核心组件与工作原理

联邦HDFS架构的核心在于引入了联邦命名空间和区域服务器的概念。每个区域服务器负责管理特定的数据块,而联邦命名空间则是一个统一的视图,将这些不同区域的数据组织起来。通过这种设计,联邦HDFS能够实现跨区域的数据冗余复制,同时支持并行读写,大大提高了数据处理的吞吐量和系统的整体性能。

### 2.2 联邦HDFS的关键特性

#### 2.2.1 命名空间的分离与扩展

联邦HDFS通过将命名空间与数据块物理分离,实现了命名空间的水平扩展。这意味着可以在不增加单个命名空间负载的情况下,增加更多的命名空间来提升系统的整体处理能力。这种分离机制还允许独立地扩展命名空间和数据块存储,为未来的系统升级和维护提供了便利。

#### 2.2.2 增强的数据保护与恢复机制

联邦HDFS的数据保护策略包括了跨区域的数据复制、快照管理以及基于文件的备份和恢复机制。这些机制确保了数据的高可用性和持久性,即使在发生硬件故障或数据丢失的情况下,也能够迅速恢复数据,从而最大限度地降低系统故障对业务的影响。

### 2.3 联邦架构对高可用性的影响

#### 2.3.1 HA在联邦架构中的作用

高可用性(HA)是联邦HDFS架构中不可或缺的一部分。通过在联邦架构中引入HA机制,可以确保即使在单个区域服务器发生故障时,系统也能够继续运行,不会影响到整体服务的可用性。HA架构通过主备切换和故障转移等机制,保障了服务的连续性和数据的完整性。

#### 2.3.2 高可用性的需求与挑战

在联邦HDFS中实现高可用性,需要考虑到系统的复杂性和组件之间的依赖关系。特别是在多命名空间的环境中,数据的一致性和同步成为了一个挑战。此外,如何在保持高可用性的同时,实现资源的高效利用,也是设计联邦HDFS HA架构时需要重点考虑的问题。这要求在系统设计上需要精心规划和持续优化,以确保HA策略能够应对各种可能出现的故障场景。

随着HDFS联邦架构的持续发展,这些挑战正逐渐被克服,而HDFS联邦与高可用性(HA)的结合,正在成为大数据存储领域的一个重要趋势。

# 3. 实现联邦HDFS高可用性的策略

## 3.1 高可用性技术原理

### 3.1.1 HA技术的理论基础

高可用性(High Availability, HA)是任何分布式系统设计的核心目标之一,它指的是系统能够在规定时间内提供服务的能力。在联邦HDFS中,HA技术确保即使在个别组件发生故障的情况下,整个系统仍然可以继续运行,并对用户提供服务。

实现HA的关键在于冗余与自动故障切换。联邦HDFS通过在不同节点上复制数据和运行多个服务实例,即使其中一个实例或节点出现故障,其他实例或节点也能接管其功能,从而实现服务的无缝切换。

### 3.1.2 主备切换与故障转移机制

主备切换是HA策略中的一个关键技术点。在联邦HDFS的场景中,主备切换通常涉及到NameNode的角色切换。一个活跃的NameNode作为主节点处理所有客户端的请求,而一个或多个备用NameNode保持同步状态,随时准备接替活跃节点的角色。

故障转移机制是指在检测到主节点发生故障时,能够自动或手动地将某个备用节点提升为新的主节点的过程。在这个过程中,新的主节点会接管所有的服务,并尽可能地保持客户端的会话状态,减少对业务的影响。

## 3.2 HDFS联邦与传统HA的对比

### 3.2.1 传统HA架构的局限性

传统的HDFS HA通过维护一对NameNode(一个活跃,一个备用)来确保高可用性。然而,这种架构有一些局限性,特别是在扩展性和灵活性方面。

当数据量和集群规模增长时,NameNode的内存需求也随之增长,成为系统的瓶颈。此外,传统HA架构中,命名空间的扩展需要停机操作,这对于需要持续运行的服务来说是不可接受的。

### 3.2.2 联邦HDFS HA的优势分析

联邦HDFS通过引入多个独立的NameNode来解决上述问题,每个NameNode管理集群中的一个子集命名空间,从而有效地分散了系统的负载。

联邦HDFS的HA策略不仅继承了传统HA的优势,还增加了命名空间的可扩展性和容错性。在联邦架构中,一个NameNode发生故障时,不会影响其他NameNode的正常运行,数据服务依然可以保持高可用性。此外,由于联邦HDFS的

0

0