【参数调优实战】:Hadoop CombineFileInputFormat参数调优实践详解

发布时间: 2024-10-27 19:22:49 阅读量: 18 订阅数: 18

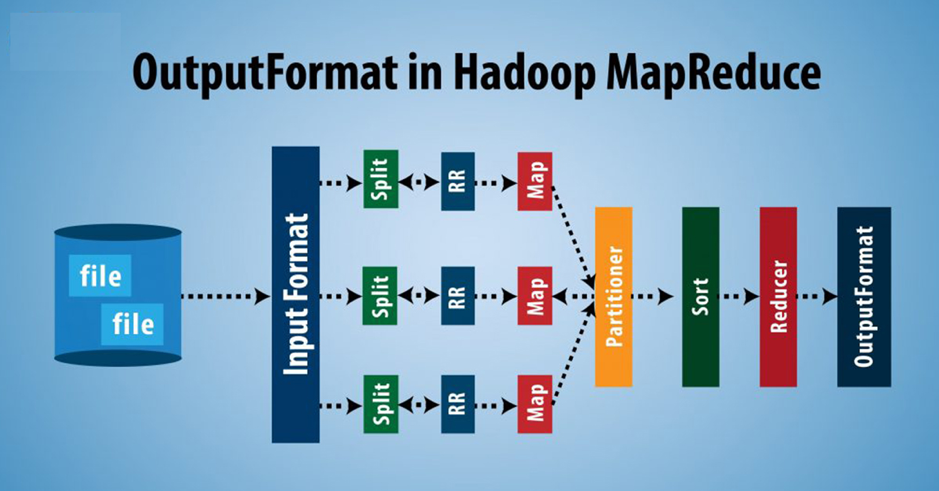

# 1. Hadoop CombineFileInputFormat简介

Hadoop作为大数据处理领域的基石,一直致力于提高数据处理的效率和优化资源利用。在众多优化方案中,`CombineFileInputFormat`扮演了重要角色。在Hadoop 2.x版本中,它作为`InputFormat`的一个子类被引入,用于优化大规模数据集的Map操作,特别是当数据存储在HDFS(Hadoop Distributed File System)的多个小文件中时。

传统的`FileInputFormat`对每一个文件都生成一个`InputSplit`,导致Map任务数量激增,从而增加了NameNode的压力并降低了处理速度。`CombineFileInputFormat`通过将多个文件的`InputSplit`合并为一个,有效减少了Map任务的数量,降低了网络I/O和磁盘I/O的开销,从而提高了处理效率。这一特性在处理跨多个存储设备分布的小文件时尤为有效。

然而,为了充分利用`CombineFileInputFormat`的优势,我们需要深入理解其工作原理,并掌握相关的参数调优技巧。下一章节将对它的工作原理进行详细解析,并探讨如何在不同存储类型下进行参数调整和优化,以达到最佳性能。

# 2. CombineFileInputFormat的工作原理

### 2.1 输入数据的分割机制

#### 2.1.1 数据切片与InputSplit

在Hadoop中,数据处理开始于对数据的切片,这是将文件系统中的数据块转换成InputSplit的过程。InputSplit是MapReduce框架中一个作业单元,定义了Map任务所处理的数据范围。在Hadoop的原生InputFormat中,数据切片通常考虑到了HDFS的块大小(默认128MB),从而尽可能地将切片划分在块边界上。

当使用CombineFileInputFormat时,这个过程变得略有不同,因为CombineFileInputFormat不仅仅考虑单个文件块的大小,它还考虑到了多个文件和多个块的组合,以提高Map任务的局部性,降低网络传输开销。通过这种方式,CombineFileInputFormat可以在保证数据局部性的前提下,合并多个小文件到一个InputSplit中。

```java

// 示例代码,展示InputSplit的创建过程

// 伪代码,仅用于说明概念

Configuration conf = new Configuration();

CombineFileInputFormat format = new CombineFileInputFormat();

format.setMinInputSplitSize(minSize);

format.setMaxInputSplitSize(maxSize);

Job job = Job.getInstance(conf);

job.setInputFormatClass(CombineFileInputFormat.class);

// 使用InputSplit进行Map任务处理

for (InputSplit split : job.getSplits()) {

// 处理每个split

}

```

上述伪代码展示了如何设置CombineFileInputFormat并获取InputSplit,但没有展示具体的切片逻辑。实际上,该过程涉及到复杂的文件布局分析和决策,这些逻辑是在Hadoop核心组件中实现的。

#### 2.1.2 CombineFileInputFormat的切片策略

CombineFileInputFormat提供了一种高级的切片策略,它能够更智能地处理数据。它不是简单地将数据切分成若干个InputSplit,而是会尝试将多个小文件或者分布在不同节点上的文件块合并成一个InputSplit,前提是这些文件或块都在一个HDFS的Block范围内。

在处理大规模数据时,小文件的存在会大大降低Hadoop集群的效率,因为每个小文件都需要一个单独的Map任务。而CombineFileInputFormat可以将这些小文件整合起来,减少Map任务的数量,从而提高整体的处理速度。

```java

// 示例代码,展示如何使用CombineFileInputFormat的切片策略

// 配置CombineFileInputFormat的切片大小

Configuration conf = new Configuration();

CombineFileInputFormat format = new CombineFileInputFormat();

format.setMinInputSplitSize(minSize);

format.setMaxInputSplitSize(maxSize);

Job job = Job.getInstance(conf);

job.setInputFormatClass(CombineFileInputFormat.class);

```

在上面的代码中,`minSize`和`maxSize`参数限制了每个切片的最小和最大尺寸,这允许用户根据具体需求调整切片策略。而实际的切片逻辑由CombineFileInputFormat内部实现,它会根据数据的存储位置、大小和文件类型等多种因素综合判断如何切分。

### 2.2 任务调度与数据本地性

#### 2.2.1 Map任务的调度过程

Map任务的调度是一个复杂的过程,它涉及到如何将任务分配给具体的节点。在Hadoop中,数据本地性是任务调度的一个重要原则。理想情况下,Map任务应该在数据所在的节点上执行,以避免数据在网络中的传输,从而减少I/O开销和提高效率。

CombineFileInputFormat通过合并多个小文件到一个InputSplit中,有助于提高数据本地性,因为它可以将原本需要在网络中传输的数据纳入到本地节点的处理过程中。此外,它还通过减少总的InputSplit数量,减少了Map任务的总体数量,从而减轻了NameNode的调度压力。

```java

// 示例代码,展示Map任务调度的处理逻辑

// 伪代码,仅用于说明概念

for (InputSplit split : job.getSplits()) {

TaskAttemptContext context = new TaskAttemptContext(conf, split);

MapRunnable mapRunnable = new MapRunnable(context);

// 调度逻辑

scheduleTask(mapRunnable);

}

```

上述代码展示了Map任务调度的抽象逻辑,实际上,调度任务通常由Hadoop的资源管理器(例如YARN)负责,而Map任务的本地性优化是由Hadoop内部机制自动处理的。

#### 2.2.2 数据本地性原则与优化

数据本地性原则指的是优

0

0