挖掘健康大数据:Hadoop在医疗行业的创新应用

发布时间: 2024-10-25 16:03:03 阅读量: 4 订阅数: 9

# 1. Hadoop技术框架概述

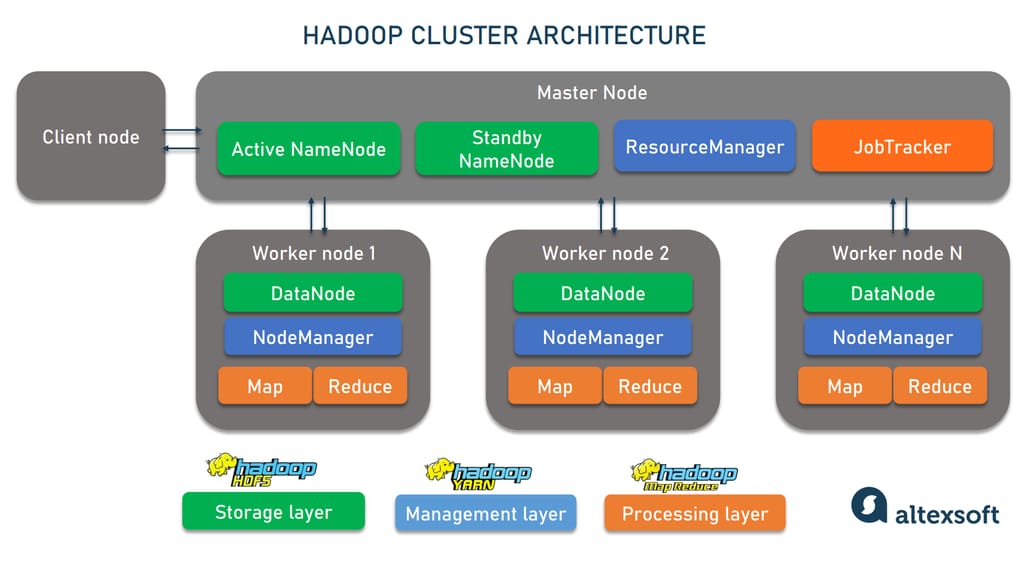

Hadoop是一个由Apache基金会开发的开源框架,它允许使用简单的编程模型跨计算机集群分布式处理大量数据。Hadoop以其高可靠性、高效性和可伸缩性闻名,成为了大数据领域的一个基石。它包括了存储系统HDFS(Hadoop Distributed File System)用于存储数据,以及MapReduce编程模型用于处理数据。

## 1.1 Hadoop的核心组件

Hadoop的核心组件主要包括HDFS和MapReduce,HDFS用于存储大数据集,并提供了高吞吐量的访问模式。MapReduce是一种编程模型和处理大数据集的相关实现,允许开发者编写代码以处理大规模数据集的并行运算。

```java

// MapReduce的一个简单示例代码

public class WordCount {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

```

从上述代码中,我们可以看到如何设置一个基本的Word Count任务,Hadoop通过Map和Reduce两个阶段处理数据,最终得到每个单词出现的次数。

## 1.2 Hadoop的应用场景

Hadoop广泛应用于需要处理大量数据的各种场景,如互联网搜索引擎、日志分析、推荐系统、社交网络分析等。它为企业提供了一个可靠、可扩展的平台,用以存储和分析在传统关系数据库中难以管理的大数据集。

通过上述对Hadoop技术框架的概述,我们可以初步了解其作为一种存储和处理大数据的技术,是如何在各种行业中发挥作用的,其中医疗行业也不例外。下一章节将深入探讨Hadoop在医疗数据存储中的应用。

# 2. Hadoop在医疗数据存储中的应用

Hadoop的分布式存储框架HDFS(Hadoop Distributed File System)提供了高吞吐量的数据访问,非常适用于医疗行业的大规模数据存储需求。医疗数据存储不仅要考虑数据的可扩展性,还要保证数据的安全性、隐私保护和可靠性。Hadoop通过其核心组件、数据块副本策略、与医疗数据格式的兼容性,以及优化策略,为医疗数据存储提供了强大支持。

## 2.1 Hadoop的基础存储机制

### 2.1.1 HDFS的基本原理和组件

HDFS的基本原理是将大文件分割成固定大小的数据块,然后将这些数据块存储在集群的多个节点上。这样,即使单个节点发生故障,数据也不会丢失,因为数据块会被复制到其他节点上。HDFS的核心组件包括:

- NameNode:负责管理文件系统的命名空间,记录每个文件中各个块所在的DataNode信息,但不存储实际的数据。

- DataNode:在集群的每个节点上运行,负责存储和检索块数据。

- Secondary NameNode:辅助NameNode进行管理工作,例如定期合并编辑日志和文件系统镜像。

### 2.1.2 数据块和副本策略

数据块是HDFS存储的基本单位,通常默认大小为128MB或256MB。医疗数据由于其敏感性,对数据的可靠性要求极高。Hadoop的副本策略保证了数据的高可用性。默认情况下,每个数据块会有三个副本,分别存储在不同的DataNode节点上,包括一个主副本和两个备份副本。这个策略可以通过修改配置文件来调整,以满足不同的性能和可靠性需求。

## 2.2 Hadoop与医疗数据格式兼容性

### 2.2.1 医疗数据的种类与格式

医疗数据是多元化的,包括结构化数据(如患者基本信息、诊疗记录、实验室检查结果)和非结构化数据(如医学影像、临床报告)。不同类型的医疗数据有不同的存储和处理需求。Hadoop能够存储和处理这些不同格式的数据,因为其生态系统中包含了多种工具来支持不同类型数据的处理。

### 2.2.2 Hadoop生态系统中的数据集成方法

Hadoop生态系统中的数据集成方法包括:

- Sqoop:用于高效地将结构化数据导入到Hadoop的HDFS中,也可以将数据导出到关系数据库中。

- Flume:适合于非结构化数据的高效收集,如日志文件。

- Kafka:用于构建实时数据处理管道和流式应用。

通过这些工具,Hadoop能够处理医疗行业中的各种数据类型,为临床研究和患者护理提供实时的数据支持。

## 2.3 Hadoop在大规模医疗数据存储中的优化

### 2.3.1 性能优化策略

Hadoop集群性能优化包括:

- 调整数据块大小:根据医疗数据的特点调整数据块的大小,可以提高存储和检索的效率。

- 调整副本数量:为提高数据的可靠性和容错能力,可以适当增加副本数量,但同时也要考虑到存储空间的利用率。

- 合理配置YARN资源管理器:通过YARN(Yet Another Resource Negotiator)合理分配计算资源,以支持并行处理和任务调度。

### 2.3.2 安全性和隐私保护措施

由于医疗数据的敏感性,Hadoop在存储医疗数据时必须采取严格的安全措施。这包括:

- Kerberos认证:用于集群内部节点间的认证,保证通信安全。

- 加密技术:对存储在HDFS上的数据进行加密,以防止未授权访问。

- 数据访问控制:利用Hadoop的权限管理机制,如Apache Ranger或Apache Sentry,来严格控制数据访问。

通过这些优化和安全措施,Hadoop能够为医疗数据存储提供一个既可靠又安全的环境。

0

0