Hadoop故障排查实战技巧:快速解决常见问题

发布时间: 2024-10-25 15:36:34 阅读量: 38 订阅数: 29

# 1. Hadoop故障排查概述

## 简介

Hadoop作为一个分布式系统,拥有高容错性、高可靠性和大规模数据存储处理能力,但同时它也存在故障风险。有效地进行故障排查对于确保数据完整性、系统稳定性和服务高可用性至关重要。本文旨在通过一系列深入浅出的章节,提供从监控到故障排查,再到性能优化和安全故障防范的全面指导。

## 故障排查的重要性

故障排查不仅是解决问题的技术过程,更是优化系统性能、提升运营效率、减少业务损失的关键步骤。Hadoop的故障排查需要了解其架构、组件和数据流,以便准确地定位问题所在并实施解决方案。

## 故障排查的基本步骤

在开始排查Hadoop故障前,系统管理员和开发者应遵循以下基本步骤:

1. 确定问题症状和影响范围,例如是集群整体不可用还是某个特定组件报错。

2. 收集并检查相关日志文件,以获取故障发生前后的系统活动记录。

3. 分析配置文件和系统资源使用情况,确认是否有异常参数设置或资源瓶颈。

4. 实施故障隔离和快速恢复策略,减少对整个系统的影响。

5. 针对排查结果,采取措施修复或优化系统。

通过以上步骤,Hadoop的故障排查将变得更加有序、高效,并且可以快速恢复到正常工作状态。接下来的章节将详细探讨集群监控、数据存储、MapReduce与YARN故障处理、配置与性能优化,以及安全故障排查与防范。

# 2. Hadoop集群的监控与健康检查

### 2.1 集群监控基础

#### 2.1.1 监控工具的选择与配置

在Hadoop环境中,选择正确的监控工具对于及时发现问题并维护集群健康至关重要。常用的Hadoop集群监控工具有Ganglia、Nagios、Ambari和Cloudera Manager等。这些工具可以提供实时数据可视化和报警功能,帮助管理员快速定位问题所在。

以Ambari为例,它是Hortonworks开发的一个开源集群监控工具,可以非常方便地与Hadoop生态系统中的组件集成。部署Ambari通常涉及以下步骤:

1. 安装Java环境。

2. 下载Ambari安装包,并设置合适的环境变量。

3. 运行Ambari安装脚本进行安装。

安装完成后,需要进行相应的配置。关键配置项包括集群主机列表、管理用户认证信息以及与Hadoop组件服务的集成配置。

```shell

# 安装Java环境(以Ubuntu为例)

sudo apt-get update

sudo apt-get install openjdk-8-jdk

# 下载并安装Ambari

wget ***

* 配置Ambari

vim /etc/ambari-server/conf/ambari.properties

# 修改相应的配置项,如数据库配置、管理员用户等

```

#### 2.1.2 关键指标的跟踪与日志分析

监控工具通常会提供各种关键指标的追踪和日志分析功能。例如,CPU、内存、磁盘I/O、网络带宽等资源使用情况,以及Hadoop集群内部组件的状态和性能指标。要确保对这些指标进行持续的跟踪,并定期分析日志文件以识别潜在问题。

对于日志文件的分析,可以使用如ELK(Elasticsearch, Logstash, Kibana)堆栈工具。Logstash可以用来收集和解析日志数据,Elasticsearch负责存储和索引数据,而Kibana则提供了一个界面来进行数据的可视化和分析。

以下是使用Logstash对Hadoop日志文件进行解析的一个简单示例配置文件:

```conf

input {

file {

path => "/path/to/hadoop/logs/*.log"

start_position => "beginning"

}

}

filter {

grok {

match => { "message" => "%{TIMESTAMP_ISO8601:timestamp}\s+%{WORD:log_level}\s+(?<log_message>.*)" }

}

}

output {

elasticsearch {

hosts => ["localhost:9200"]

}

}

```

### 2.2 集群的健康状态评估

#### 2.2.1 系统资源的使用情况

集群的健康评估首先涉及检查系统资源的使用情况。对于CPU和内存使用,可以使用Linux内置的`top`或`htop`命令来获取实时信息。对于磁盘I/O,可以使用`iostat`命令来监控。网络健康状态可以通过`ping`命令或者`netstat`来检查网络连接和带宽使用情况。

例如,使用`iostat`来监控磁盘I/O状态:

```shell

iostat -dx 2

```

#### 2.2.2 Hadoop组件运行状态检查

Hadoop集群内的各种组件(如NameNode、DataNode、ResourceManager等)的状态检查是健康评估的重要部分。可以通过访问这些组件的Web UI界面进行直观检查,也可以通过JMX(Java Management Extensions)接口获取运行时的详细性能指标。

访问JMX的常用方法是使用`jvisualvm`工具,它可以连接到远程JVM并提供丰富的性能分析功能。对于命令行方式,可以使用`jstat`工具或`jmap`命令。

```shell

jstat -gc <pid> 1000 10

```

#### 2.2.3 网络与硬件故障排查

网络和硬件故障排查是确保集群稳定运行的关键。网络故障可以通过测试网络延迟和丢包情况来诊断,比如使用`traceroute`或`mtr`命令来检测网络路径上的问题。

硬件故障排查通常需要使用特定的硬件诊断工具,比如使用`smartctl`来检查磁盘的SMART数据,分析磁盘健康状态。

```shell

smartctl -a /dev/sda

```

### 2.3 小结

在本章节中,我们介绍了Hadoop集群监控与健康检查的基本概念和方法。从监控工具的选择与配置开始,到对系统资源使用情况的跟踪,再到对Hadoop组件运行状态的检查,以及网络与硬件故障排查,每一步都是确保Hadoop集群稳定运行的重要环节。通过对监控工具的正确部署和配置,可以实现对集群状态的实时监控和管理,为集群的健康运行提供保障。在下一章,我们将深入探讨Hadoop数据存储故障的分析与解决策略。

# 3. Hadoop数据存储故障分析与解决

Hadoop数据存储层是整个大数据平台的核心,其中HDFS(Hadoop Distributed File System)作为其默认的存储解决方案,承担着数据的持久化存储任务。在庞大的数据量和高并发场景下,HDFS可能会遇到各种各样的故障问题,这些问题往往对数据的完整性和系统的稳定性造成影响。本章节将聚焦于HDFS数据不一致和磁盘故障两大问题,并探讨如何进行分析与解决。

## 3.1 HDFS数据不一致问题

HDFS通过NameNode和DataNode的协同工作,保证了数据的高可用性。然而,在实际的运维过程中,由于硬件故障、网络问题等多种因素,数据不一致问题仍然可能发生。数据不一致问题不仅影响数据的可靠性,还可能导致计算任务的失败。

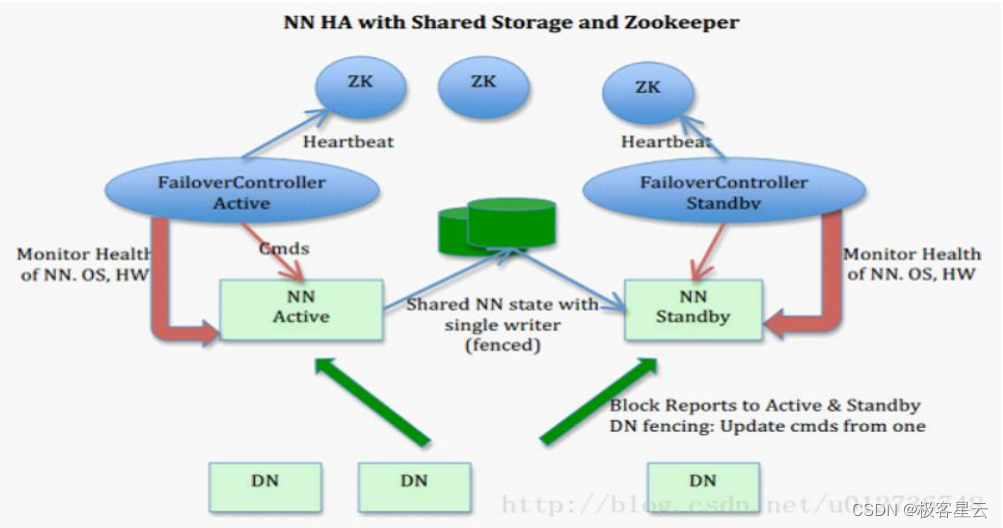

### 3.1.1 NameNode与DataNode数据同步机制

HDFS的数据同步依赖于NameNode和DataNode之间的心跳和数据块报告机制。DataNode会定期向NameNode发送心跳信息,并报告自己所持有的数据块信息。NameNode在收到心跳后,会通过这些报告来验证数据块的完整性,并及时发现不一致的数据块。

```mermaid

sequenceDiagram

participant DN

participant NN

DN->>NN: 心跳信息 & 数据块报告

alt 数据一致性检查

NN->>DN: 发送数据块检查命令

DN->>NN: 数据块校验结果

else 数据不一致

NN->>DN: 数据修复指令

DN

```

0

0