数据预处理高手:为R语言randomForest模型准备最佳数据集

发布时间: 2024-11-02 02:04:24 阅读量: 28 订阅数: 23

# 1. 数据预处理概览

数据预处理是数据挖掘和机器学习中至关重要的一步,其目的是将原始数据转换为更适合模型处理的形式。良好的数据预处理可以显著提升模型性能和结果的准确性。本章将为读者提供一个关于数据预处理的基础概念框架,为后续章节详细介绍各类预处理技术作铺垫。

## 数据预处理的重要性

在数据分析的生命周期中,预处理阶段往往占据了大部分时间。这是因为数据通常包含噪声、不一致性或不完整性。数据预处理的目标是通过清洗、整合和转换原始数据来解决这些问题,确保后续分析的准确性和可靠性。

## 数据预处理流程

数据预处理一般包括以下几个步骤:

1. 数据收集:从不同来源整合数据。

2. 数据清洗:处理缺失值、异常值和重复记录。

3. 数据转换:将数据转换为适合分析的形式,例如规范化、归一化或编码。

4. 数据规约:简化数据集规模,同时保持数据的完整性。

5. 数据离散化:将数值特征转换为分类特征,便于模型理解。

接下来的章节将详细探讨数据清洗技巧与实践、特征选择与构造、数据集划分与交叉验证等关键环节,以及如何使用R语言高效实施这些预处理步骤。

# 2. 理解randomForest模型及其数据要求

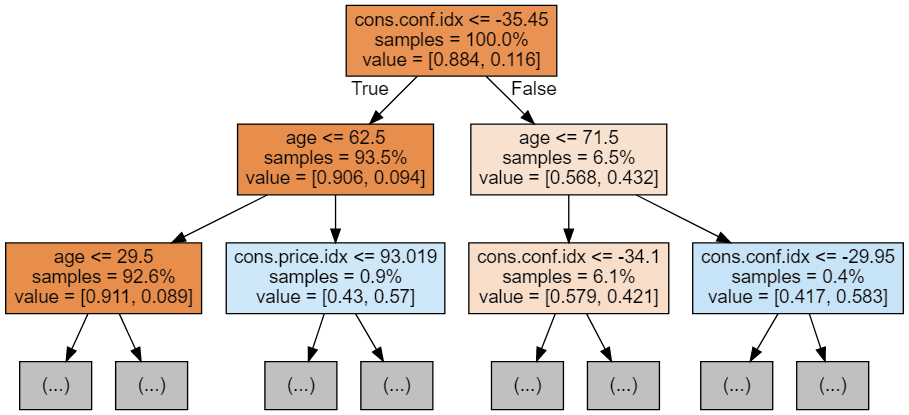

randomForest是一种集成学习算法,它通过构建多个决策树并将它们的预测结果综合起来,以提高整体模型的准确性和泛化能力。每个决策树在构建时都会从原始数据集中随机选择一部分样本和特征,这种随机性是randomForest名称的由来。randomForest模型因其高效性和鲁棒性被广泛应用于各种机器学习任务,包括分类和回归问题。

### randomForest模型的核心概念

在深入了解randomForest模型的数据要求之前,先让我们看一下randomForest模型的核心概念。randomForest算法的关键特点包括:

- **集成学习**: Random forest的核心思想是通过构建多个决策树,并将它们的预测结果综合起来,以提升模型的准确度和稳定性。

- **特征子集**: 在每次分裂决策树的一个节点时,randomForest并不会考虑所有的特征,而是从全部特征中随机选取一定数量的特征作为候选,从而降低模型之间的相关性,提高模型整体的预测性能。

- **树的独立性**: 每棵树在构建时都是独立的,它们从原始数据集中随机抽取的样本和特征进行训练。

- **投票机制**: 在进行分类任务时,randomForest通过多数投票的方式,由树们“投票”决定最终的分类结果;而在回归任务中,则通过平均预测值来得到最终结果。

### randomForest的数据要求

为了有效地构建和使用randomForest模型,数据集需要满足以下要求:

#### 数据量的要求

- **足够的样本数**: Random forest模型需要足够的训练样本以确保每棵树都能学到数据的分布特点,减少过拟合的风险。一般而言,对于足够多的特征,每棵树至少需要数千个样本。

- **特征数量**: Random forest能够很好地处理大量的特征,但也并非越多越好。过多的无关特征会增加模型训练的时间,同时降低模型的泛化能力。

#### 数据质量的要求

- **特征的多样性**: 特征间应该具有一定程度的差异性,这样可以帮助模型捕捉到数据的不同方面。

- **特征的重要性**: 理解特征的重要性是数据预处理中非常重要的一步。在randomForest中,特征重要性评估是内置的功能,可以帮助识别对预测结果影响最大的特征。

#### 特殊数据类型的处理

- **数值型数据**: Random forest对数值型数据有很好的处理能力,无需特殊处理即可直接应用于模型训练。

- **类别型数据**: 类别型数据需要转换为数值型数据,一般采用独热编码(one-hot encoding)或是标签编码(label encoding)的方式。

下面的表格提供了对这些数据要求的总结:

| 数据要求分类 | 具体要求 | 重要性说明 |

|--------------|----------|-------------|

| 数据量 | 足够的样本数 | 避免过拟合,确保每棵树学到的数据分布 |

| 数据量 | 特征数量适宜 | 过多无关特征会增加训练时间并降低泛化能力 |

| 数据质量 | 特征多样性 | 帮助模型学习数据不同方面的特征 |

| 数据质量 | 特征重要性 | 识别和保留对预测结果影响大的特征 |

| 类型转换 | 类别型数据处理 | 转换为数值型数据以适应randomForest模型 |

#### 代码示例:使用randomForest模型

下面提供了一个使用R语言中的`randomForest`包的代码示例,该代码展示了如何准备数据,训练模型,并评估模型的性能。

```R

# 加载所需的库

library(randomForest)

# 假设已经有了一个数据框df,其中包含了特征和标签

# 确保标签是因子型数据

df$label <- as.factor(df$label)

# 划分数据集为训练集和测试集

set.seed(123) # 设置随机种子以获得可复现的结果

trainIndex <- createDataPartition(df$label, p=0.8, list=FALSE)

trainSet <- df[trainIndex, ]

testSet <- df[-trainIndex, ]

# 训练randomForest模型

rfModel <- randomForest(label ~ ., data=trainSet, ntree=500)

# 查看模型性能

rfModel

# 预测测试集

predictions <- predict(rfModel, testSet)

# 使用混淆矩阵评估模型准确率

confusionMatrix(predictions, testSet$label)

```

在上面的代码中,我们首先加载了`randomForest`包。然后,确保标签是因子型数据,这是因为randomForest要求标签数据必须是因子型(分类变量)。接着,我们划分了训练集和测试集,并使用训练集数据训练了randomForest模型。最后,我们用测试集数据评估模型的性能。

在训练模型时,`ntree=500`参数指定了我们希望构建的决策树数量。这是一个超参数,可以根据需要进行调整,以找到最佳的模型性能。

通过上面的代码,我们可以看出randomForest在训练过程中的高效性,并且通过评估结果,我们可以了解模型在训练集和测试集上的准确率,帮助我们调整模型参数。

这个代码段落展示了如何在R语言中实现randomForest模型,对数据进行准备,训练模型,并对结果进行基本的性能评估。在实际应用中,我们还需要对数据进行更详细的预处理步骤,比如特征选择、缺失值处理和数据标准化,以得到更好的模型性能。

# 3. 数据清洗技巧与实践

数据清洗是数据科学工作中不可或缺的一环,它对保证数据质量以及后续模型预测的准确性有着至关重要的作用。本章节将深入探讨数据清洗过程中的技巧与实践,其中包括缺失值处理、异常值检测与处理、数据变换与标准化等关键步骤。

## 3.1 缺失值处理

### 3.1.1 识别缺失数据

在数据集中,缺失值是常见的问题之一。缺失值可能因为数据收集的不完整、数据传输中的错误或数据录入的遗漏等原因产生。识别缺失值是处理它们的第一步。在R语言中,可以使用`is.na()`函数来检查数据集中的缺失值,返回一个逻辑矩阵,表示数据集中每个元素是否是NA。

```r

# 创建数据框示例

data <- data.frame(

Name = c("Alice", "Bob", "Charlie", "David"),

Age = c(25, NA, 35, 28),

Height = c(165, 170, NA, 175)

)

# 识别数据框中的缺失值

missing_values <- is.na(data)

print(missing_values)

```

### 3.1.2 缺失值的填充策略

一旦识别出数据中的缺失值,下一步就是决定如何处理这些缺失值。常见的策略包括删除含有缺失值的行或列、用均值、中位数或众数填充,或者使用更高级的插补方法。

```r

# 删除含有缺失值的行

data_no_na <- na.omit(data)

# 用列均值填充缺失值

for (col in names(data)) {

data[is.na(data[[col]]), c

```

0

0