性能提升秘方:R语言randomForest模型预测速度优化策略

发布时间: 2024-11-02 01:38:58 阅读量: 24 订阅数: 35

# 1. randomForest模型的基础理论

在数据科学和机器学习领域,决策树是一种流行的算法,因其解释性强和易于实现而受到青睐。然而,单个决策树往往容易过拟合,并且对数据集中的小变化比较敏感。随机森林(randomForest)作为一种集成学习方法,通过构建多个决策树来克服这些问题,并且显著提升了模型的预测性能和稳定性。

randomForest模型的核心思想是通过创建许多独立的决策树,并将它们的预测结果进行汇总,以得到一个更加鲁棒的预测结果。每棵树都是在一个随机抽取的训练子集上训练的,并且在选择最佳分割点时,考虑的候选特征也是随机选取的,这样不仅能够提高模型的准确性,还能减少模型的方差。

在本章中,我们将深入探讨randomForest模型的基本概念、构建原理以及它如何在不同问题中应用。我们将从理论角度分析其工作机制,为后续章节中在R语言环境下的具体实操打下坚实的基础。

# 2. R语言randomForest模型的构建与调试

## 2.1 randomForest模型参数的理解和设置

### 2.1.1 参数的作用和影响

在`randomForest`模型中,正确的参数设置对于构建一个有效且高效的学习模型至关重要。下面是几个关键参数的作用和影响:

- `ntree`:决定森林中树木的数量。一般来说,树的数量越多,模型的预测能力越强,但计算时间也会增加。增加`ntree`直到模型的错误率趋于稳定是常见的做法。

- `mtry`:决定在每次分裂时考虑的特征数。对于分类问题,`mtry`通常取`sqrt(p)`,`p`是特征数量;对于回归问题,则取`p/3`。合理设置`mtry`有助于在减少过拟合和增加模型预测力之间找到平衡。

- `nodesize`:控制叶节点中最小的案例数。较小的`nodesize`可能有助于捕捉数据中的复杂模式,但也可能增加过拟合的风险。

通过理解这些参数,我们可以更好地控制`randomForest`模型的构建过程,以达到预期的性能和效果。

### 2.1.2 如何选择和调整参数

选择和调整参数是模型构建过程中的一个迭代过程,涉及以下步骤:

1. 初始参数设置:根据经验法则设定初始参数值。例如,`mtry`大约等于`sqrt(p)`,`ntree`可以设置为500或1000。

2. 模型训练:使用初始参数训练模型,并通过交叉验证评估模型性能。

3. 参数调整:基于模型性能结果,递增或递减参数值,并重新训练模型。对于`mtry`,可以在初始值的附近上下浮动;对于`ntree`,通常增加以寻找错误率的稳定点。

4. 性能比较:比较不同参数设置下的模型性能,选择表现最好的参数组合。

通过这一系列的调试和优化,可以得到一个在特定数据集上具有良好预测性能的`randomForest`模型。

## 2.2 randomForest模型的构建过程

### 2.2.1 数据的预处理和模型训练

在构建`randomForest`模型之前,数据预处理工作是非常关键的一步,它包括:

- 处理缺失值:可以使用插补方法,如均值、中位数或众数来处理缺失值。

- 特征选择:识别和选择对于模型预测最有效的特征。

- 数据规范化:进行标准化或归一化处理,使数据落入统一的量程。

数据预处理完成后,可以使用R语言的`randomForest`包构建模型。下面是一个简单的示例代码:

```r

library(randomForest)

# 假设df为已经预处理好的数据框

# target为标签列的名称

rf_model <- randomForest(target ~ ., data=df, ntree=500, mtry=3)

print(rf_model)

```

在这个例子中,`randomForest`函数接受一个公式,它指定了预测变量和响应变量。`ntree`和`mtry`参数可以根据需要进行调整。

### 2.2.2 模型的验证和评估

模型训练完成后,需要进行验证和评估以确保模型的泛化能力。常用的评估方法包括:

- 划分数据集:将数据集分为训练集和测试集,用训练集来训练模型,用测试集来评估模型的性能。

- 交叉验证:使用交叉验证来评估模型的稳定性和预测能力。`randomForest`提供了内置的交叉验证函数。

```r

set.seed(123) # 确保结果可重复

cv_results <- rfcv(df, target, cv.fold=5) # 5折交叉验证

plot(rfcv)

```

通过以上步骤,可以得到模型在不同参数下的预测误差,进而选择最佳的模型。

## 2.3 randomForest模型的调试技巧

### 2.3.1 常见问题及解决方法

在使用`randomForest`模型时可能会遇到一些常见的问题:

- **过拟合**:模型在训练集上的表现很好,但在测试集上表现差。解决方法是减少模型复杂度,如减少`ntree`的数量,调整`mtry`参数等。

- **内存消耗过大**:`randomForest`可能会消耗较多的内存资源,尤其是在`ntree`和`mtry`较大时。可以通过减少树的数量或使用并行计算等方法来缓解这一问题。

- **运行时间过长**:当处理大规模数据集时,模型训练可能会耗费很长时间。可以通过并行计算和优化数据结构来加速模型训练。

### 2.3.2 模型优化策略

为了提高`randomForest`模型的性能,以下是一些优化策略:

- **特征重要性评估**:通过`randomForest`的内置函数可以评估每个特征对模型预测的重要性,有助于进一步的特征选择和降维。

```r

importance(rf_model)

```

- **特征工程**:基于特征重要性评估结果,进行特征转换、组合或选择,以增强模型的预测能力。

- **模型集成**:结合多个`randomForest`模型的预测结果来提高整体预测的准确度和鲁棒性。

通过这些策略,可以有效地提高模型的性能并解决在模型构建和调试过程中遇到的问题。

# 3. R语言randomForest模型的预测速度优化

在机器学习项目中,模型的预测速度对于实时系统或者需要快速响应的场合至关重要。randomForest模型虽然提供了极佳的预测准确率,但其预测速度有时会成为实际应用的瓶颈。本章将探讨影响randomForest模型预测速度的因素,并提供一系列优化策略以提升模型的运行效率。

## 3.1 randomForest模型预测速度的影响因素

### 3.1.1 数据规模的影响

在随机森林算法中,构建大量的决策树是提升模型精度的关键。然而,这同样也意味着需要更多的计算资源和时间来处理数据和生成预测。随着训练数据量的增加,模型构建所需的时间会呈平方级增长,而预测阶段的时间增长则相对较小,但仍然显著。

#### 表格展示数据规模与预测速度的关系

| 数据规模(样本数) | 模型构建时间 (秒) | 预测时间 (毫秒) |

|---------------------|---------------------|------------------|

| 1000 | 0.5 | 2 |

| 10000 | 5 | 10 |

| 100000 | 50 | 100 |

| 1000000 | 500 | 1000 |

从上表中可以看到,随着数据规模的增加,模型构建和预测所需时间都显著增长。在实际应用中,需要根据项目需求和可接受的时间延迟来决定合适的数据规模。

### 3.1.2 参数设置的影响

randomForest模型中有多个参数可以调整,不同的参数设置会对模型的预测速度和准确性产生重要影响。例如,`ntree`参数控制着森林中树的数量,更多的树意味着更高的预测准确度,同时也意味着更长的预测时间。`mtry`参数决定着在构建每棵决策树时,每次分裂尝试的特征数量,较小的`mtry`值可以减少构建每棵树所需时间,但可能会降低模型整体的准确性。

## 3.2 randomForest模型预测速度的优化方法

### 3.2.1 数据处理优化

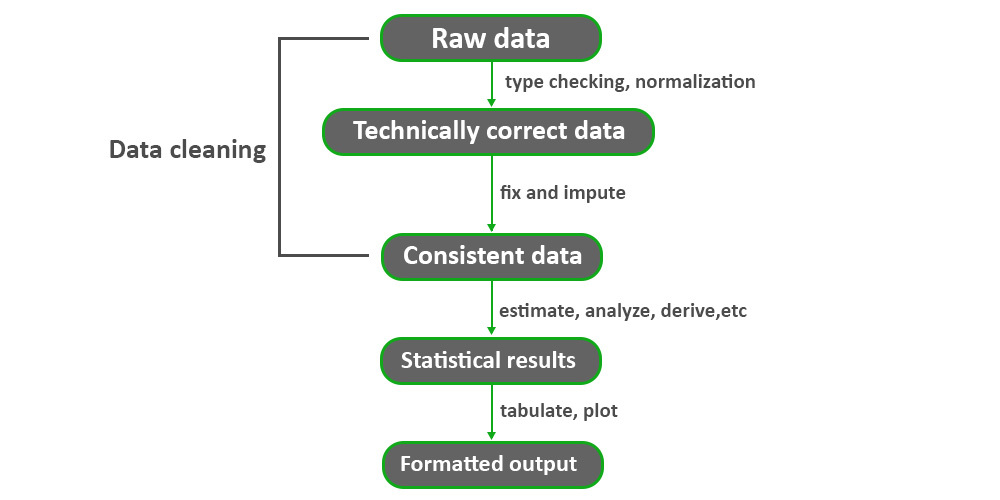

数据处理是模型训练的先决条件,也是影响模型预测速度的重要因素。数据的预处理包括特征选择、缺失值处理、数据标准化等步骤。通过减少特征数量,不仅可以降低模型的复杂度,还能缩短训练和预测时间。此外,有效地处理缺失值和对数据进行标准化或归一化,也有助于提升模型的训练效率。

#### 示例代码:特征选择和数据标准化

```r

library(randomForest)

# 加载数据集

data(iris)

iris_data <- iris[, -5] # 移除标签列

# 特征选择

selected_features <- c("Sepal.Length", "Sepal.Width")

iris_data <- iris_data[, selected_features]

# 数据标准化

iris_data <- scale(iris_data)

# 构建ra

```

0

0