【模型压缩与加速】:实战Hugging Face模型量化与剪枝技术

发布时间: 2024-09-30 17:12:16 阅读量: 51 订阅数: 23

大模型应用实战指南:高效调用、深度使用与技巧揭秘.pdf

# 1. 模型压缩与加速概述

模型压缩与加速是深度学习领域中的重要课题,尤其是在边缘计算和移动设备上。随着AI技术的广泛应用,如何在有限的计算资源上高效地运行模型,已成为技术开发者关注的焦点。模型压缩旨在通过减少模型的大小和复杂度,以减少计算资源的消耗,加速模型的推理速度。加速则是指提升模型在特定硬件上的执行效率。本章将探讨模型压缩与加速的基本概念、必要性以及它们对行业的影响。

# 2. 模型量化的理论与实践

## 2.1 量化的基本原理

### 2.1.1 量化的概念和背景

在深度学习领域,模型的大小和运行速度往往受限于模型参数的数量和计算复杂度。随着神经网络结构越来越深,模型的存储需求和计算资源消耗也随之增加。为了在资源受限的设备上部署高性能的深度学习模型,模型量化成为了研究的热点。量化的本质是通过减少模型参数的精度来减少模型的大小和计算量,同时尽可能保持模型的性能。量化过程可以分为训练时量化和推理时量化,前者在模型训练过程中实施量化,后者则是在模型训练完毕后将模型转换为低精度表示。量化的类型主要包括权重量化、激活量化和全模型量化。

### 2.1.2 量化级别和方法

量化级别通常指量化的精度,主要分为低精度和高精度。低精度量化的优点是减少内存占用和提升计算效率,但可能引入量化误差。常见的量化级别有:8位量化、4位量化、二值化量化等。量化方法可以分为后训练量化(Post-Training Quantization, PTQ)和量化感知训练(Quantization-Aware Training, QAT)。后训练量化指的是直接将训练好的浮点模型转换成低精度模型,而量化感知训练则在训练过程中模拟量化效果,使得模型在训练初期就适应低精度的表示。

## 2.2 量化模型的训练与转换

### 2.2.1 训练过程中的量化技术

量化感知训练是在模型训练过程中引入量化误差的一种策略。通过在训练时引入量化的噪声,可以使模型逐渐适应低精度的表示,减少量化后模型性能的下降。为了实现量化感知训练,训练框架需要支持模拟量化,即在前向传播和反向传播过程中,将浮点数模拟为低精度表示,而权重更新仍然在浮点数上执行。通常,量化感知训练需要调整超参数,如量化步长,以达到最佳的量化效果。

### 2.2.2 模型转换为量化格式

一旦训练好的模型需要部署到低精度硬件上,就需要将模型转换为量化格式。这通常涉及将模型的浮点数权重和激活转换为整数表示。转换过程中,需要确定量化的范围和量化比例因子。量化范围通常基于训练好的模型参数的统计信息,而比例因子则是根据量化的精度动态计算得出。比如在8位量化中,权重可能会被缩放到[-128, 127]的范围内,然后转换为8位整数。

## 2.3 量化模型的评估与优化

### 2.3.1 量化误差分析

量化误差是量化模型中不可避免的,主要来源于量化过程对权重和激活的近似。量化误差分析的目的是评估量化对模型性能的影响。通过比较量化前后的模型在验证集上的表现,可以得到量化带来的性能损失。进一步地,可以分析量化误差在模型中的分布情况,如哪些层的量化误差更大,量化误差与模型性能的关联等。

### 2.3.2 量化模型性能优化策略

在发现量化误差后,可以通过多种策略来优化量化模型的性能。例如,可以采用更复杂的量化算法,如对称量化、非对称量化、分组量化等。在一些情况下,可以对特定的层使用不同的量化策略,例如对卷积层使用较低的量化位宽,而对注意力机制层使用较高的位宽。另外,还可以通过量化前后插值(如量化感知蒸馏)的方法,来减少量化带来的性能损失。

```mermaid

graph LR

A[训练好的浮点模型] -->|量化感知训练| B[适应低精度表示]

B --> C[模型转换为量化格式]

C --> D[量化误差分析]

D --> E[优化量化模型性能]

```

### 代码块:模型量化工具使用示例

以TensorFlow为例,下面的代码块展示了一个简单的后训练量化过程。该代码使用了TensorFlow的`tf.quantization` API来将一个预训练模型转换为8位整数表示的量化模型。

```python

import tensorflow as tf

# 加载预训练模型

model = tf.keras.models.load_model('path_to_model')

# 量化模型

converter = tf.lite.TFLiteConverter.from_keras_model(model)

converter.optimizations = [tf.lite.Optimize.DEFAULT]

converter.target_spec.supported_types = [tf.float16]

tflite_quant_model = converter.convert()

# 保存量化模型

with open('quantized_model.tflite', 'wb') as f:

f.write(tflite_quant_model)

```

在上述代码中,`from_keras_model`方法加载了一个Keras模型,`Optimize.DEFAULT`选项指定了使用默认的优化器,即在转换过程中应用后训练量化。`supported_types`指定了支持的类型,这里将模型权重转换为16位浮点数表示。最终得到的`quantized_model.tflite`是一个适用于低精度推理的TensorFlow Lite模型文件。

通过量化工具的使用和代码块的展示,我们可以看到将深度学习模型部署到边缘设备上,实现模型压缩与加速的实践操作。在实际的量化实践中,还需要对量化模型进行严格的测试,确保其在特定任务上的性能满足预期。接下来的章节将继续探讨模型剪枝等其他压缩技术,并通过实际案例进一步说明模型压缩与加速的实践过程。

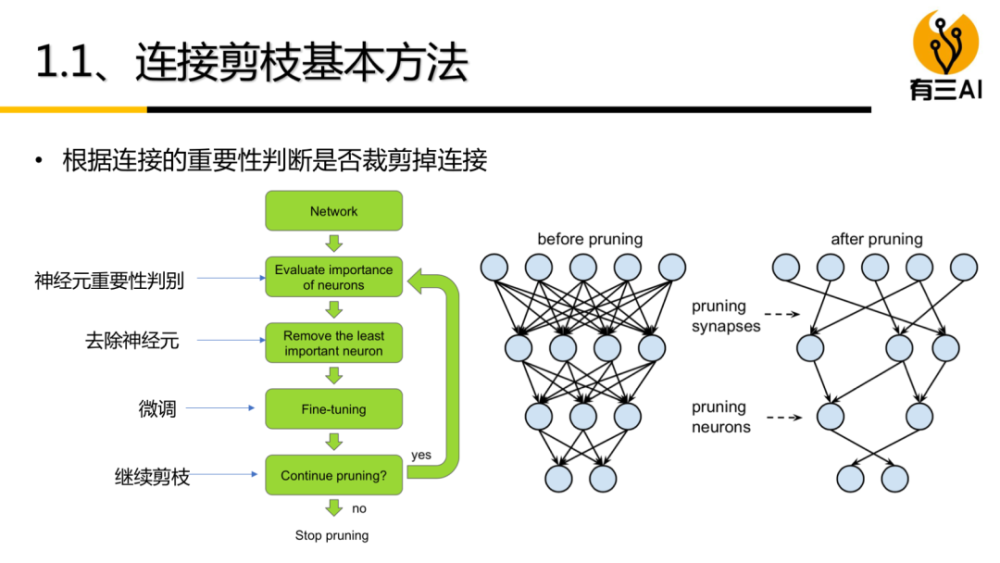

# 3. 模型剪枝的理论与实践

在深度学习模型的部署和运行过程中,资源消耗和运行效率是两大重要挑战。模型剪枝作为一种有效的模型压缩技术,能够在减少模型规模的同时,尽量不损失模型性能,甚至提升模型的泛化能力。本章节将深入探讨模型剪枝的理论基础和实践应用,提供详细的策略性剪枝方法和剪枝模型的评估调整策略。

## 3.1 剪枝技术基础

### 3.1.1 剪枝的定义与类型

剪枝技术的中心思想是移除神经网络中冗余或不重要的部分,以减少计算量并加速模型推理。其核心是“稀疏性”,即在网络中引入大量的零值,这些零值可以在数学运算中被忽略,从而降低模型的计算复杂度。

剪枝主要分为以下类型:

- **全局剪枝**:针对整个网络权重进行剪枝,这种剪枝通常会影响网络结构的完整性,因此需要在训练时考虑到网络的稀疏性。

- **局部剪枝**:仅针对网络的某一层或者某几个卷积核进行剪枝,这种剪枝保留了网络的基本结构,因此对模型性能的影响相对较小。

- **结构化剪枝**:在剪枝过程中,保证剪枝后的网络结构是规则的,例如剪枝后仍然保持卷积核大小不变,仅改变卷积核的数量。

- **非结构化剪枝**:剪枝后的网络结构可以是不规则的,即保留任意位置的权重,网络结构的不规则性可能导致后端加速库难以优化。

### 3.1.2 剪枝的理论依据

剪枝的理论依据主要源于以下几个方面:

- **冗余性**:在训练过程中,网络中的许多参数是冗余的,它们对最终的预测结果影响不大,因此可以被移除而不影响模型性能。

- **参数重要性**:可以通过计算参数对输出结果的影响程度来判断哪些参数更重要。参数重要性评估是决定剪枝比例的关键因素。

- **平滑性**:深度网络通常具有平滑性质,即对输入的小的扰动或对权重的小的修改不会导致输出结果的巨大变化。这一性质支撑了剪枝的可行性。

## 3.2 实施模型剪枝

### 3.2.1 策略性剪枝方法

策略性剪枝方法涉及根据预设的规则或算法来选择要剪除的参数。这些规则可以是基于权重大小、梯度大小、激活值的统计信息等。例如,可以移除权重绝对值较小的连接,因为它们对网络的贡献被认为较小。

一种常见的策略是基于权重重要性的剪枝方法,如:

- **L1/L2正则化**:在训练过程中引入L1或L2正则项,使得模型倾向于学习具有更少非零参数的解决方案。

- **迭代剪枝**:逐步剪枝法,即在每一步剪除一部分权重,然后重新训练网络以恢复性能损失,重复这个过程直至达到目标的稀疏性。

### 3.2.2 结构化与非结构化剪枝

结构化剪枝和非结构化剪枝各有优劣。结构化剪枝由于保持了模型的规则性,易于利用硬件优化,如使用高效的矩阵乘法算法,但可能会对模型性能有较大影响。非结构化剪枝则保留了模型的灵活性,更易于实现高稀疏性,但会增加后处理的复杂度。

### 代码块示例与分析

以下是使用PyTorch实现的简单结构化剪枝的一个示例。该代码通过移除每个卷积层中权重绝对值最小的10%的参数来剪枝。

```python

import torch

from torchvision.models import resnet18

# 加载模型

model = resnet18(pretrained=True)

# 剪枝参数设置

pruning_rate = 0.1 # 每层剪枝比例为10%

modules_to_prune = list(model.named_modules())

# 遍历所有模块进行剪枝

for name, module in modules_to_prune:

if isinstance(module, torch.nn.Conv2d):

# 对卷积层进行剪枝

prune_conv(module, pruning_rate)

def prune_conv(conv_module, pruning_rate):

"""剪枝卷积层"""

if not i

```

0

0