【端到端项目构建】:使用Hugging Face Transformers从零到一完成NLP项目

发布时间: 2024-09-30 17:40:39 阅读量: 26 订阅数: 23

Adaptnlp:易于使用的自然语言处理库和框架,用于预测,训练,微调和提供最新的NLP模型

# 1. NLP项目简介与Hugging Face Transformers概述

## 1.1 自然语言处理(NLP)的重要性

自然语言处理(NLP)是计算机科学与人工智能领域的一个分支,旨在赋予计算机理解人类语言的能力。这涉及到从文本和语音数据中提取有意义的信息,并执行如翻译、情感分析和自动摘要等任务。随着技术的进步,NLP已成为人机交互、数据分析和内容理解的核心技术。

## 1.2 Hugging Face Transformers库的影响力

Hugging Face的Transformers库是当前NLP领域最流行的开源库之一,它提供了一个易于使用、高效的平台,用于访问和应用预训练模型。Transformers库不仅简化了模型的加载和应用过程,而且支持一系列先进的NLP任务,为研究者和开发者提供了强大的工具集。

## 1.3 NLP项目构建的初步了解

在进行NLP项目构建时,我们首先需要了解预训练模型的基础知识,这包括模型如何通过大量数据进行学习以及它们在特定任务中的表现。Hugging Face的Transformers库提供了丰富的模型和组件,使得NLP项目的构建变得更为快速和简单,无论是对初学者还是经验丰富的开发者。通过本章,我们将为读者铺垫NLP项目构建的知识基础,为后续章节的具体实操打下坚实的基础。

# 2. 项目构建的理论基础

## 2.1 自然语言处理基础概念

自然语言处理(Natural Language Processing,简称NLP)是计算机科学与语言学领域的一个交叉学科,主要研究如何使计算机能够理解和处理人类的自然语言。它涉及语言学、计算机科学和数学的多个分支,其目的是设计能够自动处理和分析大量自然语言数据的算法和模型。

### 2.1.1 语言模型与预训练模型

语言模型是NLP中的一个核心概念,它能够计算一个句子在语言中出现的概率。通过训练语言模型,可以捕捉语言的统计特性,从而为许多NLP任务提供基础。近年来,预训练模型成为了语言模型的一种重要实现形式。预训练模型如BERT、GPT等,在大规模语料库上进行预训练,学习语言的深层次特征,然后可以在特定任务上进行微调(fine-tuning),以适应具体的NLP任务。

### 2.1.2 NLP中的主要任务和应用场景

NLP涵盖的任务非常丰富,包括但不限于以下几类:

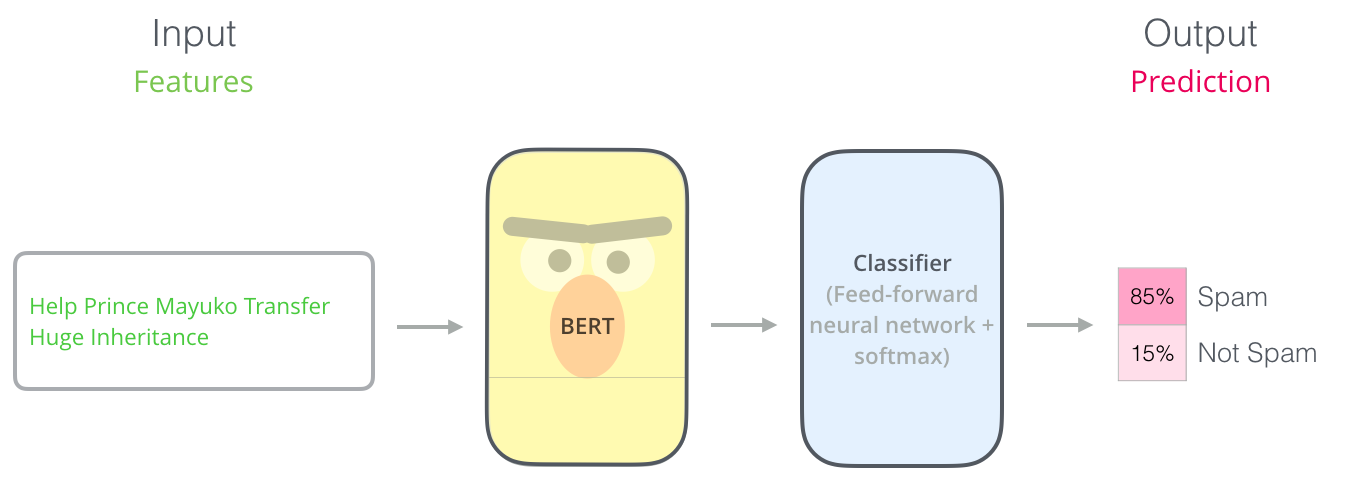

- 文本分类(Text Classification):例如情感分析、垃圾邮件检测等。

- 信息检索(Information Retrieval):从大量文本中检索出符合查询条件的信息。

- 序列标注(Sequence Labeling):如命名实体识别(NER)、词性标注(POS Tagging)等。

- 机器翻译(Machine Translation):将一种语言翻译成另一种语言。

- 问答系统(Question Answering):回答自然语言形式的问题。

- 文本生成(Text Generation):如聊天机器人、自动生成摘要等。

NLP的应用场景广泛,包括搜索引擎、智能助手、社交媒体分析、医疗健康、金融等领域。

## 2.2 Hugging Face Transformers库介绍

### 2.2.1 Transformers库的架构和组件

Transformers库由Hugging Face公司维护,提供了一系列基于最新研究成果的预训练模型和对应的工具,这些模型覆盖了NLP中的许多任务。库的核心架构基于Transformer模型,该模型通过自注意力机制有效地捕捉了文本数据的长距离依赖关系。

库中的关键组件包括:

- 模型(Model):预训练的神经网络模型,如BERT、GPT-2等。

- Tokenizers:用于文本编码的工具,将单词或字符转换成模型能理解的数字形式。

- Pipelines:高层次的应用接口,用于快速实现NLP任务,例如情感分析、问答系统等。

- 训练工具:提供了训练、评估和保存模型的功能。

### 2.2.2 预训练模型的选择与应用

预训练模型的选择通常取决于任务的需求。例如,对于文本分类任务,可以使用BERT或RoBERTa等模型;对于文本生成任务,则可选用GPT-2或T5模型。

在实际应用中,预训练模型可以进行微调(Fine-tuning),即在特定的数据集上继续训练以适应特定任务,这种方法往往能显著提高模型的性能。微调时需要注意保持模型架构与预训练时的一致性,以及合理调整学习率等超参数。

## 2.3 构建NLP项目的基本步骤

### 2.3.1 项目规划与需求分析

项目规划阶段需要明确项目的目标和需求。需求分析应包括以下方面:

- 项目的目标和预期结果。

- 需要解决的具体NLP问题。

- 数据来源和数据量大小。

- 项目的时间框架和资源预算。

在这一阶段,可能需要与领域专家进行沟通,以确保需求的准确性和可实现性。

### 2.3.2 数据收集与预处理

数据是构建NLP项目的基础。数据收集应确保数据的质量和代表性,常用的数据来源包括公开数据集、网页爬虫、应用程序日志等。数据预处理步骤通常包括:

- 清洗数据,去除无关信息,如HTML标签、非文本内容等。

- 文本标准化,例如转换为统一的大小写、去除停用词等。

- 分词(Tokenization),将文本分割成可处理的单元,如单词或字符。

- 向量化,将文本转换为数值形式,如使用词袋模型或Word Embeddings。

数据预处理是确保模型能够有效学习的关键步骤。

### 2.3.3 模型训练与优化

模型训练是NLP项目构建的核心环节。首先选择合适的预训练模型和架构,然后在特定任务的数据集上进行微调。训练过程中需要注意以下方面:

- 设置合理的训练参数,如学习率、批次大小(batch size)和训练周期(epochs)。

- 使用交叉验证等技术来避免过拟合。

- 实施有效的监控措施,例如记录损失函数值和评估指标,以评估模型在验证集上的表现。

- 对模型进行优化,如调整模型架构、使用正则化技术等,以提高模型的泛化能力。

通过这些步骤,可以逐步提升模型在特定任务上的性能。

# 3. 实践操作 - 端到端项目构建

在自然语言处理(NLP)项目中,理论知识的实际应用是至关重要的。本章将深入探讨如何使用Hugging Face的Transformers库来构建一个端到端的NLP项目。我们将从环境搭建和库安装开始,逐步介绍数据处理、模型训练和模型评估部署的具体操作。

## 3.1 环境搭建与库安装

### 3.1.1 环境准备:Python虚拟环境的创建

在进行任何NLP项目之前,建议设置一个独立的Python虚拟环境。虚拟环境能够隔离项目依赖,防止版本冲突,这对于任何类型的Python项目都是一种好的实践。我们可以使用`venv`模块来创建一个虚拟环境。

```bash

# 创建名为.env的虚拟环境

python3 -m venv .env

```

接下来,我们需要激活虚拟环境:

```bash

# 在Windows上激活虚拟环境

.env\Scripts\activate

# 在Unix或MacOS上

source .env/bin/activate

```

### 3.1.2 Transformers库的安装与配置

安装Transformers库是构建N

0

0