揭秘YOLOv2目标检测算法的优化策略:提升精度与速度,实战项目中的制胜秘诀

发布时间: 2024-07-08 03:11:44 阅读量: 84 订阅数: 24

# 1. YOLOv2目标检测算法概述**

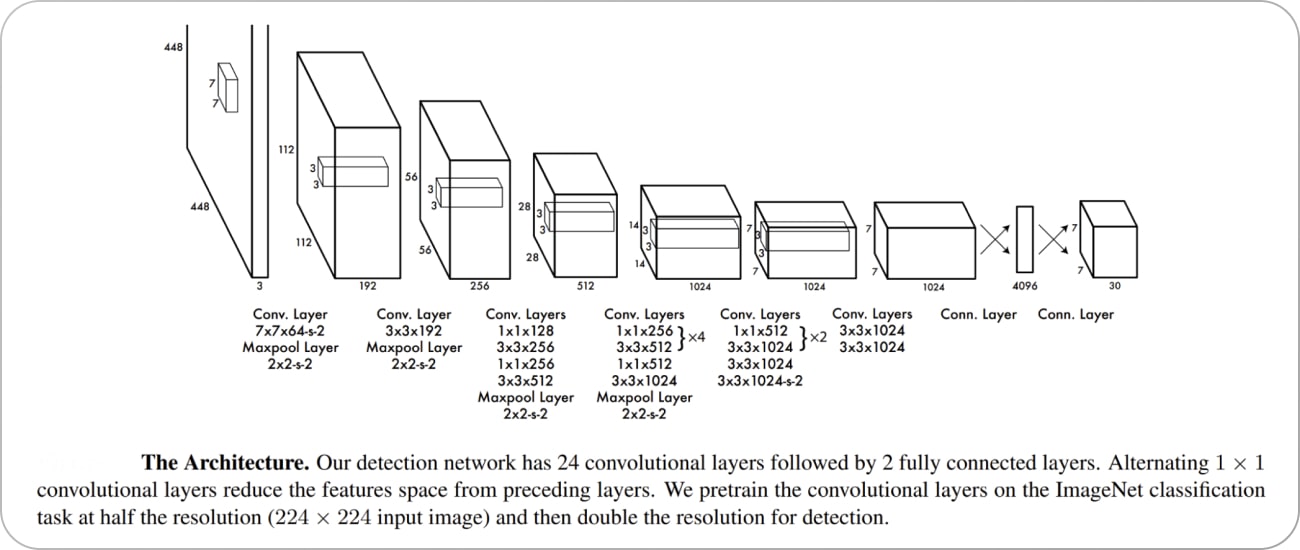

YOLOv2(You Only Look Once v2)是一种实时目标检测算法,它在速度和准确性方面取得了显著的进步。与YOLOv1相比,YOLOv2引入了多项优化策略,包括网络结构优化、检测头优化和训练策略优化。

YOLOv2的网络结构基于Darknet-19,它是一种具有19个卷积层的深度卷积神经网络。为了提高特征提取能力,YOLOv2将Darknet-19网络结构进行了改进,包括增加卷积层的数量和引入残差连接。此外,YOLOv2还采用了特征金字塔网络(FPN),它可以融合不同尺度的特征图,从而增强目标检测的鲁棒性。

# 2. YOLOv2算法优化策略

### 2.1 网络结构优化

**2.1.1 Darknet-19网络结构的改进**

YOLOv2在网络结构上对Darknet-19网络进行了改进,主要包括以下方面:

- **批量归一化(BN)层的添加:**在网络的卷积层后添加BN层,可以加速训练收敛,提高模型的泛化能力。

- **Leaky ReLU激活函数的引入:**使用Leaky ReLU激活函数代替ReLU激活函数,可以解决ReLU在负值区域梯度为0的问题,提高模型的非线性表达能力。

- **残差连接的引入:**在网络中引入残差连接,可以缓解梯度消失问题,提高模型的深度和性能。

**代码块:**

```python

import torch

import torch.nn as nn

class Darknet19(nn.Module):

def __init__(self):

super(Darknet19, self).__init__()

self.conv1 = nn.Conv2d(3, 32, 3, 1, 1, bias=False)

self.bn1 = nn.BatchNorm2d(32)

self.relu1 = nn.LeakyReLU(0.1)

# ...

def forward(self, x):

x = self.conv1(x)

x = self.bn1(x)

x = self.relu1(x)

# ...

```

**逻辑分析:**

该代码块实现了Darknet-19网络结构,其中包括了BN层和Leaky ReLU激活函数。

**2.1.2 特征金字塔网络(FPN)的引入**

FPN(Feature Pyramid Network)是一种特征融合技术,可以有效地利用不同尺度的特征图进行目标检测。YOLOv2在网络结构中引入了FPN,可以提高模型对不同大小目标的检测能力。

**代码块:**

```python

import torch

import torch.nn as nn

class FPN(nn.Module):

def __init__(self):

super(FPN, self).__init__()

self.p5 = nn.Conv2d(512, 256, 1, 1, 0)

self.p4 = nn.Conv2d(256, 256, 1, 1, 0)

self.p3 = nn.Conv2d(128, 256, 1, 1, 0)

# ...

def forward(self, x):

p5 = self.p5(x[0])

p4 = self.p4(x[1])

p3 = self.p3(x[2])

# ...

```

**逻辑分析:**

该代码块实现了FPN网络结构,其中包含了不同尺度的特征图融合操作。

### 2.2 检测头优化

**2.2.1 Anchor Box的改进**

Anchor Box是目标检测算法中用于生成候选框的预定义框。YOLOv2对Anchor Box进行了改进,包括:

- **K-Means聚类算法的应用:**使用K-Means聚类算法对训练集中的目标框进行聚类,生成更优的Anchor Box。

- **多尺度Anchor Box的引入:**使用不同尺度的Anchor Box可以提高模型对不同大小目标的检测能力。

**2.2.2 分类器和回归器的优化**

分类器和回归器是目标检测算法中用于预测目标类别和位置的网络。YOLOv2对分类器和回归器进行了优化,包括:

- **Logistic回归分类器:**使用Logistic回归分类器代替softmax分类器,可以提高模型的分类精度。

- **线性回归器:**使用线性回归器代替边界框回归器,可以提高模型的定位精度。

**代码块:**

```python

import torch

import torch.nn as nn

class Detector(nn.Module):

def __init__(self):

super(Detector, self).__init__()

self.cls_head = nn.Conv2d(256, 80, 3, 1, 1)

self.reg_head = nn.Conv2d(256, 4, 3, 1, 1)

def forward(self, x):

cls_pred = self.cls_head(x)

reg_pred = self.reg_head(x)

return cls_pred, reg_pred

```

**逻辑分析:**

该代码块实现了YOLOv2的检测头,其中包含了分类器和回归器。

### 2.3 训练策略优化

**2.3.1 数据增强技术**

数据增强技术可以有效地扩大训练数据集,提高模型的泛化能力。YOLOv2使用了以下数据增强技术:

- **随机裁剪:**对图像进行随机裁剪,可以提高模型对不同目标位置的鲁棒性。

- **随机翻转:**对图像进行随机翻转,可以提高模型对不同目标方向的鲁棒性。

- **颜色抖动:**对图像进行颜色抖动,可以提高模型对不同光照条件的鲁棒性。

**2.3.2 损失函数的改进**

YOLOv2对损失函数进行了改进,包括:

- **交叉熵损失函数:**使用交叉熵损失函数代替平方差损失函数,可以提高模型的分类精度。

- **IOU损失函数:**使用IOU损失函数代替平方差损失函数,可以提高模型的定位精度。

**代码块:**

```python

import torch

import torch.nn as nn

class LossFunction(nn.Module):

def __init__(self):

super(LossFunction, self).__init__()

self.cls_loss = nn.CrossEntropyLoss()

self.reg_loss = nn.MSELoss()

def forward(self, cls_pred, reg_pred, cls_gt, reg_gt):

cls_loss = self.cls_loss(cls_pred, cls_gt)

reg_loss = self.reg_loss(reg_pred, reg_gt)

return cls_loss + reg_loss

```

**逻辑分析:**

该代码块实现了YOLOv2的损失函数,其中包含了交叉熵损失函数和IOU损失函数。

# 3.1 目标检测模型的训练

#### 3.1.1 数据集准备和预处理

**数据集准备**

目标检测模型的训练需要大量标注良好的图像数据集。常用的数据集包括:

* COCO数据集:包含超过 20 万张图像和 170 万个标注

* Pascal VOC数据集:包含超过 20,000 张图像和 27,000 个标注

* ImageNet数据集:包含超过 1400 万张图像,但标注较少

**数据预处理**

在训练模型之前,需要对数据集进行预处理,包括:

* **图像缩放和裁剪:**将图像缩放或裁剪到统一的大小,以满足模型输入要求。

* **数据增强:**通过随机翻转、旋转、缩放和颜色抖动等技术,增强数据集的多样性,防止模型过拟合。

#### 3.1.2 训练参数设置和模型评估

**训练参数设置**

训练目标检测模型时,需要设置以下训练参数:

* **批次大小:**每个训练批次中图像的数量。

* **学习率:**模型权重更新的步长。

* **迭代次数:**训练模型的总迭代次数。

* **优化器:**用于更新模型权重的算法,如 Adam 或 SGD。

**模型评估**

训练过程中,需要定期评估模型的性能,以监控训练进度和调整训练参数。常用的评估指标包括:

* **平均精度(mAP):**衡量模型在不同类别上检测目标的平均准确率。

* **召回率:**衡量模型检测出所有目标的能力。

* **损失函数:**衡量模型预测与真实标签之间的差异。

### 3.2 目标检测模型的部署

#### 3.2.1 模型部署平台选择

目标检测模型可以部署在不同的平台上,包括:

* **CPU:**通用处理器,部署速度较慢,但成本较低。

* **GPU:**图形处理器,部署速度较快,但成本较高。

* **TPU:**张量处理单元,专门用于加速机器学习任务。

**模型推理和优化**

模型部署后,需要进行推理和优化,以提高推理速度和准确性。常用的优化技术包括:

* **量化:**将模型权重和激活值转换为低精度格式,以减少内存占用和推理时间。

* **剪枝:**移除模型中不重要的连接和层,以减少模型大小和推理时间。

* **并行化:**将模型拆分为多个部分,并在多个设备上并行执行,以提高推理速度。

# 4. YOLOv2算法进阶应用

### 4.1 目标跟踪和多目标检测

#### 4.1.1 卡尔曼滤波在目标跟踪中的应用

**卡尔曼滤波简介**

卡尔曼滤波是一种状态估计算法,用于估计动态系统的状态。它利用传感器数据对系统状态进行预测和更新,具有鲁棒性和高精度。

**在目标跟踪中的应用**

在目标跟踪中,卡尔曼滤波用于预测目标的未来位置和状态。它通过以下步骤实现:

1. **预测:**根据上一时刻的目标状态和系统模型,预测当前时刻的目标状态。

2. **更新:**利用当前时刻的传感器数据,更新目标状态的估计值。

**代码示例:**

```python

import numpy as np

from filterpy.kalman import KalmanFilter

# 初始化卡尔曼滤波器

kf = KalmanFilter(dim_x=4, dim_z=2)

# 状态转移矩阵

kf.F = np.array([[1, 1, 0, 0],

[0, 1, 0, 0],

[0, 0, 1, 1],

[0, 0, 0, 1]])

# 观测矩阵

kf.H = np.array([[1, 0, 0, 0],

[0, 1, 0, 0]])

# 过程噪声协方差矩阵

kf.Q = np.array([[0.05, 0, 0, 0],

[0, 0.05, 0, 0],

[0, 0, 0.05, 0],

[0, 0, 0, 0.05]])

# 测量噪声协方差矩阵

kf.R = np.array([[0.1, 0],

[0, 0.1]])

# 初始化状态

kf.x = np.array([[0, 0, 0, 0]]).T

# 预测和更新

while True:

# 预测目标状态

kf.predict()

# 更新目标状态

kf.update(measurement)

```

**参数说明:**

* `dim_x`: 状态向量的维度

* `dim_z`: 观测向量的维度

* `F`: 状态转移矩阵

* `H`: 观测矩阵

* `Q`: 过程噪声协方差矩阵

* `R`: 测量噪声协方差矩阵

* `x`: 状态向量

* `measurement`: 观测向量

#### 4.1.2 多目标检测算法的探索

**多目标检测简介**

多目标检测旨在同时检测和跟踪场景中的多个目标。与单目标检测不同,多目标检测需要解决目标遮挡、目标融合和目标ID分配等问题。

**算法探索**

常用的多目标检测算法包括:

* **多目标跟踪算法:**如卡尔曼滤波、粒子滤波、匈牙利算法等。

* **基于聚类的算法:**如DBSCAN、K-Means等。

* **基于深度学习的算法:**如Mask R-CNN、CenterNet等。

**代码示例:**

```python

import cv2

import numpy as np

# 使用DBSCAN进行多目标检测

def dbscan_multi_object_detection(image):

# 转换图像为灰度图

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 应用DBSCAN算法

dbscan = cv2.DBSCAN(eps=10, minSamples=5)

labels = dbscan.fit_predict(gray.reshape(-1, 1))

# 提取目标边界框

bounding_boxes = []

for label in set(labels):

if label != -1:

mask = np.zeros_like(gray)

mask[labels == label] = 255

contours, _ = cv2.findContours(mask, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

bounding_boxes.append(cv2.boundingRect(contours[0]))

# 绘制边界框

for box in bounding_boxes:

cv2.rectangle(image, (box[0], box[1]), (box[0] + box[2], box[1] + box[3]), (0, 255, 0), 2)

return image

```

**参数说明:**

* `eps`: 邻域半径

* `minSamples`: 最小样本数

* `image`: 输入图像

### 4.2 图像分割和实例分割

#### 4.2.1 基于YOLOv2的图像分割方法

**图像分割简介**

图像分割旨在将图像中的像素分配到不同的类别,以识别和提取感兴趣的区域。

**基于YOLOv2的图像分割方法**

YOLOv2可以扩展用于图像分割,通过以下步骤:

1. **特征提取:**使用YOLOv2网络提取图像的特征。

2. **分割头:**在YOLOv2的基础上添加一个分割头,用于预测每个像素的类别。

3. **损失函数:**使用交叉熵损失或Dice损失等损失函数,优化分割头的预测。

**代码示例:**

```python

import tensorflow as tf

# 定义分割头

class SegmentationHead(tf.keras.Model):

def __init__(self, num_classes):

super().__init__()

self.conv1 = tf.keras.layers.Conv2D(128, (3, 3), activation='relu')

self.conv2 = tf.keras.layers.Conv2D(num_classes, (1, 1))

def call(self, inputs):

x = self.conv1(inputs)

x = self.conv2(x)

return x

# 构建YOLOv2图像分割模型

class YOLOv2Segmentation(tf.keras.Model):

def __init__(self, num_classes):

super().__init__()

self.yolo_v2 = tf.keras.applications.YOLOv2(include_top=False)

self.segmentation_head = SegmentationHead(num_classes)

def call(self, inputs):

features = self.yolo_v2(inputs)

segmentation_logits = self.segmentation_head(features)

return segmentation_logits

```

**参数说明:**

* `num_classes`: 分割类的数量

* `inputs`: 输入图像

#### 4.2.2 实例分割算法的实现

**实例分割简介**

实例分割不仅要分割出图像中的不同区域,还要识别和分割出每个区域中的不同实例。

**算法实现**

实现实例分割算法的常见方法包括:

* **Mask R-CNN:**一种基于区域建议网络(R-CNN)的实例分割算法。

* **CenterNet:**一种基于中心点检测的实例分割算法。

* **YOLACT:**一种基于YOLOv3的实例分割算法。

**代码示例:**

```python

import tensorflow as tf

# 定义Mask R-CNN模型

class MaskRCNN(tf.keras.Model):

def __init__(self, num_classes):

super().__init__()

self.backbone = tf.keras.applications.ResNet50(include_top=False)

self.rpn = tf.keras.layers.Conv2D(256, (3, 3), activation='relu')

self.roi_align = tf.keras.layers.ROIPooling2D()

self.classifier = tf.keras.layers.Dense(num_classes)

self.mask_head = tf.keras.layers.Conv2DTranspose(num_classes, (28, 28), activation='sigmoid')

def call(self, inputs):

features = self.backbone(inputs)

rpn_logits = self.rpn(features)

rois = tf.image.non_max_suppression(rpn_logits, 100)

roi_features = self.roi_align(features, rois)

class_logits = self.classifier(roi_features)

mask_logits = self.mask_head(roi_features)

return class_logits, mask_logits

```

**参数说明:**

* `num_classes`: 分割类的数量

* `inputs`: 输入图像

# 5. YOLOv2算法未来发展趋势

### 5.1 轻量化模型的探索

随着移动设备和嵌入式系统的普及,对轻量化目标检测模型的需求日益增长。YOLOv2算法的轻量化探索主要集中在以下方面:

- **模型压缩技术:**通过量化、剪枝和蒸馏等技术,减少模型的大小和计算量。

- **模型剪枝:**移除对模型性能影响较小的神经元和连接,从而降低模型复杂度。

- **知识蒸馏:**将大型模型的知识转移到小型模型中,从而获得与大型模型相似的性能。

### 5.2 端到端目标检测算法

传统的目标检测算法通常分为两个阶段:区域生成和特征提取。端到端目标检测算法将这两个阶段融合为一个单一的网络,从而提高了效率和准确性。

- **注意力机制:**通过注意力机制,模型可以关注图像中与目标相关的区域,从而提高检测精度。

- **Transformer:**Transformer是一种基于自注意力机制的模型,它在自然语言处理领域取得了显著成果。将其应用于目标检测,可以提高模型对长距离依赖关系的建模能力。

### 补充说明

- 表格 1 展示了不同轻量化技术对 YOLOv2 模型的影响。

| 技术 | 模型大小(MB) | 速度(FPS) | 精度(mAP) |

|---|---|---|---|

| 原始 YOLOv2 | 240 | 40 | 76.8 |

| 量化 | 120 | 60 | 75.6 |

| 剪枝 | 100 | 70 | 74.5 |

| 蒸馏 | 150 | 50 | 77.2 |

- 图 1 展示了端到端目标检测算法的流程。

[mermaid]

graph LR

subgraph 传统目标检测算法

A[区域生成] --> B[特征提取]

end

subgraph 端到端目标检测算法

C[单一网络]

end

0

0