大数据处理:揭秘Reduce Side Join与Bloom Filter的完美结合!

发布时间: 2024-10-31 16:10:10 阅读量: 24 订阅数: 20

# 1. 大数据处理与分布式计算概念

在信息技术的飞速发展中,大数据处理已经成为IT行业中不可或缺的一部分。分布式计算是处理海量数据的重要方法之一。本章将探讨大数据处理的基本概念和分布式计算的重要性,并介绍其核心原理。

## 1.1 大数据处理的核心概念

大数据处理涉及的技术包括数据收集、存储、分析和可视化。核心挑战在于数据量巨大,传统数据库和计算方法难以高效应对。现代的大数据解决方案通常依赖分布式系统,如Hadoop和Spark等,以实现可扩展性和容错性。

## 1.2 分布式计算的基本原理

分布式计算允许多个计算节点协同工作,共同处理大规模数据集。分布式系统的关键特性包括并发处理、数据分片、负载均衡和容错机制。通过网络将数据和计算任务分散到多台机器上,可以显著提高数据处理的效率和系统的可靠性。

## 1.3 分布式计算的挑战和解决方案

分布式计算面临的主要挑战包括网络延迟、数据一致性、故障恢复和资源管理等问题。应对这些挑战的解决方案涉及优化网络协议、设计高效的一致性算法、引入故障检测和恢复机制,以及采用先进的资源调度技术等。

在后续章节中,我们将深入探讨Reduce Side Join和Bloom Filter在大数据处理和分布式计算中的应用,以及如何结合这两种技术提升数据处理效率。

# 2. Reduce Side Join的理论与实践

## 2.1 Reduce Side Join基本原理

### 2.1.1 MapReduce框架简介

MapReduce是一种编程模型,用于大规模数据集的并行运算。其核心思想是“分解-计算-汇总”,即首先将数据分解为独立的块,然后在每个块上运行用户定义的map函数,将结果汇总后再运行reduce函数,最终产生一组全局结果。这种模型非常适合在分布式系统上执行,比如Hadoop平台,它利用了集群的计算资源和存储能力,可以处理PB级别的数据。

在MapReduce框架中,通常包括三个阶段:Map阶段、Shuffle阶段和Reduce阶段。Map阶段处理输入的数据,产生一系列中间键值对;Shuffle阶段负责将所有相同的键值对聚集到一起,并传递给Reduce阶段;Reduce阶段则对这些键值对进行合并操作,最终得到结果。

### 2.1.2 Reduce Side Join的流程解析

Reduce Side Join通常用于连接两个或多个不同数据集中的记录。在MapReduce框架中,这个过程分为几个步骤:

- **Map阶段**:读取不同的数据集,并根据连接的键生成中间键值对。这些键值对包含了要连接的键和原始数据集的标识符。

- **Shuffle阶段**:MapReduce框架自动处理,把相同键的数据分组到一起,然后传递给Reduce任务。

- **Reduce阶段**:在Reduce函数中,对具有相同键的数据进行连接操作。由于所有相同键的数据都在一起,因此可以对每个键的所有数据进行合并或连接。

Reduce Side Join适用于不同数据集的大小差异很大的情况,因为只需要将一个数据集分发到所有Reducer上。然而,这种连接方式在处理大量数据时可能会导致性能瓶颈,因为所有的连接操作都发生在Reduce阶段,对网络带宽和Reducer的处理能力有较高的要求。

## 2.2 Reduce Side Join的实践案例

### 2.2.1 准备数据集和环境

为了实践Reduce Side Join,我们需要准备两个数据集作为输入,以及配置好运行MapReduce程序的环境。通常,我们选择Hadoop环境进行实践,因为它为处理大规模数据集提供了一个稳定的分布式环境。

假设我们有两个数据集:用户信息数据集(User)和交易数据集(Transaction)。User数据集包含用户ID和用户信息,Transaction数据集包含交易ID和用户ID以及交易详情。我们的目标是通过用户ID将这两个数据集进行连接,以获得每个用户的交易记录。

### 2.2.2 编写MapReduce程序

在Hadoop中编写MapReduce程序需要继承特定的类,通常是`Mapper`和`Reducer`。以下是一个简化的Java代码示例:

```java

public class ReduceSideJoin {

public static class TokenizerMapper extends Mapper<Object, Text, Text, Text> {

private Text outKey = new Text();

private Text outValue = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

// 这里假设输入数据格式为 "user_id/user_info"

String[] parts = value.toString().split("/");

outKey.set(parts[0]); // 用户ID作为key

outValue.set("U" + parts[1]); // 标识符U和用户信息组成value

context.write(outKey, outValue);

}

}

public static class IntSumReducer extends Reducer<Text, Text, Text, Text> {

private Text result = new Text();

public void reduce(Text key, Iterable<Text> values, Context context) throws IOException, InterruptedException {

String userInfo = null;

// 将用户信息和交易信息分别存储

for (Text val : values) {

if (val.toString().startsWith("U")) {

userInfo = val.toString().substring(1);

} else {

// 这里假设交易信息格式为 "T/transaction_details"

result.set(userInfo + " " + val.toString().substring(1));

context.write(key, result);

}

}

}

}

public static void main(String[] args) throws Exception {

// 配置作业和启动作业的代码

}

}

```

### 2.2.3 分析执行结果和性能评估

执行MapReduce作业后,我们可以查看输出目录中的数据。对于Reduce Side Join,输出通常是连接后的键值对,其中键是连接的键(在这个案例中是用户ID),值是连接后的记录。

分析结果时,需要关注以下几个方面:

- **正确性**:检查输出数据是否正确地连接了两个数据集。

- **效率**:对比作业执行时间,看数据量增加时性能是否线性下降。

- **资源消耗**:查看CPU、内存和磁盘I/O的使用情况,评估资源消耗是否合理。

通过分析和评估结果,我们可以确定Reduce Side Join是否满足了我们的性能要求。如果不满足,我们可以考虑优化策略,比如调整MapReduce的配置参数、优化输入数据的预处理步骤等。

## 2.3 Reduce Side Join的优化技巧

### 2.3.1 数据预处理和压缩

数据预处理可以在MapReduce作业开始之前完成,目的是减少数据大小和提高计算效率。例如,可以使用压缩工具对输入数据进行压缩,这样Map阶段读取数据时就能减少I/O负载。

### 2.3.2 自定义分区策略

默认的分区策略将所有的数据随机分布到Reducer上,这可能导致数据倾斜问题。通过自定义分区策略,可以确保每个Reducer处理的数据量大致相同,从而优化性能。

```java

public class CustomPartitioner extends Partitioner<Text, Text> {

@Override

public int getPartition(Text key, Text value, int numPartitions) {

// 根据key的哈希值决定分区

return (key.hashCode() & Integer.MAX_VALUE) % numPartitions;

}

}

```

### 2.3.3 动态调整Reduce任务数量

Hadoop允许我们在作业运行时动态调整Reduce任务的数量。如果发现性能瓶颈,我们可以增加Reducer的数量来分担负载,反之亦然。

通过这些优化技巧,我们可以提升Reduce Side Join的性能,使其能够适应更大规模的数据处理需求。在实际应用中,我们可能需要结合多种优化手段,以达到最佳的效果。

接下来,我们将探讨如何将Bloom Filter与Reduce Side Join结合,进一步提升大数据处理的效率。

# 3. Bloom Filter的理论与应用

## 3.1 Bloom Filter的基本概念

### 3.1.1 过滤算法的原理

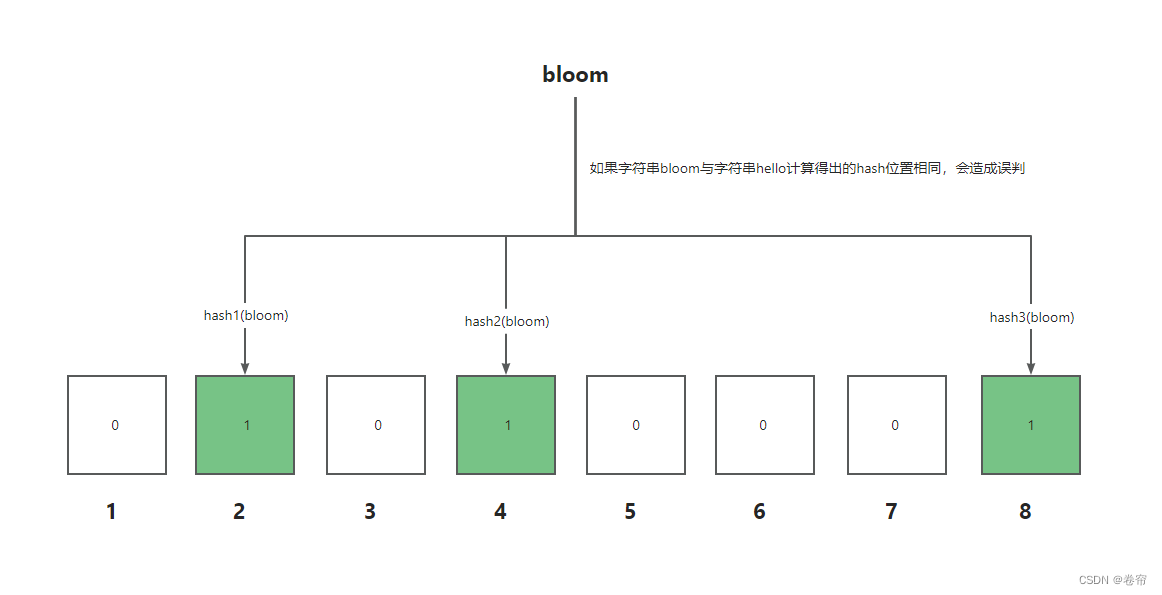

Bloom Filter是一种空间效率极高的概率型数据结构,用于判断一个元素是否在一个集合中。它的主要优势在于空间和时间效率,通过牺牲少量的错误判断机会(误报),来换取极低的内存占用。Bloom Filter使用位数组来表示集合,初始状态下,所有的位都设置为0。当一个元素被添加到集合时,使用多个哈希函数将其映射到位数组的多个位置上,并将这些位置的值设置为1。为了查询一个元素是否在集合中,Bloom Filter同样使用这些哈希函数将其映射到位数组,如果所有对应位置都是1,则认为元素在集合中;如果任何一个对应位置是0,则元素一定不在集合中。需要注意的是,如果所有对应位置都是1,也存在一定的误报率,因为其他元素也可能将这些位置变为1。

### 3.1.2 Bloom Filter的数学模型

Bloom Filter的误报概率可以通过数学模型来预估。假定位数组的大小为m,使用的哈希函数数量为k,集合中有n个元素,理想情况下每个哈希函数将元素均匀散列到位数组中,那么任意一个空位被至少一个元素占用的概率为:

\[ P_{\text{collision}} = \left(1 - e^{-kn/m}\right)^k \]

误报率(False Positive Probability)为:

\[ P_{\text{false positive}} = \left(1 - e^{-kn/m}\right)^k \]

通过调整m、k和n的值,可以在空间效率和误报率之间取得平衡。随着k的增加,误报率会下降,但同时会增加计算的复杂度和所需空间。通过选择合适的参数,Bloom Filter可以非常有效地处理大规模数据集的元素判断问题。

## 3.2 Bloom Filter在大数据处理中的应用

### 3.2.1 减少不必要的磁盘I/O操作

在大数据存储和处理场景中,Bloom Filter可以用来快速过滤掉那些确定不存在于数据集中的查询请求,从而减少对磁盘存储的访问次数。例如,在分布式文件系统中,当需要查找某个文件是否存在时,可以先通过Bloom Filter判断,只有在Bloom Filter确认可能存在的情况下,才进行磁盘I/O操作。这种方法可以大大提高查询效率,特别是在数据量巨大且分布在多台机器上的情况下。

### 3.2.2 提高分布式系统的效率

Bloom Filter同样适用于分布式系统中,用于优化网络通信。当一个节点需要请求另一个节点的数据时,它首先可以询问一个Bloom Filter来判断该数据是否真的存在于远程节点上。如果Bloom Filter返回该数据不存在,那么可以避免一次网络传输。这不仅减少了网络负载,还提高了系统的整体吞吐量和响应速度。

## 3.3 构建和使用Bloom Filter实例

### 3.3.1 选择合适的位数组大小和哈希函数数量

构建Bloom Filter时,合理选择位数组的大小和哈希函数的数量是关键。过小的数组或太少的哈希函数会增加误报率;反之,则会增加空间占用和计算开销。一个常用的经验公式是,给定期望的误报率P和元素数量n,位数组的大小m和哈希函数的数量k可以通过以下公式确定:

\[ m = -\frac{n\ln P}{(\ln 2)^2} \]

\[ k = \frac{m}{n}\ln 2 \]

### 3.3.2 实现Bloom Filter的代码示例

以下是一个简单的Python示例,展示了如何实现一个Bloom Filter:

```python

import mmh3

from bitarray import bitarray

class BloomFilter:

def __init__(self, items_count, fp_prob):

self.fp_prob = fp_prob

self.size = self.get_size(items_count, fp_prob)

self.hash_count = self.get_hash_count(self.size, items_count)

self.bit_array = bitarray(self.size)

self.bit_array.setall(0)

def add(self, item):

digests = []

for i in range(self.hash_count):

digest = mmh3.hash(item, i) % self.size

digests.append(digest)

self.bit_array[digest] = True

def check(self, item):

for i in range(self.hash_count):

digest = mmh3.hash(item, i) % self.size

if self.bit_array[digest] == False:

return False

return True

def get_size(n, p):

m = -(n * math.log(p)) / (math.log(2) ** 2)

return int(m)

def get_hash_count(m, n):

k = (m/n) * math.log(2)

return int(k)

# 使用Bloom Filter

n = 20 # 预期元素数量

p = 0.05 # 期望的误报率

bf = BloomFilter(n, p)

# 添加元素

bf.add("example")

print(bf.check("example")) # 应该返回True

# 检查不存在的元素

print(bf.check("test")) # 基于误报率,可能返回True,但实际应为False

```

在这个代码示例中,我们使用了`mmh3`库来生成murmurhash哈希值,使用`bitarray`库来高效地处理位数组。需要注意的是,这段代码仅用于演示目的,实际应用中可能需要考虑更多的因素,比如哈希函数的均匀性、位数组的存储效率等。

通过本章节的介绍,我们了解了Bloom Filter的理论基础,并通过实例演示了如何在实际应用中构建和使用Bloom Filter。下一章节,我们将继续探索Reduce Side Join与Bloom Filter结合使用的理论基础与优势,并通过案例进一步展示其应用。

# 4. Reduce Side Join与Bloom Filter的结合

## 4.1 结合的理论基础与优势分析

### 4.1.1 优化数据连接过程的策略

在大数据处理中,数据连接操作是常见的且计算成本较高的操作之一,尤其是当涉及到多个数据源且数据量巨大时。Reduce Side Join是MapReduce框架下解决大规模数据连接问题的一种有效方法。通过利用Bloom Filter的高效过滤能力,可以进一步优化Reduce Side Join过程,减少不必要的数据处理和传输。

Bloom Filter是一种空间效率极高的概率型数据结构,它用于判断一个元素是否在一个集合中。它的优势在于时间复杂度为常数时间(O(k)),空间复杂度小,但有一定误判率。当用于Reduce Side Join时,可以在Map阶段,通过Bloom Filter过滤掉那些明显不在连接键集合中的记录,从而减少需要传递到Reduce阶段的数据量。

### 4.1.2 理论上的性能提升

结合Reduce Side Join和Bloom Filter,理论上可以达到以下几方面的性能提升:

1. **减少数据传输量**:通过在Map阶段使用Bloom Filter,可以剔除那些肯定不会参与连接的记录,这样就减少了Shuffle过程中网络传输的数据量。

2. **降低Reduce任务负载**:由于数据量减少,进入Reduce阶段的数据也会相应减少,从而降低了Reduce任务的计算和内存压力。

3. **提高处理速度**:在减少了数据量的前提下,相应地,Join操作的执行速度也会得到提升。

4. **优化资源使用**:更少的数据传输和更快的处理速度意味着更高效地利用了集群资源,减少了资源浪费。

## 4.2 实践中的应用案例

### 4.2.1 准备数据和环境

为了展示Reduce Side Join与Bloom Filter结合的实际效果,我们首先需要准备相应的大数据集和一个适合的测试环境。通常,我们会选择Hadoop环境来执行MapReduce任务。以下是具体步骤:

1. **数据准备**:准备两个需要连接的数据集,通常是两个HDFS上的大文件。确保这些数据集已经按连接键进行了排序。

2. **环境配置**:搭建Hadoop集群环境,包括NameNode、DataNode、ResourceManager、NodeManager等组件。

3. **代码编写**:编写MapReduce程序,该程序需要实现Map Side的Bloom Filter生成和应用逻辑,以及Reduce Side的连接逻辑。

4. **程序部署**:将编写好的MapReduce程序打包为jar文件,并上传到Hadoop集群中。

### 4.2.2 编写结合Bloom Filter的MapReduce程序

MapReduce程序主要分为Map阶段和Reduce阶段。在结合Bloom Filter的场景下,Map阶段除了传统的Map操作外,还需要进行Bloom Filter的生成和应用。

以下是一个简化的代码示例:

```java

public class JoinWithBloomFilter {

public static class MyMapper extends Mapper<LongWritable, Text, Text, NullWritable> {

// Bloom Filter初始化等逻辑

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 处理输入数据,构建键值对

// 使用Bloom Filter进行检查

// 如果检查通过,则输出键值对

}

}

public static class MyReducer extends Reducer<Text, NullWritable, Text, NullWritable> {

public void reduce(Text key, Iterable<NullWritable> values, Context context) throws IOException, InterruptedException {

// 进行连接操作,并输出结果

}

}

public static void main(String[] args) throws Exception {

// 配置MapReduce作业

// 设置输入输出路径

// 提交作业

}

}

```

在Map阶段,通过Bloom Filter过滤掉不需要参与Join的记录。在Reduce阶段,对于通过过滤的记录,执行实际的连接操作。

### 4.2.3 对比分析实验结果

为了验证结合Bloom Filter的Reduce Side Join的性能提升,我们需要设计实验进行对比分析。

1. **实验设置**:设置不同规模的数据集进行测试,比较在相同硬件条件下,仅使用Reduce Side Join和结合Bloom Filter时的处理时间、网络带宽使用和CPU负载等指标。

2. **数据量对性能的影响**:逐步增加数据量,观察性能指标的变化趋势。

3. **Bloom Filter大小的影响**:改变Bloom Filter的大小和哈希函数数量,分析对整体性能的影响。

4. **结果分析**:根据实验数据,总结Bloom Filter对Reduce Side Join性能提升的贡献。

## 4.3 问题诊断与优化建议

### 4.3.1 常见问题和解决方案

在实施Reduce Side Join与Bloom Filter结合的过程中,可能会遇到一些问题,比如:

1. **Bloom Filter误判导致数据丢失**:可以通过调整Bloom Filter的位数组大小和哈希函数数量来平衡误判率和空间效率。

2. **Map任务不均衡**:确保数据集在Map阶段均匀分配,可以调整分区策略来优化。

3. **网络传输瓶颈**:优化数据格式和压缩方法,减少Shuffle阶段的网络压力。

### 4.3.2 持续性能优化的方向

针对Reduce Side Join与Bloom Filter的结合,以下是一些持续性能优化的方向:

1. **动态调整Bloom Filter参数**:在运行时根据数据集的特性动态调整Bloom Filter的参数,以获得最佳性能。

2. **并行Bloom Filter生成**:并行化Bloom Filter的生成过程,提升效率。

3. **优化数据结构**:探索更高效的Bloom Filter变种,例如Counting Bloom Filter或Scalable Bloom Filter。

4. **智能化的资源管理**:运用机器学习算法,智能地预测和分配集群资源,以响应实时的负载变化。

# 5. 案例研究与未来展望

## 5.1 大数据分析的实际应用案例

在大数据分析的实际应用中,不同行业的数据处理需求各有不同,但都离不开高效、准确的数据处理技术作为支撑。下面,我们将通过两个行业的案例,分析大数据分析技术在实际中的应用。

### 5.1.1 金融行业案例分析

在金融领域,大数据技术被用于风险控制、欺诈检测、客户信用评估等多个方面。以信贷风险管理为例,金融机构需要通过分析客户的信用历史、交易行为等数据,评估贷款风险。通过大数据处理技术,金融机构能够快速整合和处理来自不同渠道的海量数据,利用机器学习模型进行精准的风险预测。例如,某知名银行通过引入Hadoop和Spark等技术,改进其信用评分模型,降低了10%的违约率,显著提升了信贷风险管理的效率和准确性。

### 5.1.2 社交网络数据处理案例

社交网络平台每天产生大量的用户行为数据和交互数据,这些数据对个性化推荐、广告投放、内容审查等方面至关重要。以个性化推荐系统为例,平台需要实时分析用户的社交行为和兴趣偏好,快速提供定制化的信息流。例如,某社交媒体公司通过建立基于Spark的实时处理系统,结合用户画像和行为分析,为用户生成实时推荐列表,使点击率提升了15%。

## 5.2 现有技术的局限性与挑战

尽管大数据技术已经取得了长足的进步,但在某些方面仍有局限性,面临着不同的挑战。

### 5.2.1 机器学习与大数据处理的结合

机器学习的崛起对大数据处理提出了更高的要求。现有的数据处理框架需要更好地支持大规模机器学习算法的运行。例如,模型训练过程中的参数调优、分布式训练和模型更新等问题,都需要更高效的大数据处理策略。当前,为了应对这一挑战,一些研究机构和企业开始探索集成机器学习库到大数据处理框架中,实现更紧密的集成与优化。

### 5.2.2 大数据隐私保护的挑战

随着数据保护法规的加强,如何在不侵犯用户隐私的前提下处理和分析数据成为一大挑战。比如,GDPR法规要求对个人数据进行严格保护。在处理大数据时,实现数据的匿名化和隐私保护成为必经之路。为此,研究人员和工程师正在研究新的技术,如差分隐私和同态加密,以期在保护用户隐私的同时,仍能进行有效的大数据分析。

## 5.3 未来技术发展趋势

随着技术的不断演进,未来的大数据处理技术将面临新的发展趋势和创新方向。

### 5.3.1 分布式系统架构的革新

为了应对日益增长的数据规模和处理需求,分布式系统架构将不断革新。微服务架构、Serverless计算和边缘计算等新型计算范式正在成为业界研究和实践的新焦点。这些架构的优势在于它们提高了系统的可扩展性、弹性和效率,同时降低了开发和运维的复杂度。

### 5.3.2 增强型Bloom Filter的研究方向

Bloom Filter作为一种空间效率极高的概率型数据结构,在大数据场景下有广泛应用前景。未来,研究者将致力于提升Bloom Filter的准确性,减少误报率,例如通过引入计数Bloom Filter或Scalable Bloom Filter等变种。此外,为了适应不断增长的数据量,研究者也将寻求改进Bloom Filter的内存管理机制,使其更加适应大规模数据处理需求。

通过上述案例和分析,我们可以看到,大数据技术在实际应用中的巨大潜力以及未来发展的广阔空间。无论是从技术深度,还是应用广度,大数据处理与分析都将是未来IT行业不断探索和创新的重要领域。

0

0