大数据处理:7种方法教你如何优化Reduce Side Join性能

发布时间: 2024-10-31 16:33:32 阅读量: 17 订阅数: 16

# 1. 大数据处理与Reduce Side Join介绍

在当前信息爆炸的时代,大数据处理已成为IT行业的核心议题之一。大数据不仅指数据量巨大,更涵盖了数据的多样性、速度以及数据价值的复杂性。其中,Reduce Side Join作为大数据处理中一种常见而重要的数据关联方式,在各种业务场景中扮演着关键角色。

## 1.1 Reduce Side Join的定义和作用

Reduce Side Join是MapReduce框架中用于在不同数据集之间执行关联操作的一种技术。其基本思想是将具有共同关联字段的数据分组,然后发送到同一个Reducer节点进行合并。这种方法简单高效,尤其适合处理大量数据的关联操作。

## 1.2 Reduce Side Join的工作原理

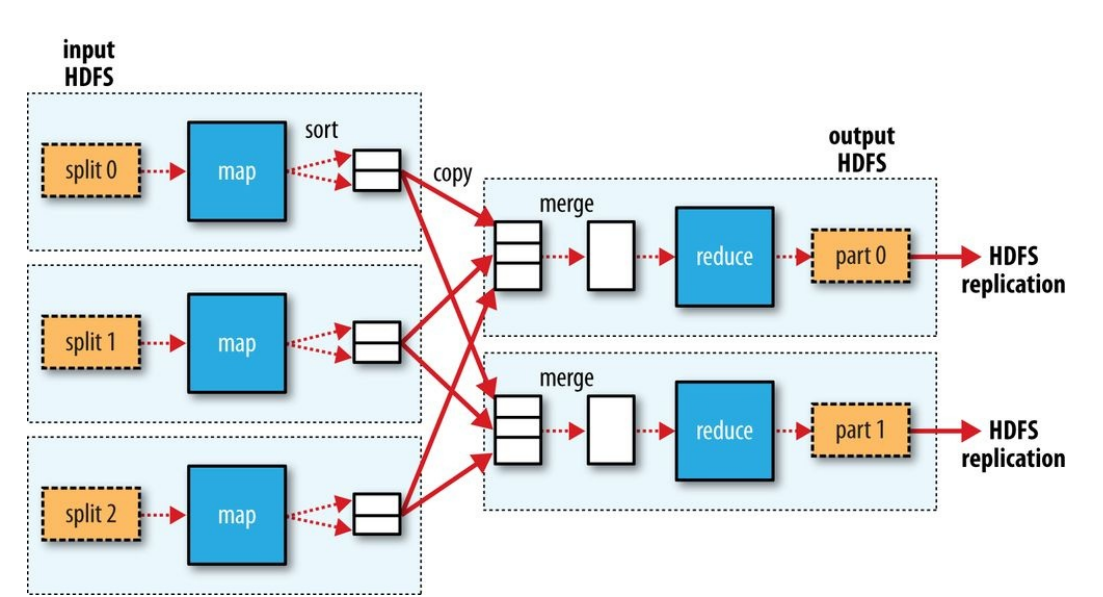

在Reduce Side Join的处理流程中,首先通过Map阶段将输入的数据集进行预处理,输出以关联键为键值对的形式,然后通过Shuffle阶段将具有相同键的所有值聚集到同一个Reducer。在Reduce阶段,根据键值对的键进行排序,最后通过关联操作生成结果。

通过接下来的章节,我们将深入探讨Reduce Side Join的理论基础,并提出一系列优化策略,从而提高数据处理的效率和质量。

# 2. 理论基础

### 2.1 大数据处理概念

#### 2.1.1 大数据的定义和特征

在当今数字化时代,大数据是指那些超出了传统数据处理软件在合理时间内捕获、管理和处理能力的数据集合。大数据具有以下主要特征:

- **体量巨大(Volume)**:数据规模庞大,以TB、PB级别计算。

- **种类繁多(Variety)**:数据类型多样,包括结构化、半结构化和非结构化数据。

- **速度快(Velocity)**:数据生成和处理的速度非常快,需要实时或近实时的处理能力。

- **价值密度低(Value)**:大量数据中蕴含有价值的信息密度相对较低,需要通过分析处理来提取。

- **真实性(Veracity)**:数据质量和准确性的不确定性,需要在处理中进行校验和清洗。

大数据的这五个V特征,要求处理技术不仅能高效地处理大量数据,还要能够灵活应对不同类型的数据,并确保处理过程的实时性。

#### 2.1.2 大数据处理的技术框架

为了解决大数据问题,出现了一系列的大数据处理技术框架,主要包括:

- **批处理框架**,如Hadoop和Spark,用于处理静态数据集,适合大规模数据的批量计算。

- **流处理框架**,如Apache Storm和Apache Flink,用于实时数据流处理,能够对高速产生的数据流进行即时分析。

- **NoSQL数据库**,如HBase、Cassandra和MongoDB,用于存储和处理非关系型的大规模数据集。

- **搜索引擎**,如Elasticsearch和Solr,用于处理和分析存储在大规模文档集合中的数据。

这些框架通过分布式计算、存储和高效的网络通信,实现了对大数据的快速处理和分析。

### 2.2 MapReduce编程模型

#### 2.2.1 MapReduce的工作原理

MapReduce是一种编程模型,用于在集群上进行大规模数据的并行运算。它主要包含两个阶段:Map阶段和Reduce阶段。

- **Map阶段**:输入的数据集被切分成固定大小的块,然后被分配到多个Map任务中并行处理。每个Map任务处理其所在的数据块,将输入数据集中的数据转换成一系列中间的键值对。

- **Reduce阶段**:Map阶段输出的键值对根据键(Key)进行排序和合并,然后分配给Reduce任务。每个Reduce任务负责处理一组具有相同键的值,并将其合并成最终结果。

MapReduce模型通过这种方式,把大规模数据处理问题转化为一系列可并行处理的子问题,大大提高了数据处理的效率和速度。

#### 2.2.2 MapReduce的设计模式

MapReduce的设计模式依赖于其对数据处理的分而治之的原则,具体有以下几种设计模式:

- **Map-only模式**:数据只需通过Map阶段进行处理,适用于只需要映射操作的场景。

- **Map-Side Join模式**:在Map阶段完成数据的关联操作,适用于关联数据集较小的情况。

- **Reduce-Side Join模式**:这是本章节关注的焦点,数据在Map阶段处理后,最终在Reduce阶段完成关联操作。

- **Combiner模式**:在Map和Reduce之间增加一个Combiner操作,用于减少数据传输量和提高处理效率。

每种模式适用于不同的数据处理场景,而选择合适的模式,需要根据具体问题来定。

### 2.3 Reduce Side Join的原理和挑战

#### 2.3.1 Reduce Side Join的工作流程

Reduce Side Join是MapReduce框架下实现数据集之间关联的一种常用方法。其工作流程可概括为以下步骤:

1. **数据预处理**:在Map阶段,根据Join操作的键对每条记录进行标记。

2. **Map阶段**:各Map任务对输入的数据集进行读取和处理,输出格式为键值对。键是Join操作的键,值是包含键值对以及数据来源标识的数据结构。

3. **Shuffle阶段**:框架自动处理数据的排序和分区,为每个键将所有相关的值(值列表)传递到同一个Reduce任务。

4. **Reduce阶段**:每个Reduce任务接收到的键和对应的值列表,按照数据来源进行合并操作,完成数据集之间的Join。

Reduce Side Join适用于数据集较大的情况,可以有效地处理大规模数据的关联问题。

#### 2.3.2 面临的性能瓶颈

尽管Reduce Side Join在处理大规模数据时十分有用,但它也面临一些性能瓶颈:

- **网络I/O压力**:Shuffle阶段数据传输量大,对网络带宽和传输速度要求较高。

- **磁盘I/O压力**:在Map和Reduce阶段,大量的数据读写操作对磁盘I/O造成压力。

- **CPU压力**:数据排序和分区可能带来额外的CPU计算负担。

- **内存压力**:对于小文件和数据倾斜问题,内存使用可能成为瓶颈。

面对这些挑战,进行数据预处理、优化算法和流程、合理分配系统资源,成为了提高Reduce Side Join性能的关键。

通过以上分析,可以看出大数据处理是一个复杂的过程,需要根据数据的特征和处理需求合理选择技术和策略。接下来的章节将深入探讨如何通过具体技术手段优化Reduce Side Join的性能,从而提升大数据处理的效率和效果。

# 3. 优化技巧一:数据预处理

在大数据处理的世界里,数据预处理是优化Reduce Side Join性能的关键步骤。通过有效的数据预处理,我们可以显著减少MapReduce作业的负载,提高数据处理效率,并为后续的处理步骤奠定坚实的基础。

## 3.1 数据清洗和过滤

数据预处理的第一步通常涉及数据清洗和过滤,它确保了参与连接的数据集是准确和有意义的。

### 3.1.1 无效和重复数据的处理

无效数据可能会导致数据处理过程中出现错误,而重复数据则会造成不必要的计算和存储开销。因此,数据清洗过程的首要任务是识别并剔除这些数据。

在这个阶段,我们通常会采用以下几种方法:

- **去除无效记录:** 使用简单的逻辑判断来排除不满足特定条件的数据记录。例如,如果数据集中包含日期字段,我们可以剔除所有日期不合法的记录。

```python

# 假设有一个DataFrame df,其中包含日期字段date

valid_df = df[df['date'].str.match('\d{4}-\d{2}-\d{2}')]

```

- **消除重复项:** 在数据集中查找重复的行,并将它们删除。这可以通过数据框(DataFrame)的 `drop_duplicates()` 方法来实现。

```python

# 删除DataFrame df中的重复行

unique_df = df.drop_duplicates()

```

### 3.1.2 数据格式的统一和转换

数据格式不统一会导致在

0

0