认识AlexNet:深度学习中的里程碑

发布时间: 2024-04-15 03:30:46 阅读量: 161 订阅数: 47

# 1. 深度学习的背景与发展

## 1.1 人工智能和神经网络的兴起

人工智能(AI)是模拟人类智能的机器系统。其历史可追溯至1956年达特茅斯会议。神经网络是一种模仿人脑神经元网络的计算模型。其应用包括图像识别、语音识别等领域。神经网络的概念和技术在人工智能发展中发挥了重要作用。

## 1.2 深度学习的发展历程

单层神经网络的限制促使了深度学习的提出,其强调多层次特征学习。深度学习技术的突破包括更深的网络结构、更有效的训练方法等。深度学习的发展推动了人工智能在各领域的应用,取得了巨大成功和进展。深度学习正逐渐成为人工智能的核心技术。

# 2. 卷积神经网络(CNN)的基础

## 2.1 卷积神经网络的概念和原理

卷积神经网络(CNN)是一种用于处理具有类似网格结构数据的深度学习模型。CNN中最基本的操作是卷积运算和池化操作,通过这些操作可以提取输入数据的特征并逐渐降低数据的空间维度。

### 2.1.1 卷积运算的定义和作用

卷积运算是CNN中的核心操作之一,它通过滑动窗口将输入数据与卷积核进行逐元素相乘并求和的方式,从而得到输出特征图。卷积运算能够有效地提取局部特征,实现特征的共享和参数的复用。

```python

# 示例代码:卷积运算

import numpy as np

def convolution(input_data, kernel):

input_height, input_width = input_data.shape

kernel_height, kernel_width = kernel.shape

output_height = input_height - kernel_height + 1

output_width = input_width - kernel_width + 1

output = np.zeros((output_height, output_width))

for i in range(output_height):

for j in range(output_width):

output[i, j] = np.sum(input_data[i:i+kernel_height, j:j+kernel_width] * kernel)

return output

```

### 2.1.2 池化层的功能和作用

池化层是为了减小特征图的尺寸并保留主要信息而引入的。常见的池化操作包括最大池化和平均池化,通过在局部区域内取最大值或平均值来压缩特征图,减少参数数量和计算复杂度。

## 2.2 卷积神经网络在计算机视觉中的应用

卷积神经网络在计算机视觉领域有着广泛的应用,主要包括图像分类和目标检测等任务。

### 2.2.1 图像分类任务中的CNN应用

在图像分类任务中,CNN可以通过学习图像的局部特征并逐渐组合成全局特征,从而对图像进行分类。经典的LeNet-5和AlexNet等模型在图像分类任务中取得了显著的成绩。

### 2.2.2 目标检测任务中的CNN应用

目标检测是识别图像中不同目标位置和类别的任务,CNN通过在图像上滑动窗口并输出目标的位置和类别来实现目标检测。如R-CNN、Fast R-CNN和Faster R-CNN等模型在目标检测领域有着重要的应用。

```python

# 示例代码:卷积神经网络目标检测

def object_detection(image, model):

# 滑动窗口检测目标

# 返回目标位置和类别

pass

```

### 2.2.3 卷积神经网络中的权重共享机制

权重共享是CNN的一个重要特点,即多个神经元共享同一组参数。通过权重共享,CNN可以减少参数数量,降低过拟合风险,并且提高模型的泛化能力。

综上所述,卷积神经网络通过卷积运算和池化操作来提取特征,广泛应用于计算机视觉领域,实现图像分类和目标检测等任务。权重共享机制有效地减少参数数量,提高模型的效率和泛化能力。

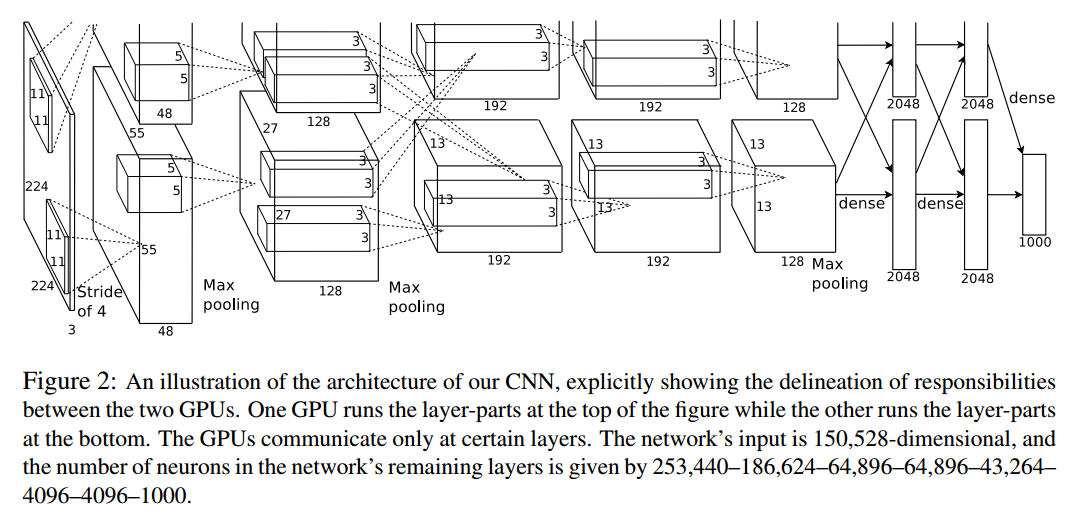

# 3.1 AlexNet的架构与创新

AlexNet 是由 Alex Krizhevsky 等人在2012年提出的深度卷积神经网络,它在当时的 ImageNet 挑战赛上取得了巨大成功,影响深远。 AlexNet 的架构和创新点使得它成为后续深度学习模型的重要里程碑。

### 3.1.1 AlexNet网络结构的设计

AlexNet的网络结构包含5层卷积层和3层全连接层组成,其中卷积层和全连接层交替出现。在卷积层中,AlexNet使用了ReLU激活函数,取代了当时常用的Sigmoid函数,加速训练过程。同时,AlexNet引入了Dropout层,减少了模型的过拟合现象。另外,AlexNet在池化层中采用了最大池化的方式,减少了模型对位置的敏感度。

### 3.1.2 AlexNet中的激活函数及其作用

在 AlexNet 中,激活函数起着至关重要的作用,它能够引入非线性因素,帮助神经网络更好地拟合复杂的数据。相比于Sigmoid函数,ReLU激活函数能够加速网络的收敛速度,避免梯度消失问题,同时减少了训练时间。AlexNet中采用的ReLU激活函数为整个深度学习领域后续模型的发展奠定了基础。

### 3.1.3 AlexNet中的正则化方法与优化策略

为了防止模型过拟合,AlexNet引入了Dropout层,通过随机将神经元置零的方式,降低模型复杂度,提高泛化能力。此外,AlexNet还使用了数据增强的方法,通过对训练数据进行旋转、翻转等操作,增加了训练数据集的多样性,进一步提升模型泛化能力。

```python

# 在代码中实现Dropout层

class Dropout:

def __init__(self, dropout_ratio):

self.dropout_ratio = dropout_ratio

self.mask = None

def forward(self, x, train_flg=True):

if train_flg:

self.mask = np.random.rand(*x.shape) > self.dropout_ratio

return x * self.mask

else:

return x * (1.0 - self.dropout_ratio)

def backward(self, dout):

return dout * self.mask

```

# 3.2 AlexNet在图像分类中的突破

AlexNet 在 ImageNet 大规模视觉识别挑战赛(ILSVRC)中取得了惊人的成绩,将深度学习推向了广泛关注的高潮。其在图像分类任务中的突破性表现,彻底改变了人们对于深度学习的认知。

### 3.2.1 ImageNet挑战赛上的成绩

在 2012 年的 ImageNet 挑战赛中,AlexNet凭借其出色的性能一举夺冠,将错误率下降到了当时已经相当低的15%左右,远超第二名的竞争对手。这一成绩震撼了整个计算机视觉领域,证明了深度学习在图像分类任务上的巨大潜力。

### 3.2.2 AlexNet对深度学习发展的影响和意义

AlexNet的问世,极大地推动了深度学习领域的发展,使得更多研究者开始关注深度学习的潜力。它引领了卷积神经网络的热潮,促进了深度学习技术在各个领域的普及和应用。

### 3.2.3 AlexNet为后续深度学习模型的启示

AlexNet的成功启示了后续深度学习模型的设计和优化方向,如更深的网络结构、更有效的激活函数、更合理的正则化方法等。同时,AlexNet证明了深度学习模型的复杂性并不是阻碍其发展的障碍,而是深度学习技术无限可能的前奏。

```mermaid

graph TD;

A[Image Input] --> B[Convolutional Layer]

B --> C[ReLU Activation]

C --> D[Max Pooling]

D --> E[Convolutional Layer]

E --> F[ReLU Activation]

F --> G[Max Pooling]

G --> H[Flatten]

H --> I[Fully Connected Layer]

I --> J[Softmax Output]

```

以上是对AlexNet在图像分类任务中取得突破的详细介绍,展示了其网络架构和对深度学习发展的重要意义。AlexNet在当今深度学习领域仍具有深远的影响,为后续模型的发展提供了重要的参考。

# 4. 深度学习在未来的发展趋势

## 4.1 强化学习和深度学习的结合

强化学习是一种机器学习方法,通过代理程序在与环境交互中学习如何采取行动来达到既定的目标。在深度学习的驱动下,强化学习得到了广泛关注并取得了许多突破。强化学习的基本原理是代理程序通过尝试不同的行动,观察环境的反馈(奖励或惩罚),并调整行为以最大化长期奖励。

### 4.1.1 强化学习的基本原理与应用领域

强化学习的基本原理包括状态、行动、奖励和策略。状态表示环境的特定情况,行动是代理程序的决策,奖励是代理程序获得的反馈,策略指代代理程序在特定状态下采取行动的概率分布。

```python

def reinforce_learning(state, action, reward, next_state):

# 强化学习算法示例

# 在此处编写强化学习算法的具体实现

pass

```

### 4.1.2 深度强化学习中的挑战与前景

深度强化学习结合了深度学习和强化学习的优势,但也面临着训练复杂、样本利用不足等挑战。未来,深度强化学习有望在智能游戏、机器人控制、金融交易等领域取得更大突破。

### 4.1.3 深度学习与自然语言处理的结合

深度学习在自然语言处理中的应用已经取得了显著进展,如机器翻译、文本分类、情感分析等任务。结合强化学习的方法可以进一步提升自然语言处理模型的表现,为智能对话、智能客服等领域带来新的可能性。

## 4.2 可解释性AI和模型压缩

随着深度学习模型变得越来越复杂,可解释性AI和模型压缩成为了研究的热点。可解释性AI旨在让人类能够理解AI模型的决策过程,而模型压缩则旨在减少模型的复杂度,提高模型的效率和泛化能力。

### 4.2.1 AI模型的可解释性和透明性

AI模型的可解释性是指人们能够理解模型的输入特征对输出结果的影响程度。透明性可以帮助人们更好地信任AI系统并发现可能存在的偏见或错误。

```java

// 可解释性AI示例代码

public void explainableAI(Model model, Input input) {

// 在此处实现模型的可解释性分析

}

```

### 4.2.2 模型压缩技术在深度学习中的应用

模型压缩技术包括剪枝、量化、蒸馏等方法,通过减少模型参数和计算量来提高模型的运行效率。模型压缩可以使模型在边缘设备上运行更加高效,同时减少模型的能耗。

```javascript

// 模型压缩示例代码

function modelCompression(model) {

// 在此处实现模型压缩算法

}

```

### 4.2.3 迁移学习和领域适应性的研究方向

迁移学习和领域适应性可以帮助在不同任务或领域中重复利用已训练好的模型,从而减少训练时间和数据量。这些技术有望进一步推动深度学习在现实世界中的应用。

## 结论:深度学习的未来展望

深度学习在各个领域的应用前景广阔,随着技术的不断进步,深度学习将会在医疗、金融、农业等领域发挥越来越重要的作用。技术的发展不仅为社会带来了巨大利益,也带来了一些挑战和伦理问题,如隐私保护、数据安全等,需要我们在发展的同时保持警惕。

# 5. 卷积神经网络的应用案例

## 5.1 图像风格转换案例分析

卷积神经网络在图像风格转换方面有着广泛的应用。通过将一幅图像的内容与另一幅图像的风格相结合,可以生成具有新颖艺术效果的图像。下表展示了图像风格转换案例中使用的一些常见数据集:

| 数据集名称 | 描述 |

|--------------|-----------------------------------------|

| COCO Dataset | 包含各种日常场景图像的数据集,用于内容提取 |

| Wikiart | 包含各种艺术风格的图像,用于风格提取 |

| MSCOCO-Full | 结合了上述两个数据集,用于训练图像风格转换模型 |

图像风格转换的过程可以简要描述为以下步骤:

1. 加载内容图像和风格图像;

2. 使用预训练的卷积神经网络模型(如VGG19)提取内容图像和风格图像的特征表示;

3. 定义损失函数,包括内容损失和风格损失;

4. 通过梯度下降等优化算法,最小化总损失函数以生成新的图像。

```python

# 伪代码示例:图像风格转换

content_image = load_image('content.jpg')

style_image = load_image('style.jpg')

# 使用预训练模型提取特征

content_features = vgg19(content_image)

style_features = vgg19(style_image)

# 定义损失函数

content_loss = calculate_content_loss(content_features, generated_features)

style_loss = calculate_style_loss(style_features, generated_features)

total_loss = content_loss + style_loss

# 优化生成图像

generated_image = optimize(total_loss)

```

## 5.2 目标检测案例研究

卷积神经网络在目标检测任务中也有着重要的应用,尤其是物体识别、定位和类别预测等方面。常用的目标检测数据集包括:

- VOC Dataset:包含20个类别的物体图像,用于目标检测和语义分割任务;

- MS COCO:包含80个类别的物体图像,用于复杂场景下的目标检测。

目标检测的流程主要包括以下步骤:

1. 加载标注数据集和预训练的卷积神经网络模型(如Faster R-CNN);

2. 在模型中添加检测头部用于预测边界框和类别;

3. 定义损失函数,包括边界框回归损失和类别预测损失;

4. 通过迭代训练,优化模型参数以提高检测准确性。

流程图如下所示:

```mermaid

graph LR

A[加载数据集和预训练模型] --> B{添加检测头部}

B --> C[定义损失函数]

C --> D[优化模型参数]

D --> E[测试模型性能]

```

通过图像风格转换案例和目标检测案例的介绍,可以看出卷积神经网络在计算机视觉和图像处理领域的广泛应用,为深度学习技术的发展提供了重要的支持与推动。

0

0