【LSTM情感分析实战指南】:从入门到精通

发布时间: 2024-08-21 20:11:12 阅读量: 14 订阅数: 13

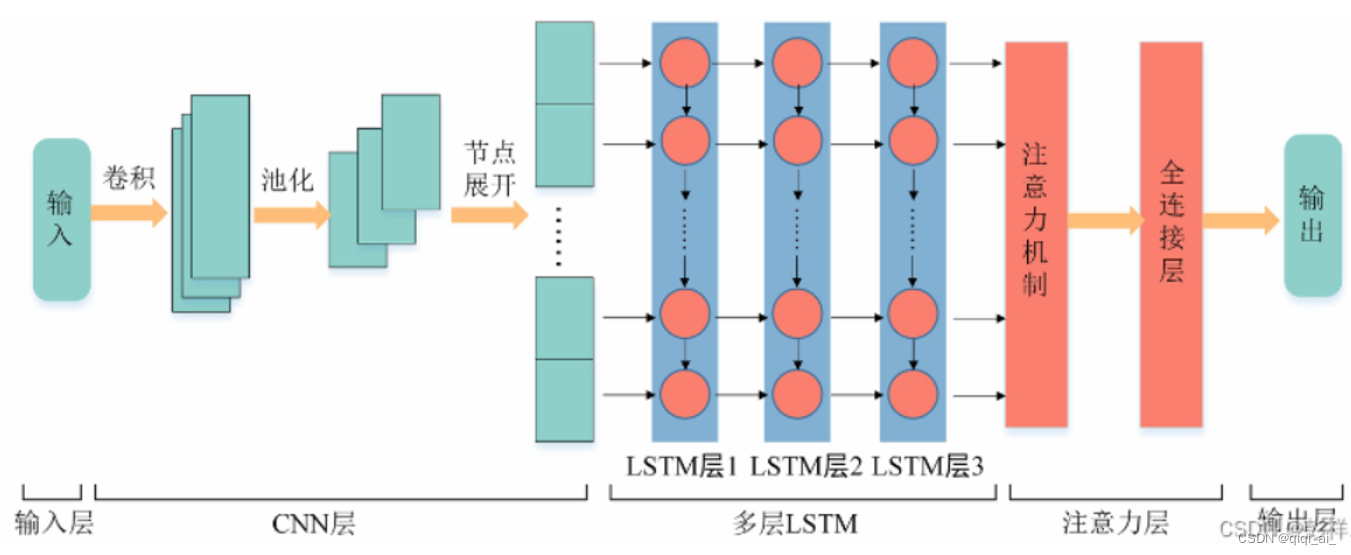

# 1. LSTM神经网络基础**

LSTM(长短期记忆)是一种循环神经网络,专门用于处理序列数据。它通过引入记忆单元来解决传统RNN中长期依赖关系消失的问题。

LSTM记忆单元由输入门、遗忘门和输出门组成。输入门控制新信息的流入,遗忘门控制旧信息的遗忘,输出门控制单元输出的信息。通过这种机制,LSTM可以有效地学习和记住长期依赖关系。

# 2. LSTM情感分析理论

### 2.1 LSTM网络结构与工作原理

**LSTM(长短期记忆网络)**是一种循环神经网络(RNN),专门设计用于处理序列数据,例如文本或时间序列。与传统的RNN不同,LSTM具有记忆单元,可以捕获序列中的长期依赖关系。

LSTM网络由以下组件组成:

- **输入门:**决定将哪些新信息添加到记忆单元中。

- **遗忘门:**决定从记忆单元中丢弃哪些现有信息。

- **记忆单元:**存储有关序列的长期信息。

- **输出门:**决定从记忆单元中输出哪些信息。

LSTM网络的工作原理如下:

1. **输入门:**接收当前输入和前一时刻的隐藏状态,并生成一个更新向量。

2. **遗忘门:**接收当前输入和前一时刻的隐藏状态,并生成一个遗忘向量。

3. **记忆单元:**使用更新向量和遗忘向量更新其值。

4. **输出门:**接收当前输入和前一时刻的隐藏状态,并生成一个输出向量。

5. **隐藏状态:**将输出向量与前一时刻的隐藏状态相结合,形成当前时刻的隐藏状态。

### 2.2 情感分析中的LSTM应用

LSTM网络在情感分析中得到了广泛应用,因为它能够捕获文本序列中的长期依赖关系。例如,一个句子中单词的顺序和上下文对理解句子的情感非常重要。

LSTM网络可以用来执行以下情感分析任务:

- **情感分类:**将文本分类为积极、消极或中性。

- **情感强度分析:**确定文本的情感强度,例如从非常消极到非常积极。

- **情感主题提取:**识别文本中讨论的情感主题。

代码块:

```python

import tensorflow as tf

# 创建LSTM模型

model = tf.keras.models.Sequential()

model.add(tf.keras.layers.LSTM(128, return_sequences=True, input_shape=(None, 10)))

model.add(tf.keras.layers.LSTM(64))

model.add(tf.keras.layers.Dense(3, activation='softmax'))

# 编译模型

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(X_train, y_train, epochs=10)

```

逻辑分析:

该代码块创建了一个LSTM模型,用于情感分类。模型由两个LSTM层和一个密集层组成。第一个LSTM层具有128个单元,并返回序列。第二个LSTM层具有64个单元。密集层具有3个单元,对应于积极、消极和中性类别。模型使用Adam优化器和分类交叉熵损失函数进行编译。

参数说明:

- `return_sequences=True`:指示LSTM层返回序列,而不是单个向量。

- `input_shape=(None, 10)`:指定输入数据的形状,其中`None`表示可变长度序列,10表示每个序列中特征的数量。

- `activation='softmax'`:指定密集层的激活函数,用于多类分类。

# 3.1 数据预处理与特征提取

**数据预处理**

数据预处理是情感分析中的关键步骤,其目的是将原始文本数据转换为模型可理解的格式。以下是一些常见的数据预处理步骤:

- **分词和词干化:**将句子分割成单词,并将其归约为其词根形式。这有助于减少词汇表的大小并提高模型的泛化能力。

- **去除停用词:**移除常见的非信息性单词,如“the”、“and”、“of”,这些单词不会对情感分析产生重大影响。

- **词性标注:**识别单词的词性,如名词、动词、形容词。这有助于模型理解单词在句子中的作用。

- **文本归一化:**将文本转换为小写,并移除标点符号和特殊字符。这有助于提高模型的鲁棒性。

**特征提取**

特征提取是将预处理后的文本数据转换为模型可用的数值表示的过程。以下是一些常用的特征提取方法:

- **词袋模型 (BoW):**将文本表示为单词出现的频率或存在与否。这是一种简单且有效的特征提取方法,但它忽略了单词的顺序和上下文。

- **TF-IDF:**一种加权 BoW 模型,其中单词的权重由其在文本中出现的频率和在整个语料库中出现的频率决定。这有助于突出文本中重要的单词。

- **词嵌入:**将单词表示为稠密向量,其中每个维度表示单词的语义信息。这允许模型捕获单词之间的关系和相似性。

**代码块:**

```python

import nltk

from nltk.corpus import stopwords

from nltk.stem import PorterStemmer

from sklearn.feature_extraction.text import CountVectorizer

# 加载文本数据

text_data = ["I love this movie!", "This movie is terrible!"]

# 分词和词干化

stemmer = PorterStemmer()

tokenized_data = [stemmer.stem(word) for word in nltk.word_tokenize(" ".join(text_data))]

# 去除停用词

stop_words = set(stopwords.words('english'))

filtered_data = [word for word in tokenized_data if word not in stop_words]

# 提取词袋模型特征

vectorizer = CountVectorizer()

features = vectorizer.fit_transform(filtered_data)

# 打印特征

print(vectorizer.get_feature_names_out())

print(features.toarray())

```

**逻辑分析:**

此代码演示了数据预处理和特征提取的过程。它使用 NLTK 库进行分词、词干化和去除停用词。然后,它使用 scikit-learn 库的 CountVectorizer 提取词袋模型特征。输出的特征是一个稀疏矩阵,其中行表示文档,列表示单词,值表示单词在文档中出现的次数。

**参数说明:**

- `text_data`:要预处理和提取特征的文本数据列表。

- `stemmer`:用于词干化的词干器对象。

- `stop_words`:要从文本中去除的停用词集合。

- `vectorizer`:用于提取词袋模型特征的 CountVectorizer 对象。

# 4.1 LSTM模型的超参数调优

超参数调优对于优化LSTM情感分析模型的性能至关重要。以下是一些关键超参数及其调优策略:

### 学习率

学习率控制着模型权重在每次迭代中的更新幅度。较高的学习率可能导致模型不稳定或发散,而较低的学习率可能导致训练缓慢。通常,学习率从0.001到0.01之间进行调优。

```python

# 设置学习率

optimizer = tf.keras.optimizers.Adam(learning_rate=0.001)

```

### 隐藏层单元数

隐藏层单元数决定了模型的复杂性。单元数过多可能导致过拟合,而单元数太少可能导致欠拟合。通常,隐藏层单元数从64到512之间进行调优。

```python

# 设置隐藏层单元数

model = tf.keras.Sequential([

tf.keras.layers.LSTM(units=128, return_sequences=True),

tf.keras.layers.LSTM(units=128),

tf.keras.layers.Dense(units=1, activation='sigmoid')

])

```

### 批大小

批大小控制着每次迭代中训练模型的样本数量。较大的批大小可以提高训练效率,但可能导致梯度估计不稳定。较小的批大小可以提高梯度估计的稳定性,但可能导致训练速度变慢。通常,批大小从32到256之间进行调优。

```python

# 设置批大小

train_dataset = train_dataset.batch(batch_size=64)

```

### 退出条件

退出条件控制着训练过程的停止时间。通常,训练过程在达到以下条件之一时停止:

* **最大训练周期:**指定训练的最大周期数。

* **最小损失:**指定训练损失达到某个阈值时停止。

* **验证集准确率:**指定验证集准确率达到某个阈值时停止。

```python

# 设置退出条件

callbacks = [

tf.keras.callbacks.EarlyStopping(patience=5, restore_best_weights=True)

]

```

### 优化器

优化器控制着模型权重的更新方式。常用的优化器包括:

* **Adam:**一种自适应优化器,可以自动调整学习率。

* **RMSprop:**一种自适应优化器,可以防止梯度爆炸。

* **SGD:**一种随机梯度下降优化器,需要手动调整学习率。

```python

# 设置优化器

optimizer = tf.keras.optimizers.Adam(learning_rate=0.001)

```

### 激活函数

激活函数控制着神经元输出的非线性关系。常用的激活函数包括:

* **ReLU:**整流线性单元,对于正输入输出线性,对于负输入输出0。

* **sigmoid:**逻辑函数,输出范围为0到1。

* **tanh:**双曲正切函数,输出范围为-1到1。

```python

# 设置激活函数

model = tf.keras.Sequential([

tf.keras.layers.LSTM(units=128, return_sequences=True, activation='relu'),

tf.keras.layers.LSTM(units=128, activation='relu'),

tf.keras.layers.Dense(units=1, activation='sigmoid')

])

```

# 5.1 社交媒体情感分析

社交媒体平台上充斥着大量的用户生成内容,这些内容包含丰富的用户情绪和观点。利用LSTM模型进行社交媒体情感分析,可以深入了解用户对品牌、产品或事件的看法,从而为企业提供宝贵的市场洞察。

### 5.1.1 数据获取与预处理

社交媒体情感分析的第一步是收集和预处理数据。常用的数据源包括Twitter、Facebook和Instagram。数据收集可以通过API或第三方工具进行。

预处理过程包括:

- **数据清洗:**去除重复数据、无效数据和噪声数据。

- **分词:**将文本内容分割成一个个单词或词组。

- **词干提取:**将单词还原为其基本形式,去除词缀。

- **停用词去除:**去除无意义的单词,如介词和连词。

### 5.1.2 LSTM模型构建

构建LSTM模型用于社交媒体情感分析时,需要考虑以下参数:

- **层数:**LSTM网络的层数决定了模型的复杂度。一般来说,层数越多,模型的性能越好,但计算成本也更高。

- **隐藏层单元数:**隐藏层单元数决定了模型的容量。单元数越多,模型可以学习更复杂的特征。

- **激活函数:**激活函数决定了神经元的输出。常用的激活函数包括sigmoid、tanh和ReLU。

### 5.1.3 模型训练与评估

模型训练过程中,需要使用带标签的数据集。标签可以是二分类(正面/负面)或多分类(正面/中性/负面)。

训练完成后,使用验证集对模型进行评估。常用的评估指标包括准确率、召回率和F1分数。

### 5.1.4 实战应用

训练好的LSTM模型可以用于各种社交媒体情感分析任务,例如:

- **品牌监测:**跟踪和分析用户对品牌的看法,及时发现潜在的危机或机遇。

- **产品评论分析:**收集和分析用户对产品的评论,了解用户需求和改进方向。

- **舆情分析:**监测和分析社交媒体上的舆论趋势,了解公众对特定事件或话题的看法。

0

0