【版本控制与快照】:HDFS功能详解与性能优化

发布时间: 2024-10-28 02:24:40 阅读量: 4 订阅数: 8

# 1. HDFS基础和分布式存储概念

## HDFS的基本概念

Hadoop分布式文件系统(HDFS)是Hadoop生态系统的核心组件,用于在跨多个物理节点的分布式环境中存储大数据。它是高度容错的,旨在在廉价硬件上部署。HDFS的主要特性是它能提供高吞吐量的数据访问,特别适合大规模数据集的应用。

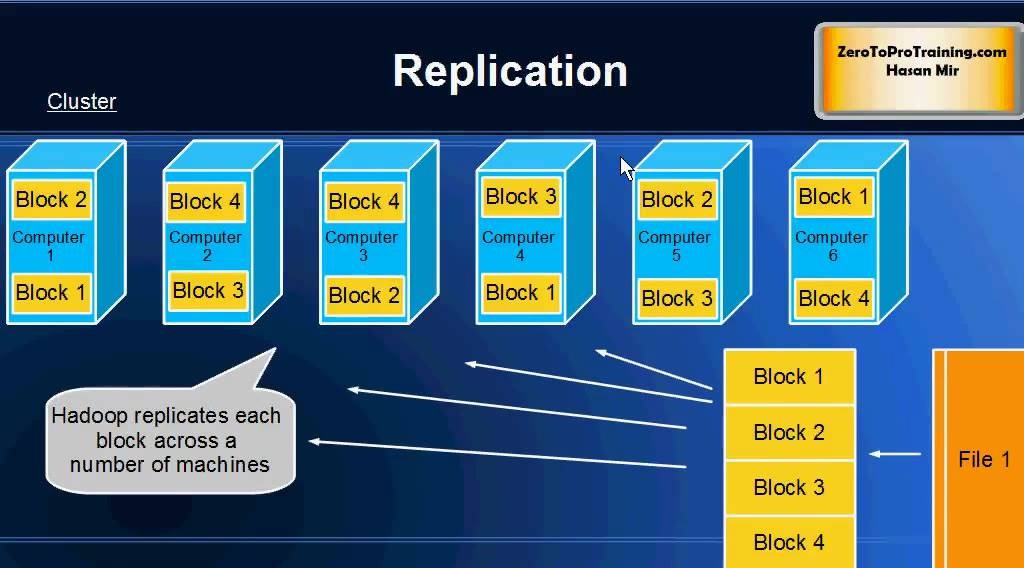

## 分布式存储的基本原理

分布式存储系统的设计允许数据在多个服务器之间分散存储,而不是集中在一个服务器上。这种设计减少了单点故障的可能性,提高了系统的可靠性和可扩展性。HDFS通过数据块的分布式存储、复制和数据恢复策略,确保了即使在硬件故障的情况下,数据的完整性和访问性也能得到保障。

## HDFS在现代IT架构中的作用

在现代IT架构中,HDFS承担着大数据存储与管理的关键角色。它通常与Hadoop生态系统中的其他组件,如HBase, Hive等一起工作,为数据科学家、分析师提供了一个强大的数据分析和处理平台。HDFS提供了一个可扩展的存储解决方案,让企业可以有效地收集、存储和分析海量数据集,从而获得商业洞察和优化运营。

这一章节为您深入浅出地介绍了HDFS的基础知识,以及它作为分布式存储解决方案在现代企业IT架构中的重要性。接下来的章节将深入探讨HDFS的版本控制机制和快照功能,以及如何优化HDFS性能并运用HDFS解决实际问题。

# 2. HDFS版本控制机制

## 2.1 HDFS文件系统中的版本控制原理

### 2.1.1 版本控制的历史背景和必要性

版本控制在计算机文件中是一个管理对文件或数据集的不同版本的机制。在早期,版本控制主要用于跟踪和管理源代码的变更,以帮助开发者在多人协作的软件开发环境中协同工作。随着技术的发展,版本控制的应用已经扩展到数据管理领域,尤其是在大数据存储系统如Hadoop的分布式文件系统HDFS中。

数据版本控制的必要性可以从几个方面理解:

1. 数据的可靠性:在数据更新过程中,可能会遇到错误或异常,保留旧版本的数据可以确保数据的可靠性。

2. 数据恢复:在数据被意外删除或损坏时,能够从旧版本恢复数据是至关重要的。

3. 协作:在多人编辑同一个文件时,版本控制可以保证所有用户的更改都被记录和追踪,避免数据丢失。

### 2.1.2 HDFS中的版本控制实现细节

HDFS中的版本控制机制是通过保留文件的多个副本(版本)来实现的。当一个文件被更新时,HDFS不会立即覆盖旧文件,而是保留旧文件的副本,并创建一个新的文件副本。这样的机制为文件的历史版本提供了备份,并允许用户在需要时访问旧版本。

HDFS的版本控制主要通过以下几个方面来实现:

1. **版本号**:每个文件或目录都有一个与之关联的版本号,每次修改操作都会增加这个版本号。

2. **时间戳**:每个版本都有一个时间戳,记录了该版本创建的时刻。

3. **存储策略**:HDFS使用特定的存储策略来管理不同版本的数据,这包括决定保留多少个版本、如何存储这些版本等。

## 2.2 HDFS版本控制的操作实践

### 2.2.1 基本的版本控制命令

HDFS提供了版本控制相关的命令来管理和操作文件版本。以下是几个基础命令的例子:

```sh

hadoop fs -versionz <path> # 列出指定文件的所有版本

hadoop fs -getversion <path> <version> # 获取指定版本的文件

```

使用这些命令时,需要指定文件的路径和需要操作的版本号。例如,列出`/user/hadoop/file.txt`的所有版本,使用命令`hadoop fs -versionz /user/hadoop/file.txt`。

### 2.2.2 版本比较和回滚操作

版本比较可以帮助用户识别不同版本之间的差异。HDFS提供了如下命令来比较文件版本:

```sh

hadoop fs -diffz <path> <version1> <version2>

```

而回滚操作则是将文件恢复到之前的某个版本。如下命令可实现回滚操作:

```sh

hadoop fs -setversion <path> <version>

```

### 2.2.3 版本控制与数据一致性

版本控制机制引入了数据一致性的新挑战。如何确保用户读取的是正确的版本,以及系统如何处理并发操作,这些都是HDFS版本控制需要解决的问题。HDFS利用事务日志和元数据来维护数据的一致性,并确保在并发环境下,不同用户对文件版本的操作不会互相干扰。

## 2.3 HDFS版本控制的高级特性

### 2.3.1 快照的创建、管理与恢复

除了基本的版本控制之外,HDFS还支持快照功能。快照是一种用于备份数据的机制,它提供了一个数据集在特定时间点的状态视图。创建快照的命令如下:

```sh

hdfs dfsadmin -allowSnapshot <path>

hdfs dfs -createSnapshot <path> [<snapshotName>]

```

快照的恢复可以通过以下命令完成:

```sh

hdfs dfs -restoreSnapshot <path> <snapshotName>

```

### 2.3.2 版本控制在数据备份中的应用

版本控制的机制极大地简化了数据备份和恢复的过程。在数据备份的场景中,保留一个文件的多个版本可以作为一种备份策略。这样,即使原文件被意外覆盖或删除,也总是有旧版本可以恢复。HDFS中实现备份策略时,需要考虑以下几个关键点:

- **保留策略**:确定保留多少个旧版本、保留多久等。

- **备份频率**:定期备份还是在文件更新时自动备份。

- **资源消耗**:版本控制会增加存储空间的使用,需要合理规划存储资源。

通过这些高级特性的实施,HDFS的版本控制不仅能够提供数据保护,还能在数据备份与恢复方面提供强大的支持。

接下来,我们将进一步深入了解HDFS的快照功能。

# 3. HDFS快照功能深入

0

0