Hadoop文件系统容错性:pull与get过程故障转移策略的专业分析

发布时间: 2024-10-28 04:12:35 阅读量: 32 订阅数: 25

# 1. Hadoop文件系统简介与容错性基础

## 1.1 Hadoop文件系统简介

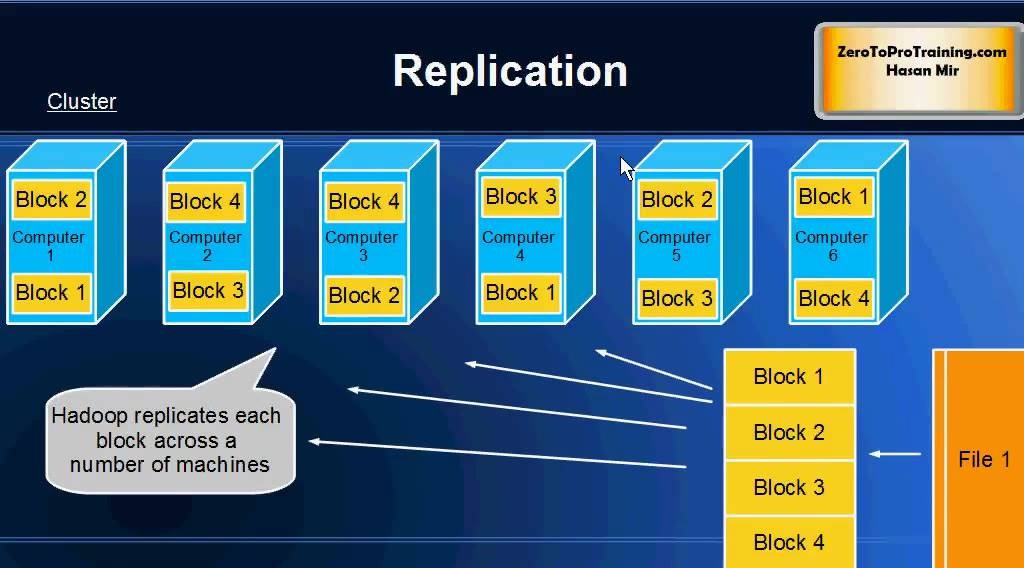

Hadoop分布式文件系统(HDFS)是Hadoop的核心组件之一,它是一个高度容错的系统,设计用来部署在廉价的硬件上。HDFS能提供高吞吐量的数据访问,非常适合大规模数据集的应用。它通过在多个服务器上存储数据的多个副本来提供高可用性和容错性。在HDFS中,文件被分成一个或多个块,这些块被存储在集群的不同节点上。

## 1.2 Hadoop的容错性基础

Hadoop的容错性设计主要是通过数据的冗余存储来实现的。它通过创建数据副本并分散存储在不同的数据节点上来防止数据丢失。当某个数据节点发生故障时,Hadoop可以在其他节点上找到数据的副本,从而保证了计算和存储的连续性。此外,Hadoop还提供了心跳检测、数据校验和自动故障转移等机制来增强其容错性。

```java

// 示例代码:HDFS文件写入流程

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path path = new Path("hdfs://namenode/path/to/file");

FSDataOutputStream out = fs.create(path, new Progressable() {

public void progress() {

System.out.println("Upload progress");

}

});

// 写入数据

out.write(...);

out.close();

```

在这个示例代码中,`FileSystem.create` 方法创建了一个HDFS上的文件,并通过 `FSDataOutputStream` 写入数据。HDFS自动处理数据的复制和存储。容错机制确保在任何单点失败的情况下,数据依然可用。

# 2. Hadoop的pull过程与故障转移策略

## 2.1 Hadoop文件系统中的pull过程解析

### 2.1.1 pull过程的工作原理

Hadoop分布式文件系统(HDFS)中的pull过程是数据读取的核心,涉及客户端与HDFS集群之间的数据交互。在pull过程中,客户端向NameNode发送请求,以获取所需文件的块列表。NameNode则返回块所在的DataNode地址。接着,客户端直接与相应的DataNode通信,以流的形式读取数据块。数据在传输过程中会被分成多个包,并通过校验和进行验证,确保数据的完整性。

在pull过程中,HDFS采取了懒加载的数据读取策略,这意味着数据只有在实际需要时才从DataNode读取,而不需要事先全部加载到内存中,有效降低了内存的消耗。同时,该策略在实现上也考虑了数据传输的优化,使用了管道(pipeline)方式,客户端可以连续从多个DataNode读取数据块,而不是逐个读取,这样能够大大提高读取效率。

```java

// Java伪代码示例,演示客户端如何向DataNode发送数据读取请求

DFSClient dfsClient = ... // 获取DFSClient实例

LocatedBlock locatedBlock = dfsClient.locateBlock(blockPath); // 定位数据块位置

DFSInputStream inputStream = dfsClient.open(blockPath); // 打开文件输入流

byte[] buffer = new byte[1024]; // 初始化缓冲区

int bytesRead;

while ((bytesRead = inputStream.read(buffer)) != -1) {

// 处理读取到的数据块

}

```

在上述代码块中,我们模拟了客户端读取数据块的过程。其中,`DFSClient.locateBlock` 方法用于定位数据块位置,返回一个 `LocatedBlock` 对象,它包含了数据块所在的DataNode列表。`DFSClient.open` 方法用于打开文件输入流,并开始读取数据。这个过程展示了pull过程中的核心操作。

### 2.1.2 影响pull过程的关键因素

在pull过程中,影响性能和稳定性的关键因素有很多。首要的是网络带宽和延迟,它们直接决定了数据的传输效率。其次,DataNode的负载也至关重要,高负载的DataNode可能会导致读取延迟增加。此外,系统的硬件配置,包括磁盘I/O性能和CPU速度,也会影响pull过程的效率。

在设计HDFS时,为了提高容错性和可扩展性,Hadoop引入了数据副本的概念。因此,副本数(replication factor)也是影响pull过程的一个重要因素。副本数设置得过高会增加存储成本,设置得太低又可能影响数据的可靠性。最后,客户端读取模式(例如随机访问或顺序访问)也会影响pull过程,因为它们对数据块的局部性和访问频率有不同的影响。

```markdown

| 影响因素 | 说明 |

| -------------- | ------------------------------------------------------------ |

| 网络带宽 | 数据传输的速率,高带宽有助于快速传输大量数据 |

| 延迟 | 网络传输的时间延迟,影响读取性能 |

| DataNode负载 | DataNode处理读取请求的能力,高负载会导致读取延迟 |

| 硬件配置 | 包括磁盘I/O性能和CPU速度,直接影响读取性能 |

| 副本数 | 数据副本的复制品数量,影响数据的可靠性和存储成本 |

| 读取模式 | 客户端访问数据的模式,影响数据局部性和访问频率 |

```

## 2.2 pull过程的故障检测机制

### 2.2.1 节点故障的识别方法

HDFS在pull过程中,需要有效地检测和响应节点故障。故障检测主要依赖于心跳机制和数据块报告。DataNode会定期向NameNode发送心跳消息,报告其健康状态和存储的数据块信息。如果NameNode在指定时间内没有收到某个DataNode的心跳,它会将该节点标记为宕机。此外,DataNode还会发送数据块报告,供NameNode检查数据块的副本数是否符合要求。

```mermaid

graph LR

A[DataNode] -->|心跳消息| B[NameNode]

A -->|数据块报告| B

B --> C{是否宕机?}

C -->|是| D[标记宕机]

C -->|否| E[保持正常状态]

```

### 2.2.2 故障响应和通知机制

一旦节点被标记为宕机,HDFS会触发一系列故障响应和通知机制。首先,NameNode会从文件系统的元数据中移除宕机节点的数据块记录,并启动数据块的复制过程,从其他健康的DataNode中复制缺失的数据块。接着,NameNode会通知所有客户端宕机节点上的数据块不再有效,客户端应从其他节点重新获取数据块。

在客户端侧,当读取过程中发现数据块不可用时,

0

0