Hadoop数据拉取优化:提升pull过程效率与稳定性的专家策略

发布时间: 2024-10-28 03:31:10 阅读量: 3 订阅数: 5

# 1. Hadoop数据拉取基础

在大数据处理领域,Hadoop凭借其强大的分布式存储与计算能力,已成为处理海量数据的标准框架之一。数据拉取作为Hadoop数据处理流程中的重要一环,它的效率直接关系到整个系统的性能表现。本章我们将从Hadoop数据拉取的基础知识开始,为读者深入理解后续章节中的高级概念打下坚实基础。我们将简要介绍数据拉取的定义、场景以及Hadoop系统中数据拉取的基本流程。

## 1.1 数据拉取简介

数据拉取(Data Pull)是指从数据源主动获取所需数据的过程。在Hadoop生态系统中,数据拉取通常发生在MapReduce任务执行时,Map任务需要从HDFS(Hadoop Distributed File System)中拉取输入数据进行处理。

## 1.2 Hadoop中的应用场景

Hadoop中的数据拉取通常涉及以下场景:

- MapReduce任务执行时,从HDFS拉取输入数据。

- YARN(Yet Another Resource Negotiator)中,应用程序拉取容器资源。

- Hive或Pig等高层抽象工具中,执行查询时从HDFS或HBase拉取数据。

通过本章的学习,我们将建立对数据拉取过程的初步认识,为后续章节的深入分析打下基础。

# 2. 理解Hadoop数据拉取过程

## 2.1 数据拉取机制概述

### 2.1.1 HDFS中数据块的分布

在Hadoop分布式文件系统(HDFS)中,文件被切分成一系列的块(block),每个块的默认大小是128MB(在Hadoop 2.x版本中)。块的分布直接影响数据拉取的过程,因为块存放在不同的DataNode上。当MapReduce作业需要处理数据时,它会向NameNode请求块的位置信息,然后与DataNode建立连接以直接从数据源拉取数据块。

在HDFS中,一个块的多个副本会分布在整个集群的不同节点上,以保证数据的可靠性和容错性。副本的数量默认是3。副本策略不仅关系到数据的可靠存储,还影响到数据拉取的效率。通常情况下,为了提高数据访问速度,会尽可能地将任务调度到含有数据副本的节点上执行。

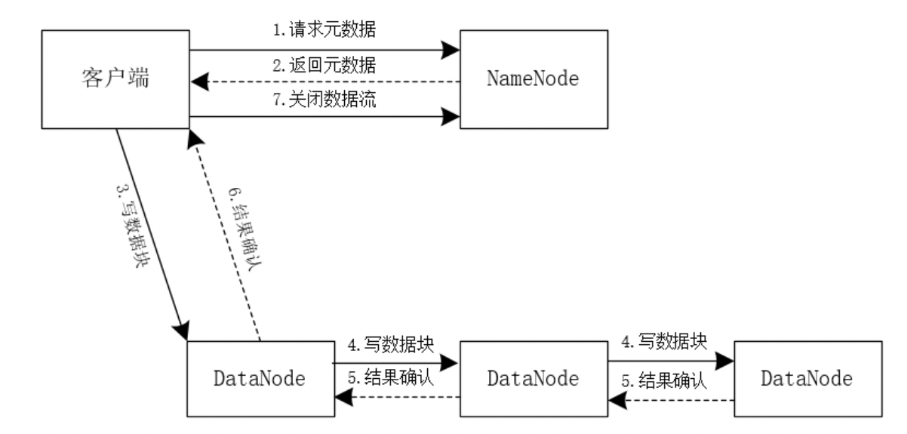

### 2.1.2 数据拉取的主要参与者

数据拉取过程涉及到的关键组件包括NameNode、DataNode、MapReduce任务以及客户端库如libhdfs或Hadoop的Java API。其中,NameNode负责管理文件系统的命名空间以及块的映射信息,DataNode则负责存储数据块,MapReduce任务在计算过程中拉取需要处理的数据块,客户端库为应用程序提供与HDFS进行交互的能力。

当MapReduce任务启动时,它会与NameNode通信获取数据块的位置信息。一旦获取了位置信息,MapReduce任务就会直接从DataNode拉取数据。这个过程需要考虑网络开销、磁盘I/O、CPU和内存资源的使用情况。合理配置NameNode和DataNode,可以大大优化数据拉取的性能。

## 2.2 影响数据拉取性能的关键因素

### 2.2.1 网络带宽与延迟的影响

网络带宽是数据拉取性能的关键瓶颈之一。在Hadoop集群中,如果带宽不足,那么即便有大量的并行任务,整体的数据处理能力也会受限。另外,网络延迟同样影响数据拉取的速度,高延迟会导致任务等待时间增长,从而影响集群的吞吐量。

为了避免网络带宽和延迟成为数据拉取的瓶颈,建议使用高速网络设备如万兆以太网,并优化网络布局,比如合理设计网络拓扑结构,减少跳数,增加节点间的连接带宽。同时,在数据拉取的优化实践中,还会涉及到一些参数的调整,例如调整Hadoop内部通信的缓冲区大小,以减少网络开销。

### 2.2.2 节点资源分配的影响

节点资源的合理分配对于数据拉取过程同样至关重要。在Hadoop集群中,如果Map和Reduce任务分配的资源不均匀或者配置不当,可能会造成部分节点过载,而其他节点则空闲。这会导致数据拉取过程中出现资源争抢和等待,影响整体的处理速度。

为了解决资源分配不当的问题,需要对集群的资源进行精细化管理,例如使用YARN(Yet Another Resource Negotiator)这样的资源管理框架,它允许资源的动态分配,可以根据应用程序的实际需要来调整资源使用。在Hadoop的配置文件中,相关的参数包括`mapreduce.framework.name`,`yarn.resourcemanager.address`等,需要根据具体的集群规模和任务特性进行调整。

### 2.2.3 数据本地性与复制策略的影响

Hadoop的数据本地性指的是尽可能地在数据所在位置进行计算,以减少网络传输开销。这涉及到HDFS的副本放置策略,即数据块会被尽可能地复制到多个DataNode上,以便能够就近处理数据。如果数据的副本不是本地存储的,那么拉取数据将需要通过网络从远程节点获取,这会显著增加数据拉取的时间。

在Hadoop中,副本策略通常由参数`dfs.replication`来控制,默认情况下是3。适当的副本策略能够平衡数据的可靠性和读取性能,但是也需要考虑到集群的实际存储能力和任务负载。在数据拉取优化理论中,我们会进一步探讨如何在保证数据安全的基础上,通过调整副本策略和数据本地性设置来优化性能。

总结来说,Hadoop数据拉取过程是一个复杂的过程,涉及到多层次的资源管理和优化策略。理解和掌握这些基础知识,为后续的优化实践和案例分析打下坚实的基础。下一章节我们将探讨数据拉取优化的基本原则和策略分类。

# 3. Hadoop数据拉取优化理论

在处理大数据时,优化数据拉取过程至关重要,因为它直接影响整体系统的性能和效率。优化数据拉取不仅能够提高数据处理速度,还能降低系统资源消耗和成本。本章节将探讨Hadoop数据拉取优化的基本理论和策略,为读者提供一套系统化、科学化的优化思路。

#### 3.1 数据拉取优化的基本原则

在进行数据拉取优化时,首先需要了解一些基本原则,它们是优化工作的出发点和方向。

##### 3.1.1 减少数据传输的总体带宽

数据传输带宽是影响Hadoop集群性能的关键因素之一。减少数据传输的总体带宽可以有效地减轻网络的压力,并提升整体的数据处理速度。实现这一目标的策略包括:

- **数据压缩技术**:通过数据压缩技术减少传输的数据量,但需要注意选择合适的压缩算法以平衡计算开销。

- **数据分割**:将大文件分割成小块,按需拉取,减少不必要的数据传输。

- **读取模式优化**:合理规划Map任务的读取模式,避免重复读取相同的数据块。

##### 3.1.2 提升节点间的数据传输效率

节点间高效的数据传输对于提升系统吞吐量至关重要。以下策略能够帮助我们实现这一目标:

- **数据缓存**:在任务执行节点上缓存常用数据,以减少重复的网络传输。

- **网络拓扑感知**:利用Hadoop的网络拓扑感知功能,优先在本地或同一机架内的节点间传输数据,降低跨机架的数据传输。

- **并行处理**:合理安排Map和Reduce任务的并行度,充分发挥集群的并行处理能力。

#### 3.2 数据拉取优化策略分类

数据拉取优化可以从硬件、软件和架构三个层面进行。

##### 3.2.1 硬件层面的优化

硬件层面的优化主要集中在提升硬件性能,这包括:

- **升级硬件设备**:例如,升级到更高性能的网络交换机、增加网络带宽等。

- **优化存储硬件**:使用SSD替换传统的HDD,或者配置更高性能的RAID卡以加快数据读写速度。

##### 3.2.2 软件层面的优化

软件优化通常涉及对Hadoop系统配置参数的调整,如:

- **HDFS参数调优**:比如`dfs.replication`,`dfs.block.size`等参数。

- **MapReduce参数调优**:如`mapreduce.job.reduces`,`mapreduce.input.line.inputformat.linespermap`等。

##### 3.2.3 架构层面的优化

架构优化是指从系统的整体架构出发,实现资源的最大化利用。一些常见的优化措施包括:

- **扩展数据存储层**:引入HDFS联邦或HDFS高可用等架构,增强数据存储的稳定性和扩展性。

- **构建多层存储策略**:通过分级存储,将冷热

0

0