NameNode故障转移机制:内部工作原理全解析

发布时间: 2024-10-28 06:29:38 阅读量: 34 订阅数: 40

Hadoop中namenode和secondarynamenode工作机制讲解

# 1. HDFS与NameNode概述

Hadoop分布式文件系统(HDFS)是Hadoop的核心组件,支持大量数据的存储与访问,是大数据分析的基石。本章将简述HDFS的基本概念,包括其分布式存储系统的特性以及体系结构,并将详细探讨NameNode在HDFS中的核心角色。

## 1.1 HDFS的基本概念

### 1.1.1 分布式存储系统简介

分布式存储系统是设计用来存储和管理大规模数据的系统,它将数据分散存储在多台物理服务器上,通过网络连接成一个逻辑上统一的存储环境。与传统的单机存储相比,分布式存储系统能够提供更高的存储容量、更好的数据冗余和更强的数据处理能力。HDFS作为分布式存储系统的一种,特别适用于大数据场景,它能够处理PB级别的数据量,并保证数据的高可靠性。

### 1.1.2 HDFS的体系结构

HDFS采用主从结构(Master/Slave),主要分为NameNode和DataNode两个组件。NameNode作为主节点,负责管理文件系统的命名空间和客户端对文件的访问;DataNode作为从节点,负责存储实际的数据块。文件系统的名字空间包括目录、文件和属性等信息,而文件数据则被分成一系列的数据块,由各个DataNode存储。

## 1.2 NameNode在HDFS中的角色

### 1.2.1 元数据管理职责

NameNode是HDFS中最重要的组件之一,它管理文件系统命名空间和控制外部客户端的访问。具体来说,NameNode负责记录每个文件中各个块所在的数据节点信息,以及处理客户端的文件系统操作请求,如打开、关闭、重命名文件或目录等。

### 1.2.2 读写请求处理流程

当客户端需要读取文件时,它首先查询NameNode来获取文件的元数据信息,然后直接与存储数据块的DataNode通信,读取所需的数据。写入文件时,流程也类似,客户端先通过NameNode获得可用的DataNode列表,然后将数据分块写入这些DataNode。在这个过程中,NameNode确保操作的一致性,并处理数据块的复制来保证数据的可靠性。

## 1.3 NameNode的重要性与潜在风险

### 1.3.1 NameNode单点故障问题

由于NameNode在HDFS中的关键作用,它的故障会导致整个文件系统不可用,因此NameNode的单点故障是HDFS架构的主要风险之一。为了解决这个问题,Hadoop社区引入了高可用性机制,如双NameNode配置,来实现NameNode的故障转移,保证服务的连续性。

### 1.3.2 高可用性的必要性

为了实现HDFS的高可用性,需要部署多个NameNode来相互备份,使系统能够在主NameNode发生故障时快速切换到备用NameNode,从而保持服务的稳定性。这一策略对于确保大数据处理的连续性和数据安全性至关重要,对于5年以上的IT从业者来说,了解和掌握这些知识是必须的。

以上章节概述了HDFS的基本架构和NameNode的重要性,为后续深入探讨NameNode的高可用性架构和故障转移机制打下了基础。

# 2. NameNode的高可用性架构

### 2.1 高可用性的设计原理

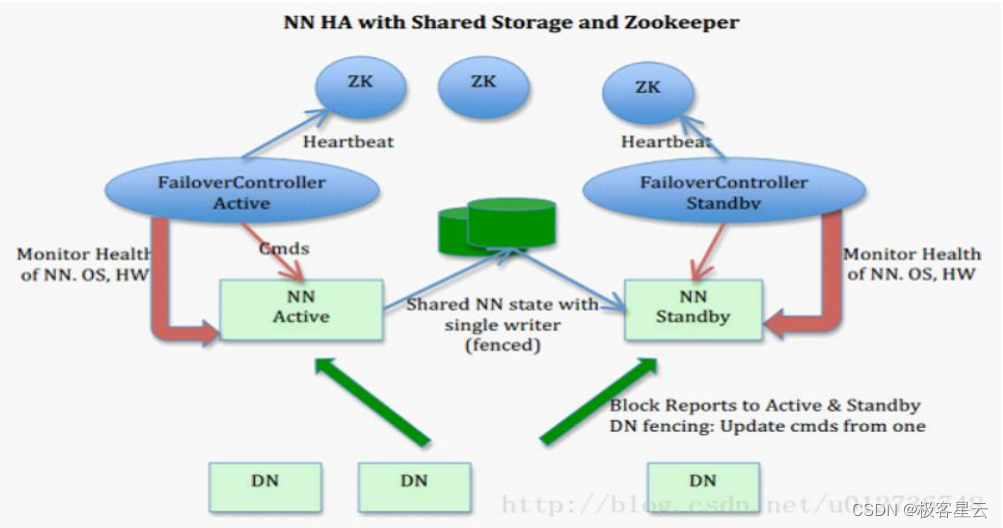

#### 2.1.1 双NameNode架构介绍

高可用性是任何企业级分布式存储系统的核心要求。在Hadoop的分布式文件系统(HDFS)中,为了应对NameNode单点故障问题,设计了双NameNode架构,也就是所谓的"主备"模式。在这种模式下,有两个NameNode节点:一个处于活跃状态(Active),负责处理所有的客户端请求;另一个处于待命状态(Standby),在发生故障时可以迅速接管。两个NameNode共享同一份文件系统的元数据信息,并通过一种名为“共享存储”的方式来保证元数据的一致性。

为了使这种架构能够正常工作,引入了Quorum Journal Manager(QJM)或EditLogTailing等技术,以实现实时的数据复制。当Active NameNode发生故障时,Standby NameNode可以读取共享存储中的元数据,并通过与DataNode的通信,恢复成为一个完全可用的Active NameNode。

#### 2.1.2 脑裂问题及其解决策略

双NameNode架构中一个潜在的问题是所谓的“脑裂”(split-brain)现象,当网络故障或系统异常导致两个NameNode同时认为自己是Active状态时,就会出现两个节点同时试图对文件系统进行写操作,这将导致元数据不一致和数据损坏。为了解决这个问题,Hadoop 2.0之后版本引入了ZooKeeper来协调NameNode之间的状态。ZooKeeper的作用是确保任何时候只有一个NameNode处于Active状态。

ZooKeeper集群会维护一个状态文件,记录当前哪个NameNode是活跃的。当发生网络分区时,ZooKeeper可以准确地判断哪个NameNode是可信的,防止脑裂现象发生。

### 2.2 集群状态同步机制

#### 2.2.1 ZKFailoverController的作用

ZKFailoverController(ZKFC)是HDFS高可用性架构中的一个关键组件,它负责监控和管理NameNode的状态。ZKFC持续监视NameNode的心跳,确认它是否健康,并在出现问题时协调故障转移。当Active NameNode停止发送心跳或被认为不可用时,ZKFC会使用ZooKeeper中的锁机制来切换状态,从而启动故障转移流程。

#### 2.2.2 JournalNode与编辑日志的同步

在双NameNode架构中,编辑日志的同步是保证元数据一致性的关键。JournalNodes集群是ZooKeeper上的一个组件,负责存储和同步NameNode的编辑日志。编辑日志是记录了所有文件系统更改操作的日志,这些操作包括创建文件、删除文件、修改文件权限等。

每个对元数据的修改操作都会被写入到JournalNode集群的多数节点上,确保了即使其中一个NameNode失败,另一个NameNode也可以读取到完整的编辑日志,从而保证了元数据的一致性。这个过程也被称为“多数写入”(Quorum-based Write),因为它需要多数节点写入成功才认为是一次成功的写操作。

### 2.3 状态切换与故障恢复策略

#### 2.3.1 故障时的角色切换流程

当Active NameNode发生故障时,Standby NameNode需要接管成为新的Active NameNode。这个切换过程被称为故障转移(Failover),主要包括以下几个步骤:

1. 当ZKFC检测到Active NameNode没有心跳时,会首先尝试在本地重启服务。

2. 如果重启失败,ZKFC会向ZooKeeper请求锁来获得故障转移的权限。

3. 获取锁后,ZKFC会执行安全的故障转移步骤,包括将旧的Active NameNode标记为不可用,并让Standby NameNode接管成为新的Active NameNode。

4. 同时,ZKFC还会更新所有客户端的配置,确保它们知道新的Active NameNode的位置。

#### 2.3.2 故障恢复后的数据一致性处理

故障转移完成后

0

0