HDFS数据读写容错:保障大数据完整性与可靠性

发布时间: 2024-10-28 05:46:55 阅读量: 26 订阅数: 30

# 1. HDFS的基本概念和架构

## Hadoop分布式文件系统(HDFS)简介

HDFS是Hadoop生态系统的核心组件之一,专为存储大规模数据集和处理跨多个计算节点的数据而设计。它的设计遵循"一次写入,多次读取"的原则,这意味着数据一旦写入,通常不会改变,直到被追加或删除。

## HDFS架构组件解析

HDFS架构由两部分主要组件构成:NameNode和DataNode。NameNode是文件系统的管理者,负责管理文件系统树及整个系统的命名空间,维护文件系统元数据,例如文件和目录信息。DataNode则负责存储实际数据,它们响应客户端的读写请求,并返回或存储数据。

```mermaid

graph LR

A[NameNode] -->|管理元数据| B[DataNode]

B --> C[存储数据块]

A --> D[协调数据操作]

```

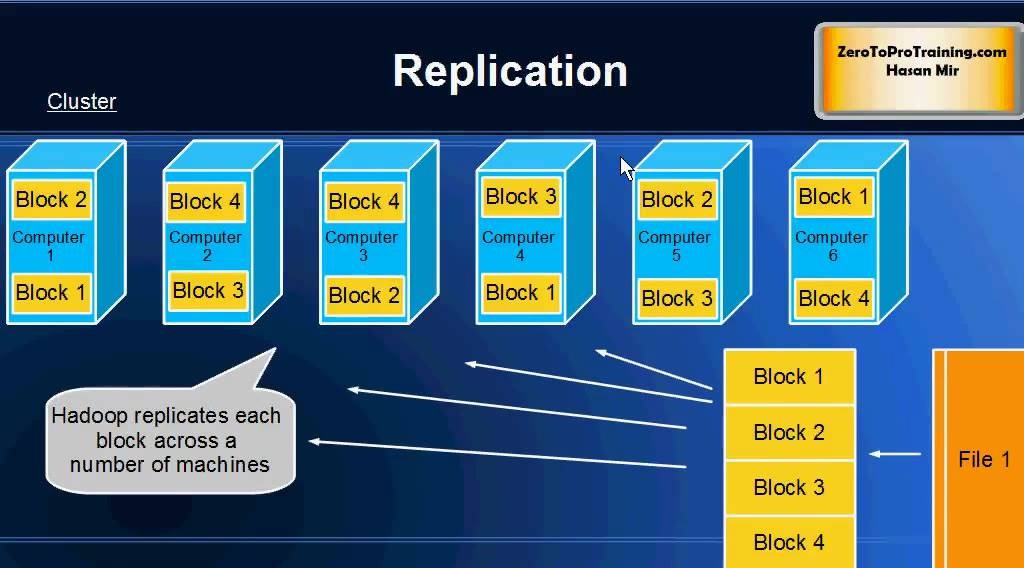

## HDFS的高容错性设计

HDFS为了保证高容错性,采用数据块的概念存储数据,文件被切分成一个或多个块(默认大小为128MB),这些块被复制并存储在不同的DataNode上。通过这种方式,即使部分节点失败,HDFS仍能保证数据的完整性。这种设计是HDFS能在廉价硬件上运行的基础,同时也保证了系统的可伸缩性和容错性。

以上内容介绍了HDFS的基础概念和核心架构,为后续章节深入探讨HDFS的读写机制和容错策略打下了坚实的基础。

# 2. HDFS数据读写过程的理论基础

## 2.1 HDFS的基本操作和命令

### 2.1.1 HDFS文件系统的使用

在Hadoop分布式文件系统(HDFS)中,文件系统的基本操作与传统文件系统有着共通之处,但又因其分布式特性而有所不同。首先,HDFS是设计来存储大规模数据集的,因此提供了几个特有的命令来与文件系统交互。

`hadoop fs` 命令是与HDFS进行交互的主要方式。例如,列出HDFS根目录下的内容可以使用:

```bash

hadoop fs -ls /

```

此命令会输出HDFS根目录下的所有文件和目录信息。

创建一个目录的命令是:

```bash

hadoop fs -mkdir /newdir

```

此命令会在HDFS的根目录下创建一个名为`newdir`的新目录。

要删除一个文件,可以使用:

```bash

hadoop fs -rm /path/to/file

```

要复制文件到HDFS,可以使用:

```bash

hadoop fs -put localfile /path/to/hdfsfile

```

这些命令是进行HDFS文件系统操作的基础,必须熟练掌握。执行`hadoop fs`后跟不同的参数,可以执行不同的操作,比如查看文件内容、移动文件、重命名文件等等。

### 2.1.2 HDFS的配置和管理

HDFS的配置涉及多个方面,包括集群的扩展性、性能优化、安全性设置等等。Hadoop的配置主要通过编辑`hdfs-site.xml`、`core-site.xml`和`mapred-site.xml`等XML文件来完成。

在`hdfs-site.xml`文件中,可以设置HDFS的副本数量:

```xml

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

</configuration>

```

这里将副本数设置为3,意味着HDFS会为每个文件存储三份数据,以保证数据的容错能力。

HDFS的管理也包括对HDFS的监控和维护。通常,可以通过Hadoop自带的Web界面来监控HDFS状态。HDFS提供了一个Web界面,通常在9870端口(配置不同可能不同)上可以访问,通过它管理员可以查看文件系统的健康状况、使用情况等信息。

此外,集群管理还包括节点的增加或移除、数据均衡、磁盘空间管理等。这些操作对集群的稳定性和性能至关重要,必须由经验丰富的管理员来执行。

## 2.2 HDFS数据读写的机制

### 2.2.1 数据读取的原理

HDFS的数据读取原理依赖于其设计中的“一次写入,多次读取”的策略。当一个文件需要被读取时,客户端首先查询NameNode来获取文件的元数据信息和数据块的位置信息。然后,客户端直接与DataNode通信来读取所需的数据块。

数据读取流程通常分为以下步骤:

1. 客户端发起读取请求,通过文件路径查询NameNode获取文件的元数据,包括文件的数据块索引和副本位置。

2. NameNode返回文件的数据块所在DataNode的位置。

3. 客户端根据返回的位置信息,直接与对应的DataNode建立连接,请求读取数据块。

4. DataNode开始向客户端发送数据。为了提高吞吐量,客户端可以并行读取多个数据块。

5. 客户端接收数据块,并将它们按顺序组合成完整的文件。

### 2.2.2 数据写入的原理

HDFS的数据写入原理也是分布式计算环境中的关键机制之一。数据写入分为以下几个步骤:

1. 客户端通过配置的HDFS路径发起写入请求。

2. 客户端先联系NameNode,NameNode根据当前存储的数据块和集群情况为文件分配一个新的数据块,并返回给客户端。

3. 客户端将数据分成块并并行写入多个DataNode,通常为三个副本。

4. 每个DataNode写入完毕后向客户端发送写入成功的信号。

5. 客户端确认所有数据块都写入完成后,告知NameNode写入操作完成。

这个过程保证了数据的高可用性,因为文件的每个数据块都有三个副本。

## 2.3 HDFS数据容错的策略

### 2.3.1 数据复制的策略

HDFS通过数据复制的策略来保证数据的高可用性和容错性。数据复制机制是HDFS能够处理硬件故障的核心特性之一。

HDFS中的数据复制策略可以总结如下:

- 默认情况下,每个数据块被复制成三份,分别存储在不同的DataNode上。

- 当创建一个新的数据块时,NameNode会选取合适的DataNode来存放这些副本。

- 副本的选择会尽量避免同一机架内的节点,以降低整个机架故障导致数据丢失的风险。

- 当DataNode故障或需要维护时,NameNode会自动将数据块的副本复制到其他DataNode,从而保证数据的冗余。

复制策略的实现不仅依赖于NameNode的管理,还依赖于各个DataNode的定期心跳信息,以确保副本信息的准确性。

### 2.3.2 数据恢复的机制

数据恢复是HDFS处理节点故障或数据损坏的一种机制。当DataNode因为硬件故障或其他原因无法提供服务时,NameNode会检测到该节点失效,并指示其他DataNode复制它们存储的数据块以恢复数据的副本数。

数据恢复的机制包括以下几个步骤:

1. NameNode定期通过心跳检测DataNode的状态。

2. 如果NameNode在一定时间内没有收到某个DataNode的心跳,它将认为该DataNode失效。

3. NameNode会从失效节点的数据块列表中找出丢失的副本,并重新创建它们。

4. NameNode会选择其他DataNode来创建新的副本,重新构建数据冗余。

此外,HDFS还提供了一些用于诊断和恢复数据的命令,例如`hadoop fsck`用于检查文件系统健康状况,`hadoop distcp`用于复制大量数据。这些工具对于维护HDFS的稳定运行至关重要。

在下一章中,我们将深入探讨如何在实际应用中优化HDFS的数据读写和容错机制,以及如何处理实际遇到的问题。

# 3. HDFS数据读写容错的实践应用

## 3.1 HDFS数据读写的优化

### 3.1.1 数据读取的优化策略

在大数据场景下,数据读取是关键性能瓶颈之一,优化HDFS的数据读取可以显著提高整体系统的响应速度和效率。对于数据读取的优化,关键在于减少读取延迟和提高数据传输速度。

优化策略主要包括以下几个方面:

- **合理配置块大小**:调整

0

0