架构深度解析:HDFS容错机制如何塑造系统设计

发布时间: 2024-10-28 06:04:16 阅读量: 4 订阅数: 10

# 1. HDFS容错机制概述

HDFS(Hadoop Distributed File System)作为Apache Hadoop项目的核心组件,主要负责在大规模集群环境中存储数据。容错机制是其核心特性之一,确保了在面对硬件故障时系统能够持续稳定运行,并尽可能地减少数据丢失的风险。

## 1.1 容错机制的重要性

在分布式系统中,硬件故障是常态而非例外。HDFS的容错机制通过数据冗余、复制和自动恢复等手段,保证了即使在部分节点发生故障时,数据依然可访问,且不会因为单点故障而影响整体数据存储的可用性。

## 1.2 HDFS容错机制的基本原理

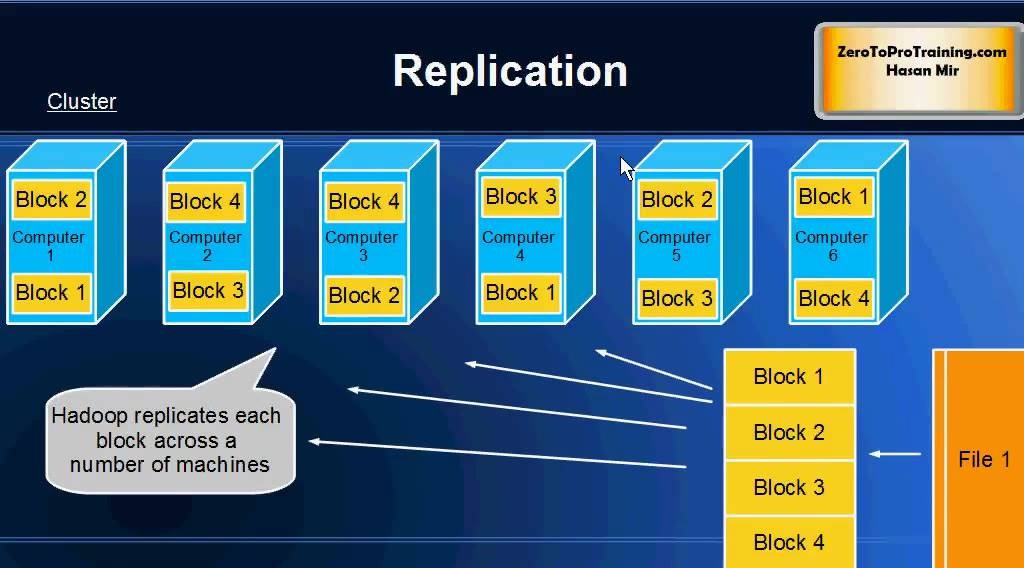

HDFS的容错主要依赖于数据的多份复制。通过在不同节点间分布数据的多个副本,可以在部分节点失效时,通过读取其他健康节点上的副本,继续提供服务。这种复制策略降低了因硬件故障导致的数据丢失风险,同时也提供了较高的读取吞吐量。

## 1.3 容错与系统性能的权衡

虽然数据冗余和复制策略极大地提高了系统的容错性,但也不可避免地增加了存储成本和写入延迟。在设计和配置HDFS时,需要仔细考虑如何在高容错和高性能之间做出权衡,以适应不同的业务需求和环境约束。

# 2. HDFS的数据冗余与复制

## 2.1 数据块的复制原理

HDFS的设计哲学之一是通过数据冗余存储来保证系统的容错性。一个文件在HDFS中被分成一系列的数据块,每个块默认大小为128MB(在Hadoop 2.x以前为64MB),这些数据块会被自动复制并分布到多个数据节点上。数据的高冗余复制策略是HDFS容错性的关键。

### 2.1.1 数据块的基本概念

数据块(Block)是HDFS存储数据的基本单位。由于硬件故障在大规模集群中是常态,为了保证数据的可靠性,每个数据块在不同的数据节点上保存多个副本来实现冗余。默认情况下,HDFS采用3副本策略,即每个数据块会有一个主副本(Primary)和两个副副本(Secondary),分别保存在不同的数据节点上。这样即使有两个数据节点同时发生故障,数据也不会丢失。

### 2.1.2 数据复制策略与过程

数据复制在写入过程中实现。当客户端通过HDFS API写入文件时,HDFS客户端首先将文件分成多个数据块,并与NameNode通信获取数据块存放的目标数据节点列表。接着,客户端并行地将数据块发送到这些数据节点。完成一个数据块的写入后,客户端会继续写入下一个数据块,直至整个文件被完全写入。

复制过程中涉及的策略如下:

- **负载均衡**: HDFS通过复杂的调度机制,确保数据块被均匀地分散到集群中的所有节点,避免个别节点过载。

- **数据本地性**: 尽量选择与写入数据节点在同一机架内的数据节点进行复制,因为同一机架内的节点间通信速度更快。

- **冗余复制**: HDFS依赖副本数来提供容错能力。副本数可以在创建文件时设置,也可在文件创建后调整。

## 2.2 数据一致性模型

HDFS提供了基于写入一次(Write-Once)的文件系统模型。这个模型简单,且非常适合大型数据分析应用的需求。

### 2.2.1 HDFS的一致性语义

HDFS遵循“一次写入,多次读取”的一致性模型,文件一旦创建并写入后,就不允许修改。这个模型允许HDFS在数据读取时能保证数据的一致性。

HDFS提供以下一致性保证:

- **原子性写入**: 在文件写入过程中,客户端可以保证要么整个数据块被写入,要么在发生故障时整个数据块不会被写入,避免了部分写入导致的数据不一致。

- **顺序一致性**: 对于同一个文件的写入操作,HDFS保证后续的读取操作将按照写入顺序的顺序返回数据。

### 2.2.2 如何维护数据一致性

维护数据一致性是一个复杂的过程。HDFS通过以下机制来保证数据的一致性:

- **数据块校验**: 每个数据块在写入后都会进行校验和(Checksum)计算。客户端在读取数据块时会重新计算校验和,以确保数据未被篡改。

- **副本一致性**: HDFS NameNode定期检查各个数据节点上的副本状态,并与副本间的校验和进行比较,确保副本数据的一致性。

- **故障恢复**: 一旦检测到副本不一致,系统将自动触发副本的重新复制过程来修复。

## 2.3 故障检测与恢复机制

HDFS设计中融合了对节点故障的检测和数据自动恢复的机制,从而确保了即使在大量节点故障情况下也能保持数据不丢失。

### 2.3.1 心跳检测与节点状态监控

HDFS使用心跳检测机制来监控数据节点的健康状况。每个数据节点会定期向NameNode发送心跳信号,表明自身正常运行。如果NameNode在预定的超时时间内未接收到某个数据节点的心跳信号,它将认为该节点已经宕机,并启动故障恢复流程。

心跳检测流程如下:

1. **周期性心跳**: 数据节点每秒向NameNode发送一次心跳信号。

2. **超时判断**: 如果超过设定的超时时间(默认为10分钟),NameNode未收到心跳信号,判定为节点宕机。

3. **状态更新**: NameNode将该节点标记为宕机状态,并从集群中移除该节点上的所有副本。

### 2.3.2 数据与元数据的自动恢复过程

HDFS为了保证高可用性,对数据块和元数据提供了自动恢复策略。

数据自动恢复过程如下:

1. **副本丢失**: 如果检测到某个数据块的副本数量少于预期(默认为3副本),则NameNode会触发复制过程,生成新的副本放到其他健康的数据节点上。

2. **元数据恢复**: 如果NameNode宕机,元数据的恢复依赖于Secondary NameNode或Standby NameNode(在HA配置下)。这些辅助节点定期合并编辑日志与文件系统镜像,保证在主节点宕机时可以迅速切换到备用节点。

通过心跳检测与自动恢复机制,HDFS能够在部分节点失效时维持集群的完整性和可用性。这些机制对于确保数据持久性和可靠性至关重要,使得HDFS能够广泛应用于大数据存储和处理场景。

# 3. HDFS的高可用性设计

## 3.1 命名节点的高可用方案

Hadoop分布式文件系统(HDFS)在设计时,就已经充分考虑到了系统故障的普遍性。为了实现HDFS的高可用性,Hadoop社区引入了多个关键的组件和设计,其中最重要的便是命名节点(NameNode)的高可用(High Availability, HA)配置。

### 3.1.1 ZKFC的工作机制

在HDFS的高可用配置中,ZooKeeper Failover Controller(ZKFC)扮演了至关重要的角色。ZKFC负责监控命名节点的健康状况,并在命名节点故障时迅速采取行动。

ZKFC工作机制主要涉及以下几个步骤:

1. **健康检查**:每个命名节点的ZKFC会定期向其管理的命名节点发送心跳包,确保命名节点的正常运行。

2. **状态同步**:如果ZKFC没有收到心跳响应,或者命名节点自身报告错误,ZKFC会认定该命名节点出现故障。

3. **切换请求**:在确认命名节点故障后,ZKFC会请求ZooKeeper集群进行命名节点的切换,将故障节点的服务转移到另一个健康的命名节点。

ZKFC与ZooKeeper集群的协作确保了切换过程中的数据一致性,并尽量减少服务中断的时间。

### 3.1.2 主从切换与状态同步

在HDFS HA的配置中,存在两个处于待命状态的命名节点:一个活跃(Active)命名节点和一个或多个待命(Standby)命名节点。活跃节点负责所有的文件系统的命名空间操作,而待命节点则等待成为下一个活跃节点。这一过程的实现是通过ZooKeeper集群和ZKFC的共同协作完成的。

状态同步的实现主要依靠ZooKeeper的特性:

1. **分布式锁**:ZooKeeper维护分布式锁来确保在任何时间只有一个命名节

0

0