神经网络引擎:探索神经网络架构的演变之路,解锁人工智能的无限潜力

发布时间: 2024-07-13 04:10:56 阅读量: 38 订阅数: 46

# 1. 神经网络的理论基础**

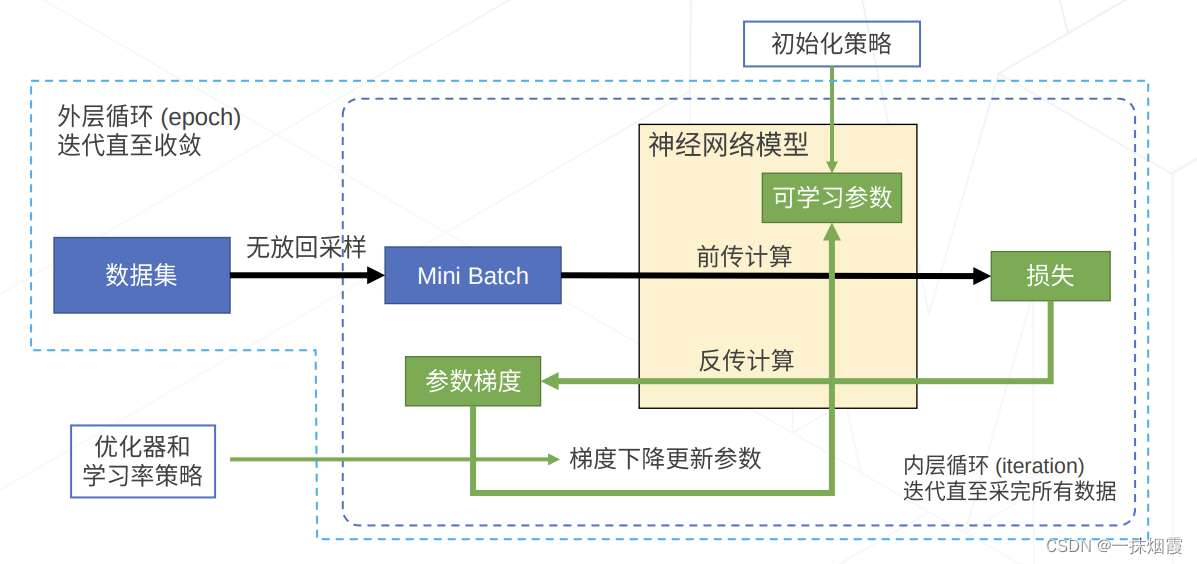

神经网络是一种受生物神经系统启发的机器学习模型。它由相互连接的人工神经元组成,这些神经元可以接收、处理和传递信息。神经网络的理论基础建立在以下关键概念之上:

* **神经元模型:**神经元是神经网络的基本单元,它接收输入,应用激活函数,并产生输出。激活函数通常是非线性的,例如 sigmoid 或 ReLU,它允许神经元对输入进行复杂的非线性变换。

* **权重和偏差:**每个神经元之间的连接都有一个权重,它决定了输入对神经元输出的影响程度。偏差是一个常数,它可以平移神经元的激活函数。

* **前馈传播:**神经网络通过前馈传播来处理输入数据。数据从输入层流向输出层,每个神经元根据其权重和偏差计算其输出,然后将其传递给下一层。

* **反向传播:**反向传播是一种算法,用于训练神经网络。它通过比较网络输出与预期输出之间的误差来计算权重和偏差的梯度。然后,使用梯度下降算法更新权重和偏差,以最小化误差。

# 2. 神经网络架构的演变

神经网络架构经历了从早期简单模型到复杂深层网络的演变。本章节将回顾神经网络架构的演变历程,重点介绍感知机、多层感知机、卷积神经网络和循环神经网络等关键架构。

### 2.1 早期神经网络架构

#### 2.1.1 感知机

感知机是神经网络中最简单的模型,它是一个二分类器,可以将输入数据分类为两类。感知机由一个线性组合函数和一个阈值函数组成。线性组合函数计算输入数据和权重的加权和,阈值函数将加权和与阈值进行比较,输出 0 或 1。

```python

import numpy as np

class Perceptron:

def __init__(self, learning_rate=0.01, n_iter=1000):

self.lr = learning_rate

self.n_iter = n_iter

self.weights = None

self.bias = None

def fit(self, X, y):

n_samples, n_features = X.shape

self.weights = np.zeros(n_features)

self.bias = 0

for _ in range(self.n_iter):

for i in range(n_samples):

output = np.dot(X[i], self.weights) + self.bias

error = y[i] - output

self.weights += self.lr * error * X[i]

self.bias += self.lr * error

def predict(self, X):

output = np.dot(X, self.weights) + self.bias

return np.where(output >= 0, 1, -1)

```

**逻辑分析:**

* `fit()` 方法使用梯度下降算法训练感知机模型,通过迭代更新权重和偏差来最小化损失函数。

* `predict()` 方法使用训练好的权重和偏差对新数据进行预测。

#### 2.1.2 多层感知机

多层感知机(MLP)是一种前馈神经网络,由多个层组成,每层包含多个神经元。MLP 可以解决更复杂的问题,因为它能够学习非线性关系。

```python

import numpy as np

class MLP:

def __init__(self, hidden_layer_sizes=(100,), activation='relu', learning_rate=0.01, n_iter=1000):

self.hidden_layer_sizes = hidden_layer_sizes

self.activation = activation

self.lr = learning_rate

self.n_iter = n_iter

self.layers = []

self.weights = []

self.biases = []

def fit(self, X, y):

n_samples, n_features = X.shape

n_outputs = len(np.unique(y))

# 初始化层

self.layers.append(Layer(n_features, self.hidden_layer_sizes[0], self.activation))

for i in range(len(self.hidden_layer_sizes) - 1):

self.layers.append(Layer(self.hidden_layer_sizes[i], self.hidden_layer_sizes[i + 1], self.activation))

self.layers.append(Layer(self.hidden_layer_sizes[-1], n_outputs, 'softmax'))

# 初始化权重和偏差

for layer in self.layers:

self.weights.append(np.random.randn(layer.n_inputs, layer.n_outputs) * np.sqrt(2.0 / layer.n_inputs))

self.biases.append(np.zeros((1, layer.n_outputs)))

# 训练模型

for _ in range(self.n_iter):

for i in range(n_samples):

# 前向传播

activations = [X[i]]

for j in range(len(self.layers)):

activations.append(self.layers[j].forward(activations[-1], self.weights[j], self.biases[j]))

# 反向传播

deltas = [np.zeros_like(activations[-1])]

for j in range(len(self.layers) - 1, -1, -1):

deltas.insert(0, self.layers[j].backward(deltas[0], self.weights[j], self.biases[j]))

# 更新权重和偏差

for j in range(len(self.layers)):

self.weights[j] -= self.lr * deltas[j + 1].dot(activations[j].T)

self.biases[j] -= self.lr * np.sum(deltas[j + 1], axis=0)

def predict(self, X):

activations = [X]

for layer in self.layers:

activations.append(layer.forward(activations[-1], self.weights[activations.index(X)], self.biases[activations.index(X)]))

return activations[-1]

```

**逻辑分析:**

* `fit()` 方法使用反向传播算法训练 MLP 模型,通过迭代更新权重和偏差来最小化损失函数。

* `predict()` 方法使用训练好的权重和偏差对新数据进行预测。

### 2.2 卷积神经网络

卷积神经网络(CNN)是一种专门用于处理图像数据的深度学习模型。CNN 具有卷积层和池化层,可以提取图像中的空间特征。

#### 2.2.1 卷积层

卷积层是 CNN 的核心组件,它使用卷积运算符提取图像中的特征。卷积运算符由一个滤波器组成,滤波器在图像上滑动,计算滤波器和图像相应区域的元素积。

```python

import numpy as np

class Conv2D:

def __init__(self, in_channels, out_channels, kernel_size, stride=1, padding=0):

self.in_channels = in_channels

self.out_channels = out_channels

self.kernel_size = kernel_size

self.stride = stride

self.padding = padding

self.weights = np.random.randn(out_channels, in_channels, kernel_size, kernel_size) * np.sqrt(2.0 / (in_channels * kernel_size * kernel_size))

self.biases = np.zeros((1, out_channels, 1, 1))

def forward(self, X):

n_samples, in_channels, height, width = X.shape

out_height = (height + 2 * self.padding - self.kernel_size) // self.stride + 1

out_width = (width + 2 * self.padding - self.kernel_size) // self.stride + 1

out = np.zeros((n_samples, self.out_channels, out_height, out_width))

for i in range(n_samples):

for j in range(self.out_channels):

for k in range(out_height):

for l in range(out_width):

out[i, j, k, l] = np.sum(X[i, :, k * self.stride:k * self.stride + self.kernel_size, l * self.stride:l * self.stride + self.kernel_size] * self.weights[j]) + self.biases[j]

return out

def backward(self, dout):

n_samples, out_channels, height, width = dout.shape

in_height = (height - 1) * self.stride + self.kernel_size

in_width = (width - 1) * self.stride + self.kernel_size

dweights = np.zeros_like(self.weights)

dbiases = np.zeros_like(self.biases)

dX = np.zeros_like(X)

for i in range(n_samples):

for j in range(out_channels):

for k in range(height):

for l in range(width):

dweights[j] += dout[i, j, k, l] * X[i, :, k * self.stride:k * self.stride + self.kernel_size, l * self.stride:l * self.stride + self.kernel_size]

dbiases[j] += dout[i, j, k, l]

dX[i, :, k * self.stride:k * self.stride + self.kernel_size, l * self.stride:l * self.stride + self.kernel_size] += dout[i, j, k, l] * self.weights[j]

return dX, dweights, dbiases

```

**逻辑分析

# 3.1 图像识别

图像识别是神经网络应用最广泛的领域之一,主要包括物体检测和图像分类两大任务。

#### 3.1.1 物体检测

物体检测旨在从图像中识别和定位特定对象。常用的神经网络架构包括:

- **单级检测器:**直接预测目标边界框和类别,如 YOLO、SSD。

- **两级检测器:**先产生目标候选框,再对候选框进行分类和回归,如 Faster R-CNN、Mask R-CNN。

**代码块:**

```python

import cv2

import numpy as np

# 加载图像

image = cv2.imread("image.jpg")

# 使用 YOLOv5 模型进行物体检测

model = cv2.dnn.readNetFromDarknet("yolov5s.cfg", "yolov5s.weights")

# 设置输入图像尺寸

blob = cv2.dnn.blobFromImage(image, 1 / 255.0, (416, 416), (0, 0, 0), swapRB=True, crop=False)

# 设置模型输入

model.setInput(blob)

# 前向传播

detections = model.forward()

# 解析检测结果

for detection in detections[0, 0]:

confidence = detection[2]

if confidence > 0.5:

class_id = int(detection[1])

x, y, w, h = detection[3:7] * np.array([image.shape[1], image.shape[0], image.shape[1], image.shape[0]])

cv2.rectangle(image, (x, y), (x + w, y + h), (0, 255, 0), 2)

cv2.putText(image, f"{class_id}", (x, y - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

# 显示检测结果

cv2.imshow("Image", image)

cv2.waitKey(0)

```

**逻辑分析:**

- `cv2.dnn.blobFromImage()` 函数将图像转换为模型输入所需的 blob 格式。

- `model.setInput()` 函数将 blob 设置为模型输入。

- `model.forward()` 函数执行前向传播,产生检测结果。

- 循环遍历检测结果,并根据置信度过滤出高置信度的检测结果。

- 使用 `cv2.rectangle()` 和 `cv2.putText()` 函数在图像上绘制边界框和类别标签。

#### 3.1.2 图像分类

图像分类旨在将图像分类到预定义的类别中。常用的神经网络架构包括:

- **卷积神经网络(CNN):**提取图像特征并进行分类,如 VGGNet、ResNet。

- **Transformer:**利用自注意力机制处理图像序列,如 ViT、Swin Transformer。

**代码块:**

```python

import torch

from torchvision import transforms

# 加载图像

image = cv2.imread("image.jpg")

# 预处理图像

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

image_tensor = transform(image).unsqueeze(0)

# 加载模型

model = torch.hub.load('pytorch/vision:v0.10.0', 'resnet18', pretrained=True)

# 前向传播

output = model(image_tensor)

# 获取预测结果

_, predicted = torch.max(output.data, 1)

# 输出预测类别

print(f"Predicted class: {predicted}")

```

**逻辑分析:**

- `transforms.Compose()` 函数将图像预处理操作组合成一个序列。

- `torch.hub.load()` 函数从 PyTorch Hub 加载预训练模型。

- `model()` 函数执行前向传播,产生预测结果。

- `torch.max()` 函数返回预测类别和置信度。

# 4. 神经网络的进阶应用**

**4.1 生成对抗网络 (GAN)**

**4.1.1 GAN 的基本原理**

生成对抗网络 (GAN) 是一种无监督学习算法,用于生成逼真的数据。GAN 由两个神经网络组成:生成器和判别器。

* **生成器**:生成器负责生成假数据。它从随机噪声中采样,并将其转换为与真实数据相似的输出。

* **判别器**:判别器负责区分真实数据和生成器生成的数据。它将数据作为输入,并输出一个概率值,表示数据是真实的还是假的。

GAN 的训练过程是一个博弈过程。生成器试图生成与真实数据难以区分的数据,而判别器试图区分真实数据和生成器生成的数据。通过这种博弈,生成器和判别器相互竞争,最终生成器可以生成非常逼真的数据。

**4.1.2 GAN 的应用**

GAN 已被用于各种应用中,包括:

* **图像生成**:GAN 可用于生成逼真的图像,例如人脸、动物和风景。

* **文本生成**:GAN 可用于生成逼真的文本,例如新闻文章、故事和诗歌。

* **音乐生成**:GAN 可用于生成逼真的音乐,例如歌曲、旋律和和声。

**代码块:**

```python

import tensorflow as tf

# 定义生成器

generator = tf.keras.Sequential([

tf.keras.layers.Dense(128, activation="relu"),

tf.keras.layers.Dense(256, activation="relu"),

tf.keras.layers.Dense(512, activation="relu"),

tf.keras.layers.Dense(1024, activation="relu"),

tf.keras.layers.Dense(784, activation="sigmoid")

])

# 定义判别器

discriminator = tf.keras.Sequential([

tf.keras.layers.Dense(1024, activation="relu"),

tf.keras.layers.Dense(512, activation="relu"),

tf.keras.layers.Dense(256, activation="relu"),

tf.keras.layers.Dense(128, activation="relu"),

tf.keras.layers.Dense(1, activation="sigmoid")

])

# 定义损失函数

generator_loss = tf.keras.losses.BinaryCrossentropy(from_logits=True)

discriminator_loss = tf.keras.losses.BinaryCrossentropy(from_logits=True)

# 定义优化器

generator_optimizer = tf.keras.optimizers.Adam(learning_rate=0.0002)

discriminator_optimizer = tf.keras.optimizers.Adam(learning_rate=0.0002)

# 训练 GAN

for epoch in range(100):

# 训练生成器

with tf.GradientTape() as tape:

noise = tf.random.normal([batch_size, 100])

generated_images = generator(noise)

fake_labels = tf.zeros([batch_size, 1])

generator_loss_value = generator_loss(fake_labels, discriminator(generated_images))

gradients = tape.gradient(generator_loss_value, generator.trainable_weights)

generator_optimizer.apply_gradients(zip(gradients, generator.trainable_weights))

# 训练判别器

with tf.GradientTape() as tape:

real_images = ... # 加载真实图像

real_labels = tf.ones([batch_size, 1])

fake_images = ... # 使用生成器生成假图像

fake_labels = tf.zeros([batch_size, 1])

discriminator_loss_value = discriminator_loss(real_labels, discriminator(real_images)) + discriminator_loss(fake_labels, discriminator(fake_images))

gradients = tape.gradient(discriminator_loss_value, discriminator.trainable_weights)

discriminator_optimizer.apply_gradients(zip(gradients, discriminator.trainable_weights))

```

**逻辑分析:**

该代码块展示了 GAN 的训练过程。它定义了生成器和判别器网络,并定义了损失函数和优化器。训练循环迭代 100 个 epoch,在每个 epoch 中,生成器和判别器网络交替训练。生成器试图生成逼真的图像,而判别器试图区分真实图像和生成图像。通过这种博弈过程,生成器和判别器相互竞争,最终生成器可以生成非常逼真的图像。

**4.2 强化学习**

**4.2.1 强化学习的框架**

强化学习是一种机器学习算法,用于训练代理在特定环境中做出最佳决策。强化学习框架包括:

* **代理**:代理是与环境交互并做出决策的实体。

* **环境**:环境是代理与之交互的世界。它提供状态和奖励给代理。

* **状态**:状态是环境的当前描述。

* **动作**:动作是代理可以采取的行动。

* **奖励**:奖励是代理在采取特定动作后收到的反馈。

**4.2.2 强化学习的算法**

有许多强化学习算法,包括:

* **Q 学习**:Q 学习是一种无模型算法,它估计每个状态-动作对的价值。

* **策略梯度**:策略梯度是一种基于梯度的算法,它直接优化策略函数。

* **演员-评论家**:演员-评论家是一种算法,它使用演员网络来选择动作,并使用评论家网络来评估动作。

**代码块:**

```python

import gym

import numpy as np

# 创建环境

env = gym.make("CartPole-v1")

# 创建代理

agent = ... # 使用 Q 学习、策略梯度或演员-评论家算法创建代理

# 训练代理

for episode in range(100):

state = env.reset()

done = False

while not done:

action = agent.act(state)

next_state, reward, done, _ = env.step(action)

agent.learn(state, action, reward, next_state, done)

state = next_state

```

**逻辑分析:**

该代码块展示了强化学习的训练过程。它创建了一个环境、一个代理和一个训练循环。训练循环迭代 100 个 episode,在每个 episode 中,代理与环境交互,采取动作并接收奖励。代理使用这些经验来更新其策略,以便在未来做出更好的决策。

**4.3 无监督学习**

**4.3.1 聚类分析**

聚类分析是一种无监督学习算法,用于将数据点分组到称为簇的相似组中。聚类分析算法包括:

* **k 均值聚类**:k 均值聚类是一种基于距离的算法,它将数据点分配到 k 个簇中,其中 k 是一个预定义的参数。

* **层次聚类**:层次聚类是一种基于层次的算法,它创建一棵树状图,其中数据点按相似度分组。

* **密度聚类**:密度聚类是一种基于密度的算法,它将数据点分配到簇中,其中簇是数据点密度高的区域。

**4.3.2 降维算法**

降维算法是一种无监督学习算法,用于将高维数据投影到低维空间中。降维算法包括:

* **主成分分析 (PCA)**:PCA 是一种基于协方差的算法,它将数据投影到由数据最大方差方向张成的子空间中。

* **奇异值分解 (SVD)**:SVD 是一种基于矩阵分解的算法,它将数据投影到由数据最大奇异值对应的奇异向量张成的子空间中。

* **t 分布邻域嵌入 (t-SNE)**:t-SNE 是一种基于概率的算法,它将数据投影到低维空间中,同时保持数据点的局部邻域关系。

# 5. 神经网络的未来发展

随着神经网络技术的发展,研究人员正在探索新的领域和应用,以进一步推动其能力和影响力。以下是神经网络未来发展的几个关键方向:

### 5.1 量子神经网络

量子神经网络是将量子计算原理应用于神经网络的一种新兴领域。量子计算机具有处理大量数据和执行复杂计算的巨大潜力,这可以显着提高神经网络的性能。量子神经网络有望在优化、机器学习和人工智能等领域取得突破。

### 5.2 神经形态计算

神经形态计算是一种受人脑启发的计算范式。神经形态系统模仿人脑的结构和功能,允许它们以高效和低功耗的方式处理信息。神经形态神经网络可以用于创建更智能、更节能的设备,例如自主机器人和智能传感器。

### 5.3 可解释性神经网络

可解释性神经网络是能够解释其决策和预测的模型。这对于提高神经网络的透明度和可信度至关重要,尤其是在涉及高风险决策的应用中。可解释性神经网络可以帮助研究人员和从业人员了解神经网络如何工作,并识别潜在的偏见或错误。

神经网络的未来发展充满着无限的可能性。随着这些新兴领域的不断探索,神经网络有望在未来几年继续改变各行各业,为社会带来前所未有的进步和创新。

0

0