深度学习与无监督学习的完美结合:自编码器的应用案例

发布时间: 2024-09-02 09:16:29 阅读量: 163 订阅数: 49

# 1. 深度学习与无监督学习概述

## 1.1 什么是深度学习

深度学习是机器学习的一个分支,主要通过模拟人脑的神经网络结构来进行特征学习与数据抽象。它利用多层神经网络处理非线性和高维数据,已成功应用于图像识别、语音处理、自然语言处理等领域。

## 1.2 无监督学习的定义

无监督学习是一种机器学习方法,它不依赖于预先标记的数据,而是从数据中识别模式、结构和关系。无监督学习的核心目标是发现隐藏在数据中的固有结构和分布。

## 1.3 深度学习与无监督学习的关联

在深度学习中,无监督学习特别关键,因为它能够在数据标注昂贵或不可能的情况下,通过自编码器等模型挖掘数据潜在的特征。这些特征随后可以用于其他学习任务,例如监督学习中的分类或回归任务。

# 2. 自编码器的基础理论

自编码器是一种特殊类型的神经网络,它在无监督学习领域中扮演着重要角色。通过学习输入数据的高效压缩表示,它们可以用于降维、特征提取、异常检测等多种应用。本章将详细介绍自编码器的基础理论,包括其概念、工作机制、类型与结构,以及训练过程中的优化方法。

## 2.1 自编码器的概念与原理

### 2.1.1 神经网络基础回顾

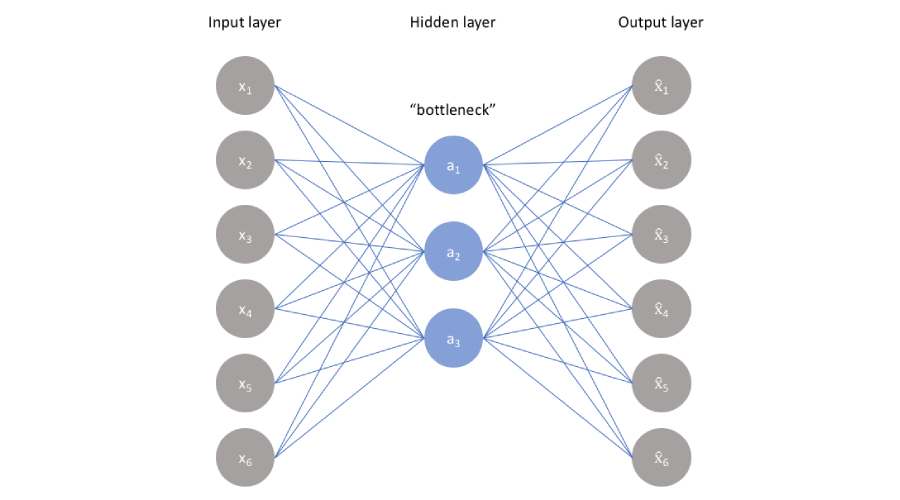

在探讨自编码器之前,有必要简要回顾一下神经网络的基础知识。神经网络是一种模仿人脑神经元之间交互方式的计算模型,由输入层、多个隐藏层和输出层组成。每个层中包含若干神经元,它们通过权重连接。神经网络的基本操作包括前向传播和反向传播。前向传播用于计算输入数据在网络中的输出,而反向传播则用于根据误差调整权重,以优化网络性能。

在无监督学习的背景下,自编码器的目的是学习输入数据的一个压缩表示,从而能够重构出与输入尽可能接近的输出。这种压缩表示称为编码(code),而重构过程则涉及解码(decode)。自编码器通常由编码器(encoder)和解码器(decoder)两部分组成,其中编码器负责将输入映射到压缩空间,解码器则将压缩空间的表示映射回数据空间。

### 2.1.2 自编码器的工作机制

自编码器的核心思想是训练网络学习一个恒等函数,即其输出尽可能接近输入。为了实现这一点,它需要通过编码器压缩信息并由解码器重建输入数据。如果网络成功地重建输入,那么我们可以认为它已经学会了一个有效的数据表示。

自编码器的训练是一个无监督学习的过程,不需要标注数据。它通过最小化输入和输出之间的差异来学习参数。差异通常通过损失函数来度量,常用的损失函数包括均方误差(MSE)和交叉熵损失。

自编码器的一个关键特性是编码的维度低于输入数据的维度,这种结构迫使网络学习到输入数据的最压缩且最能代表性的特征。通过这种方式,自编码器能够在降维和特征提取方面发挥作用。

## 2.2 自编码器的类型与结构

### 2.2.1 标准自编码器

标准自编码器是最简单的自编码器形式,包含一个编码器和一个解码器。编码器通常由一个或多个完全连接的层(fully connected layer)构成,这些层减少输入维度以形成潜在表示。解码器的作用则是通过完全连接的层将潜在表示映射回数据维度。

对于标准自编码器而言,其主要挑战在于避免过拟合。过拟合是指模型在训练数据上表现良好,但在未见过的新数据上表现差。为了解决这个问题,研究人员引入了正则化技术,如权重衰减(weight decay)和dropout。

### 2.2.2 变分自编码器(VAE)

变分自编码器(Variational Autoencoder,VAE)是一种概率生成模型,它在标准自编码器的基础上引入了随机性。VAE使用概率分布对潜在空间进行建模,并通过采样这些分布来生成新的数据样本。

VAE的关键之处在于编码器输出的是潜在变量的概率分布参数(例如均值和方差),而不是确定性的潜在表示。解码器随后从这个潜在分布中采样,以生成新的数据点。由于其生成特性,VAE在图像生成、语音合成等应用中非常受欢迎。

### 2.2.3 去噪自编码器(DAE)

去噪自编码器(Denoising Autoencoder,DAE)是一种特殊类型的自编码器,它在编码输入之前先对其进行破坏,然后让解码器重建未损坏的原始输入。这种破坏可以是随机地将输入的一部分值置为零(即添加噪声)。

去噪自编码器迫使模型学习到一个更鲁棒的、能够忽略输入噪声的表示。这种表示通常具有更好的泛化能力,因为在实际应用中,我们很少能够获得完全无噪声的数据。

## 2.3 自编码器训练与优化

### 2.3.1 损失函数的选择

自编码器的训练依赖于损失函数来指导网络学习。损失函数衡量的是网络输出和目标数据(通常是输入数据本身)之间的差异。最常用的损失函数是均方误差,它计算输出与目标之间的平方差的平均值。

对于二进制数据,通常使用二元交叉熵损失函数;对于多类别数据,可以使用分类交叉熵损失函数。选择适当的损失函数取决于具体任务的需求和数据类型。

### 2.3.2 反向传播算法的实现

反向传播是训练自编码器的关键过程,它用于根据损失函数计算出的误差更新网络中的权重。反向传播算法首先执行前向传播计算输出,然后计算损失函数关于输出的导数,接着反向传递误差信号以计算梯度,最后使用梯度下降或其他优化算法来更新权重。

关键步骤包括:

1. 初始化网络权重。

2. 前向传播输入数据通过网络。

3. 计算输出与目标之间的损失。

4. 反向传播损失通过网络以计算梯度。

5. 更新网络权重以减小损失。

### 2.3.3 正则化技巧和超参数调整

正则化是在训练过程中加入的额外约束,旨在防止模型过度复杂化。在自编码器中,常用的方法包括L1和L2正则化,它们通过给损失函数添加额外项来限制权重的大小。

除了正则化,超参数调整也至关重要,它包括但不限于学习率、批次大小(batch size)、迭代次数(epochs)以及潜在表示的维度等。超参数的选择将直接影响模型的性能。

一个有效的调整策略是从一个较大的范围开始,进行粗略的网格搜索,找到最佳的参数范围,然后再通过更细致的搜索来精细调整这些参数。此外,也可以采用基于模型表现的自动化超参数优化方法,如贝叶斯优化。

```python

# 示例代码:实现一个简单的自编码器训练过程

import numpy as np

from keras.layers import Input, Dense

from keras.models import Model

from keras.optimizers import RMSprop

# 定义自编码器参数

input_dim = 784 # 例如,将28x28的图片展平为784个像素值

encoding_dim = 32 # 编码维度,即潜在空间的维度

# 编码器模型构建

input_img = Input(shape=(input_dim,))

encoded = Dense(encoding_dim, activation='relu')(input_img)

# 解码器模型构建

decoded = Dense(input_dim, activation='sigmoid')(encoded)

# 自编码器模型搭建,将编码器和解码器串联起来

autoencoder = Model(input_img, decoded)

# 编译模型

***pile(optimizer=RMSprop(), loss='binary_crossentropy')

# 训练模型

autoencoder.fit(x_train, x_train,

epochs=50,

batch_size=

```

0

0