MATLAB预测模型中的决策树和随机森林:构建强大的分类器

发布时间: 2024-06-14 05:10:27 阅读量: 20 订阅数: 20

# 1. 决策树和随机森林概述**

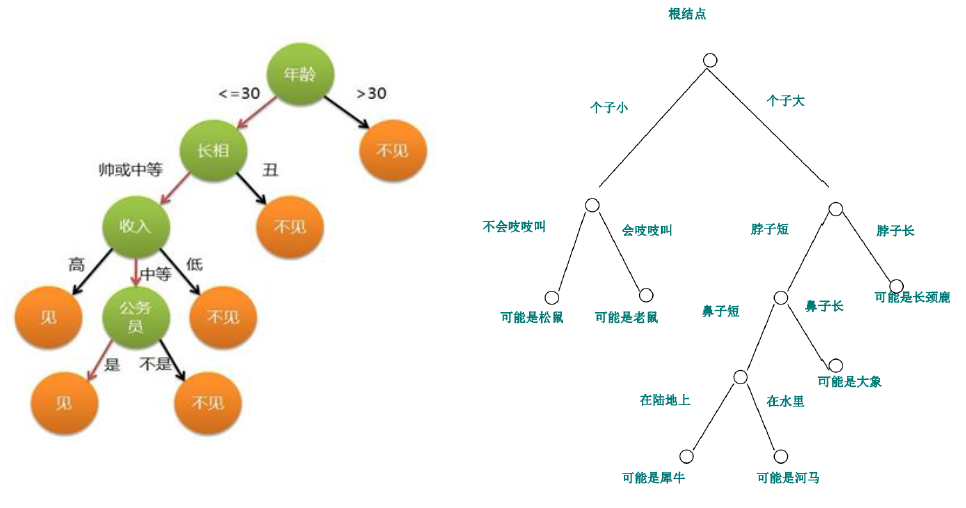

决策树和随机森林是机器学习中强大的分类算法,它们在各种领域中得到广泛应用。决策树通过一系列规则将数据点划分为不同的类别,而随机森林则通过组合多个决策树来提高预测准确性。

决策树的构建过程涉及选择最佳特征来划分数据,并递归地将数据划分为子集,直到每个子集包含一个类。随机森林通过随机选择特征和数据子集来构建多个决策树,然后将这些树的预测结果进行组合。这种集成方法有助于减少过拟合,提高泛化能力。

# 2. 决策树理论

### 2.1 决策树的基本原理

决策树是一种监督学习算法,它通过递归地将数据集分割成更小的子集来构建决策模型。每个子集代表数据集中的一个决策节点,而决策树的叶子节点则代表最终的预测结果。

决策树的构建过程如下:

1. **选择根节点:**选择一个特征作为根节点,该特征对目标变量的区分度最高。

2. **分割数据集:**根据根节点的取值将数据集分割成两个或多个子集。

3. **递归地构建子树:**对每个子集重复步骤 1 和 2,直到满足停止条件(例如,数据集太小或所有样本都属于同一类)。

4. **生成决策树:**将所有子树连接起来形成一棵决策树。

### 2.2 决策树的构建和剪枝

#### 2.2.1 信息增益和信息增益率

信息增益衡量一个特征对目标变量区分度的指标。它计算为:

```

信息增益(特征) = 信息熵(数据集) - 信息熵(特征分割后的数据集)

```

信息熵衡量数据集的不确定性,计算为:

```

信息熵(数据集) = -Σ(p_i * log2(p_i))

```

其中,p_i 是数据集属于第 i 类的概率。

信息增益率是信息增益的归一化形式,它考虑了特征的取值个数:

```

信息增益率(特征) = 信息增益(特征) / 分裂信息(特征)

```

其中,分裂信息衡量特征分割数据集的难度,计算为:

```

分裂信息(特征) = -Σ(p_i * log2(p_i))

```

#### 2.2.2 剪枝策略

剪枝是减少决策树复杂度和防止过拟合的一种技术。常见的剪枝策略包括:

* **预剪枝:**在决策树构建过程中,当信息增益或信息增益率低于某个阈值时,停止分裂。

* **后剪枝:**在决策树构建完成后,从底部向上剪除不重要的子树。

### 2.3 决策树的优缺点

**优点:**

* 易于理解和解释

* 可以处理连续和分类数据

* 不需要特征缩放或归一化

* 可以处理缺失值

**缺点:**

* 容易过拟合

* 对噪声数据敏感

* 决策边界可能过于简单

# 3.1 随机森林的原理和优势

随机森林是一种集成学习算法,它通过构建多个决策树并对它们的预测进行平均来提高预测精度。其原理如下:

1. **Bootstrapping

0

0