【SVD算法揭秘】:探索奇异值分解的原理与应用,解锁数据洞察

发布时间: 2024-08-22 03:25:49 阅读量: 28 订阅数: 47

# 1. 奇异值分解(SVD)基础**

奇异值分解(SVD)是一种强大的数学工具,用于分析矩阵并提取其内在结构。它将一个矩阵分解成三个矩阵的乘积:一个左奇异矩阵、一个对角奇异值矩阵和一个右奇异矩阵。

SVD具有广泛的应用,从数据分析到图像处理再到自然语言处理。它可以用于降维、特征提取、协同过滤和文本主题建模。在本章中,我们将探讨SVD的基础知识,包括其数学定义、几何解释和计算方法。

# 2. SVD原理与数学推导**

## 2.1 SVD的数学定义和几何解释

奇异值分解(SVD)是一种线性代数技术,用于将矩阵分解为三个矩阵的乘积:一个酉矩阵(U)、一个对角矩阵(Σ)和另一个酉矩阵(V)。

**数学定义:**

设A是一个m×n矩阵,则其SVD可以表示为:

```

A = UΣV^T

```

其中:

* U是一个m×m酉矩阵,其列向量是A的左奇异向量。

* Σ是一个m×n对角矩阵,其对角线元素是A的奇异值,按降序排列。

* V是一个n×n酉矩阵,其列向量是A的右奇异向量。

**几何解释:**

SVD可以从几何角度理解为将矩阵A分解为一系列旋转和拉伸操作。

* **旋转:**U和V是旋转矩阵,它们将A的列空间和行空间旋转到标准正交基上。

* **拉伸:**Σ的对角线元素代表了A的奇异值,它们确定了A在不同方向上的拉伸程度。

## 2.2 SVD的计算方法和算法

计算SVD的方法有多种,其中最常用的算法是QR算法。QR算法是一种迭代算法,它交替应用QR分解和反向QR分解,直到矩阵A收敛到SVD形式。

**QR算法步骤:**

1. 将A分解为QR分解:A = QR

2. 将Q分解为QR分解:Q = QR

3. 重复步骤1和2,直到A收敛到SVD形式

**参数说明:**

* **最大迭代次数:**指定算法的最大迭代次数。

* **收敛阈值:**指定算法停止迭代的收敛阈值。

**代码块:**

```python

import numpy as np

def svd(A, max_iter=100, tol=1e-6):

"""

计算矩阵A的奇异值分解

参数:

A:输入矩阵

max_iter:最大迭代次数

tol:收敛阈值

返回:

U:左奇异向量矩阵

Σ:奇异值对角矩阵

V:右奇异向量矩阵

"""

m, n = A.shape

U = np.eye(m)

V = np.eye(n)

for _ in range(max_iter):

Q, R = np.linalg.qr(A)

A = R @ Q

Q, R = np.linalg.qr(A.T)

A = Q.T @ R

if np.linalg.norm(A - U @ np.diag(np.diag(A)) @ V.T) < tol:

break

Σ = np.diag(np.diag(A))

return U, Σ, V

```

**代码逻辑逐行解读:**

* 第1行:导入NumPy库。

* 第2-6行:定义SVD函数,指定输入参数和返回参数。

* 第8-9行:获取矩阵A的形状。

* 第10行:初始化左奇异向量矩阵U和右奇异向量矩阵V为单位矩阵。

* 第12-17行:执行QR算法迭代。

* 第18-21行:检查收敛条件,如果满足则停止迭代。

* 第22-23行:提取奇异值对角矩阵Σ。

* 第24行:返回U、Σ和V。

# 3.1 降维和数据可视化

SVD在数据分析中的一个重要应用是降维和数据可视化。降维是指将高维数据投影到低维空间中,以方便可视化和分析。SVD可以用来实现降维,因为它可以将数据分解为一系列正交向量和奇异值。

#### 3.1.1 主成分分析(PCA)

主成分分析(PCA)是一种广泛使用的降维技术,它使用SVD来识别数据中最主要的特征。PCA通过计算协方差矩阵的特征向量和特征值来实现降维。特征向量代表数据中的主要方向,而特征值表示这些方向上的数据方差。

```python

import numpy as np

from sklearn.decomposition import PCA

# 加载数据

data = np.loadtxt('data.csv', delimiter=',')

# 创建PCA模型

pca = PCA(n_components=2)

# 拟合数据

pca.fit(data)

# 降维

reduced_data = pca.transform(data)

```

PCA的代码逻辑如下:

- `n_components`参数指定要投影到的维度数。

- `fit`方法计算协方差矩阵的特征向量和特征值。

- `transform`方法将数据投影到低维空间中。

#### 3.1.2 奇异值阈值(SVT)

奇异值阈值(SVT)是一种另一种降维技术,它使用SVD来选择具有显著奇异值的数据特征。SVT通过设置一个阈值来过滤掉小奇异值,从而减少数据的维度。

```python

import numpy as np

# 加载数据

data = np.loadtxt('data.csv', delimiter=',')

# 计算奇异值分解

U, s, Vh = np.linalg.svd(data, full_matrices=False)

# 设置奇异值阈值

threshold = 0.1

# 过滤奇异值

significant_s = s[s > threshold]

# 降维

reduced_data = U[:, :len(significant_s)] @ np.diag(significant_s) @ Vh

```

SVT的代码逻辑如下:

- `np.linalg.svd`函数计算SVD分解。

- `threshold`参数指定奇异值阈值。

- 过滤奇异值后,使用`U`、`s`和`Vh`重建低维数据。

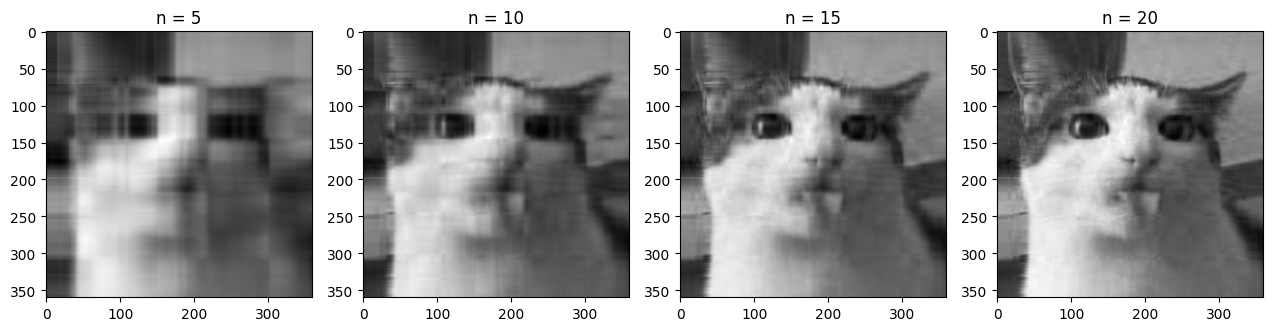

# 4. SVD在图像处理中的应用

奇异值分解(SVD)在图像处理领域具有广泛的应用,它可以有效地解决图像降噪、去模糊、压缩和特征提取等问题。

### 4.1 图像降噪和去模糊

#### 4.1.1 低秩近似

图像降噪的目标是去除图像中的噪声,而低秩近似是一种有效的降噪方法。图像可以近似为一个低秩矩阵,噪声则表现为高秩分量。通过SVD,我们可以将图像分解为低秩矩阵和高秩矩阵,然后丢弃高秩分量即可得到降噪后的图像。

```python

import numpy as np

from scipy.linalg import svd

# 读取图像

image = cv2.imread('noisy_image.jpg')

# 将图像转换为灰度图

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 进行SVD分解

U, s, Vh = svd(gray_image, full_matrices=False)

# 选择奇异值阈值

threshold = 10

# 重构低秩近似图像

denoised_image = np.dot(U[:, :threshold], np.dot(np.diag(s[:threshold]), Vh[:threshold, :]))

# 显示降噪后的图像

cv2.imshow('Denoised Image', denoised_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

#### 4.1.2 奇异值阈值(SVT)

奇异值阈值(SVT)是一种基于SVD的去模糊算法。它通过对奇异值进行阈值处理,去除高频噪声分量,从而实现图像去模糊。

```python

import numpy as np

from scipy.linalg import svd

# 读取图像

image = cv2.imread('blurred_image.jpg')

# 将图像转换为灰度图

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 进行SVD分解

U, s, Vh = svd(gray_image, full_matrices=False)

# 选择奇异值阈值

threshold = 10

# 重构去模糊图像

deblurred_image = np.dot(U[:, :threshold], np.dot(np.diag(s[:threshold]), Vh[:threshold, :]))

# 显示去模糊后的图像

cv2.imshow('Deblurred Image', deblurred_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

### 4.2 图像压缩和特征提取

#### 4.2.1 JPEG和JPEG2000

JPEG和JPEG2000是两种广泛使用的图像压缩算法。它们都利用SVD来减少图像数据量。JPEG通过丢弃高频奇异值来实现压缩,而JPEG2000则采用小波变换和SVD相结合的方式进行压缩。

#### 4.2.2 SIFT和SURF

SIFT(尺度不变特征变换)和SURF(加速鲁棒特征)是两种图像特征提取算法。它们都利用SVD来计算图像的特征点和描述符。SIFT算法通过对图像进行高斯金字塔分解,然后在每个尺度上进行SVD,提取特征点和描述符。SURF算法则采用积分图像和Hessian矩阵来提取特征点,并使用SVD计算描述符。

# 5. SVD在自然语言处理中的应用

### 5.1 文本主题建模和聚类

#### 5.1.1 潜在语义分析(LSA)

潜在语义分析(LSA)是一种基于SVD的文本主题建模技术,它将文本表示为一个词项-文档矩阵,并使用SVD将该矩阵分解为三个矩阵:

```mermaid

graph LR

subgraph LSA分解

A[词项-文档矩阵] --> B[奇异值矩阵] --> C[左奇异矩阵]

A[词项-文档矩阵] --> B[奇异值矩阵] --> D[右奇异矩阵]

end

```

其中,奇异值矩阵的对角元素表示了文本的潜在主题,左奇异矩阵表示了词项在每个主题中的权重,右奇异矩阵表示了文档在每个主题中的权重。

#### 5.1.2 概率潜在语义分析(PLSA)

概率潜在语义分析(PLSA)是LSA的概率模型扩展,它假设文本中的每个词是由一个潜在主题和一个词项生成模型共同生成的。PLSA的分解过程与LSA类似,但它使用概率模型来估计奇异值矩阵和主题权重。

### 5.2 文本分类和情感分析

#### 5.2.1 奇异值分类(SVC)

奇异值分类(SVC)是一种基于SVD的文本分类技术,它将文本表示为一个词项-文档矩阵,并使用SVD将该矩阵分解为奇异值矩阵和奇异向量矩阵。

```python

# 使用SVD进行文本分类

from sklearn.decomposition import TruncatedSVD

from sklearn.linear_model import LogisticRegression

# 加载文本数据

X = tfidf_matrix # 词项-文档矩阵

# 使用SVD分解文本数据

svd = TruncatedSVD(n_components=100)

X_svd = svd.fit_transform(X)

# 使用奇异值矩阵进行分类

clf = LogisticRegression()

clf.fit(X_svd, y) # y为文本类别标签

```

#### 5.2.2 奇异值情感分析(SVEA)

奇异值情感分析(SVEA)是一种基于SVD的情感分析技术,它将文本表示为一个词项-文档矩阵,并使用SVD将该矩阵分解为奇异值矩阵和奇异向量矩阵。

```python

# 使用SVD进行情感分析

from sklearn.decomposition import TruncatedSVD

from sklearn.linear_model import LogisticRegression

# 加载文本数据

X = tfidf_matrix # 词项-文档矩阵

# 使用SVD分解文本数据

svd = TruncatedSVD(n_components=100)

X_svd = svd.fit_transform(X)

# 使用奇异值矩阵进行情感分析

clf = LogisticRegression()

clf.fit(X_svd, y) # y为文本情感标签

```

0

0