【R语言内存管理艺术】:管理kmeans内存消耗,优化分析体验

发布时间: 2024-11-03 06:15:49 阅读量: 24 订阅数: 22

# 1. R语言与内存管理基础

内存管理是任何编程语言中的一个重要方面,尤其是对于像R这样的高级统计语言,其在数据分析和统计建模方面广泛应用。本章将简要介绍R语言的基本概念,并探讨其内存管理的基础知识。

## 1.1 R语言简介

R是一种专为统计分析和图形表示设计的编程语言和环境。它的开源特性和丰富的社区支持使其成为数据科学家和统计学家的首选工具。R语言支持多种数据结构,如向量、矩阵、数据框(data frames)和列表(lists)。

## 1.2 内存管理基础

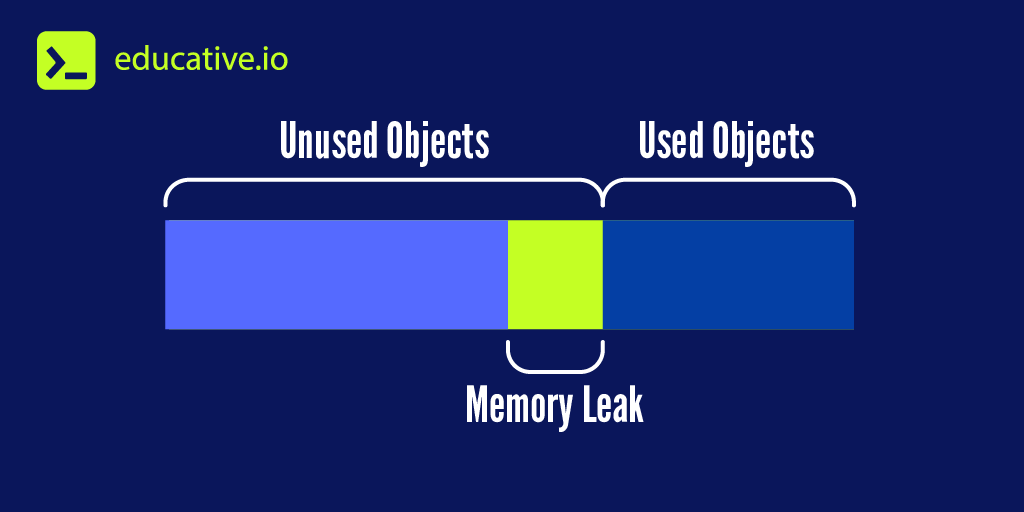

在R中,内存管理是指在执行数据分析时,如何有效地分配和回收内存资源。R语言提供了一些内置函数和环境变量来监控和管理内存。了解这些机制对于防止内存泄露和优化代码性能至关重要。

```r

# 使用gc()函数查看当前的内存使用情况

gc()

# 使用memory.limit()设置内存限制(仅限于Windows平台)

memory.limit(size = 2000)

```

上例中,`gc()`函数用于触发R的垃圾回收器,从而可以回收不再使用的内存。`memory.limit()`函数则用于设置R环境能够使用的最大内存容量。

通过本章的学习,读者将对R语言内存管理有一个初步的认识,为后续章节深入探讨内存管理技巧和优化方法打下基础。

# 2. 深入理解kmeans算法及其内存开销

kmeans聚类算法是数据科学中常用的一种无监督学习算法,它以数据点到各个聚类中心的欧氏距离作为判定标准,通过迭代计算使得聚类中心不断调整,最终达到数据点的归类目的。然而,随着数据集规模的增加,kmeans算法的内存开销逐渐成为限制其应用的一个重要因素。在本章节中,我们将深入探讨kmeans算法的工作原理、内存消耗机制以及如何在R语言中有效监控和优化内存使用。

### 2.1 kmeans算法的原理与应用

#### 2.1.1 kmeans算法的工作流程

kmeans算法通过以下步骤实现数据聚类:

1. 随机选择k个数据点作为初始聚类中心。

2. 对于每个数据点,计算其与每个聚类中心的距离,并将数据点划分到距离最近的聚类中心所代表的类别中。

3. 重新计算每个类别的聚类中心位置,即该类中所有点的均值。

4. 重复步骤2和步骤3,直到聚类中心位置不再发生显著变化,或者达到预定的迭代次数。

kmeans算法具有简单、快速的优点,但同时也存在对初始聚类中心敏感、需要预先指定聚类数量k等局限性。

#### 2.1.2 kmeans算法在R中的实现

在R语言中,我们可以使用基础函数`kmeans()`来实现kmeans聚类。下面是一个简单的示例:

```R

# 加载数据集

data(iris)

# 使用前四列数据进行聚类

setosa_and_versicolor <- iris[iris$Species != "virginica", 1:4]

# 执行kmeans聚类

setosa_and_versicolor_kmeans <- kmeans(setosa_and_versicolor, centers=2)

# 查看聚类结果

print(setosa_and_versicolor_kmeans$size)

```

在这段代码中,我们首先加载了iris数据集,并选择了其中的前四列数据进行聚类。`kmeans()`函数将数据集分为两个聚类中心,并返回一个包含聚类结果的对象。

### 2.2 kmeans内存消耗分析

#### 2.2.1 数据集大小对内存的影响

kmeans算法的内存消耗主要由以下几个因素决定:

1. 数据集的规模:数据点的数量和每个数据点的维度。

2. 聚类中心的数量:在初始化和迭代过程中都需要存储聚类中心。

随着数据集规模的增加,需要存储的数据点和聚类中心数量都会增加,从而导致内存消耗增大。在R中,数据主要以矩阵或数据框(data frame)的形式存储,而这些数据结构在处理大规模数据时可能会导致内存不足。

#### 2.2.2 参数设定对内存消耗的影响

除了数据集大小外,kmeans算法中的参数设定也会对内存消耗产生影响:

- **centers**:聚类中心数量。该参数直接影响内存消耗,因为每个聚类中心都需要内存来存储其位置信息。

- **nstart**:随机选择初始中心的次数。每次迭代都可能产生新的聚类中心,因此`nstart`值越大,内存消耗也会相应增加。

- **iter.max**:迭代的最大次数。虽然每次迭代中聚类中心的位置变化不大,但持续的迭代也会对内存产生压力。

通过合理设置这些参数,可以在保证聚类质量的同时减少不必要的内存使用。

### 2.3 R语言中监控内存使用

#### 2.3.1 内存使用情况的实时监控方法

在R语言中,我们可以通过内置函数`memory.size()`和`memory.limit()`来监控和管理内存使用情况。`memory.size()`可以返回当前R进程已使用的内存量(单位为MB),而`memory.limit()`可以设置内存使用的上限。

```R

# 查看当前已使用内存

current_memory_usage <- memory.size()

print(paste("当前内存使用量:", current_memory_usage, "MB"))

# 设置内存使用上限为2048MB

memory.limit(size=2048)

```

这些函数可以帮助我们在进行大规模计算之前确保有足够的内存,并在运行过程中监控内存的使用情况。

#### 2.3.2 常用内存优化工具介绍

在R语言中,除了内置函数外,还有一些第三方工具可以帮助我们更好地管理内存,例如`tracemem`和`profvis`。

- `tracemem`:它可以跟踪对象被复制的情况,这对于了解数据在内存中的使用和复制情况非常有用。

- `profvis`:这是一个性能分析工具,它可以可视化内存使用情况,帮助我们发现内存消耗的热点。

```R

# 跟踪对象复制

tracked_object <- tracemem(iris)

iris_copy <-

```

0

0