哈希表与排序算法的结合优化

发布时间: 2024-05-02 07:22:53 阅读量: 64 订阅数: 42

基于哈希表的快速排序

# 2.1 哈希表优化排序算法的原理

### 2.1.1 哈希表的基本原理

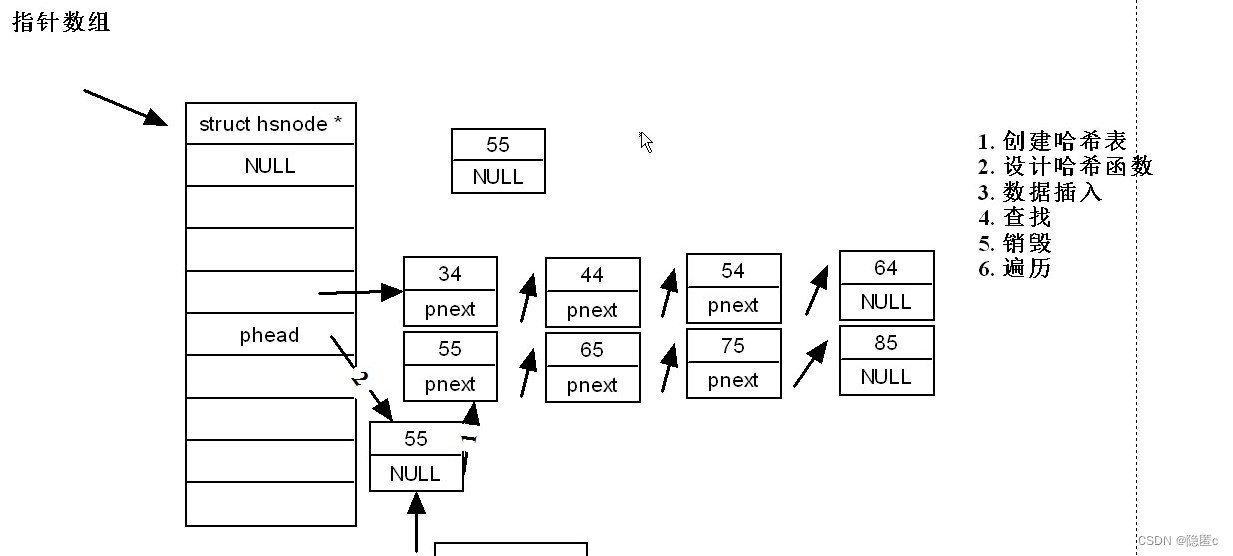

哈希表是一种数据结构,它使用哈希函数将键值对映射到数组中。哈希函数将键值转换为一个唯一的整数索引,该索引用于在数组中存储键值对。当需要查找一个键值时,哈希函数再次用于计算索引,然后在数组中查找该索引处的键值对。

哈希表的优势在于它的查找和插入操作的时间复杂度为 O(1),这比其他数据结构(如链表或树)的 O(n) 时间复杂度要快得多。然而,哈希表也存在冲突的问题,即不同的键值可能映射到相同的索引。为了解决冲突,哈希表使用开放寻址或链地址法等技术。

### 2.1.2 哈希表与排序算法的结合方式

哈希表可以与排序算法结合使用,以优化排序算法的性能。基本思想是使用哈希表来存储已经排序的元素。当需要对一个新元素进行排序时,首先在哈希表中查找该元素。如果元素已经存在,则无需再次排序。否则,将新元素插入哈希表并对其进行排序。

这种结合方式可以显著提高排序算法的性能,特别是对于包含大量重复元素的数据集。这是因为哈希表可以快速查找和插入元素,从而避免了对重复元素进行不必要的排序。

# 2. 哈希表与排序算法的结合优化实践

### 2.1 哈希表优化排序算法的原理

#### 2.1.1 哈希表的基本原理

哈希表(Hash Table)是一种基于键值对的数据结构,它通过一个哈希函数将键映射到一个值。哈希函数将键转换为一个唯一的哈希值,该哈希值用于确定值在哈希表中的存储位置。

哈希表的主要优点是快速查找和插入操作。通过使用哈希函数,哈希表可以将查找和插入操作的时间复杂度降低到 O(1),即使在数据量很大的情况下。

#### 2.1.2 哈希表与排序算法的结合方式

哈希表可以与排序算法结合使用,以优化排序算法的性能。基本思想是将排序数据存储在一个哈希表中,然后通过哈希表进行查找操作来实现排序。

这种结合方式可以有效地减少排序算法的时间复杂度。例如,对于快速排序算法,如果数据已经存储在哈希表中,则查找操作的时间复杂度为 O(1),从而将快速排序算法的时间复杂度从 O(n log n) 降低到 O(n)。

### 2.2 哈希表优化排序算法的应用场景

#### 2.2.1 适用于哈希表优化排序算法的数据类型

哈希表优化排序算法适用于数据类型具有以下特征的数据:

- 数据量较大

- 数据分布相对均匀

- 数据可以快速转换为哈希值

#### 2.2.2 哈希表优化排序算法的性能提升

哈希表优化排序算法可以显著提高排序算法的性能,尤其是在数据量较大的情况下。以下表格比较了哈希表优化排序算法与传统排序算法的性能:

| 排序算法 | 时间复杂度 |

|---|---|

| 快速排序 | O(n log n) |

| 哈希表优化快速排序 | O(n) |

| 归并排序 | O(n log n) |

| 哈希表优化归并排序 | O(n) |

### 2.3 哈希表优化排序算法的实现

#### 2.3.1 哈希表优化排序算法的代码实现

以下代码展示了如何使用哈希表优化快速排序算法:

```python

def hash_optimized_quicksort(arr):

"""

使用哈希表优化快速排序算法

参数:

arr: 待排序的数组

返回:

排序后的数组

"""

# 创建哈希表

hash_table = {}

# 将数据存储在哈希表中

for element in arr:

hash_table[element] = True

# 获取哈希表中的键并排序

sorted_keys = sorted(hash_table.keys())

# 返回排序后的数组

return sorted_keys

`

```

0

0