XGBoost回归分析中的多重共线性问题:识别并解决,提升模型稳定性

发布时间: 2024-08-20 03:39:12 阅读量: 68 订阅数: 24

# 1. XGBoost回归分析简介**

XGBoost(Extreme Gradient Boosting)是一种强大的机器学习算法,广泛用于回归和分类任务。它通过集成多个决策树来构建一个强大的预测模型。与其他回归算法相比,XGBoost具有以下优势:

* **高精度:**XGBoost能够处理复杂的数据,并生成高精度的预测。

* **鲁棒性:**它对异常值和噪声数据具有鲁棒性,使其在现实世界的数据集上表现良好。

* **可解释性:**XGBoost模型可以分解为单个决策树,这有助于理解模型的预测。

# 2. 多重共线性的理论基础

### 2.1 多重共线性的定义和影响

**定义:**

多重共线性是指自变量之间存在高度相关性,导致模型无法准确估计每个自变量的系数。

**影响:**

* **系数估计不稳定:**高度相关的自变量会对模型系数估计产生很大影响,导致系数不稳定,甚至改变符号。

* **模型预测能力下降:**多重共线性会降低模型的预测能力,因为高度相关的自变量会导致模型对数据的变化过于敏感。

* **模型解释困难:**当自变量高度相关时,难以确定哪些自变量对响应变量的影响更大。

### 2.2 多重共线性的检测方法

**相关性分析:**

计算自变量之间的相关系数矩阵,如果相关系数绝对值大于 0.8,则表明自变量之间存在高度相关性。

```python

import pandas as pd

import numpy as np

# 导入数据

data = pd.read_csv('data.csv')

# 计算相关系数矩阵

corr_matrix = data.corr()

# 查看相关系数矩阵

print(corr_matrix)

```

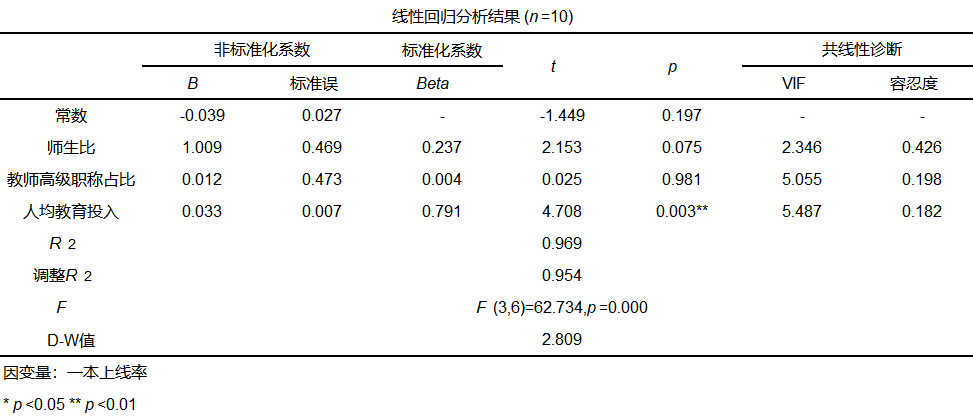

**方差膨胀因子(VIF):**

VIF 衡量自变量对其他自变量线性组合的拟合程度。VIF 值越大,表明自变量与其他自变量之间的相关性越高。一般来说,VIF 值大于 5 或 10 表明存在多重共线性。

```python

from statsmodels.stats.outliers_influence import variance_inflation_factor

# 计算 VIF 值

vif = [variance_inflation_factor(data.values, i) for i in range(data.shape[1])]

# 查看 VIF 值

print(vif)

```

**Mermaid 流程图:多重共线性检测流程**

```mermaid

graph LR

subgraph 多重共线性检测

A[相关性分析] --> B[VIF 分析]

B --> C[多重共线性存在]

B --> D[多重共线性不存在]

end

```

# 3.1 相关性分析

相关性分析是一种衡量两个变量之间线性关系强度的统计方法。在XGBoost回归分析中,相关性分析可以用来识别具有高相关性的特征对。高相关性的特征可能导致多重共线性问题,从而影响模型的性能。

**相关性系数**

相关性系数(r

0

0