半监督学习的集成学习方法:提升模型泛化的秘诀

发布时间: 2024-11-19 18:07:37 阅读量: 5 订阅数: 14

# 1. 半监督学习基础

半监督学习是一种重要的机器学习方法,它在有大量未标记数据和有限标记数据的情况下表现出色。它旨在充分利用未标记数据的分布特性,以指导模型更好地泛化到未知数据上。

## 1.1 半监督学习的核心概念

半监督学习的中心思想是,尽管不是所有数据都有标签,但是未标记的数据依然包含有用的结构信息和规律。通过合理地结合这些信息,半监督算法能够以少量的标记数据和大量的未标记数据提升模型性能。

## 1.2 半监督学习的常见方法

半监督学习涵盖多种策略和技术,包括半监督分类、回归、聚类等。常见的方法有自训练、标签传播算法和半监督集成学习等,每种方法都试图以不同的方式利用未标记数据的优势。

半监督学习的发展不断推动着机器学习领域的边界,它不仅在理论层面提供了新视角,在实际应用中也为解决数据稀缺问题提供了可行方案。在接下来的章节中,我们将更深入地探讨半监督学习及其与集成学习的结合方式。

# 2. 集成学习的理论框架

### 2.1 集成学习的概念和优势

集成学习是一种机器学习范式,它通过构建并结合多个学习器来完成学习任务。其核心思想是组合多个弱学习器的预测结果,以产生一个强学习器的预测,通常会得到比单独使用任一学习器更加准确和鲁棒的结果。

#### 2.1.1 集成学习的定义

在集成学习中,个体学习器通常被称为基学习器,而整体模型则是由这些基学习器组合而成的集成模型。根据集成中基学习器之间的关系,集成学习可以分为两大类:

- 同质集成(Homogeneous Ensemble):使用同种类型的基学习器,例如多个决策树构成的随机森林。

- 异质集成(Heterogeneous Ensemble):使用不同类型的基学习器,例如决策树、支持向量机等混合使用。

在定义上,集成学习的主要思想就是通过集体的智慧来解决学习问题,达到比单个学习器更好的性能。

#### 2.1.2 集成学习的性能优势

集成学习之所以在机器学习中备受青睐,是因为它具有以下优势:

- **误差降低**:通过结合多个模型,可以减少方差(Variance),从而减少过拟合的风险。

- **偏差降低**:如果各个模型之间相互独立,同时又能捕捉到数据的不同方面,集成学习能够降低偏差(Bias)。

- **鲁棒性增强**:集成学习对于噪声和异常值具有更强的容忍能力。

通过集成学习,可以在一定程度上缓解单一模型的缺陷,提高模型的泛化能力,因此在竞赛和工业界被广泛应用。

### 2.2 集成学习的策略分类

集成学习可以根据不同的构建策略分为若干方法类别。其中,Bagging、Boosting和Stacking是最为流行的三种策略。

#### 2.2.1 Bagging方法

**Bagging(Bootstrap Aggregating)** 通过构建多个相互独立的基学习器,并行地进行训练,然后将它们的预测结果按照某种策略(例如投票、平均)进行融合。这种方法在减少方差方面表现突出,著名的Bagging方法包括随机森林(Random Forest)。

#### 2.2.2 Boosting方法

**Boosting** 是一种迭代技术,通过顺序地训练多个基学习器,每个学习器都在上一个学习器的基础上进行改进,通常关注之前模型预测错误的样本。Boosting方法能够有效降低偏差,增强整体模型的准确性。代表性的Boosting方法有AdaBoost、XGBoost等。

#### 2.2.3 Stacking方法

**Stacking(Stacked Generalization)** 是一种比较特殊的集成方法,它将不同的模型作为第一层基学习器,然后将这些基学习器的预测结果作为输入,训练一个第二层的元学习器。Stacking方法不仅能够结合不同模型的优点,还能够通过元学习器进一步优化结果。

### 2.3 集成学习算法的优化技术

为了进一步提高集成学习的性能,需要引入一些优化技术来增强模型的多样性和准确性。

#### 2.3.1 算法集成的多样性提升

多样性是集成学习的核心。只有当各个基学习器之间具有足够的差异时,集成才能发挥最大的效能。提升多样性可以通过以下方式实现:

- **数据多样性**:通过数据层面的增强技术,如引入噪声、改变采样率等,来增加基学习器的数据变化性。

- **模型多样性**:使用不同的模型结构或者调整模型的超参数来增加模型之间的差异性。

#### 2.3.2 模型选择与融合策略

集成学习的效果很大程度上取决于基学习器的选择和融合策略。有效的模型选择可以基于模型性能进行挑选,而融合策略则包括但不限于:

- **投票机制**:对于分类问题,最常见的融合方法是投票机制。其中,每个基学习器对每个类别进行投票,最终选择票数最多的类别作为预测结果。

- **加权平均法**:对于回归问题,可以利用加权平均法,根据基学习器在验证集上的表现,赋予不同的权重。

融合策略的选择依赖于具体任务和学习器的类型,需要通过实验来确定最佳策略。

```python

# 示例:投票机制的Python代码实现

from sklearn.ensemble import VotingClassifier

from sklearn.linear_model import LogisticRegression

from sklearn.svm import SVC

from sklearn.tree import DecisionTreeClassifier

# 定义三个不同的分类器

clf1 = LogisticRegression(random_state=1)

clf2 = SVC(random_state=1)

clf3 = DecisionTreeClassifier(random_state=1)

# 创建VotingClassifier集成模型

eclf = VotingClassifier(estimators=[('lr', clf1), ('rf', clf2), ('gnb', clf3)], voting='hard')

# 训练模型

eclf.fit(X_train, y_train)

# 预测结果

predictions = eclf.predict(X_test)

```

以上代码创建了一个结合了逻辑回归、支持向量机和决策树的集成模型。通过`VotingClassifier`类,我们能够很方便地实现不同模型的集成和投票机制。这种集成方法在多个数据集上的表现通常优于单个分类器。

在下一章节中,我们将探讨半监督集成学习的关键技术,包括自训练方法、标签传播算法以及处理这些方法中遇到的挑战和对策。

# 3. 半监督集成学习的关键技术

## 3.1 自训练方法

### 3.1.1 自训练的基本原理

自训练(Self-training)是一种迭代的半监督学习方法,其核心思想是利用有标签的数据训练一个初始模型,然后用该模型为无标签数据进行标签预测,将预测置信度高的无标签数据和对应的预测标签加入到训练集中,反复迭代直至收敛。这个过程相当于模型不断自我训练和提升。

自训练过程中,初始的有标签数据集扮演着关键角色。这些数据通常需要有较好的代表性,因为它们定义了学习任务和模式。这个方法在处理文本分类、图像识别等任务时尤其有效。

### 3.1.2 自训练在半监督学习中的应用

自训练方法的一个典型应用是自然语言处理领域的词性标注任务。例如,我们可以使用小量的已标注文本训练一个词性标注器,然后该标注器对未标注的文本进行预测,将预测结果中置信度最高的部分加入到训练集中。如此迭代多次后,可以显著提升模型在未标注文本上的表现。

在视觉识别任务中,自训练也可以被用来提高模型的泛化能力。通过不断地将模型预测准确率高的未标注样本加入到训练集中,模型在新样本上的表现会越来越好。

## 3.2 标签传播算法

### 3.2.1 标签传播的理论基础

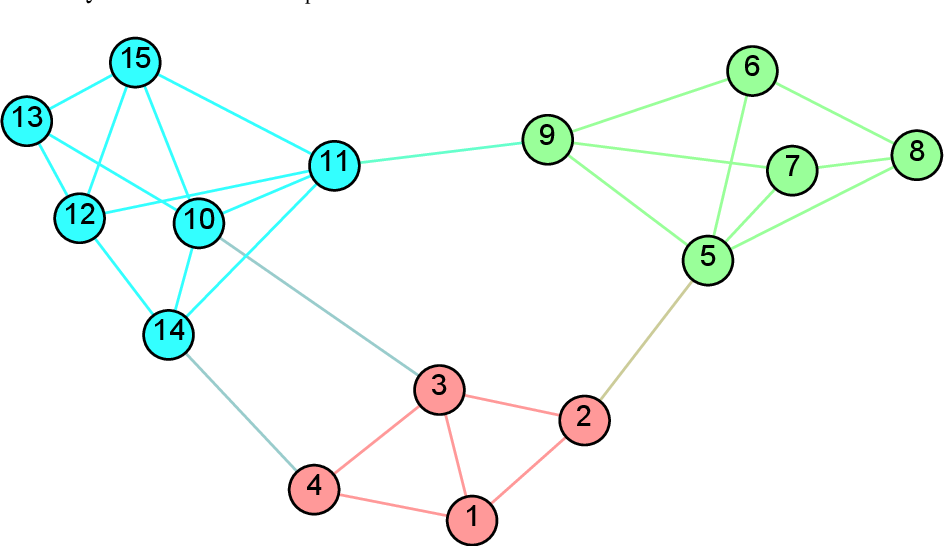

标签传播(Label Propagation)算法是解决半监督学习问题的另一种有效方法。它的核心是基于图的半监督学习思想,图中顶点代表样本,边代表样本间的相似性。算法通过迭代过程,将有标签样本的标签信息传播到无标签样本上,从而实现标签的预测和学习。

标签传播算法的关键在于图的构建和权重的分配,它通过图的拓扑结构和边的权重来决定标签信息的传播路径。算法通常假设相似的样本具有相同的标签,这通过边的权重来体现,权重越大,样本间相似性越高,标签信息传递的影响力越大。

### 3.2.2 标签传播的实践技巧

在实践中,标签传播算法的性能往往依赖于图的构建质量,包括节点的选择、边的权重计算方法等。一个常用的技巧是使用k近邻(k-NN)方法构建图,其中每对节点的权重通常由它们的相似度或距离计算得到,比如高斯核函数。

在标签传播过程中,为了防止标签的过度传播,即过拟合到训练数据上,需要引入平滑项或正则化项,这有助于保持标签的稳定性和预测的一致性。

```python

import numpy as np

from sklearn import datasets

from sklearn.semi_supervised import LabelSpreading

from sklearn.metrics import accuracy_score

# 以鸢尾花数据集为例

iris = datasets.load_iris()

X, y = iris.data, iris.target

n_samples, n_features = X.shape

# 有标签的数据

indices = np.array([0, 1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 12, 13, 14, 15])

y_train = y[indices]

X_train = X[indices]

# 无标签的数据

mask = np.ones(len(y), dtype=bool)

mask[indices] = False

X_test = X[mask]

y_test = y[mask]

# 使用标签传播算法

label_spread = LabelSpreading(kernel='knn')

label_spread.fit(X_train, y_train)

# 预测无标签数据的标签

y_pred = label_spread.predict(X_test)

# 评估准确率

print(f"Label Propagation accuracy: {accuracy_score(y_test, y_pred)}")

```

在上述示例代码中,我们使用`LabelSpreading`类实现了标签传播算法,并评估了在鸢尾花数据集上的准确率。通过调整算法参数,例如核函数类型,可以优化模型性能。

## 3.3 半监督集成学习的挑战与对策

### 3.3.1 处理不确定性的策略

半监督学习面临的挑战之一是如何处理未标注数据中的不确定性。这种不确定性可能来源于噪声、异常值,或者模型自身的不稳定性。为了应对这些挑战,研究者们提出了多种策略。

一种常见的策略是数据清洗

0

0