【高效数据预处理】:LightGBM技巧,让数据处理更上一层楼

发布时间: 2024-09-30 14:15:08 阅读量: 10 订阅数: 11

# 1. 数据预处理概述

## 1.1 数据预处理的重要性

在任何数据分析或机器学习项目中,数据预处理是至关重要的第一步。未经处理的数据往往是杂乱无章的,它包含噪音、缺失值、异常值以及可能存在的不一致性,这些都可能影响到后续模型的性能和准确性。因此,进行有效的数据预处理,可以提高数据质量,使分析结果更加可靠,为构建高效的机器学习模型打下坚实基础。

## 1.2 数据预处理的目标

数据预处理的主要目标是将原始数据转换为适合分析的格式。这个过程涉及多个步骤,包括数据清洗、数据转换、数据规范化、特征选择等。通过这些步骤,可以确保数据的完整性,提高数据的一致性,降低数据维度,从而简化模型结构,提升学习算法的效率和结果的准确性。

## 1.3 数据预处理的方法

数据预处理的方法多种多样,常见的有数据缺失值处理、数据规范化、离散化、特征编码、数据降维等。例如,数据规范化可以使用标准化或归一化方法使数据具有统一的尺度;离散化技术将连续特征划分成若干个区间,从而简化问题。这些方法通常需要结合具体问题和数据集的特点来选择和应用。

在接下来的章节中,我们将探讨LightGBM在数据预处理中的作用,它如何帮助我们更高效地进行数据预处理工作。

# 2. LightGBM算法基础

### 2.1 LightGBM的核心原理

#### 2.1.1 基于梯度提升的学习框架

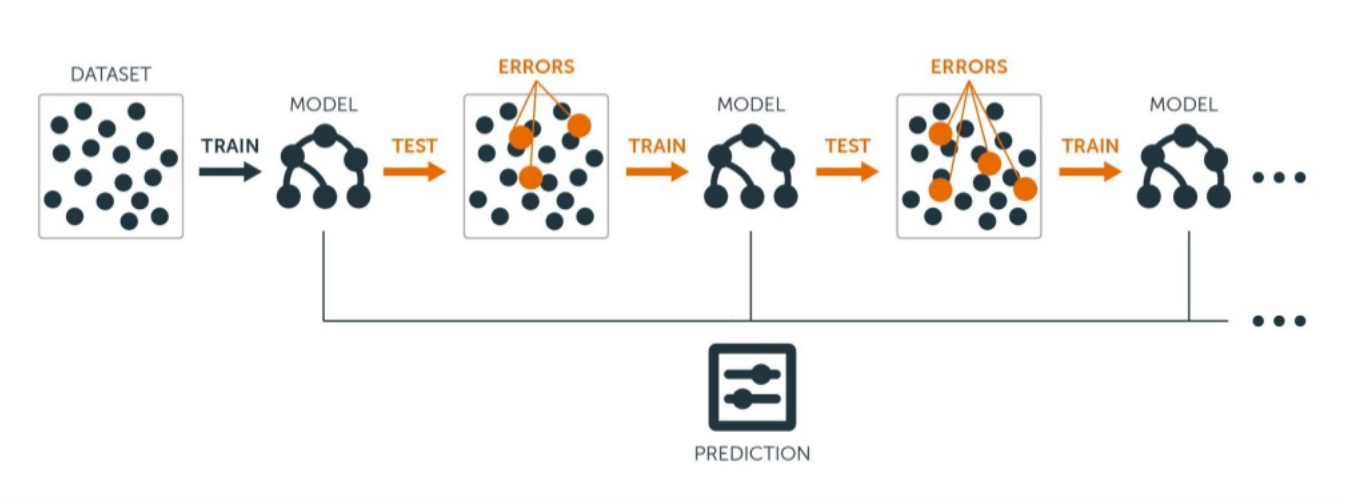

LightGBM是一种基于梯度提升的机器学习算法,它由微软推出,并且是基于决策树算法的。梯度提升机(Gradient Boosting Machine, GBM)通过迭代地增加新的弱学习器来改进模型的性能。每一步的弱学习器都专注于当前模型的不足,并试图最小化一个损失函数。在LightGBM中,这个弱学习器是一棵决策树。

LightGBM采用了一种称为带深度限制的直方图算法(Histogram-based Algorithm with Depth-Wise Growth)来构建决策树。这种算法不同于传统的逐点扫描方式,它首先将连续的特征值离散化为k个离散的bin,然后通过直方图的方式减少计算量,加速了梯度提升的过程。

- **代码块示例:**

```python

import lightgbm as lgb

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

# 加载数据集

iris = load_iris()

X, y = iris.data, iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 初始化LightGBM训练数据

train_data = lgb.Dataset(X_train, label=y_train)

# 设置参数

params = {

'objective': 'multiclass',

'num_class': 3,

'metric': 'multi_logloss'

}

# 训练模型

gbm = lgb.train(params, train_data)

# 预测

predictions = gbm.predict(X_test, num_iteration=gbm.best_iteration)

```

- **代码逻辑解读:**

1. 导入必要的库,这里使用了`lightgbm`和`sklearn`。

2. 加载数据集,并将数据集拆分为训练集和测试集。

3. 创建`lgb.Dataset`对象,这是LightGBM进行训练和预测所必需的。

4. 设置LightGBM的参数,`objective`定义了任务是多分类,`num_class`设置了类别数量,`metric`指定了损失函数。

5. 使用`lgb.train`函数训练模型,并用`gbm`对象保存训练结果。

6. 使用训练好的模型在测试集上进行预测,并指定使用最佳迭代次数`gbm.best_iteration`。

#### 2.1.2 LightGBM的特点和优势

LightGBM的特点在于它对梯度提升框架进行了一系列的优化和改进,使得它在效率和性能上都有显著的优势。它特别适合处理大规模数据集,因为它使用了基于直方图的算法,将连续特征值映射到离散的bin上。这样的离散化减少了计算量,同时在内存中只存储bin的边界,进一步减少了内存的使用。

LightGBM还支持并行学习,通过使用多线程技术,可以有效地利用CPU资源,在每个深度上并行地选择最佳分割点,从而加快了模型训练速度。除此之外,LightGBM还具有对类别特征的原生支持,不需要像其他模型那样进行独热编码处理。

- **表格:LightGBM与传统梯度提升方法的对比**

| 特性 | LightGBM | 传统梯度提升方法 |

|-------------------|--------------------------|---------------------------|

| 决策树构建算法 | 带深度限制的直方图算法 | 逐点扫描算法 |

| 内存使用效率 | 高 | 低 |

| 计算效率 | 高 | 低 |

| 多线程并行学习 | 支持 | 不支持 |

| 类别特征支持 | 原生支持 | 需要预处理 |

| 应用场景适应性 | 广泛 | 较窄 |

### 2.2 LightGBM的关键参数

#### 2.2.1 参数调优的基本方法

参数调优是机器学习模型优化中的关键步骤,它决定了模型的性能和泛化能力。LightGBM提供了大量的参数来调整训练过程,包括但不限于学习率、树的深度、特征的子采样比例等。基本的参数调优方法包括手动调整、网格搜索和随机搜索等。

手动调整通常基于经验进行,调整参数直到模型的性能达到预期。网格搜索是在指定的参数范围内穷举所有可能的参数组合,以找到最优的模型。随机搜索则是在指定的参数空间内随机选择参数组合进行测试,通常比网格搜索更快,因为它不需要测试所有可能的组合。

- **代码块示例:**

```python

from sklearn.model_selection import GridSearchCV

# 设置LightGBM的参数网格

param_grid = {

'learning_rate': [0.01, 0.1, 0.2],

'num_leaves': [20, 40, 60],

'feature_fraction': [0.7, 0.8, 0.9]

}

# 使用GridSearchCV进行网格搜索

gbm = lgb.LGBMClassifier()

grid_search = GridSearchCV(estimator=gbm, param_grid=param_grid, cv=3, n_jobs=-1, scoring='accuracy')

grid_search.fit(X_train, y_train)

# 输出最佳参数

best_params = grid_search.best_params_

print("Best parameters found: ", best_params)

```

- **代码逻辑解读:**

1. 设置一个参数网格`param_grid`,这里指定了学习率、叶子节点数量和特征抽样比例的可能值。

2. 使用`GridSearchCV`进行网格搜索,设置交叉验证的折数为3,使用所有可用的CPU核心进行并行搜索,并且以准确度作为评分标准。

3. 将预处理好的训练数据`X_train`和`y_train`输入到网格搜索中。

4. 输出网格搜索找到的最佳参数组合。

#### 2.2.2 常见参数的深度解析

在LightGBM中,一些关键的参数对于最终模型的性能有着决定性的影响。例如,`learning_rate`(学习率)控制着每一步的权重更新大小,较低的学习率有助于提升模型的泛化能力,但增加了训练时间。`num_leaves`(叶子节点数)是树的复杂度的直接影响因素,增加叶子节点数可以提升模型的拟合能力,但过高的值可能导致过拟合。`feature_fraction`(特征抽样比例)通过随机选择部分特征来训练每一棵树,这有助于增加模型的多样性,防止过拟合。

调整这些参数需要理解它们在模型训练过程中的作用,并通过实验来找到最佳的参数组合。理解这些参数的影响可以帮助快速定位模型可能遇到的问题,并采取相应的策略进行优化。

- **mermaid格式流程图:LightGBM参数调优流程**

```mermaid

graph LR

A[开始调优] --> B[设定参数范围]

B --> C[选择调优方法]

C --> D[网格搜索]

C --> E[随机搜索]

C --> F[贝叶斯优化]

D --> G[交叉验证]

E --> G

F --> G

G --> H[评估模型性能]

H --> I{性能是否满意?}

I -- 是 --> J[记录参数]

I -- 否 --> B[重新设定参数范围]

J --> K[结束调优]

```

- **流程图解读:**

1. 开始调优流程,首先设定参数范围,这可能基于先验知识或初步的实验结果。

2. 接下来选择一个调优方法,这里列举了网格搜索、随机搜索和贝叶斯优化三种常见方法。

3. 选择的参数调整方法将对模型进行交叉验证,以检验不同参数组合的性能。

4. 通过交叉验证评估模型性能,然后判断是否达到预期的性能目标。

5. 如果性能满意,则记录当前的参数设置,并结束调优流程。

6. 如果性能不满意,则需要重新设定参数范围,并重复调优流程。

# 3. LightGBM在数据预处理中的应用

## 3.1 离散化与特征组合

### 3.1.1 离散化技术与应用实例

离散化是将连续变量转化为离散变量的过程,其在数据预处理中扮演着至关重要的角色。离散化可以减少数据噪声、减少数据维度,并且有助于后续模型的构建和计算。在使用LightGBM进行数据预处理时,可以通过内置的离散化功能,将连续型特征转换为分类型特征,同时利用离散化后的数据进行特征组合,从而挖掘出更有用的特征。

以一个典型的例子说明,假设我们有一个关于用户年龄的连续特征,这个特征可能会由于年龄分布不均等因素,导致模型难以捕捉到不同年龄段用户的行为差异。通过LightGBM提供的离散化处理,可以将年龄分段,例如划分为少年、青年、中年、老年等几个阶段。然后,可以将这些阶段作为新的特征输入到模型中。

以下是一个基于Python的代码示例,展示了如何使用LightGBM进行特征离散化并进行模型训练:

```python

import lightgbm as lgb

import pandas as pd

from sklearn.datasets import load_breast_cancer

# 加载数据集

data = load_breast_cancer()

X = pd.DataFrame(data.data, columns=data.feature_names)

y = pd.Series(data.target)

# 使用LightGBM进行特征离散化

params = {

'objective': 'binary',

'metric': 'binary_logloss'

}

train_data = lgb.Dataset(X, label=y)

# 设置参数并启用离散化

params['feature_fraction_bynode'] = 0.05

bst = lgb.train(params, train_data, num_boost_round=10)

# 离散化后的新特征保存

discrete_features = bst.dump_model()['feature_name']

```

在这个例子中,我们使用了`feature_fraction_bynode`参数来控制每个节点的特征采样比例,这实际上是一个间接的离散化参数。它通过限制每个节点使用的特征数量来帮助模型找到特征的离散阈值。

### 3.1.2 特征组合的方法和效果评估

特征组合是指将多个特征按照一定的规则或算法组合成新的特征,这样做可以增强模型对数据模式的理解能力。LightGBM支持通过内置的交叉特征生成功能来自动进行特征组合,这在一定程度上可以提升模型性能。

特征组合的常见方法包括:

- 乘法组合:两个特征相乘。

- 高阶组合:三个或更多特征的组合。

- 哈希技巧:利用哈希函数将多个特征映射到有限的特征空间中。

在LightGBM中,可以通过设置参数`feature_fraction`来控制特征组合的数量和多样性。较小的`feature_fraction`会鼓励模型更多地进行特征组合。

接下来,我们将演示如何在LightGBM中进行特征组合,并使用AUC(Area Under Curve)等指标评估模型性能:

```python

import numpy as np

from sklearn.metrics import roc_auc_score

# 使用交叉验证评估特征组合的效果

cv_results = lgb.cv(para

```

0

0